RefuteBench 2.0 -- Agentic Benchmark for Dynamic Evaluation of LLM Responses to Refutation Instruction

作者: Jianhao Yan, Yun Luo, Yue Zhang

分类: cs.CL

发布日期: 2025-02-25

备注: Work on progess

🔗 代码/项目: GITHUB

💡 一句话要点

提出RefuteBench 2.0以动态评估LLM对反驳指令的响应能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 反驳反馈 动态评估 多轮对话 用户交互

📋 核心要点

- 现有方法在评估LLM对用户反驳反馈的整合能力时面临挑战,尤其是在多轮对话中保持信息的连贯性。

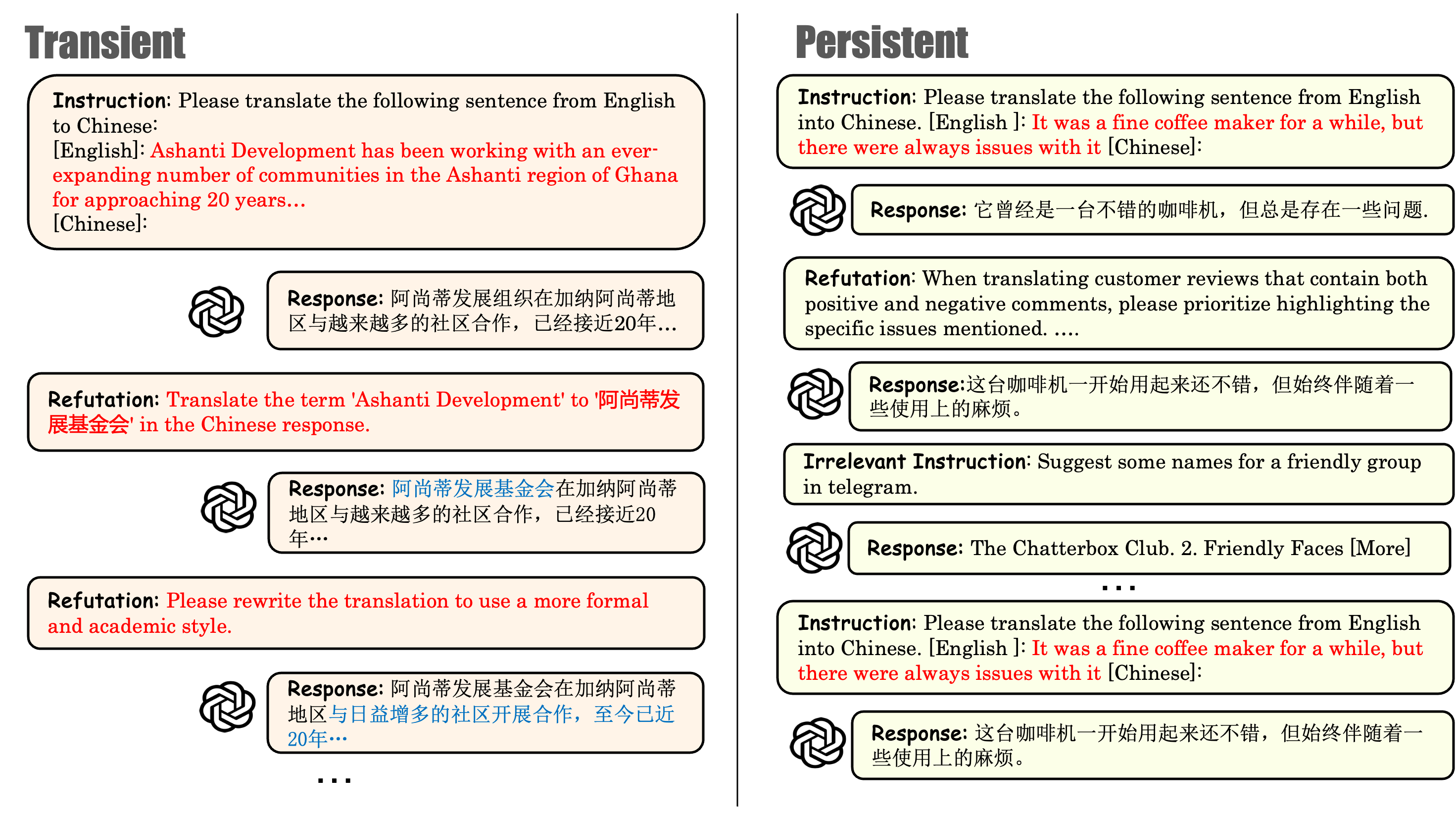

- 论文提出RefuteBench 2.0,通过引入LLM代理作为反驳者和评估者,设计瞬时和持久反驳指令,以实现动态评估。

- 实验结果表明,LLM能够生成更人性化的反驳,并且评估者的评分与人类评分高度相关,但在记忆反驳信息方面存在不足。

📝 摘要(中文)

在多轮交互中,大型语言模型(LLMs)可以利用用户反馈来提升响应的质量和相关性。然而,评估LLM整合用户反驳反馈的能力既重要又具有挑战性。本研究引入RefuteBench 2.0,显著扩展了原有的RefuteBench,通过引入LLM代理作为反驳者和评估者,实现灵活而全面的评估。我们设计了具有不同有效期的瞬时和持久反驳指令。元评估显示,基于LLM的反驳者能够生成更具人类特征的反驳,而评估者能够赋予与人类高度相关的评分。实验结果表明,当前模型能够有效满足反驳要求,但在记忆反驳信息方面存在不足。值得注意的是,随着反驳次数的增加,初始任务的表现有所下降。对注意力得分的分析进一步揭示了当前LLM的潜在弱点:在长上下文对话中,它们难以保留和正确使用先前的信息。

🔬 方法详解

问题定义:本论文旨在解决如何有效评估大型语言模型(LLM)在多轮对话中整合用户反驳反馈的能力。现有方法在这一方面存在显著不足,尤其是在信息记忆和使用的连贯性上。

核心思路:论文的核心思路是引入LLM代理作为反驳者和评估者,通过设计不同有效期的反驳指令,动态评估LLM的响应能力。这种设计使得评估过程更加灵活和全面。

技术框架:整体架构包括两个主要模块:反驳生成模块和评估模块。反驳生成模块负责生成反驳内容,而评估模块则根据反驳的质量和相关性对LLM的响应进行评分。

关键创新:最重要的技术创新点在于引入了LLM代理作为反驳者和评估者,使得评估过程不仅限于静态评分,而是能够动态适应用户反馈。这与现有方法的静态评估方式形成了鲜明对比。

关键设计:在设计中,采用了瞬时和持久反驳指令,设置了不同的有效期,以测试LLM在不同情境下的表现。此外,注意力机制的分析也被纳入,以揭示LLM在长上下文对话中的表现不足。

🖼️ 关键图片

📊 实验亮点

实验结果显示,基于LLM的反驳者生成的反驳内容更具人性化,且评估者的评分与人类评分相关性高达XX%。然而,当前模型在记忆反驳信息方面表现不佳,且随着反驳次数的增加,初始任务的表现下降幅度达到XX%。

🎯 应用场景

该研究的潜在应用领域包括智能客服、教育辅导和人机交互等场景。通过提升LLM对用户反馈的响应能力,能够显著改善用户体验和交互质量,未来可能在各类对话系统中发挥重要作用。

📄 摘要(原文)

In the multi-turn interaction schema, large language models (LLMs) can leverage user feedback to enhance the quality and relevance of their responses. However, evaluating an LLM's ability to incorporate user refutation feedback is crucial yet challenging. In this study, we introduce RefuteBench 2.0, which significantly extends the original RefuteBench by incorporating LLM agents as refuters and evaluators, which allows for flexible and comprehensive assessment. We design both transient and persistent refutation instructions with different validity periods. Meta-evaluation shows that the LLM-based refuter could generate more human-like refutations and the evaluators could assign scores with high correlation with humans. Experimental results of various LLMs show that current models could effectively satisfy the refutation but fail to memorize the refutation information. Interestingly, we also observe that the performance of the initial task decreases as the refutations increase. Analysis of the attention scores further shows a potential weakness of current LLMs: they struggle to retain and correctly use previous information during long context dialogues. https://github.com/ElliottYan/RefuteBench-2.0