ReVision: A Dataset and Baseline VLM for Privacy-Preserving Task-Oriented Visual Instruction Rewriting

作者: Abhijit Mishra, Mingda Li, Hsiang Fu, Richard Noh, Minji Kim

分类: cs.CL, cs.AI, cs.CV

发布日期: 2025-02-20 (更新: 2025-12-31)

备注: Accepted and to appear in IJCNLP-AACL 2025

💡 一句话要点

提出ReVision数据集与基线VLM,用于保护隐私的视觉指令重写任务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 隐私保护 指令重写 多模态交互 设备端AI

📋 核心要点

- 现有VLM依赖云端处理,存在视觉数据隐私泄露风险,且难以满足实时性要求。

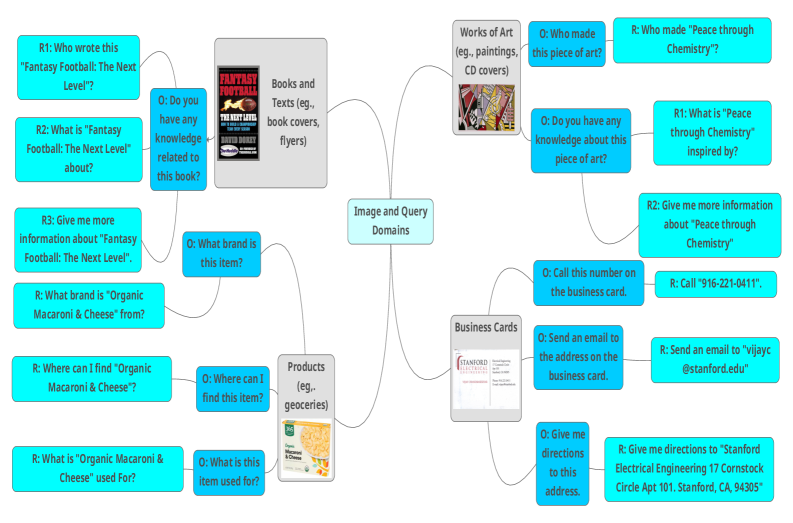

- 提出视觉指令重写方法,将多模态指令转化为文本,利用轻量级VLM在本地设备上处理。

- 构建包含39000+样本的数据集,并设计紧凑型VLM,实验证明其有效性和实用性。

📝 摘要(中文)

随着AR、VR和现代智能手机日益普及,高效且保护隐私的多模态交互变得至关重要。现有强大的视觉语言模型(VLM)依赖云端处理,引发了视觉数据隐私和实时性问题。本文探索了视觉指令重写,将多模态指令转换为纯文本命令,从而将轻量级的设备端指令重写VLM(250M参数)与现有对话AI系统集成,增强视觉数据隐私。为此,我们提出了一个包含14个领域超过39,000个示例的数据集,并开发了一个紧凑的VLM,该VLM在图像字幕数据集上进行预训练,并针对指令重写进行微调。实验结果表明,即使是量化后的模型(<500MB存储空间)也能实现有效的指令重写,从而实现以隐私为中心的多模态AI应用。

🔬 方法详解

问题定义:论文旨在解决多模态人机交互中,现有视觉语言模型(VLM)依赖云端处理带来的视觉数据隐私泄露和实时性不足的问题。现有方法需要将敏感的视觉数据上传到服务器进行处理,用户隐私无法得到保障,同时云端处理也引入了延迟,影响用户体验。

核心思路:论文的核心思路是将多模态指令(包含视觉信息和文本指令)转换为纯文本指令,从而可以使用轻量级的、可以在本地设备上运行的VLM进行处理。这样既避免了将视觉数据上传到云端,保护了用户隐私,又降低了计算延迟,提高了响应速度。

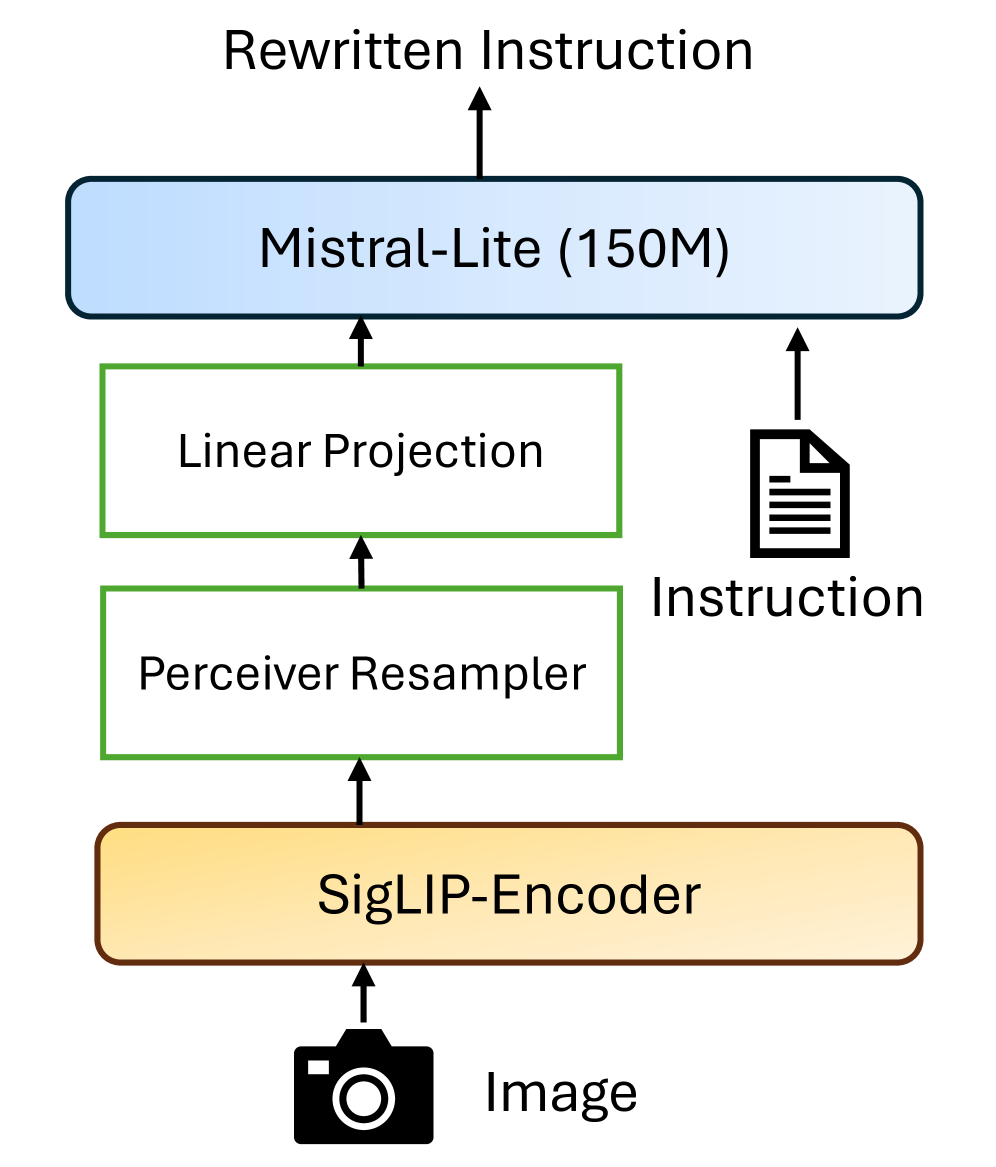

技术框架:整体框架包含两个主要部分:一是视觉指令重写VLM,负责将多模态指令转换为文本指令;二是现有的对话AI系统,负责处理文本指令并生成相应的回复。视觉指令重写VLM首先在图像字幕数据集上进行预训练,然后在一个新的视觉指令重写数据集上进行微调。

关键创新:最重要的技术创新点在于提出了视觉指令重写的概念,并构建了相应的数据集和基线模型。与直接使用大型VLM处理多模态指令相比,该方法通过指令重写,将问题简化为文本处理,从而可以使用更小的模型,在保护隐私的同时,实现高效的交互。

关键设计:论文设计了一个包含39000+样本的视觉指令重写数据集,涵盖14个领域。VLM模型采用encoder-decoder结构,encoder用于处理视觉信息,decoder用于生成文本指令。模型在图像字幕数据集上进行预训练,学习视觉和文本之间的关联,然后在视觉指令重写数据集上进行微调,优化指令重写能力。为了进一步降低模型大小,论文还对模型进行了量化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是量化后的模型(<500MB存储空间)也能实现有效的指令重写。通过NLG指标(BLEU、METEOR、ROUGE)和语义解析分析,验证了该方法的有效性。该方法在保证隐私的同时,实现了与大型VLM相媲美的性能。

🎯 应用场景

该研究成果可应用于各种需要保护用户隐私的多模态人机交互场景,例如智能家居、AR/VR应用、智能助手等。用户可以通过视觉指令与设备进行交互,而无需担心个人隐私泄露。此外,该方法还可以降低对硬件的要求,使得更多设备能够支持复杂的多模态交互。

📄 摘要(原文)

Efficient and privacy-preserving multimodal interaction is essential as AR, VR, and modern smartphones with powerful cameras become primary interfaces for human-computer communication. Existing powerful large vision-language models (VLMs) enabling multimodal interaction often rely on cloud-based processing, raising significant concerns about (1) visual privacy by transmitting sensitive vision data to servers, and (2) their limited real-time, on-device usability. This paper explores Visual Instruction Rewriting, a novel approach that transforms multimodal instructions into text-only commands, allowing seamless integration of lightweight on-device instruction rewriter VLMs (250M parameters) with existing conversational AI systems, enhancing vision data privacy. To achieve this, we present a dataset of over 39,000 examples across 14 domains and develop a compact VLM, pretrained on image captioning datasets and fine-tuned for instruction rewriting. Experimental results, evaluated through NLG metrics such as BLEU, METEOR, and ROUGE, along with semantic parsing analysis, demonstrate that even a quantized version of the model (<500MB storage footprint) can achieve effective instruction rewriting, thus enabling privacy-focused, multimodal AI applications.