EvoP: Robust LLM Inference via Evolutionary Pruning

作者: Shangyu Wu, Hongchao Du, Ying Xiong, Shuai Chen, Tei-Wei Kuo, Nan Guan, Chun Jason Xue

分类: cs.CL, cs.AI

发布日期: 2025-02-19 (更新: 2025-08-13)

💡 一句话要点

EvoP:通过演化剪枝实现鲁棒的大语言模型推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型剪枝 演化算法 聚类采样 资源受限环境

📋 核心要点

- 现有LLM剪枝方法采用启发式策略,忽略数据特征,导致性能次优,难以在资源受限环境部署。

- EvoP通过聚类采样构建多样化校准数据集,并采用演化搜索寻找最优剪枝模式。

- 实验表明,EvoP在不同LLM和下游任务上均表现出最佳性能和效率,具有实际应用价值。

📝 摘要(中文)

大型语言模型(LLM)在自然语言处理任务中取得了显著成功,但其庞大的规模和计算需求阻碍了它们在资源受限环境中的部署。现有的模型剪枝方法通过移除模型中冗余的结构(例如,元素、通道、层)来解决这个问题。然而,这些方法采用启发式剪枝策略,导致次优的性能。此外,它们在剪枝模型时也忽略了数据特征。为了克服这些限制,我们提出了EvoP,一个用于鲁棒LLM推理的演化剪枝框架。EvoP首先提出了一种基于聚类的校准数据集采样(CCDS)策略,用于创建更多样化的校准数据集。然后,EvoP引入了一种演化剪枝模式搜索(EPPS)方法来找到最优的剪枝模式。与现有的模型剪枝技术相比,EvoP在保持最佳效率的同时实现了最佳性能。在不同的LLM和不同的下游任务上的实验验证了所提出的EvoP的有效性,使其成为在实际应用中部署LLM的实用且可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在资源受限环境下部署困难的问题。现有剪枝方法依赖启发式策略,忽略数据特性,导致剪枝后的模型性能下降,无法充分利用LLM的潜力。因此,需要一种更有效、更鲁棒的剪枝方法,能够在保持模型性能的同时,显著降低计算资源需求。

核心思路:EvoP的核心思路是结合数据特征和演化算法,寻找最优的剪枝模式。通过聚类校准数据集,保证数据多样性,避免剪枝过程对特定数据分布的过拟合。利用演化算法的全局搜索能力,克服启发式剪枝的局部最优问题,从而获得更优的剪枝方案。

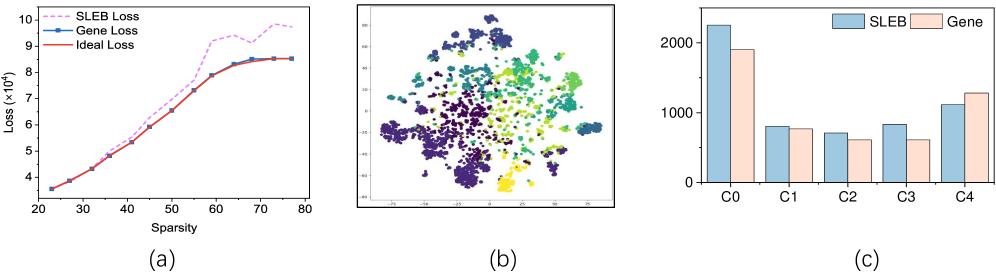

技术框架:EvoP框架主要包含两个阶段:1) 基于聚类的校准数据集采样(CCDS):对原始数据集进行聚类,并从每个簇中选择代表性样本,构建一个更具多样性的校准数据集。2) 演化剪枝模式搜索(EPPS):使用演化算法搜索最优的剪枝模式,目标是在保持模型性能的同时,最大程度地减少模型参数量。

关键创新:EvoP的关键创新在于将聚类采样和演化算法相结合,用于LLM的剪枝。CCDS策略能够有效提升校准数据集的多样性,从而提高剪枝的鲁棒性。EPPS方法能够克服启发式剪枝的局限性,找到全局最优的剪枝模式。

关键设计:CCDS策略中,聚类算法的选择和簇的数量是关键参数。EPPS方法中,演化算法的选择(如遗传算法)、适应度函数的设计(平衡性能和参数量)、以及剪枝粒度的选择(如元素级别、通道级别)是关键设计。适应度函数通常包含一个性能损失项和一个参数量减少项,通过调整两者的权重来控制剪枝的强度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EvoP在多个LLM和下游任务上均取得了显著的性能提升。与现有的剪枝方法相比,EvoP在保持相似甚至更高性能的同时,能够实现更高的压缩率。例如,在某些任务上,EvoP可以将模型参数量减少50%以上,同时性能仅下降不到1%。这些结果验证了EvoP的有效性和实用性。

🎯 应用场景

EvoP可应用于各种资源受限的场景,例如移动设备、嵌入式系统和边缘计算设备。通过降低LLM的计算需求,EvoP使得在这些平台上部署复杂的自然语言处理应用成为可能,例如智能助手、机器翻译和文本摘要。该研究有助于推动LLM在实际应用中的普及,并为未来的模型压缩和优化研究提供新的思路。

📄 摘要(原文)

Large Language Models (LLMs) have achieved remarkable success in natural language processing tasks, but their massive size and computational demands hinder their deployment in resource-constrained environments. Existing model pruning methods address this issue by removing redundant structures (e.g., elements, channels, layers) from the model. However, these methods employ a heuristic pruning strategy, which leads to suboptimal performance. Besides, they also ignore the data characteristics when pruning the model. To overcome these limitations, we propose EvoP, an evolutionary pruning framework for robust LLM inference. EvoP first presents a cluster-based calibration dataset sampling (CCDS) strategy for creating a more diverse calibration dataset. EvoP then introduces an evolutionary pruning pattern searching (EPPS) method to find the optimal pruning pattern. Compared to existing model pruning techniques, EvoP achieves the best performance while maintaining the best efficiency. Experiments across different LLMs and different downstream tasks validate the effectiveness of the proposed EvoP, making it a practical and scalable solution for deploying LLMs in real-world applications.