DataSciBench: An LLM Agent Benchmark for Data Science

作者: Dan Zhang, Sining Zhoubian, Min Cai, Fengzu Li, Lekang Yang, Wei Wang, Tianjiao Dong, Ziniu Hu, Jie Tang, Yisong Yue

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-02-19

备注: 40 pages, 7 figures, 6 tables

🔗 代码/项目: GITHUB

💡 一句话要点

DataSciBench:一个用于评估LLM在数据科学任务中能力的综合性基准测试。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数据科学 基准测试 代码生成 模型评估

📋 核心要点

- 现有数据科学LLM基准测试侧重于简单任务和指标,缺乏对复杂真实场景的有效评估。

- DataSciBench通过构建包含不确定真值和复杂评估指标的提示,更全面地评估LLM的数据科学能力。

- 实验结果表明,API模型优于开源模型,Deepseek-Coder-33B-Instruct在开源模型中表现最佳,揭示了LLM在数据科学中的优劣势。

📝 摘要(中文)

本文提出了DataSciBench,一个用于评估大型语言模型(LLM)在数据科学领域能力的综合性基准。现有的相关基准主要集中于单一任务、易于获得的真值以及直接的评估指标,这限制了可评估任务的范围。相比之下,DataSciBench基于更全面和精心策划的自然且具有挑战性的提示构建,用于处理不确定的真值和评估指标。我们开发了一个半自动化的流程,用于生成真值(GT)和验证评估指标。该流程利用并实现了基于LLM的自洽性和人工验证策略,通过利用收集到的提示、预定义的任务类型和聚合函数(指标)来生成准确的GT。此外,我们提出了一个创新的任务-函数-代码(TFC)框架,以基于精确定义的指标和程序规则来评估每个代码执行结果。我们的实验框架涉及使用我们收集的各种提示来测试6个基于API的模型、8个开源通用模型和9个开源代码生成模型。这种方法旨在为LLM在数据科学中提供更全面和严格的评估,揭示它们的优势和劣势。实验结果表明,基于API的模型在所有指标上都优于开源模型,并且Deepseek-Coder-33B-Instruct在开源模型中获得了最高分。我们在https://github.com/THUDM/DataSciBench发布了所有代码和数据。

🔬 方法详解

问题定义:现有LLM数据科学基准测试主要关注简单、孤立的任务,依赖于容易获得的精确真值和简单的评估指标。这无法充分评估LLM在实际数据科学场景中处理复杂、不确定性数据和目标的真实能力。现有方法难以模拟真实世界数据科学任务的复杂性和多样性。

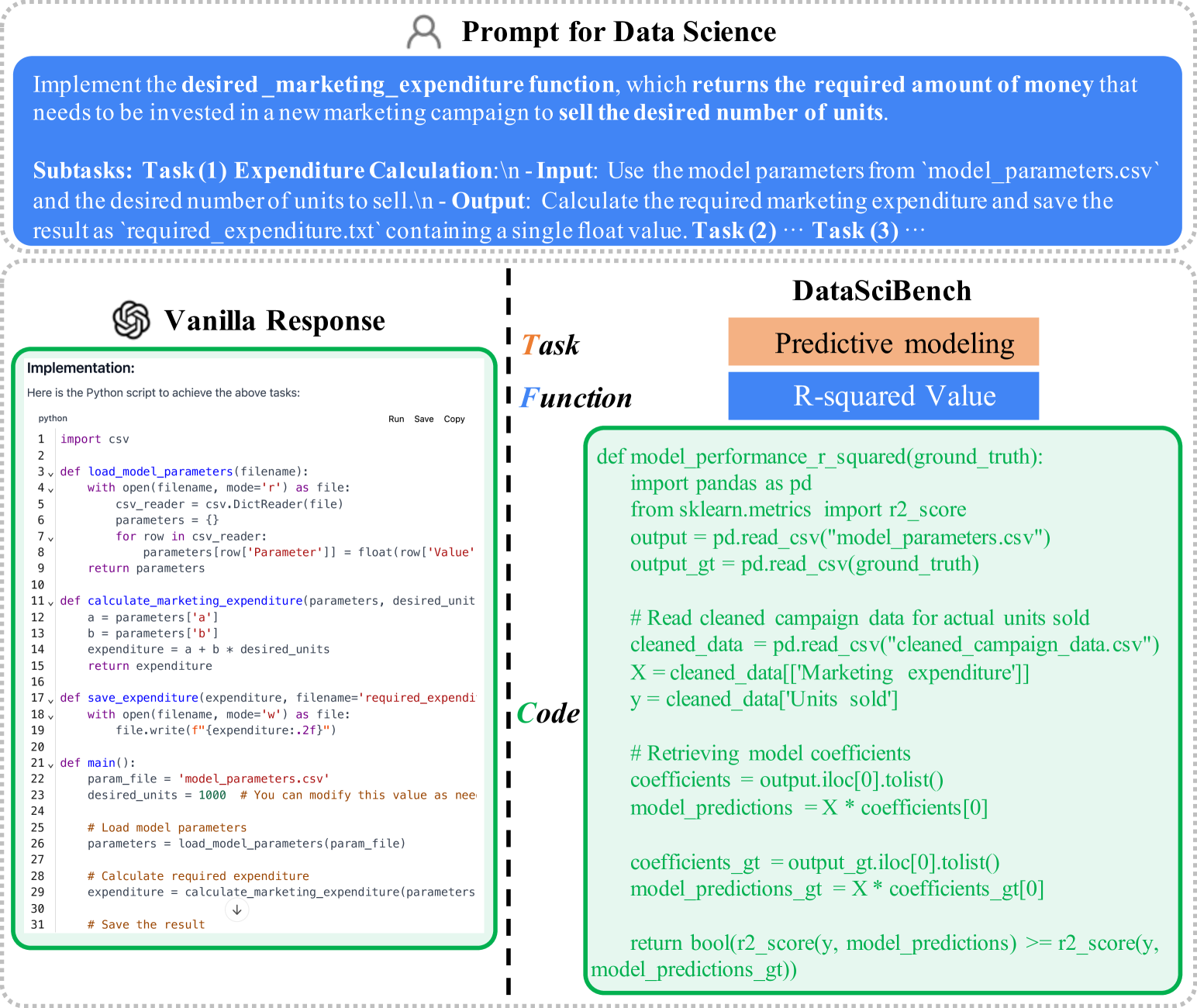

核心思路:DataSciBench的核心思路是构建一个更具挑战性和现实性的基准测试,包含更复杂、更自然的提示,以及不确定的真值和更精细的评估指标。通过半自动化的真值生成和验证流程,以及创新的任务-函数-代码(TFC)评估框架,更全面地评估LLM在数据科学任务中的表现。

技术框架:DataSciBench的整体框架包括以下几个主要阶段:1) 收集和整理数据科学任务的自然提示;2) 开发半自动化的真值生成和验证流程,利用LLM的自洽性和人工验证来生成高质量的真值;3) 设计任务-函数-代码(TFC)框架,用于评估代码执行结果,该框架基于预定义的指标和程序规则;4) 使用收集到的提示和TFC框架,对各种LLM进行评估,包括API模型、开源通用模型和开源代码生成模型。

关键创新:DataSciBench的关键创新在于:1) 提出了一个更全面和现实的数据科学基准测试,包含复杂提示和不确定真值;2) 开发了半自动化的真值生成和验证流程,提高了真值的质量和可靠性;3) 提出了任务-函数-代码(TFC)框架,用于更精细地评估代码执行结果。与现有方法相比,DataSciBench更注重评估LLM在真实数据科学场景中的能力。

关键设计:DataSciBench的关键设计包括:1) 提示的设计,旨在模拟真实数据科学任务的复杂性和多样性;2) 真值生成流程中,LLM自洽性和人工验证的结合,确保真值的准确性;3) TFC框架中,任务、函数和代码之间的对应关系,以及预定义的指标和程序规则,用于评估代码执行结果的正确性和效率。具体的参数设置和损失函数等细节未在摘要中提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,API模型在所有指标上都优于开源模型,这表明API模型在数据科学任务中具有更强的能力。在开源模型中,Deepseek-Coder-33B-Instruct取得了最高的得分,表明其在代码生成和数据处理方面具有较强的竞争力。这些结果为LLM在数据科学领域的应用提供了重要的参考。

🎯 应用场景

DataSciBench可用于评估和比较不同LLM在数据科学领域的性能,帮助研究人员和开发者选择最适合特定任务的模型。该基准测试还可以促进LLM在数据科学领域的应用,例如自动化数据分析、数据可视化和模型构建。未来,DataSciBench可以扩展到更多的数据科学任务和领域,并与其他基准测试相结合,形成更全面的评估体系。

📄 摘要(原文)

This paper presents DataSciBench, a comprehensive benchmark for evaluating Large Language Model (LLM) capabilities in data science. Recent related benchmarks have primarily focused on single tasks, easily obtainable ground truth, and straightforward evaluation metrics, which limits the scope of tasks that can be evaluated. In contrast, DataSciBench is constructed based on a more comprehensive and curated collection of natural and challenging prompts for uncertain ground truth and evaluation metrics. We develop a semi-automated pipeline for generating ground truth (GT) and validating evaluation metrics. This pipeline utilizes and implements an LLM-based self-consistency and human verification strategy to produce accurate GT by leveraging collected prompts, predefined task types, and aggregate functions (metrics). Furthermore, we propose an innovative Task - Function - Code (TFC) framework to assess each code execution outcome based on precisely defined metrics and programmatic rules. Our experimental framework involves testing 6 API-based models, 8 open-source general models, and 9 open-source code generation models using the diverse set of prompts we have gathered. This approach aims to provide a more comprehensive and rigorous evaluation of LLMs in data science, revealing their strengths and weaknesses. Experimental results demonstrate that API-based models outperform open-sourced models on all metrics and Deepseek-Coder-33B-Instruct achieves the highest score among open-sourced models. We release all code and data at https://github.com/THUDM/DataSciBench.