Scaling Multimodal Search and Recommendation with Small Language Models via Upside-Down Reinforcement Learning

作者: Yu-Chen Lin, Sanat Sharma, Hari Manikandan, Jayant Kumar, Tracy Holloway King, Jing Zheng

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-02-14 (更新: 2025-12-03)

备注: Accepted by ICDM 2025 MMSR

💡 一句话要点

提出基于倒置强化学习的小语言模型多模态搜索与推荐框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态搜索 多模态推荐 小语言模型 倒置强化学习 合成数据蒸馏 GPT-2 模型压缩

📋 核心要点

- 现有LLM虽然性能强大,但计算成本高昂,难以在资源受限的实时多模态搜索和推荐场景中部署。

- 利用倒置强化学习和合成数据蒸馏,训练小型语言模型(SLM)进行多任务提示生成,降低计算成本。

- 实验表明,参数量仅为1亿的SLM在相关性和多样性指标上,可达到与80亿参数LLM相近的性能。

📝 摘要(中文)

本文研究了如何扩展小语言模型(SLM)以支持多模态搜索和推荐用例,同时保持足够的效率以用于实时、资源受限的部署。我们提出了一个框架,该框架结合了倒置强化学习与来自大型语言模型(Llama-3)的合成数据蒸馏,以训练一个1亿参数的GPT-2模型用于多任务提示生成。尽管比最先进的大型语言模型(LLM)小80倍,但我们的SLM实现了与Llama-3 8B、Qwen3 8B和Ministral 8B等竞争基线相差不到6%的相关性和多样性分数。这些结果表明,SLM可以有效地处理多模态搜索和推荐任务,同时显著降低推理延迟和内存开销。我们的研究强调了轻量级模型作为可扩展多模态发现的实用引擎的潜力,弥合了前沿研究与媒体推荐和创意内容生成等实际多模态应用之间的差距。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在多模态搜索和推荐系统中部署时面临的计算资源消耗过高的问题。现有方法依赖于参数量巨大的LLM,导致推理延迟高、内存占用大,难以满足实时性和资源约束的需求。

核心思路:论文的核心思路是利用小语言模型(SLM)替代大型LLM,并通过倒置强化学习和合成数据蒸馏的方法,使SLM在保持较低计算成本的同时,尽可能逼近LLM的性能。倒置强化学习允许模型直接学习生成期望行为的策略,而无需显式奖励函数。

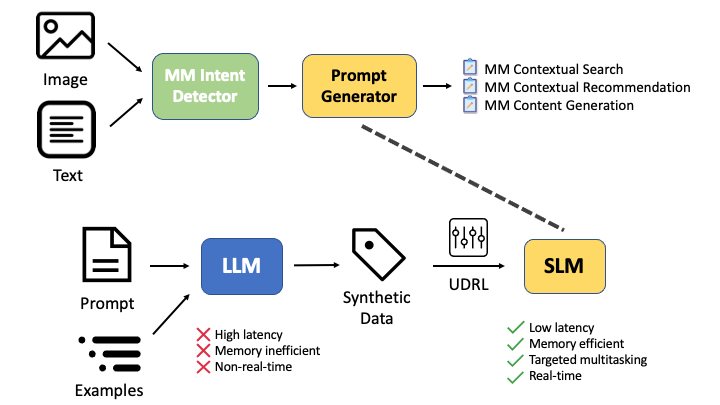

技术框架:整体框架包含以下几个主要阶段:1) 使用大型语言模型(如Llama-3)生成合成数据,模拟多模态搜索和推荐场景下的用户行为和偏好。2) 利用这些合成数据,结合倒置强化学习,训练一个小型语言模型(如GPT-2)进行多任务提示生成。3) 将训练好的SLM部署到实际的多模态搜索和推荐系统中,用于生成搜索查询或推荐提示。

关键创新:最重要的技术创新点在于结合了倒置强化学习和合成数据蒸馏,有效地训练了一个参数量远小于LLM的SLM,使其能够在多模态搜索和推荐任务中达到与LLM相近的性能。与传统的监督学习方法相比,倒置强化学习能够更好地学习生成期望行为的策略。

关键设计:论文使用GPT-2作为SLM的基础架构,并采用1亿参数的模型规模。在倒置强化学习中,模型的目标是生成能够导致期望结果的提示。损失函数的设计旨在最大化生成提示与期望行为之间的相似度。合成数据的质量和多样性对SLM的性能至关重要,因此论文采用了精心设计的提示策略来生成高质量的合成数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用倒置强化学习训练的1亿参数GPT-2模型,在多模态搜索和推荐任务中,其相关性和多样性指标与80亿参数的Llama-3、Qwen3和Ministral等大型语言模型相比,差距仅在6%以内。这表明SLM在保持较低计算成本的同时,能够有效逼近LLM的性能。

🎯 应用场景

该研究成果可广泛应用于多模态搜索、推荐系统、创意内容生成等领域。例如,在电商平台中,可以利用SLM生成更精准的商品搜索提示;在视频推荐系统中,可以生成更个性化的推荐理由;在内容创作领域,可以辅助用户生成高质量的文本描述或图像提示。该研究有助于推动多模态AI技术在资源受限环境下的应用。

📄 摘要(原文)

In this work, we investigate how small language models (SLMs) can be scaled to support multimodal search and recommendation use cases while remaining efficient enough for real-time, resource-constrained deployments. We present a framework that combines upside-down reinforcement learning with synthetic data distillation from a large language model (Llama-3) to train a 100M-parameter GPT-2 model for multitask prompt generation. Despite being up to 80 times smaller than state-of-the-art large language models (LLMs), our SLM achieves relevance and diversity scores within 6% of competitive baselines such as Llama-3 8B, Qwen3 8B, and Ministral 8B. These results demonstrate that SLMs can effectively handle multimodal search and recommendation tasks, while dramatically reducing inference latency and memory overhead. Our study highlights the potential of lightweight models as practical engines for scalable multimodal discovery, bridging the gap between cutting-edge research and real-world multimodal applications such as media recommendations and creative content generation.