Quantifying depressive mental states with large language models

作者: Jakub Onysk, Quentin J. M. Huys

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-02-13 (更新: 2025-09-25)

备注: main text - 9 pages, 6 figures;

💡 一句话要点

利用大型语言模型量化抑郁症心理状态,揭示数据需求与概念对齐的界限。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 抑郁症 心理健康 症状量化 稀疏自编码器

📋 核心要点

- 现有方法难以有效量化抑郁症患者的语言表达,从而限制了LLM在心理健康领域的应用。

- 论文提出利用LLM捕捉抑郁症状的语言特征,并结合临床数据进行验证,以评估LLM的量化能力。

- 实验表明,LLM在抑郁症状量化方面具有潜力,但数据质量和概念对齐是关键因素。

📝 摘要(中文)

大型语言模型(LLMs)在心理健康领域可能发挥重要作用,它们能够量化用于交流情绪、感受和想法的口头表达。虽然该领域已取得显著且充满希望的进展,但其根本限制尚不明确。本文聚焦于抑郁症状,概述并评估了LLM在三个关键测试上的表现。首先,评估LLM在一个来自大型人类样本(n=770)的新型真实数据集上的性能。该数据集的新颖之处在于,它包含标准临床验证的抑郁症状量化以及同一个人对每个症状相关想法的具体口头描述。其次,测试LLM中的潜在结构在多大程度上可以捕捉到临床观察到的模式。我们训练有监督的稀疏自编码器(sSAE)来预测综合征中的特定症状和症状模式。第三,如果LLM正确捕捉并量化了相关的心理状态,那么这些状态应该对经过验证的情绪诱导干预引起的情绪状态变化做出反应。总体而言,这项工作为使用LLM量化病理性心理状态提供了基础性见解,强调了基于LLM的量化对数据底层要求的硬性限制;但也表明LLM表现出显著的概念对齐。

🔬 方法详解

问题定义:论文旨在解决如何利用大型语言模型(LLMs)准确量化抑郁症患者的心理状态,特别是通过分析他们的语言表达。现有方法的痛点在于缺乏高质量的、包含症状量化和对应语言描述的数据集,以及对LLM捕捉临床模式能力的有效评估。

核心思路:论文的核心思路是构建一个包含临床量化数据和语言描述的新型数据集,并利用该数据集评估LLM在抑郁症状量化方面的性能。同时,通过训练稀疏自编码器(sSAE)来探索LLM捕捉临床模式的能力,并验证LLM对情绪诱导干预的反应。

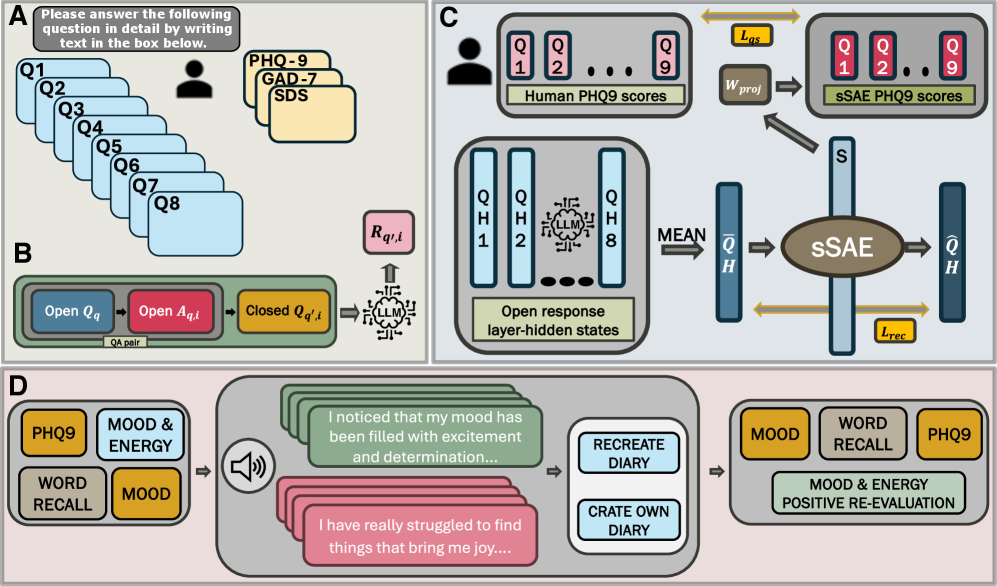

技术框架:整体框架包含三个主要部分:1) 构建包含抑郁症状量化和语言描述的新型数据集;2) 使用该数据集评估LLM的性能,并训练sSAE来预测症状和症状模式;3) 通过情绪诱导实验验证LLM对情绪变化的反应。具体流程为:首先收集包含抑郁症患者症状量化和语言描述的数据,然后使用LLM提取语言特征,并将其与临床量化数据进行比较。接着,训练sSAE来预测特定症状和症状模式,并分析sSAE的权重。最后,通过情绪诱导实验,观察LLM提取的特征是否能反映情绪变化。

关键创新:论文的关键创新在于:1) 构建了一个包含症状量化和对应语言描述的新型数据集,为LLM在心理健康领域的应用提供了高质量的数据基础;2) 利用sSAE探索了LLM捕捉临床模式的能力,并验证了LLM对情绪诱导干预的反应。与现有方法相比,该研究更全面地评估了LLM在抑郁症量化方面的性能,并揭示了数据质量和概念对齐的重要性。

关键设计:在数据集构建方面,论文收集了770名参与者的数据,包括临床验证的抑郁症状量化和对应的语言描述。在sSAE的训练方面,论文使用了稀疏约束,以提高模型的泛化能力。在情绪诱导实验方面,论文使用了经过验证的情绪诱导方法,以确保实验结果的可靠性。具体的参数设置和损失函数等技术细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

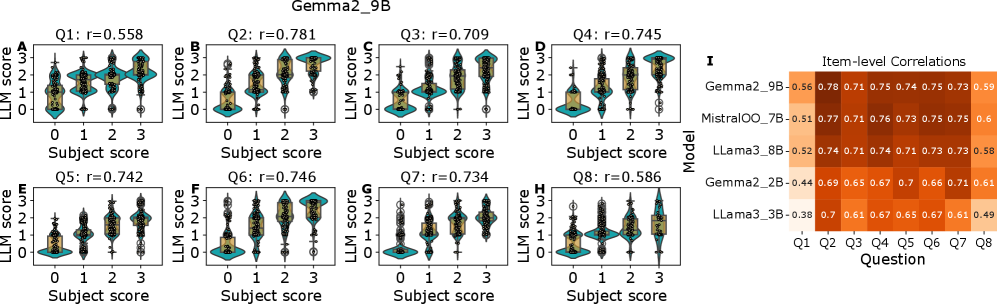

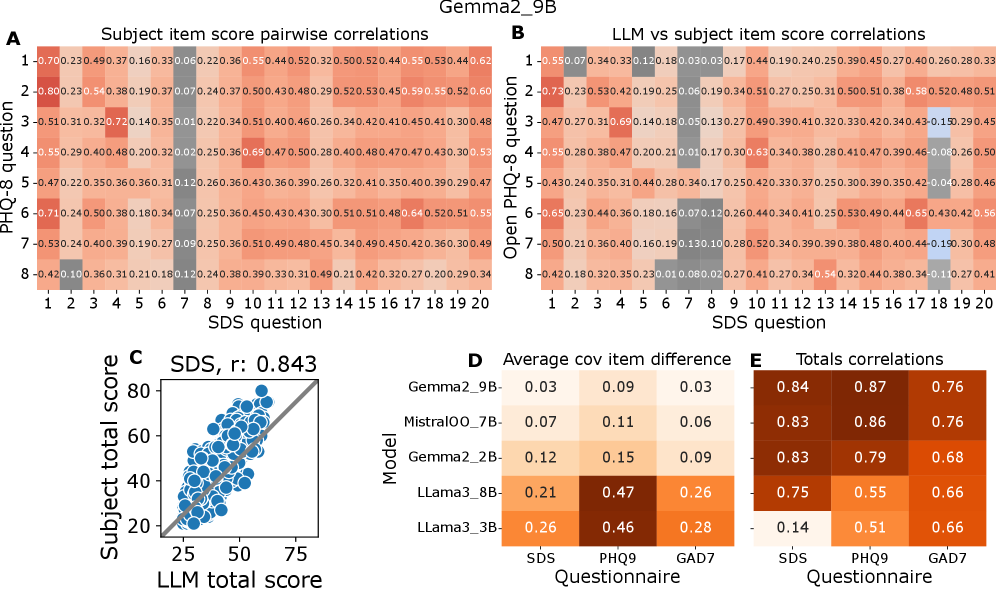

📊 实验亮点

论文构建了一个包含770名参与者的新型数据集,并利用该数据集评估了LLM在抑郁症状量化方面的性能。实验结果表明,LLM在一定程度上能够捕捉抑郁症状的语言特征,但数据质量和概念对齐是关键因素。此外,sSAE的训练结果表明,LLM可以有效地捕捉临床观察到的症状模式。

🎯 应用场景

该研究成果可应用于心理健康筛查、诊断辅助和个性化治疗。通过分析患者的语言表达,可以更客观地评估其心理状态,并为医生提供决策支持。未来,该技术有望应用于在线心理咨询、智能心理健康助手等领域,提高心理健康服务的可及性和效率。

📄 摘要(原文)

Large Language Models (LLMs) may have an important role to play in mental health by facilitating the quantification of verbal expressions used to communicate emotions, feelings and thoughts. While there has been substantial and very promising work in this area, the fundamental limits are uncertain. Here, focusing on depressive symptoms, we outline and evaluate LLM performance on three critical tests. The first test evaluates LLM performance on a novel ground-truth dataset from a large human sample (n=770). This dataset is novel as it contains both standard clinically validated quantifications of depression symptoms and specific verbal descriptions of the thoughts related to each symptom by the same individual. The performance of LLMs on this richly informative data shows an upper bound on the performance in this domain, and allow us to examine the extent to which inference about symptoms generalises. Second, we test to what extent the latent structure in LLMs can capture the clinically observed patterns. We train supervised sparse auto-encoders (sSAE) to predict specific symptoms and symptom patterns within a syndrome. We find that sSAE weights can effectively modify the clinical pattern produced by the model, and thereby capture the latent structure of relevant clinical variation. Third, if LLMs correctly capture and quantify relevant mental states, then these states should respond to changes in emotional states induced by validated emotion induction interventions. We show that this holds in a third experiment with 190 participants. Overall, this work provides foundational insights into the quantification of pathological mental states with LLMs, highlighting hard limits on the requirements of the data underlying LLM-based quantification; but also suggesting LLMs show substantial conceptual alignment.