No Need for Explanations: LLMs can implicitly learn from mistakes in-context

作者: Lisa Alazraki, Maximilian Mozes, Jon Ander Campos, Tan Yi-Chern, Marek Rei, Max Bartolo

分类: cs.CL, cs.AI

发布日期: 2025-02-12 (更新: 2025-09-20)

备注: EMNLP 2025

💡 一句话要点

LLM可从错误中隐式学习:无需显式解释即可提升数学推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 隐式学习 错误学习 数学推理 思维链提示

📋 核心要点

- 现有方法依赖于提供详细解释的错误答案来提升LLM的推理能力,但可能存在过度约束。

- 该研究提出一种反直觉的发现,即LLM在没有显式纠正理由的情况下,能更好地从错误中学习。

- 实验表明,移除纠正理由后,LLM在数学推理任务中表现更优,且优于思维链提示。

📝 摘要(中文)

大型语言模型(LLM)展示错误答案是提高其在推理密集型任务中性能的常用策略。人们普遍认为,为了使错误答案有帮助,必须附带全面的理由,详细说明错误在哪里以及如何纠正它们。然而,本文提出了一个反直觉的发现:观察到,当从上下文中删除这些理由,并让模型自行推断错误答案的缺陷时,LLM在数学推理任务中表现更好。在我们的评估中,这种方法也大大优于思维链提示。这些结果在不同大小和不同推理能力的LLM中是一致的。为了理解为什么LLM在没有明确纠正理由的情况下更有效地从错误中学习,我们进行了彻底的分析,调查了不同提示策略之间上下文长度和答案多样性的变化及其对性能的影响。我们还检查了在提供上下文理由时过度拟合的证据,并研究了LLM在仅以错误答案作为输入的情况下,自主推断高质量纠正理由的能力。我们发现,虽然错误答案比额外的多样化正确答案更有利于LLM学习,但明确的纠正理由过度约束了模型,从而限制了这些好处。

🔬 方法详解

问题定义:现有方法在利用错误答案提升LLM推理能力时,通常需要提供详细的纠正理由。这种方法的痛点在于,显式的纠正理由可能会过度约束模型,限制其自主学习和推理能力,导致性能瓶颈。论文旨在探索是否可以移除这些显式理由,让LLM自行从错误中学习,从而提升其推理能力。

核心思路:论文的核心思路是,LLM可能具备从错误答案中隐式学习的能力,即使没有明确的纠正理由。通过让模型自行推断错误答案的缺陷,可以避免过度约束,并激发其更深层次的推理能力。这种方法类似于人类从错误中学习的过程,即通过分析错误并自主寻找正确的解决方案。

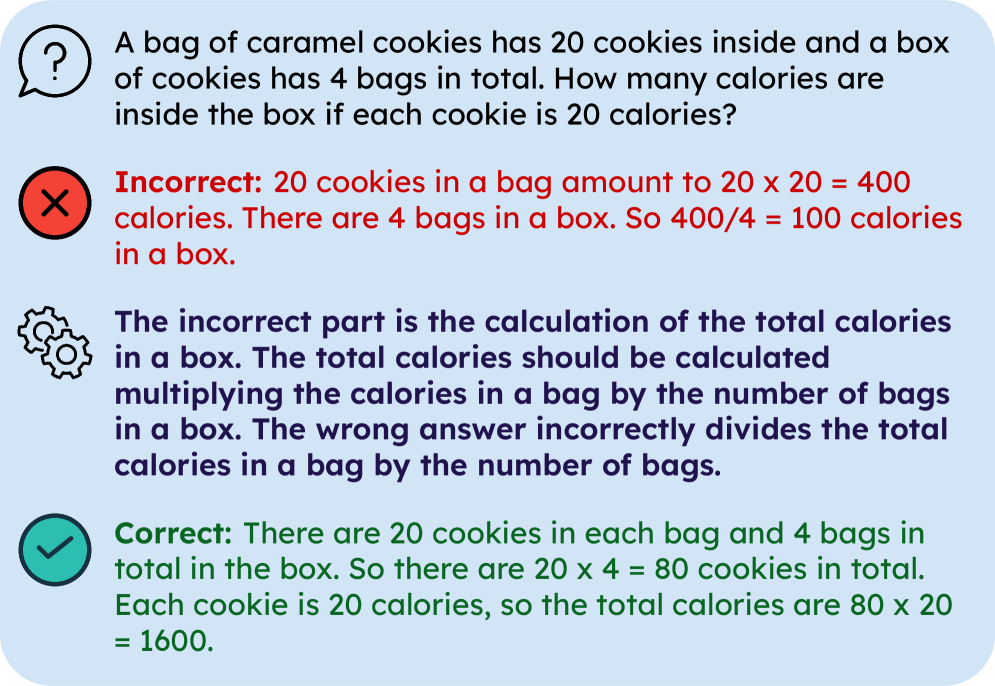

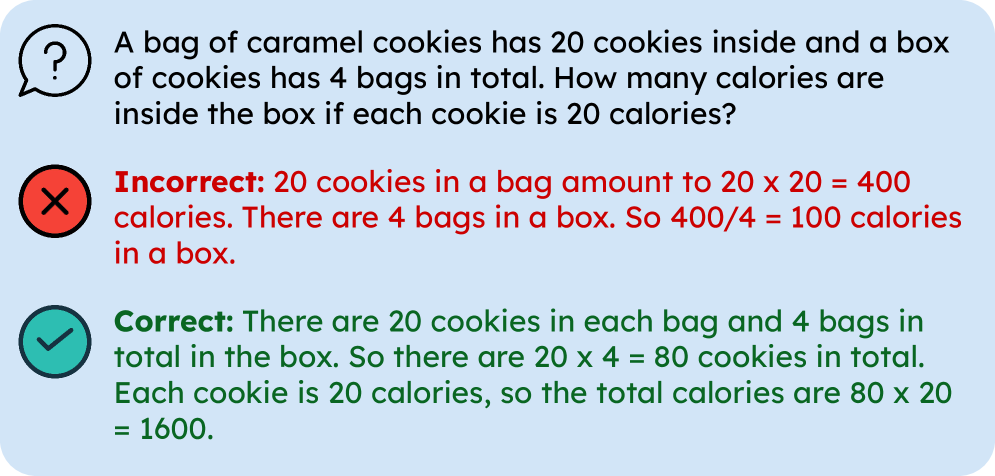

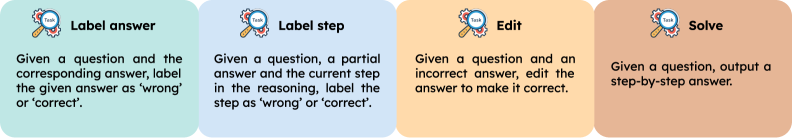

技术框架:该研究主要通过实验对比不同的提示策略来验证核心思路。具体来说,对比了以下几种提示策略:1) 提供错误答案和纠正理由;2) 仅提供错误答案;3) 提供思维链提示;4) 提供多样化的正确答案。然后,在数学推理任务上评估不同提示策略下LLM的性能。此外,还分析了上下文长度、答案多样性等因素对性能的影响,并研究了LLM自主推断纠正理由的能力。

关键创新:该研究最重要的技术创新点在于,发现LLM可以从错误答案中隐式学习,而无需显式的纠正理由。这一发现挑战了现有方法的认知,并为提升LLM推理能力提供了一种新的思路。与现有方法相比,该方法更加简洁高效,避免了过度约束,并能更好地激发LLM的自主学习能力。

关键设计:研究中关键的设计包括:1) 精心设计的数学推理任务,用于评估LLM的推理能力;2) 多种不同的提示策略,用于对比不同学习方式的效果;3) 详细的实验分析,用于理解LLM从错误中学习的机制。此外,还考虑了上下文长度、答案多样性等因素的影响,并研究了LLM自主推断纠正理由的能力。具体的参数设置和网络结构取决于所使用的LLM模型,论文中没有详细说明。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在数学推理任务中,仅提供错误答案的提示策略优于提供错误答案和纠正理由的策略,也优于思维链提示。这一结果在不同大小和不同推理能力的LLM中是一致的。研究还发现,提供显式纠正理由可能会导致模型过度拟合,从而限制其学习能力。总的来说,该研究表明,LLM可以从错误中隐式学习,而无需显式的纠正理由。

🎯 应用场景

该研究成果可应用于各种需要LLM进行推理的任务,例如数学问题求解、代码生成、知识问答等。通过利用错误答案进行隐式学习,可以提升LLM在这些任务中的性能,并降低对人工标注数据的依赖。此外,该研究还可以为LLM的训练和优化提供新的思路,例如设计更有效的学习策略,或开发更强大的推理模型。

📄 摘要(原文)

Showing incorrect answers to Large Language Models (LLMs) is a popular strategy to improve their performance in reasoning-intensive tasks. It is widely assumed that, in order to be helpful, the incorrect answers must be accompanied by comprehensive rationales, explicitly detailing where the mistakes are and how to correct them. However, in this work we present a counterintuitive finding: we observe that LLMs perform better in math reasoning tasks when these rationales are eliminated from the context and models are left to infer on their own what makes an incorrect answer flawed. This approach also substantially outperforms chain-of-thought prompting in our evaluations. These results are consistent across LLMs of different sizes and varying reasoning abilities. To gain an understanding of why LLMs learn from mistakes more effectively without explicit corrective rationales, we perform a thorough analysis, investigating changes in context length and answer diversity between different prompting strategies, and their effect on performance. We also examine evidence of overfitting to the in-context rationales when these are provided, and study the extent to which LLMs are able to autonomously infer high-quality corrective rationales given only incorrect answers as input. We find evidence that, while incorrect answers are more beneficial for LLM learning than additional diverse correct answers, explicit corrective rationales over-constrain the model, thus limiting those benefits.