Measuring Diversity in Synthetic Datasets

作者: Yuchang Zhu, Huizhe Zhang, Bingzhe Wu, Jintang Li, Zibin Zheng, Peilin Zhao, Liang Chen, Yatao Bian

分类: cs.CL, cs.AI

发布日期: 2025-02-12 (更新: 2025-08-14)

备注: Accepted by ICML 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出DCScore,从分类角度评估合成数据集多样性,提升模型鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 合成数据 多样性评估 自然语言处理 文本分类 大型语言模型

📋 核心要点

- 现有方法难以准确衡量合成数据集的多样性,阻碍了模型鲁棒性的提升。

- DCScore将多样性评估转化为样本分类任务,利用样本间的相互关系进行评估。

- 实验表明DCScore与数据集多样性伪真值相关性更强,且计算成本显著降低。

📝 摘要(中文)

大型语言模型(LLMs)被广泛用于生成合成数据集,以用于各种自然语言处理(NLP)任务,例如文本分类和摘要。然而,准确衡量这些合成数据集的多样性——这是保证模型鲁棒性的一个关键方面——仍然是一个重大挑战。在本文中,我们介绍了一种新颖的方法DCScore,用于从分类的角度衡量合成数据集的多样性。具体来说,DCScore将多样性评估表述为一个样本分类任务,利用样本之间的相互关系。我们进一步提供了DCScore满足的多样性相关公理的理论验证,突出了其作为一种有原则的多样性评估方法的作用。在合成数据集上的实验结果表明,DCScore与被评估数据集的多个多样性伪真值具有更强的相关性,突显了其有效性。此外,经验和理论证据都表明,与现有方法相比,DCScore大大降低了计算成本。代码可在https://github.com/bluewhalelab/dcscore获得。

🔬 方法详解

问题定义:论文旨在解决合成数据集多样性评估的问题。现有方法在准确性和计算效率上存在不足,难以有效指导合成数据的生成,从而影响下游模型的性能。具体来说,如何量化合成数据集的多样性,并使其与模型的泛化能力相关联,是一个关键挑战。

核心思路:DCScore的核心思路是将多样性评估问题转化为一个分类问题。通过训练一个分类器来区分不同的样本,并利用分类器的性能来衡量数据集的多样性。如果一个数据集的多样性越高,那么分类器就越难区分其中的样本,从而导致分类性能下降。

技术框架:DCScore的技术框架主要包含以下几个步骤:1) 构建样本关系图:基于样本之间的相似度构建一个图结构,用于捕捉样本之间的相互关系。2) 训练分类器:利用构建的样本关系图,训练一个分类器来区分不同的样本。3) 计算DCScore:基于分类器的性能,计算DCScore作为数据集多样性的度量。DCScore越高,表示数据集的多样性越低。

关键创新:DCScore的关键创新在于将多样性评估问题转化为一个分类问题,并利用样本之间的相互关系进行评估。与现有方法相比,DCScore能够更准确地捕捉数据集的多样性,并且具有更高的计算效率。此外,论文还提供了DCScore满足多样性相关公理的理论验证,使其成为一种有原则的多样性评估方法。

关键设计:在构建样本关系图时,可以使用不同的相似度度量方法,例如余弦相似度或欧氏距离。分类器可以选择不同的模型,例如支持向量机(SVM)或神经网络。DCScore的计算方式可以根据具体的分类器性能进行调整。论文中具体使用了哪种相似度度量、分类器模型和DCScore计算方式未知。

🖼️ 关键图片

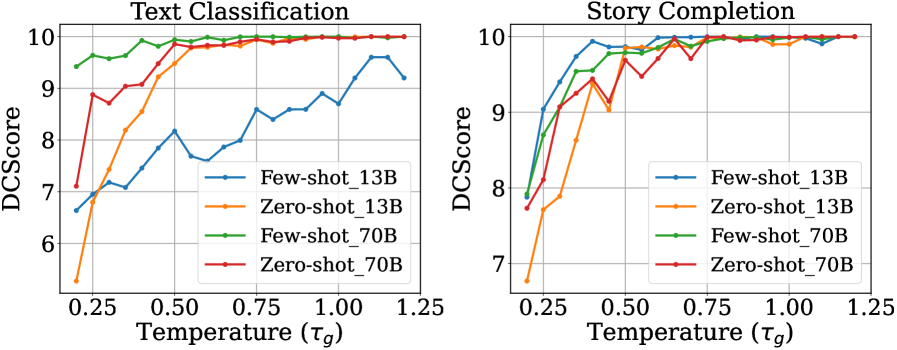

📊 实验亮点

实验结果表明,DCScore与合成数据集的多个多样性伪真值具有更强的相关性,表明其能够更准确地衡量数据集的多样性。此外,与现有方法相比,DCScore在计算成本上显著降低,使其能够应用于更大规模的数据集。具体的性能提升数据未知。

🎯 应用场景

DCScore可应用于各种自然语言处理任务中合成数据集的多样性评估,例如文本分类、摘要生成等。通过优化合成数据集的多样性,可以提高下游模型的鲁棒性和泛化能力。此外,DCScore还可以用于评估不同数据增强方法的效果,从而选择最佳的数据增强策略。

📄 摘要(原文)

Large language models (LLMs) are widely adopted to generate synthetic datasets for various natural language processing (NLP) tasks, such as text classification and summarization. However, accurately measuring the diversity of these synthetic datasets-an aspect crucial for robust model performance-remains a significant challenge. In this paper, we introduce DCScore, a novel method for measuring synthetic dataset diversity from a classification perspective. Specifically, DCScore formulates diversity evaluation as a sample classification task, leveraging mutual relationships among samples. We further provide theoretical verification of the diversity-related axioms satisfied by DCScore, highlighting its role as a principled diversity evaluation method. Experimental results on synthetic datasets reveal that DCScore enjoys a stronger correlation with multiple diversity pseudo-truths of evaluated datasets, underscoring its effectiveness. Moreover, both empirical and theoretical evidence demonstrate that DCScore substantially reduces computational costs compared to existing methods. Code is available at: https://github.com/bluewhalelab/dcscore.