TruthFlow: Truthful LLM Generation via Representation Flow Correction

作者: Hanyu Wang, Bochuan Cao, Yuanpu Cao, Jinghui Chen

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-02-06

💡 一句话要点

提出TruthFlow,通过表征流校正实现大语言模型的事实性生成

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 事实性生成 表征学习 流模型 Flow Matching 幻觉问题 知识问答

📋 核心要点

- 大语言模型难以持续生成真实可靠的回复,现有方法对所有查询使用统一校正向量,效果有限。

- TruthFlow利用Flow Matching学习查询特定的校正向量,将模型表征从幻觉状态引导至真实状态。

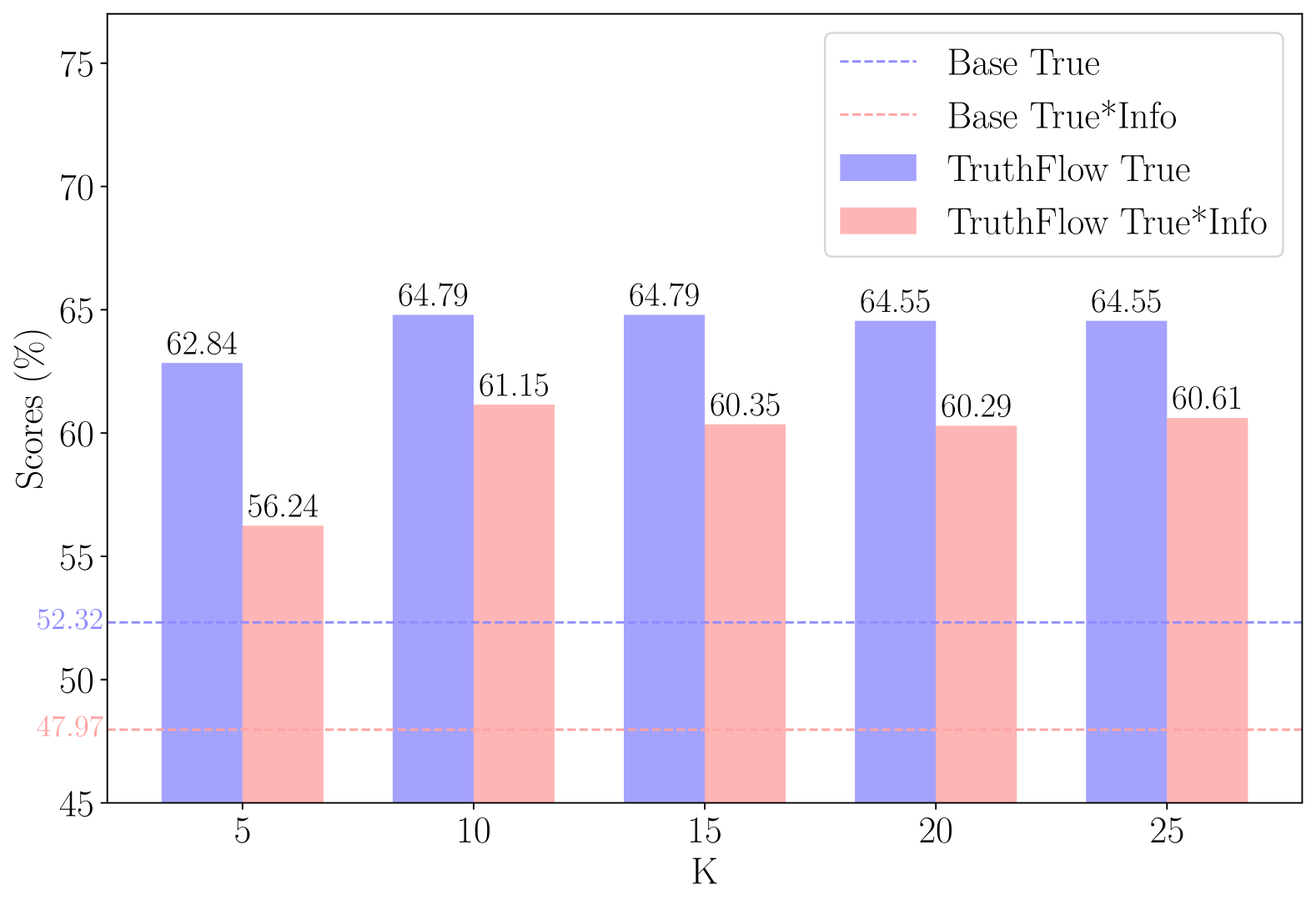

- 实验表明,TruthFlow在TruthfulQA等基准测试中显著提升了LLM的事实性,并具有良好的迁移能力。

📝 摘要(中文)

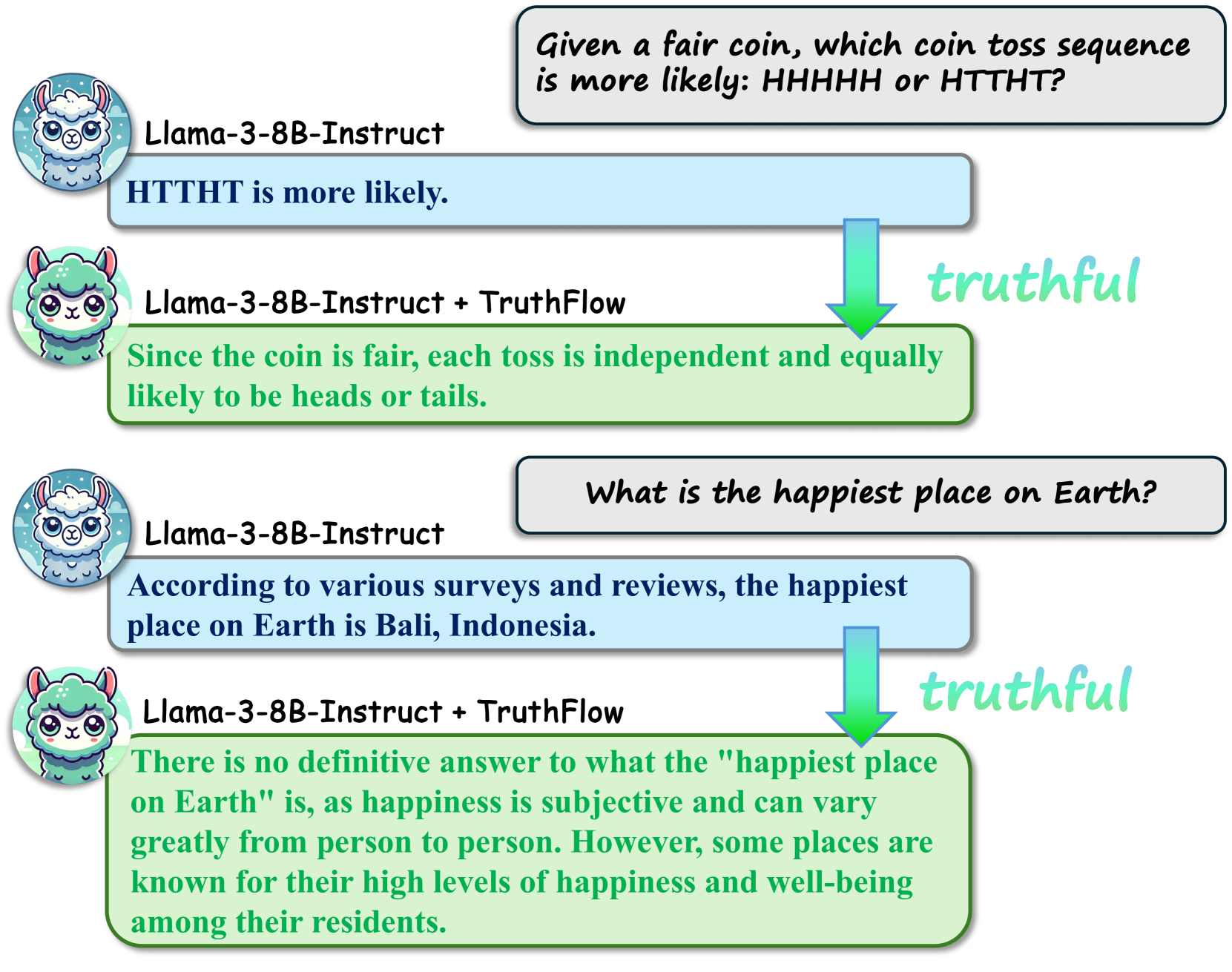

大型语言模型(LLMs)在生成一致的事实性回复方面存在困难。现有的表征干预技术通常对所有输入查询应用通用的表征校正向量,这限制了它们在面对各种查询时的有效性。本研究提出TruthFlow,一种利用Flow Matching技术进行查询特定事实性表征校正的新方法。具体来说,TruthFlow首先使用流模型学习查询特定的校正向量,将表征从幻觉状态过渡到事实状态。然后在推理过程中,训练好的流模型生成这些校正向量,以提高LLM输出的事实性。实验结果表明,TruthFlow显著提高了在TruthfulQA上评估的各种高级LLM在开放式生成任务中的性能。此外,训练好的TruthFlow模型表现出强大的可迁移性,在其他未见过的幻觉基准测试中也能有效执行。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLMs)生成内容不真实的问题,即产生幻觉。现有方法,如直接干预模型表征,通常使用对所有输入都相同的校正向量。这种通用性限制了它们在处理多样化查询时的效果,无法针对特定查询进行优化,导致校正效果不佳。

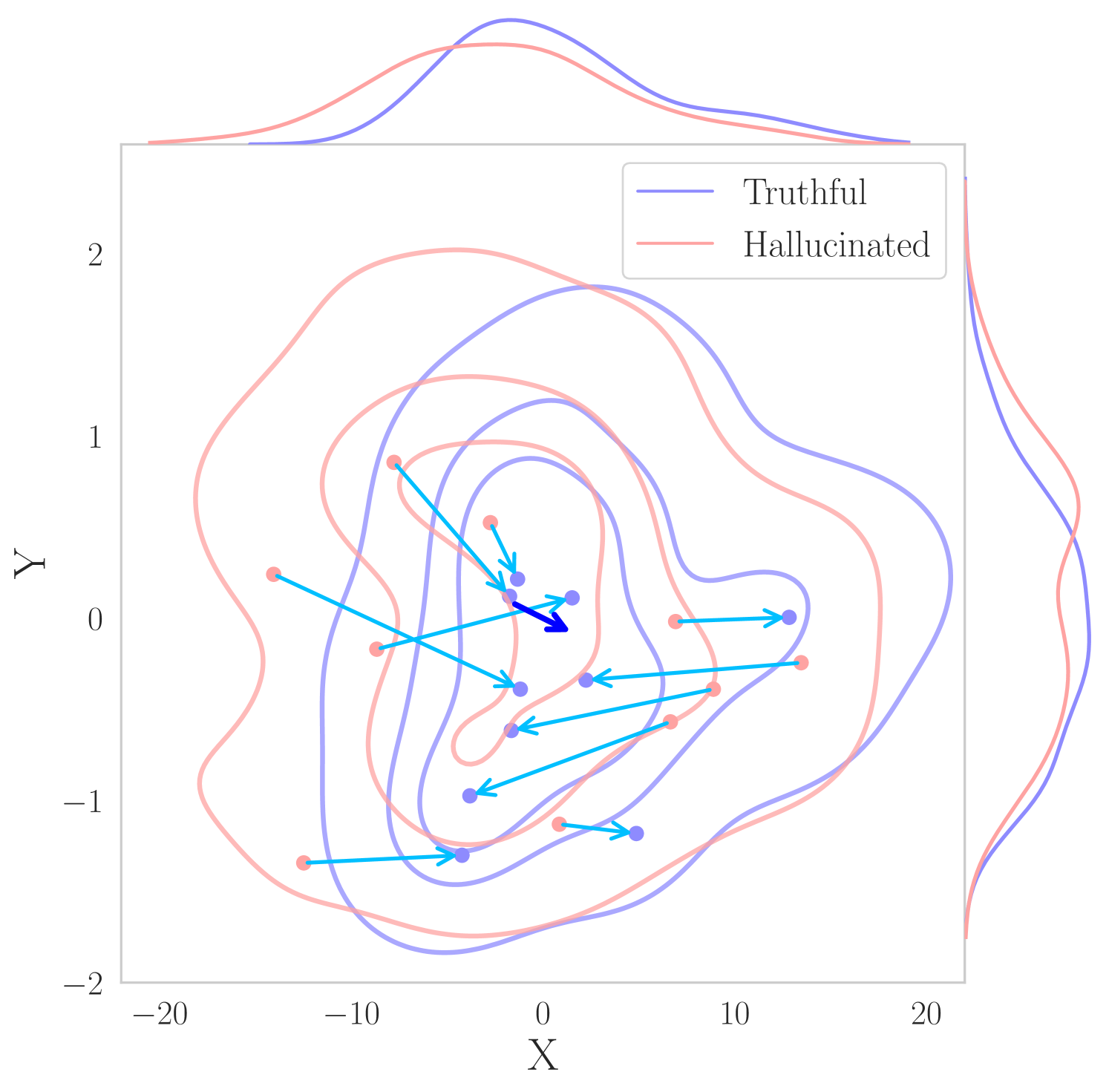

核心思路:TruthFlow的核心思路是学习查询特定的表征校正向量,从而将模型从产生幻觉的状态引导到生成真实信息的状态。通过Flow Matching技术,TruthFlow能够学习一个流模型,该模型可以根据不同的输入查询生成相应的校正向量。这种方法允许模型根据具体情况进行调整,从而提高生成内容的事实性。

技术框架:TruthFlow的整体框架包含两个主要阶段:训练阶段和推理阶段。在训练阶段,首先收集幻觉数据和对应的真实数据,然后使用Flow Matching训练一个流模型,该模型学习从幻觉表征到真实表征的映射。在推理阶段,对于给定的输入查询,首先获取LLM的原始表征,然后使用训练好的流模型生成校正向量,最后将校正向量应用于原始表征,从而生成更真实的输出。

关键创新:TruthFlow的关键创新在于使用Flow Matching技术学习查询特定的表征校正向量。与现有方法使用通用校正向量不同,TruthFlow能够根据不同的输入查询生成不同的校正向量,从而实现更精细的表征校正。这种方法能够更好地适应多样化的查询,提高生成内容的事实性。

关键设计:TruthFlow的关键设计包括:1) 使用Flow Matching作为学习校正向量的框架,Flow Matching能够有效地学习复杂的表征映射关系。2) 设计合适的损失函数,以确保学习到的校正向量能够有效地将幻觉表征转换为真实表征。3) 针对不同的LLM,可能需要调整Flow Matching模型的结构和参数,以获得最佳性能。具体参数设置和网络结构在论文中应该有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TruthFlow在TruthfulQA基准测试中显著提高了各种先进LLM的事实性。此外,训练好的TruthFlow模型展现出强大的迁移能力,在其他未见过的幻觉基准测试中也能有效执行。这些结果表明,TruthFlow是一种有效且通用的方法,可以提高LLM生成内容的事实性。

🎯 应用场景

TruthFlow可应用于各种需要大语言模型生成真实可靠信息的场景,例如问答系统、知识库构建、医疗诊断辅助等。通过提高LLM生成内容的事实性,TruthFlow可以减少错误信息的传播,提高用户对LLM的信任度,并促进LLM在更多领域的应用。未来,该技术有望进一步发展,应用于更复杂的任务和更广泛的语言模型。

📄 摘要(原文)

Large language models (LLMs) are known to struggle with consistently generating truthful responses. While various representation intervention techniques have been proposed, these methods typically apply a universal representation correction vector to all input queries, limiting their effectiveness against diverse queries in practice. In this study, we introduce TruthFlow, a novel method that leverages the Flow Matching technique for query-specific truthful representation correction. Specifically, TruthFlow first uses a flow model to learn query-specific correction vectors that transition representations from hallucinated to truthful states. Then, during inference, the trained flow model generates these correction vectors to enhance the truthfulness of LLM outputs. Experimental results demonstrate that TruthFlow significantly improves performance on open-ended generation tasks across various advanced LLMs evaluated on TruthfulQA. Moreover, the trained TruthFlow model exhibits strong transferability, performing effectively on other unseen hallucination benchmarks.