From Rational Answers to Emotional Resonance: The Role of Controllable Emotion Generation in Language Models

作者: Yurui Dong, Luozhijie Jin, Yao Yang, Bingjie Lu, Jiaxi Yang, Zhi Liu

分类: cs.CL

发布日期: 2025-02-06 (更新: 2025-10-14)

备注: 43 pages, 5 figures

💡 一句话要点

提出基于情感向量控制的情感生成框架,提升语言模型的情感表达能力

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感生成 可控生成 语言模型 情感向量 人机交互

📋 核心要点

- 现有大型语言模型难以在人机交互中一致、可控地表达情感,限制了其应用潜力。

- 论文提出基于情感向量(EVs)的可控情感生成框架,通过注入EVs到LLM隐藏层实现情感调制。

- 实验表明,该方法在多个LLM上实现了情感一致性、主题稳定性和情感强度可控性,优于基线。

📝 摘要(中文)

情感是人类交流的基本组成部分,影响着理解、信任和参与度。大型语言模型(LLM)虽然在推理和知识生成方面表现出色,但在以一致、可控和上下文适当的方式表达情感方面仍存在困难。这种限制阻碍了它们在真实人机交互中的潜力。本文提出了一种基于情感向量(EVs)的可控情感生成框架。情感向量是从中性和情感条件响应之间的内部激活变化中提取的潜在表示。通过在推理过程中将这些向量注入到预训练LLM的隐藏状态中,我们的方法能够对情感基调进行细粒度、连续的调制,而无需任何额外的训练或架构修改。我们进一步提供了理论分析,证明EV引导增强了情感表达能力,同时保持了语义保真度和语言流畅性。实验结果表明,该方法在多个LLM家族中实现了情感一致性、主题稳定性和情感强度可控性,并优于现有的基于提示和微调的基线方法。情感向量(EV)引导为弥合大型语言模型中的理性推理和情感理解提供了一种高效且可解释的方法,为构建能够进行更自然人机交互的情感共鸣AI系统提供了一个有希望的方向。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在生成文本时,缺乏对情感的有效控制,难以产生具有特定情感色彩的回复。现有的prompt工程或微调方法,要么缺乏灵活性,要么需要大量训练数据,难以适应各种情感需求。因此,如何让LLM在不进行大量训练的情况下,生成具有可控情感的文本是一个亟待解决的问题。

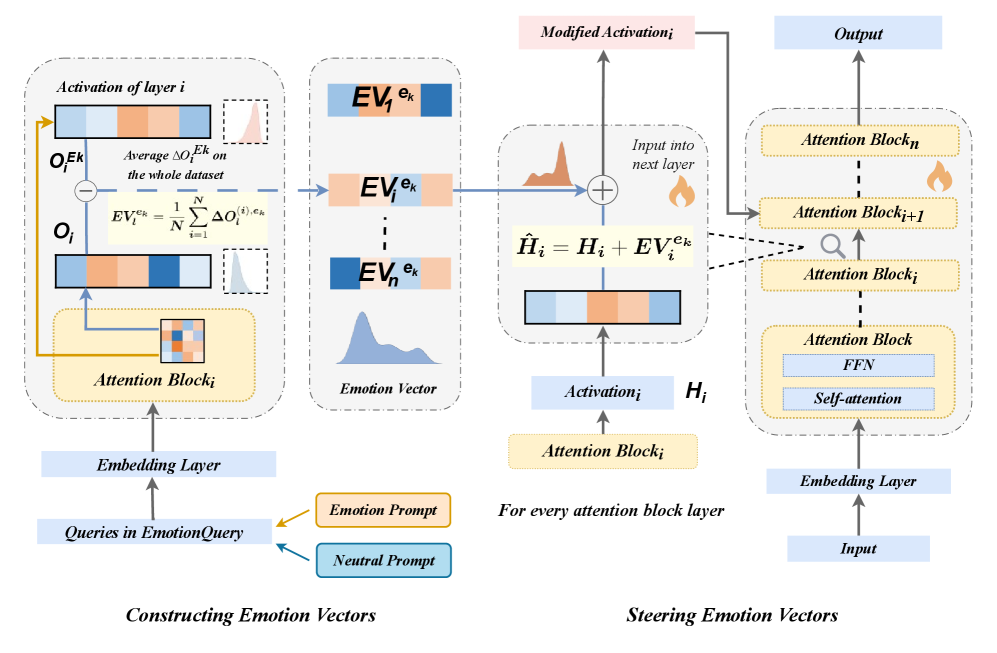

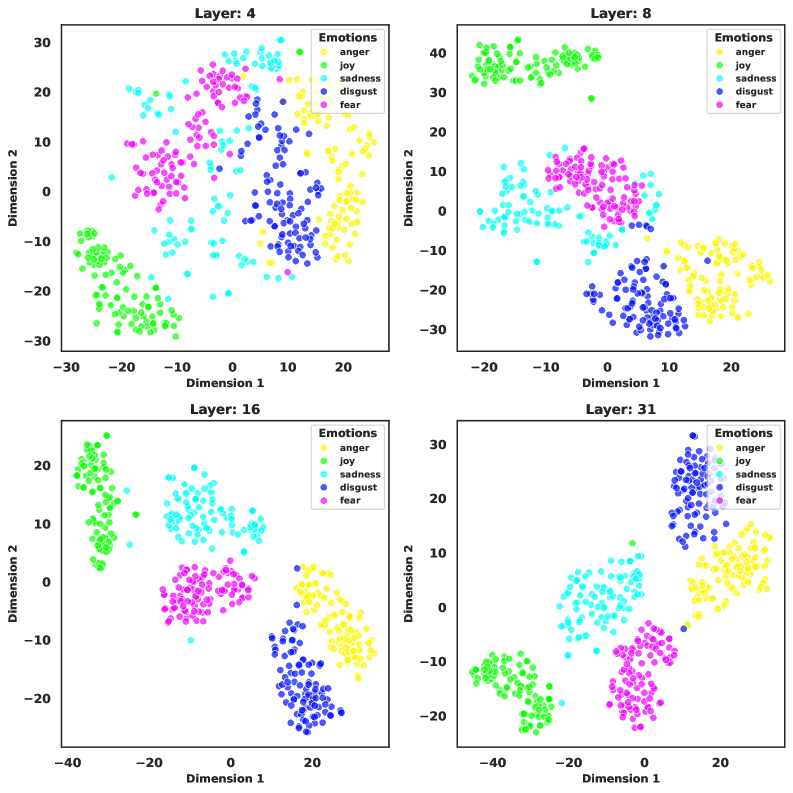

核心思路:论文的核心思路是利用LLM内部的激活变化来表示情感。具体来说,通过对比LLM在生成中性文本和情感文本时的内部激活状态,提取出“情感向量”(Emotion Vectors, EVs)。这些EVs代表了特定情感在LLM内部的表示。通过在推理阶段将这些EVs注入到LLM的隐藏状态中,可以引导LLM生成具有相应情感色彩的文本。这种方法无需额外的训练,具有很高的灵活性和可控性。

技术框架:该框架主要包含两个阶段:情感向量提取阶段和情感引导生成阶段。在情感向量提取阶段,首先使用LLM生成中性文本和情感文本,然后计算它们在LLM内部隐藏状态的差异,得到情感向量。在情感引导生成阶段,将提取的情感向量注入到LLM的隐藏状态中,从而引导LLM生成具有特定情感的文本。整个过程无需对LLM进行任何修改或训练。

关键创新:该方法最重要的创新点在于提出了“情感向量”的概念,并利用它来实现对LLM情感生成的可控性。与传统的prompt工程或微调方法相比,该方法无需额外的训练数据,具有更高的灵活性和可控性。此外,该方法还具有很好的可解释性,因为情感向量可以直接反映特定情感在LLM内部的表示。

关键设计:情感向量的计算方式是中性文本和情感文本在LLM隐藏状态的差值。情感向量注入的位置是LLM的隐藏状态,具体注入哪一层可以根据实验结果进行调整。情感向量的注入强度可以通过一个系数进行控制,从而实现对情感强度的调节。论文中没有明确提及损失函数或网络结构,因为该方法主要是在推理阶段进行的,无需训练。

🖼️ 关键图片

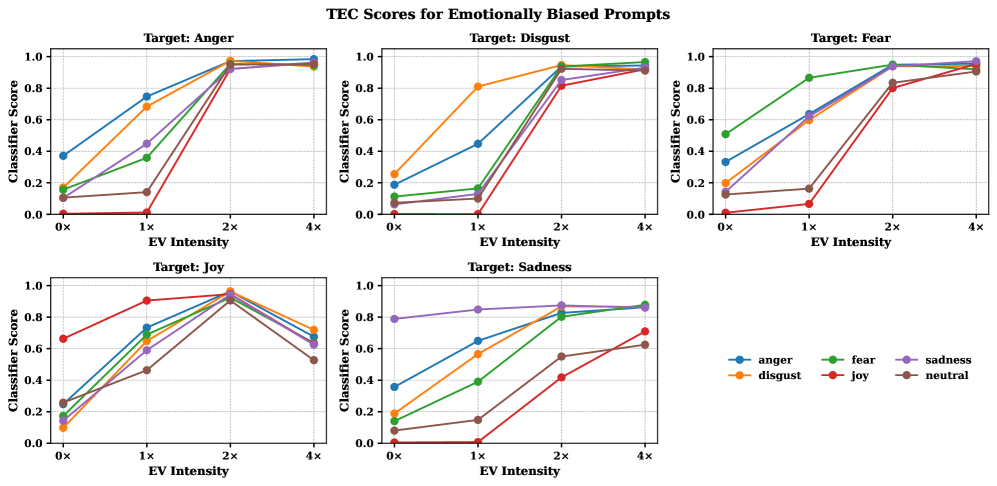

📊 实验亮点

实验结果表明,该方法在多个LLM家族中实现了情感一致性、主题稳定性和情感强度可控性。与基于提示和微调的基线方法相比,该方法在情感表达的灵活性和泛化性方面表现出优越性。具体性能数据未知,但结论表明该方法在多个指标上优于现有方法。

🎯 应用场景

该研究成果可应用于多个领域,例如情感客服、心理健康咨询、教育辅导等。通过控制AI的情感表达,可以提升用户体验,增强人机交互的自然性和亲和力。未来,该技术有望应用于更广泛的场景,例如情感游戏、虚拟社交等,构建更具情感共鸣的AI系统。

📄 摘要(原文)

Purpose: Emotion is a fundamental component of human communication, shaping understanding, trust, and engagement across domains such as education, healthcare, and mental health. While large language models (LLMs) exhibit strong reasoning and knowledge generation capabilities, they still struggle to express emotions in a consistent, controllable, and contextually appropriate manner. This limitation restricts their potential for authentic human-AI interaction. Methods: We propose a controllable emotion generation framework based on Emotion Vectors (EVs) - latent representations derived from internal activation shifts between neutral and emotion-conditioned responses. By injecting these vectors into the hidden states of pretrained LLMs during inference, our method enables fine-grained, continuous modulation of emotional tone without any additional training or architectural modification. We further provide theoretical analysis proving that EV steering enhances emotional expressivity while maintaining semantic fidelity and linguistic fluency. Results: Extensive experiments across multiple LLM families show that the proposed approach achieves consistent emotional alignment, stable topic adherence, and controllable affect intensity. Compared with existing prompt-based and fine-tuning-based baselines, our method demonstrates superior flexibility and generalizability. Conclusion: Emotion Vector (EV) steering provides an efficient and interpretable means of bridging rational reasoning and affective understanding in large language models, offering a promising direction for building emotionally resonant AI systems capable of more natural human-machine interaction.