Experiments with Large Language Models on Retrieval-Augmented Generation for Closed-Source Simulation Software

作者: Andreas Baumann, Peter Eberhard

分类: cs.CL, cs.AI

发布日期: 2025-02-06 (更新: 2025-12-05)

备注: 16 pages, 6 tables, 2 figures

💡 一句话要点

针对闭源仿真软件,探索基于检索增强生成的大语言模型应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 大型语言模型 闭源软件 仿真软件 信息检索 本地LLM 知识库

📋 核心要点

- 闭源软件领域中,大语言模型面临知识盲区和幻觉问题,限制了其应用。

- 利用检索增强生成(RAG)框架,结合LLM的预训练知识和外部知识,提升问答和代码生成能力。

- 实验表明,RAG系统在闭源仿真软件中表现出潜力,但信息定制化是提升性能的关键。

📝 摘要(中文)

大型语言模型(LLM)已成为开发和编程中不可或缺的工具。然而,它们存在幻觉问题,尤其是在处理未知知识时。当LLM用于支持闭源软件应用时,情况尤其如此。检索增强生成(RAG)提供了一种方法,将预训练知识与额外知识结合起来,以响应用户提示。可能的任务范围包括智能自动补全、问题回答的文本提取、模型总结、组件解释、组合推理,以及仿真组件和完整输入模型的创建。本文针对闭源仿真框架,即无网格仿真软件Pasimodo,测试了现有的RAG系统。由于数据保护和知识产权对于闭源软件解决的问题尤为重要,因此测试侧重于使用本地LLM执行。为了使较小的机构能够使用这些系统,将首先测试较小的语言模型。结果显示出令人印象深刻的结果,但经常由于信息不足而失败。测试了改进响应质量的不同方法。特别是,根据提示定制提供给LLM的信息被证明是一个显著的改进。这证明了巨大的潜力,以及改进闭源仿真模型信息检索所需的进一步工作。

🔬 方法详解

问题定义:论文旨在解决闭源仿真软件领域中,大型语言模型(LLM)由于缺乏特定领域知识而产生的幻觉问题。现有方法难以有效利用LLM进行智能自动补全、问题回答、模型总结等任务,阻碍了LLM在闭源软件中的应用。

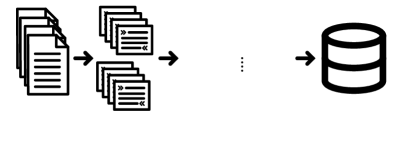

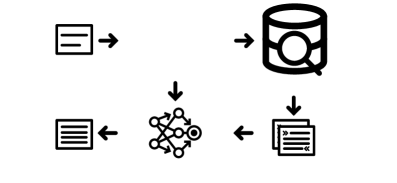

核心思路:论文采用检索增强生成(RAG)框架,核心思想是在LLM生成响应之前,先从外部知识库中检索相关信息,然后将检索到的信息与用户提示一起输入LLM,从而增强LLM的知识,减少幻觉,提高响应质量。这样,LLM不仅依赖于自身的预训练知识,还能利用外部知识库中的信息。

技术框架:整体流程包括以下几个主要阶段:1) 用户输入提示;2) 检索器根据提示从外部知识库(例如软件文档、代码示例等)中检索相关信息;3) 将检索到的信息与用户提示拼接成新的输入;4) 将新的输入输入到LLM中;5) LLM生成响应。该框架的关键在于检索器的设计和知识库的构建。

关键创新:论文的关键创新在于针对闭源仿真软件的特点,探索了不同的信息检索策略,并发现根据用户提示定制提供给LLM的信息能够显著提高响应质量。这表明,针对特定领域,优化RAG框架中的信息检索模块至关重要。与传统RAG方法相比,该研究更注重领域知识的精准匹配。

关键设计:论文测试了不同的本地LLM,并比较了不同的检索策略。关键设计包括:1) 如何构建和维护闭源软件的知识库;2) 如何设计高效的检索器,能够根据用户提示准确地检索到相关信息;3) 如何将检索到的信息有效地融入到LLM的输入中,以最大程度地提高响应质量。论文强调了信息定制化对于提升RAG性能的重要性,但具体的信息定制方法细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RAG系统在闭源仿真软件中表现出潜力。特别地,根据用户提示定制提供给LLM的信息被证明是一个显著的改进,表明信息检索策略对RAG性能至关重要。虽然具体性能数据未知,但该研究强调了针对特定领域优化RAG框架的重要性,为后续研究提供了方向。

🎯 应用场景

该研究成果可应用于各种闭源软件的智能助手开发,例如CAD/CAE软件、工业控制软件等。通过RAG技术,可以提升LLM在特定领域内的知识水平,使其能够更好地理解用户意图,提供更准确、更专业的服务,例如智能代码补全、故障诊断、操作指导等,从而提高软件的使用效率和用户体验。

📄 摘要(原文)

Large Language Models (LLMs) are tools that have become indispensable in development and programming. However, they suffer from hallucinations, especially when dealing with unknown knowledge. This is particularly the case when LLMs are to be used to support closed-source software applications. Retrieval-Augmented Generation (RAG) offers an approach to use additional knowledge alongside the pre-trained knowledge of the LLM to respond to user prompts. Possible tasks range from a smart-autocomplete, text extraction for question answering, model summarization, component explaining, compositional reasoning, to creation of simulation components and complete input models. This work tests existing RAG systems for closed-source simulation frameworks, in our case the mesh-free simulation software Pasimodo. Since data protection and intellectual property rights are particularly important for problems solved with closed-source software, the tests focus on execution using local LLMs. In order to enable smaller institutions to use the systems, smaller language models will be tested first. The systems show impressive results, but often fail due to insufficient information. Different approaches for improving response quality are tested. In particular, tailoring the information provided to the LLMs dependent to the prompts proves to be a significant improvement. This demonstrates the great potential and the further work needed to improve information retrieval for closed-source simulation models.