LLaVAC: Fine-tuning LLaVA as a Multimodal Sentiment Classifier

作者: T. Chay-intr, Y. Chen, K. Viriyayudhakorn, T. Theeramunkong

分类: cs.CL

发布日期: 2025-02-05

🔗 代码/项目: GITHUB

💡 一句话要点

LLaVAC:通过微调LLaVA实现多模态情感分类

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感分析 大型语言模型 视觉语言模型 LLaVA 微调 提示学习 MVSA-Single数据集

📋 核心要点

- 现有多模态情感分析方法在融合图像和文本信息时存在不足,难以充分利用预训练模型的强大能力。

- LLaVAC通过设计结构化提示,将单模态和多模态情感标签融入LLaVA的微调过程,提升情感分类效果。

- 在MVSA-Single数据集上的实验表明,LLaVAC在多模态情感分析任务中优于现有方法,证明了其有效性。

📝 摘要(中文)

本文提出了一种名为LLaVAC的方法,用于构建多模态情感分析的分类器。该方法利用大型语言和视觉助手(LLaVA)的微调能力,来预测图像和文本模态的情感标签。我们的方法包括设计一个结构化的提示,该提示结合了单模态和多模态标签,以微调LLaVA,使其能够有效地执行情感分类。在MVSA-Single数据集上的实验表明,LLaVAC在三种数据处理程序中均优于现有的多模态情感分析方法。LLaVAC的实现已在https://github.com/tchayintr/llavac上公开。

🔬 方法详解

问题定义:本文旨在解决多模态情感分析问题,即如何有效地结合图像和文本信息来准确预测情感。现有方法通常采用复杂的特征工程或浅层模型,难以充分利用预训练模型所蕴含的知识,导致性能受限。

核心思路:论文的核心思路是利用大型语言和视觉助手(LLaVA)的强大能力,通过微调使其适应多模态情感分类任务。LLaVA作为一种预训练的多模态模型,已经具备了理解图像和文本信息的能力。通过针对情感分类任务进行微调,可以使其更好地捕捉情感相关的特征。

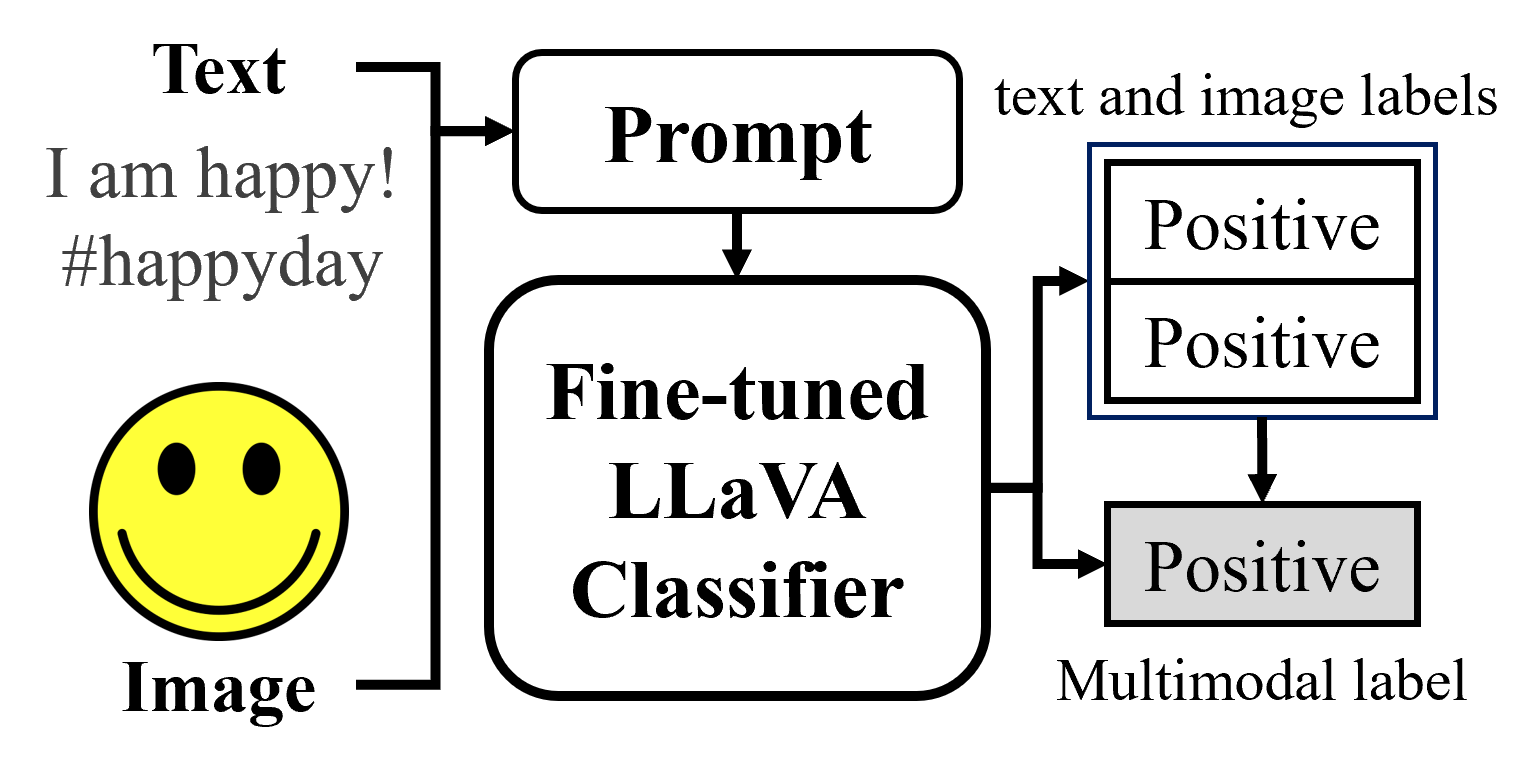

技术框架:LLaVAC的技术框架主要包括以下几个步骤:1) 数据准备:构建包含图像、文本和情感标签的多模态数据集。2) 提示设计:设计结构化的提示,将单模态(图像或文本)和多模态(图像+文本)的情感标签融入提示中。3) 模型微调:使用设计的提示对LLaVA进行微调,使其学习如何根据图像和文本信息预测情感标签。4) 模型评估:在测试集上评估微调后的LLaVA的性能。

关键创新:LLaVAC的关键创新在于利用结构化的提示来引导LLaVA进行多模态情感分类。通过将情感标签融入提示中,可以有效地利用LLaVA的预训练知识,并使其更好地适应情感分类任务。此外,LLaVAC还探索了不同的数据处理程序,以进一步提升性能。

关键设计:论文中关键的设计包括:1) 提示的结构:提示的设计需要考虑到如何有效地将图像、文本和情感标签结合起来。2) 微调的参数设置:微调LLaVA时需要选择合适的学习率、batch size等参数。3) 数据处理程序:论文探索了不同的数据处理程序,例如数据增强和数据平衡,以提升模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLaVAC在MVSA-Single数据集上优于现有的多模态情感分析方法。具体而言,LLaVAC在三种不同的数据处理程序下均取得了最佳性能,证明了其鲁棒性和有效性。论文公开了LLaVAC的实现代码,方便其他研究者进行复现和改进。

🎯 应用场景

LLaVAC可应用于社交媒体情感分析、舆情监控、智能客服等领域。通过分析用户发布的图像和文本信息,可以了解用户的情感倾向,从而为企业提供决策支持,改善用户体验,并及时发现潜在的危机事件。未来,该方法还可以扩展到其他多模态情感相关的任务中。

📄 摘要(原文)

We present LLaVAC, a method for constructing a classifier for multimodal sentiment analysis. This method leverages fine-tuning of the Large Language and Vision Assistant (LLaVA) to predict sentiment labels across both image and text modalities. Our approach involves designing a structured prompt that incorporates both unimodal and multimodal labels to fine-tune LLaVA, enabling it to perform sentiment classification effectively. Experiments on the MVSA-Single dataset demonstrate that LLaVAC outperforms existing methods in multimodal sentiment analysis across three data processing procedures. The implementation of LLaVAC is publicly available at https://github.com/tchayintr/llavac.