Automating Mathematical Proof Generation Using Large Language Model Agents and Knowledge Graphs

作者: Vincent Li, Tim Knappe, Yule Fu, Kevin Han, Kevin Zhu

分类: cs.CL

发布日期: 2025-02-04 (更新: 2025-07-26)

备注: Accepted to ICML AI4Math Workshop 2025, NAACL SRW 2025

💡 一句话要点

KG-Prover:利用知识图谱增强大语言模型,实现自动化数学证明生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动化定理证明 知识图谱 大语言模型 数学推理 自然语言处理

📋 核心要点

- 现有定理证明方法难以有效识别关键数学概念及其相互关系,并且难以在自然语言中正确形式化证明。

- KG-Prover利用从数学文本挖掘的知识图谱来增强LLM,从而构建和形式化数学证明,无需额外微调。

- 实验表明,KG-Prover显著提升了LLM在多个数学数据集上的证明能力,最高提升达21%。

📝 摘要(中文)

本文提出了一种名为KG-Prover的新框架,该框架利用从权威数学文本中挖掘的知识图谱来增强通用大语言模型(LLM),从而构建和形式化数学证明。论文研究了使用KG-Prover进行基于图的测试时计算扩展的效果,结果表明,与多个数据集上的基线相比,性能得到了显著提高。通过与KG-Prover结合,通用LLM在miniF2F-test数据集上的性能提升高达21%,在ProofNet、miniF2F-test和MUSTARD数据集上,无需额外扩展,性能也稳定提升了2-11%。此外,使用o4-mini的KG-Prover在miniF2F-test上实现了超过50%的性能。这项工作为利用知识图谱增强自然语言证明推理提供了一种有前景的方法,且无需额外的微调。

🔬 方法详解

问题定义:现有的自动化定理证明方法在处理复杂数学问题时,面临着关键数学概念识别困难、概念间关系理解不足以及自然语言证明形式化不准确等挑战。这些痛点限制了通用大语言模型在数学推理任务中的应用。

核心思路:论文的核心思路是利用从权威数学文本中提取的知识图谱来增强大语言模型。知识图谱能够提供丰富的数学概念和关系信息,帮助模型更好地理解问题,并生成更准确、更规范的数学证明。通过将知识图谱与大语言模型结合,可以弥补模型在数学知识方面的不足,提高其推理能力。

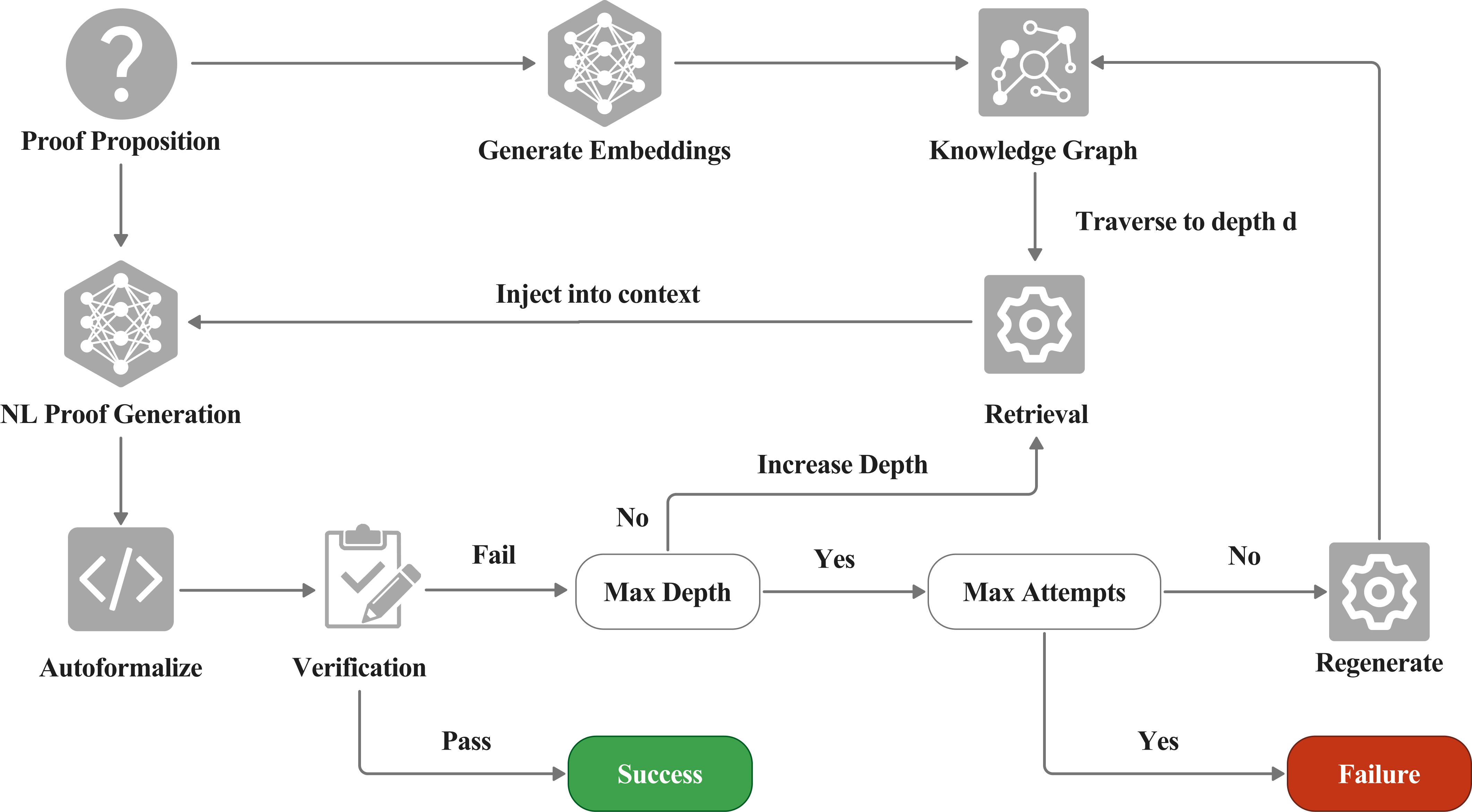

技术框架:KG-Prover框架主要包含以下几个阶段:1) 知识图谱构建:从数学文本中提取数学概念和关系,构建知识图谱。2) 问题理解:利用大语言模型理解给定的数学问题。3) 知识图谱查询:根据问题,在知识图谱中查询相关的数学概念和关系。4) 证明生成:结合问题和知识图谱信息,利用大语言模型生成数学证明。5) 证明形式化:将生成的证明形式化,使其符合数学规范。

关键创新:KG-Prover的关键创新在于将知识图谱引入到大语言模型的数学证明过程中。与传统的基于规则或符号推理的方法不同,KG-Prover利用知识图谱提供背景知识,并利用大语言模型进行自然语言推理,从而实现了更灵活、更高效的自动化定理证明。此外,该方法无需对大语言模型进行额外的微调,降低了使用成本。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但可以推断,知识图谱的构建质量、大语言模型的选择以及知识图谱查询策略等因素都会对KG-Prover的性能产生重要影响。未来的研究可以进一步探索这些关键设计,以提高KG-Prover的性能。

🖼️ 关键图片

📊 实验亮点

KG-Prover在多个数据集上取得了显著的性能提升。在miniF2F-test数据集上,与通用LLM结合后,性能提升高达21%。在ProofNet、miniF2F-test和MUSTARD数据集上,无需额外扩展,性能也稳定提升了2-11%。此外,使用o4-mini的KG-Prover在miniF2F-test上实现了超过50%的性能。

🎯 应用场景

KG-Prover具有广泛的应用前景,可用于自动化数学定理证明、数学教育、科学研究等领域。它可以帮助研究人员验证数学猜想,辅助学生学习数学知识,并加速科学发现的过程。未来,KG-Prover有望成为数学研究和教育的重要工具。

📄 摘要(原文)

Large language models have demonstrated remarkable capabilities in natural language processing tasks requiring multi-step logical reasoning capabilities, such as automated theorem proving. However, challenges persist within theorem proving, such as the identification of key mathematical concepts, understanding their interrelationships, and formalizing proofs correctly within natural language. We present KG-prover, a novel framework that leverages knowledge graphs mined from reputable mathematical texts to augment general-purpose LLMs to construct and formalize mathematical proofs. We also study the effects of scaling graph-based, test-time compute using KG-Prover, demonstrating significant performance improvements over baselines across multiple datasets. General-purpose LLMs improve up to 21\% on miniF2F-test when combined with KG-Prover, with consistent improvements ranging from 2-11\% on the ProofNet, miniF2F-test, and MUSTARD datasets without additional scaling. Furthermore, KG-Prover with o4-mini achieves over 50% miniF2F-test. This work provides a promising approach for augmenting natural language proof reasoning with knowledge graphs without the need for additional finetuning.