LLM-ProS: Analyzing Large Language Models' Performance in Competitive Problem Solving

作者: Md Sifat Hossain, Anika Tabassum, Md. Fahim Arefin, Tarannum Shaila Zaman

分类: cs.CL, cs.AI

发布日期: 2025-02-04

备注: To be published in LLM4Code 2025 workshop proceedings

💡 一句话要点

LLM-ProS:评估大语言模型在竞争性问题求解中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 算法竞赛 ICPC 问题求解 性能评估

📋 核心要点

- 现有大语言模型在复杂问题求解,如算法编码和竞赛编程中面临泛化能力和适应性挑战。

- LLM-ProS通过ICPC世界总决赛问题,从推理、准确性和效率等多维度评估LLM的性能。

- 实验结果揭示了不同LLM在算法问题解决能力上的显著差异,并分析了训练方法等因素的影响。

📝 摘要(中文)

本文提出了一种新的评估技术LLM-ProS,用于评估最先进的大语言模型在国际大学生程序设计竞赛(ICPC)问题上的表现。使用2011年至2024年166道世界总决赛问题的精选数据集,我们对模型的推理能力、准确性和效率进行了基准测试。我们评估了五个模型——GPT-4o、Mistral Large、Llama-3.1-405B以及包含o1-mini和o1-preview的o1系列,涵盖了正确性、资源利用率和响应校准等关键指标。结果揭示了模型在泛化、适应和解决新问题能力方面的显著差异。我们还研究了训练方法、数据集污染和思维链推理对模型性能的影响。研究结果为优化用于算法任务的大语言模型提供了新的见解,突出了当前模型的优势和局限性。

🔬 方法详解

问题定义:论文旨在评估和分析大型语言模型(LLMs)在解决复杂算法问题,特别是ICPC竞赛问题时的性能。现有方法缺乏一个专门针对算法竞赛问题的评估基准,难以充分了解LLMs在推理、泛化和资源利用方面的能力。此外,数据集污染和训练方法对LLMs性能的影响也需要深入研究。

核心思路:论文的核心思路是构建一个专门针对ICPC问题的评估框架LLM-ProS,并利用该框架对多个主流LLMs进行基准测试。通过分析模型在解决实际竞赛问题时的表现,揭示其在算法问题求解方面的优势和局限性。同时,研究不同训练方法和数据集特性对模型性能的影响,为优化LLMs在算法任务中的应用提供指导。

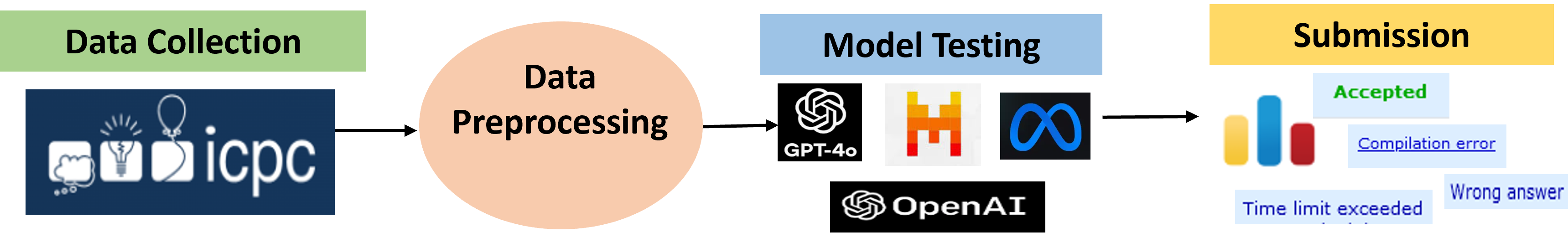

技术框架:LLM-ProS评估框架主要包括以下几个阶段:1) 数据集构建:收集并整理ICPC世界总决赛问题,构建包含166道题目的评估数据集。2) 模型选择:选择具有代表性的LLMs,如GPT-4o、Mistral Large、Llama-3.1-405B和o1系列。3) 性能评估:利用LLMs解决数据集中的问题,并根据正确性、资源利用率和响应校准等指标评估其性能。4) 结果分析:分析不同模型在不同问题上的表现,并研究训练方法、数据集污染和思维链推理对模型性能的影响。

关键创新:论文的主要创新在于提出了LLM-ProS评估框架,该框架专门针对算法竞赛问题,能够更全面、深入地评估LLMs在算法问题求解方面的能力。此外,论文还对多个主流LLMs进行了基准测试,并分析了训练方法和数据集特性对模型性能的影响,为优化LLMs在算法任务中的应用提供了新的见解。

关键设计:论文的关键设计包括:1) 数据集的选择:选择ICPC世界总决赛问题,保证了问题的难度和多样性。2) 评估指标的设计:采用正确性、资源利用率和响应校准等多个指标,全面评估模型的性能。3) 对比实验的设计:对比不同LLMs在相同问题上的表现,并分析不同训练方法和数据集特性对模型性能的影响。具体的参数设置、损失函数、网络结构等技术细节取决于被评估的LLM本身,论文主要关注的是评估框架和结果分析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,不同LLM在ICPC问题上的表现存在显著差异。例如,GPT-4o在某些问题上表现出色,但在另一些问题上则不如其他模型。研究还发现,数据集污染和训练方法对模型性能有重要影响。思维链推理在一定程度上可以提高模型的性能,但并非所有问题都适用。具体性能数据需要在论文中查找。

🎯 应用场景

该研究成果可应用于自动化算法设计、智能编程辅助、教育辅导等领域。通过深入了解LLM在算法问题求解方面的能力,可以开发更智能的编程工具,提高软件开发效率,并为算法学习者提供个性化的指导。此外,该研究还可以促进LLM在其他复杂问题求解领域的应用。

📄 摘要(原文)

The rapid advancement of large language models has opened new avenues for automating complex problem-solving tasks such as algorithmic coding and competitive programming. This paper introduces a novel evaluation technique, LLM-ProS, to assess the performance of state-of-the-art LLMs on International Collegiate Programming Contest (ICPC) problems. Using a curated dataset of 166 World Finals problems from 2011 to 2024, we benchmark the models' reasoning, accuracy, and efficiency. We evaluate the five models-GPT-4o, Mistral Large, Llama-3.1-405B, and the o1 family, consisting of o1-mini and o1-preview, across critical metrics like correctness, resource utilization, and response calibration. Our results reveal significant differences in the models' abilities to generalize, adapt, and solve novel problems. We also investigated the impact of training methodologies, dataset contamination, and chain-of-thought reasoning on model performance. The findings provide new insights into optimizing LLMs for algorithmic tasks, highlighting both strengths and limitations of current models.