Are Language Models Up to Sequential Optimization Problems? From Evaluation to a Hegelian-Inspired Enhancement

作者: Soheil Abbasloo

分类: cs.CL, cs.AI

发布日期: 2025-02-04

💡 一句话要点

提出WorldGen与ACE框架以提升语言模型在序列优化问题中的表现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 序列优化 语言模型 黑格尔辩证法 优化问题 动态生成 模型提升 复杂度控制

📋 核心要点

- 现有大型语言模型在处理复杂序列优化问题时表现不佳,尤其在问题复杂度增加时性能显著下降。

- 本文提出WorldGen框架生成具有可控复杂度的序列优化问题,并引入ACE框架以提升LLMs的表现。

- 实验结果表明,采用ACE框架后,LLMs在复杂SOPs上的表现有显著提升,未进行重训练或微调。

📝 摘要(中文)

大型语言模型(LLMs)在多个领域展现出卓越能力,为优化问题的解决带来了革命性机遇。本文探讨了LLMs在处理序列优化问题(SOPs)方面的能力,并引入了WorldGen框架,以生成具有可控复杂度的未见SOPs来评估LLM的表现。研究发现,虽然LLMs在简单SOPs上表现良好,但随着复杂度增加,其性能显著下降。为此,本文借鉴黑格尔辩证法的哲学假设,提出了ACE框架,展示了如何在不进行重训练或进一步微调的情况下显著提升LLMs在SOP环境中的表现。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在处理序列优化问题时性能下降的问题,尤其是在问题复杂度增加的情况下,现有方法无法有效应对这一挑战。

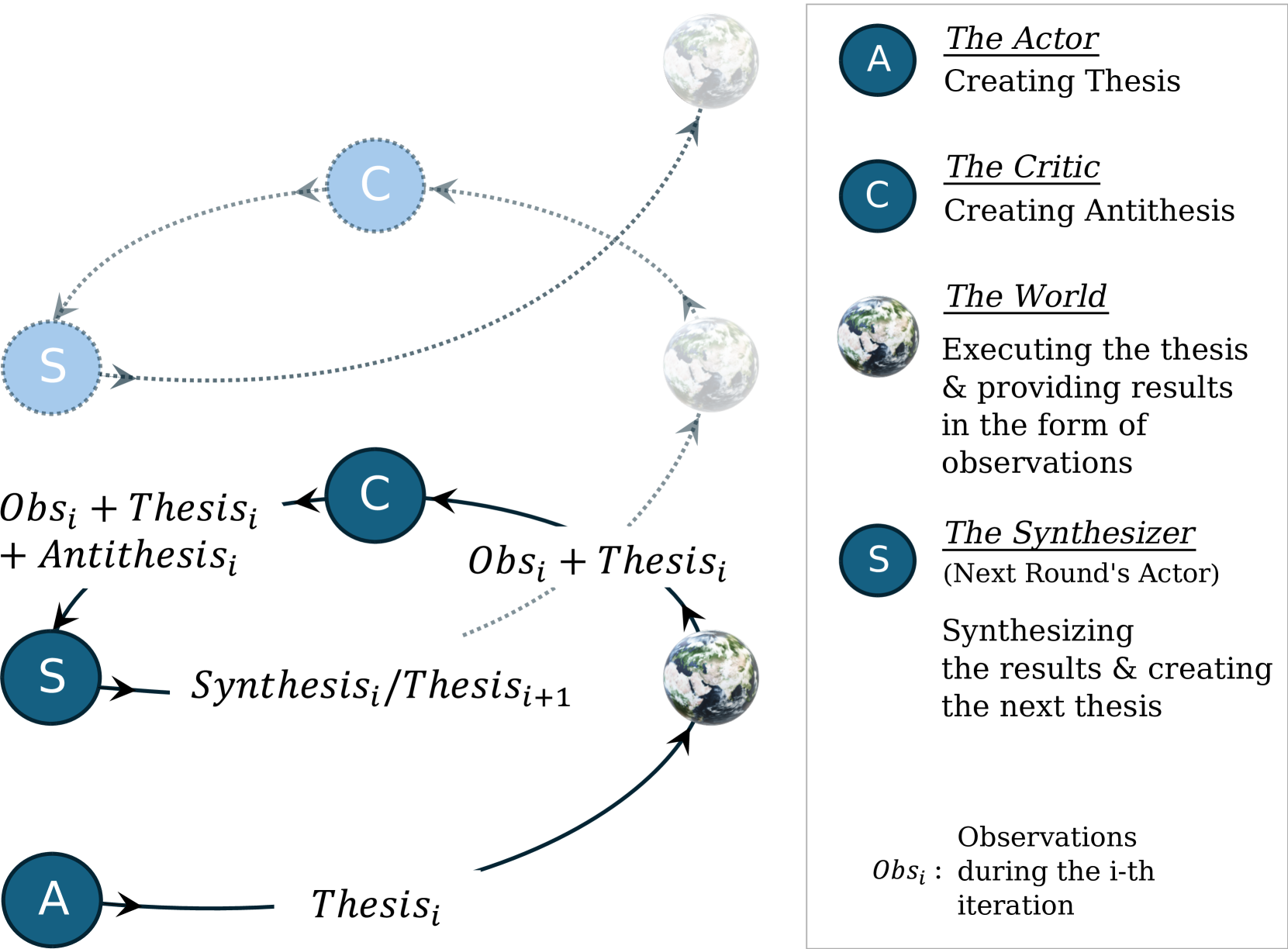

核心思路:论文的核心思路是通过引入WorldGen框架生成多样化的序列优化问题,并结合黑格尔辩证法的思想,提出ACE框架来提升LLMs的推理能力。这样的设计旨在通过哲学启发来改善模型的表现,而不是依赖传统的重训练或微调。

技术框架:整体架构包括两个主要模块:WorldGen用于生成具有不同复杂度的序列优化问题,ACE则用于优化LLMs在这些问题上的表现。通过动态生成问题,研究者能够更全面地评估模型的能力。

关键创新:最重要的技术创新点在于ACE框架的提出,它通过哲学启发的方式显著提升了LLMs在复杂序列优化问题上的表现,与现有方法的本质区别在于不需要重训练。

关键设计:在ACE框架中,关键设计包括对模型推理过程的优化,具体参数设置和损失函数的选择尚未详细披露,需进一步研究以明确最佳实践。具体的网络结构和参数设置也未在摘要中给出。

🖼️ 关键图片

📊 实验亮点

实验结果显示,采用ACE框架后,LLMs在复杂序列优化问题上的表现显著提升,具体性能数据和对比基线尚未详细披露,但整体提升幅度明显,展示了该方法的有效性。

🎯 应用场景

该研究的潜在应用领域包括自动化决策、资源分配、调度问题等复杂优化场景。通过提升语言模型在序列优化问题上的表现,能够为实际问题提供更高效的解决方案,具有广泛的实际价值和未来影响。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated impressive capabilities across numerous fields, presenting an opportunity to revolutionize optimization problem-solving, a crucial, ubiquitous, and complex domain. This paper explores the proficiency of LLMs in handling Sequential Optimization Problems (SOPs). We introduce WorldGen, a dynamic framework for generating unseen SOPs with controllable complexities, to evaluate LLM performance. Our initial observations reveal that while LLMs perform well on simple SOPs, their performance significantly degrades with increased complexity. Motivated by this, we revisit philosophical hypotheses on reasoning to enhance LLM performance. Inspired by the influential framework of Hegelian Dialectics, we propose ACE, demonstrating how the performance of LLMs in SOP contexts can be significantly improved without any retraining or further fine-tuning.