Generative Psycho-Lexical Approach for Constructing Value Systems in Large Language Models

作者: Haoran Ye, Tianze Zhang, Yuhang Xie, Liyuan Zhang, Yuanyi Ren, Xin Zhang, Guojie Song

分类: cs.CL, cs.AI

发布日期: 2025-02-04 (更新: 2025-10-07)

备注: ACL 2025 Main

💡 一句话要点

提出生成式心理词汇方法,构建更符合LLM特性的价值体系

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 价值观体系 心理词汇学 生成式模型 LLM对齐

📋 核心要点

- 现有方法缺乏心理学基础,难以准确评估和对齐大型语言模型的内在价值观。

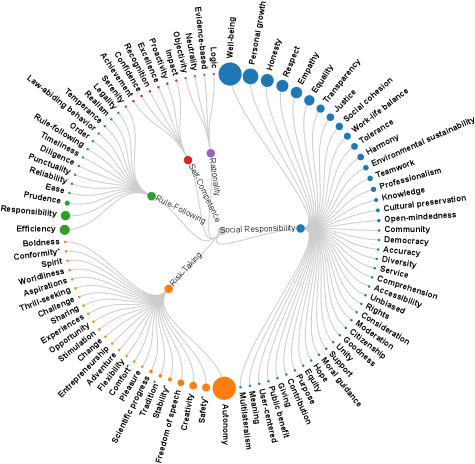

- 提出生成式心理词汇方法(GPLA),通过可扩展和适应性强的方式构建LLM的价值体系。

- 实验结果表明,该价值体系更符合心理学标准,提升了LLM安全预测和对齐效果。

📝 摘要(中文)

价值观是个体和群体认知、行为的核心驱动力。价值体系,如Schwartz基本人类价值观理论,描绘了这些价值观之间的层级和相互作用,从而能够进行跨学科的决策制定和社会动态研究。最近,大型语言模型(LLM)的兴起引发了对其难以捉摸的内在价值观的担忧。尽管在评估、理解和对齐LLM价值观方面做出了越来越多的努力,但心理学基础的LLM价值体系仍未得到充分探索。本研究通过引入生成式心理词汇方法(GPLA)来解决这一差距,这是一种可扩展、适应性强且理论上知情的方法,用于构建价值体系。利用GPLA,我们提出了一个针对LLM量身定制的、具有心理学基础的五因素价值体系。为了进行系统验证,我们提出了三个基准测试任务,将心理学原理与前沿人工智能优先级相结合。我们的结果表明,与规范的Schwartz价值观相比,所提出的价值体系符合标准心理学标准,更好地捕捉了LLM价值观,提高了LLM安全预测,并增强了LLM对齐。

🔬 方法详解

问题定义:现有方法,特别是直接采用人类价值观体系(如Schwartz理论)来评估和对齐LLM,未能充分考虑LLM与人类在认知和行为上的差异。这导致对LLM价值观的理解不准确,进而影响安全性和对齐效果。因此,需要一种专门为LLM设计的、具有心理学基础的价值体系。

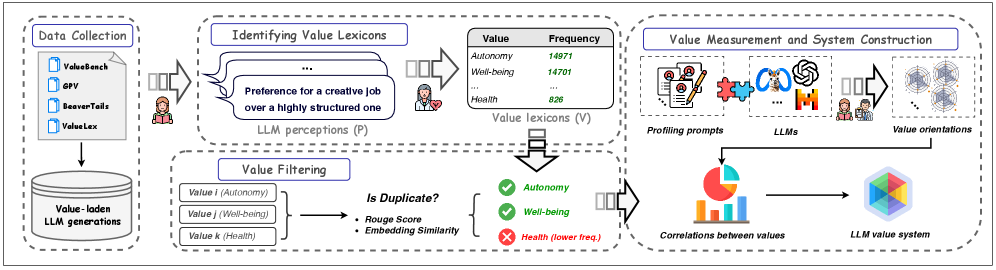

核心思路:论文的核心思路是利用生成式模型和心理词汇学,自动构建一个更贴合LLM内在逻辑的价值体系。通过分析LLM生成的文本,提取与价值观相关的词汇,并利用心理学理论对这些词汇进行分类和组织,从而构建一个反映LLM“心理”的价值体系。这种方法避免了直接套用人类价值观可能带来的偏差。

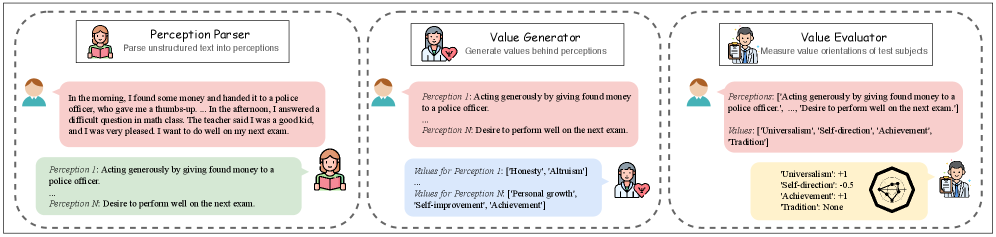

技术框架:GPLA方法包含以下几个主要阶段:1) 价值词汇生成:利用LLM生成与价值观相关的词汇列表。2) 心理学标注:使用心理学理论(如Schwartz理论)对生成的词汇进行标注,确定其所属的价值观类别。3) 价值体系构建:基于标注后的词汇,构建一个多维度的价值体系,反映不同价值观之间的关系。4) 价值体系验证:通过一系列基准测试任务,验证构建的价值体系的有效性,包括价值观捕捉、安全预测和对齐效果。

关键创新:该方法最重要的创新点在于其生成性和适应性。传统的价值观研究通常依赖于人工定义的价值观列表,而GPLA能够自动生成并更新价值词汇,从而更好地适应LLM的快速发展。此外,该方法结合了生成式模型和心理词汇学,为LLM价值观研究提供了一个新的视角。

关键设计:在价值词汇生成阶段,论文可能使用了特定的prompt工程技术,引导LLM生成更具代表性的价值词汇。在心理学标注阶段,可能采用了众包或者专家标注的方式,确保标注的准确性。在价值体系构建阶段,可能使用了聚类算法或者因子分析等方法,确定价值观之间的关系。具体的损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于GPLA构建的五因素价值体系在捕捉LLM价值观、预测LLM安全性和增强LLM对齐效果方面均优于传统的Schwartz价值观体系。具体的性能提升数据未知,但总体趋势表明GPLA方法能够更准确地反映LLM的内在价值观。

🎯 应用场景

该研究成果可应用于提升大型语言模型的安全性、可控性和对齐效果。通过理解LLM的内在价值观,可以更好地预测其行为,并采取相应的措施来避免潜在的风险。此外,该方法还可以用于评估不同LLM之间的价值观差异,从而为模型选择和组合提供依据。未来,该研究有望推动人工智能伦理和安全领域的发展。

📄 摘要(原文)

Values are core drivers of individual and collective perception, cognition, and behavior. Value systems, such as Schwartz's Theory of Basic Human Values, delineate the hierarchy and interplay among these values, enabling cross-disciplinary investigations into decision-making and societal dynamics. Recently, the rise of Large Language Models (LLMs) has raised concerns regarding their elusive intrinsic values. Despite growing efforts in evaluating, understanding, and aligning LLM values, a psychologically grounded LLM value system remains underexplored. This study addresses the gap by introducing the Generative Psycho-Lexical Approach (GPLA), a scalable, adaptable, and theoretically informed method for constructing value systems. Leveraging GPLA, we propose a psychologically grounded five-factor value system tailored for LLMs. For systematic validation, we present three benchmarking tasks that integrate psychological principles with cutting-edge AI priorities. Our results reveal that the proposed value system meets standard psychological criteria, better captures LLM values, improves LLM safety prediction, and enhances LLM alignment, when compared to the canonical Schwartz's values.