Activation-Informed Merging of Large Language Models

作者: Amin Heyrani Nobari, Kaveh Alim, Ali ArjomandBigdeli, Akash Srivastava, Faez Ahmed, Navid Azizan

分类: cs.CL, cs.AI

发布日期: 2025-02-04 (更新: 2025-11-06)

💡 一句话要点

提出激活信息引导的模型合并方法AIM,提升大语言模型性能和鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型合并 激活信息 持续学习 模型压缩 参数融合 知识整合

📋 核心要点

- 现有模型合并方法缺乏对模型内部激活信息的有效利用,导致合并后的模型性能提升有限,甚至可能出现性能下降。

- AIM方法的核心思想是利用激活空间的信息,在模型合并过程中有选择地保留基础模型中的关键权重,从而提升合并模型的性能和鲁棒性。

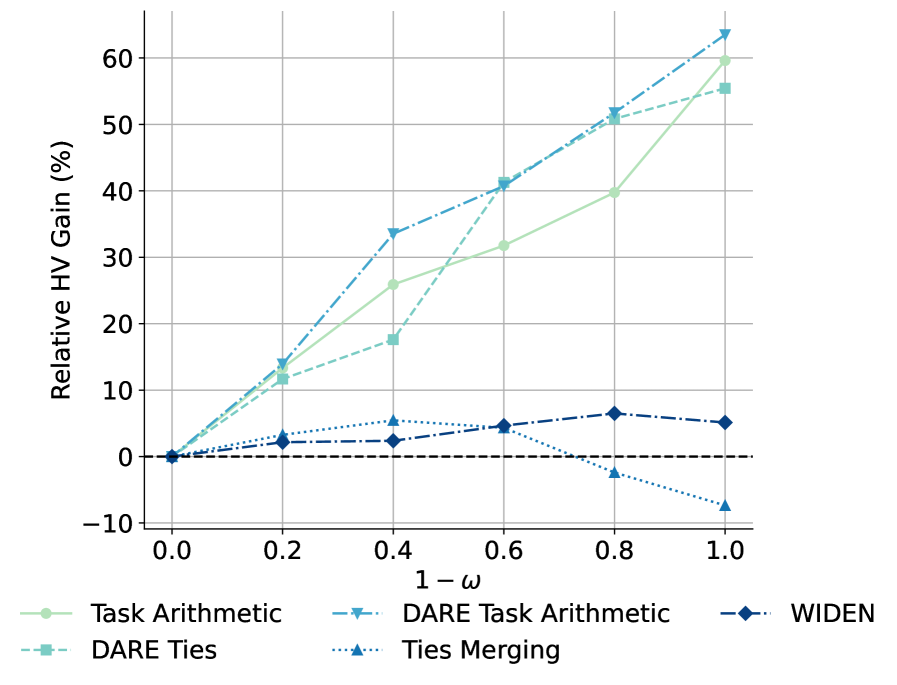

- 实验结果表明,AIM方法能够显著提升合并模型在多个基准测试中的性能,最高可达40%,验证了该方法的有效性。

📝 摘要(中文)

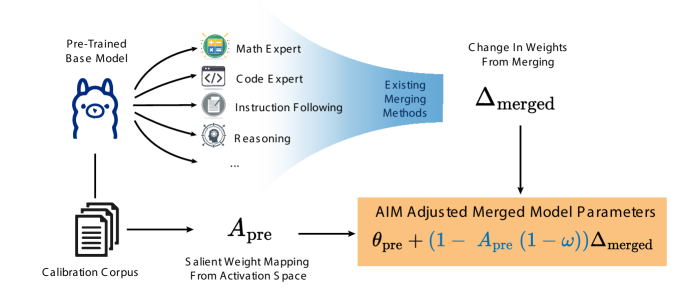

模型合并是一种结合多个微调后的大语言模型(LLM)参数和嵌入的方法,它提供了一种有前景的途径,可以在保持计算效率的同时,增强模型在各种任务上的性能。本文介绍了一种名为激活信息引导合并(AIM)的技术,该技术将LLM的激活空间信息整合到合并过程中,以提高性能和鲁棒性。AIM被设计成一种灵活的、互补的解决方案,适用于任何现有的合并方法。它的目标是保留来自基础模型的关键权重,借鉴了持续学习(CL)和模型压缩的原则。通过使用任务无关的校准集,AIM在合并过程中有选择地优先考虑重要的权重。我们通过实验证明,AIM显著提高了合并模型在多个基准测试中的性能。我们的研究结果表明,考虑激活空间信息可以为LLM的模型合并策略提供实质性的进步,在基准测试中性能提升高达40%。

🔬 方法详解

问题定义:模型合并旨在结合多个微调后LLM的优势,但现有方法通常直接平均或加权平均模型参数,忽略了模型内部激活状态的重要性。这可能导致合并后的模型性能不如预期,尤其是在任务差异较大时,容易出现灾难性遗忘等问题。因此,如何有效地利用模型内部信息,指导模型合并过程,是本文要解决的关键问题。

核心思路:AIM的核心思路是利用模型在处理数据时的激活信息,来判断哪些权重对于模型的性能至关重要。通过分析激活空间,可以识别出对特定任务或通用能力贡献较大的权重,并在合并过程中优先保留这些权重。这种方法借鉴了持续学习和模型压缩的思想,旨在避免合并过程中关键信息的丢失。

技术框架:AIM方法可以作为现有模型合并方法的补充模块。其主要流程包括:1) 使用一个任务无关的校准数据集,让参与合并的LLM进行推理;2) 记录每个LLM在校准数据集上的激活值;3) 基于激活值,计算每个权重的“重要性”得分;4) 在模型合并过程中,根据权重的重要性得分,调整合并的权重比例,优先保留重要性较高的权重。

关键创新:AIM的关键创新在于将激活空间的信息引入到模型合并过程中。与传统的参数平均方法不同,AIM能够根据权重对模型性能的贡献程度,动态地调整合并策略。这种方法更加精细化,能够更好地保留模型中的关键信息,从而提升合并后的模型性能。

关键设计:AIM的关键设计包括:1) 任务无关校准集的选择,需要保证数据集的多样性,能够覆盖模型可能遇到的各种场景;2) 权重重要性得分的计算方法,可以使用激活值的统计量(如均值、方差)或梯度信息来衡量;3) 合并权重比例的调整策略,可以使用线性加权、指数加权等方法,根据权重重要性得分来确定每个模型的贡献比例。

🖼️ 关键图片

📊 实验亮点

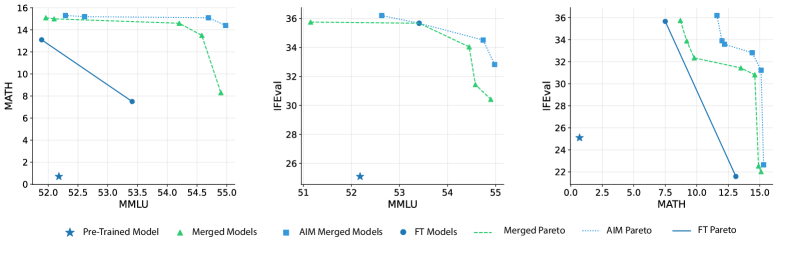

实验结果表明,AIM方法在多个基准测试中显著提升了合并模型的性能,最高可达40%。与传统的模型合并方法相比,AIM能够更好地保留模型中的关键信息,从而获得更高的准确率和更强的泛化能力。此外,AIM方法具有良好的通用性,可以与多种现有的模型合并方法相结合。

🎯 应用场景

AIM方法可以广泛应用于需要结合多个LLM优势的场景,例如:1) 个性化推荐系统,结合用户历史行为数据微调的多个模型;2) 多领域知识问答系统,融合不同领域知识的多个模型;3) 持续学习场景,合并新任务微调后的模型,同时保留原有任务的性能。该方法具有提升模型性能、增强模型鲁棒性和降低计算成本的潜力。

📄 摘要(原文)

Model merging, a method that combines the parameters and embeddings of multiple fine-tuned large language models (LLMs), offers a promising approach to enhance model performance across various tasks while maintaining computational efficiency. This paper introduces Activation-Informed Merging (AIM), a technique that integrates the information from the activation space of LLMs into the merging process to improve performance and robustness. AIM is designed as a flexible, complementary solution that is applicable to any existing merging method. It aims to preserve critical weights from the base model, drawing on principles from continual learning (CL) and model compression. Utilizing a task-agnostic calibration set, AIM selectively prioritizes essential weights during merging. We empirically demonstrate that AIM significantly enhances the performance of merged models across multiple benchmarks. Our findings suggest that considering the activation-space information can provide substantial advancements in the model merging strategies for LLMs, with up to a 40% increase in benchmark performance.