CoAT: Chain-of-Associated-Thoughts Framework for Enhancing Large Language Models Reasoning

作者: Jianfeng Pan, Senyou Deng, Shaomang Huang

分类: cs.CL, cs.AI

发布日期: 2025-02-04 (更新: 2025-11-13)

备注: 18 pages, 10 figures, Accepted by EMNLP 2025 (Findings)

💡 一句话要点

提出CoAT框架,结合MCTS与联想记忆增强大语言模型推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理能力 蒙特卡洛树搜索 联想记忆 知识库 多跳推理 自适应学习

📋 核心要点

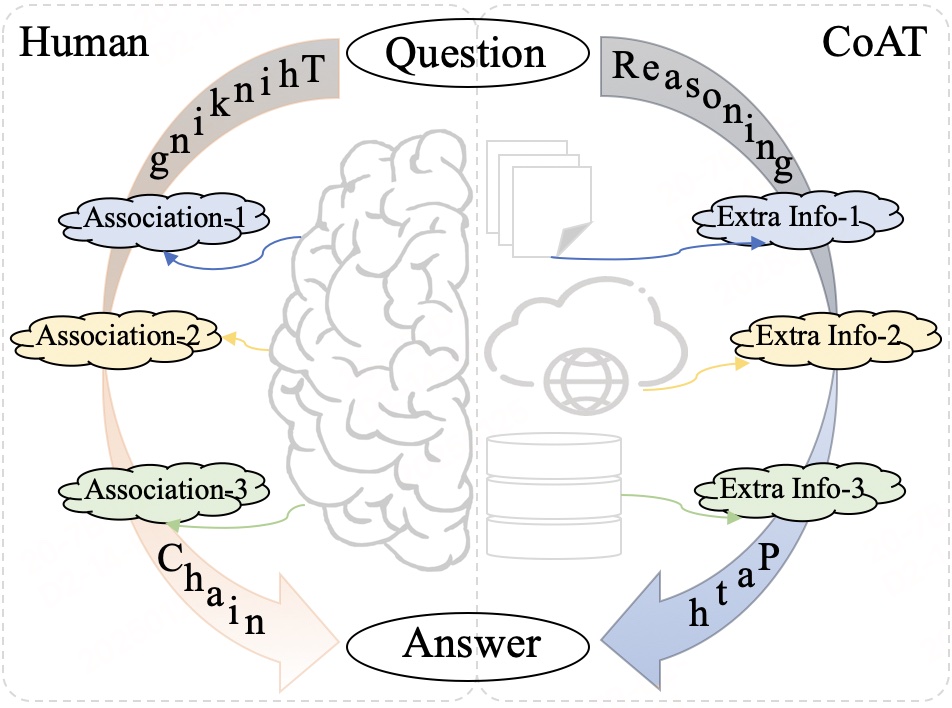

- 现有LLM推理依赖“快速思考”,基于单一查询和自身能力生成结果,缺乏人类思考时的联想和知识补充。

- CoAT框架结合蒙特卡洛树搜索(MCTS)和联想记忆,扩展LLM搜索空间,动态更新知识库,模拟人类联想思考过程。

- 实验表明,CoAT在多跳推理数据集HotpotQA和MuSiQue上提升超过10%,在CRB数据集上提升超过15%,验证了其有效性。

📝 摘要(中文)

本文提出了一种名为“联想思维链”(CoAT)的新框架,旨在增强大型语言模型(LLM)的推理能力。该框架受到人类在思考过程中不断联想和补充知识的启发,创新性地结合了蒙特卡洛树搜索(MCTS)算法和动态整合新关键信息的“联想记忆”机制。通过将MCTS的结构化探索能力与联想记忆的自适应学习能力相结合,CoAT显著扩展了LLM的搜索空间,使其能够探索多样化的推理路径并实时动态更新其知识库。这使得框架不仅能够回顾和改进早期的推论,还能自适应地整合不断发展的信息,确保最终输出既准确又全面。在各种生成和推理任务中验证了CoAT的有效性。定量实验表明,CoAT在开源多跳推理数据集(HotpotQA、MuSiQue)上实现了超过10%的性能提升,并在作者自有的CRB数据集上实现了超过15%的提升。

🔬 方法详解

问题定义:现有的大型语言模型在进行复杂推理时,通常采用“快速思考”模式,即直接基于给定的输入和模型自身的知识进行推理,缺乏人类思考过程中不断联想和补充知识的能力。这种方式限制了模型探索更广泛的推理路径,容易陷入局部最优解,导致推理结果不够准确和全面。现有方法难以有效模拟人类的“慢思考”过程。

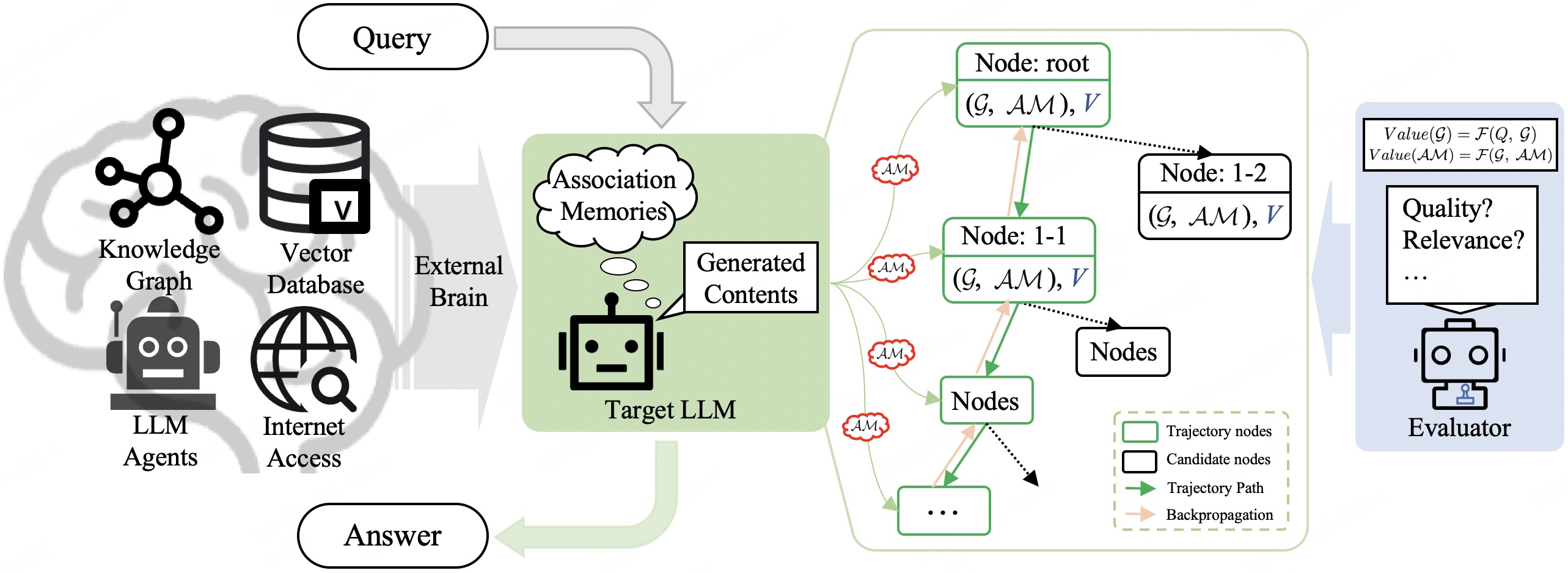

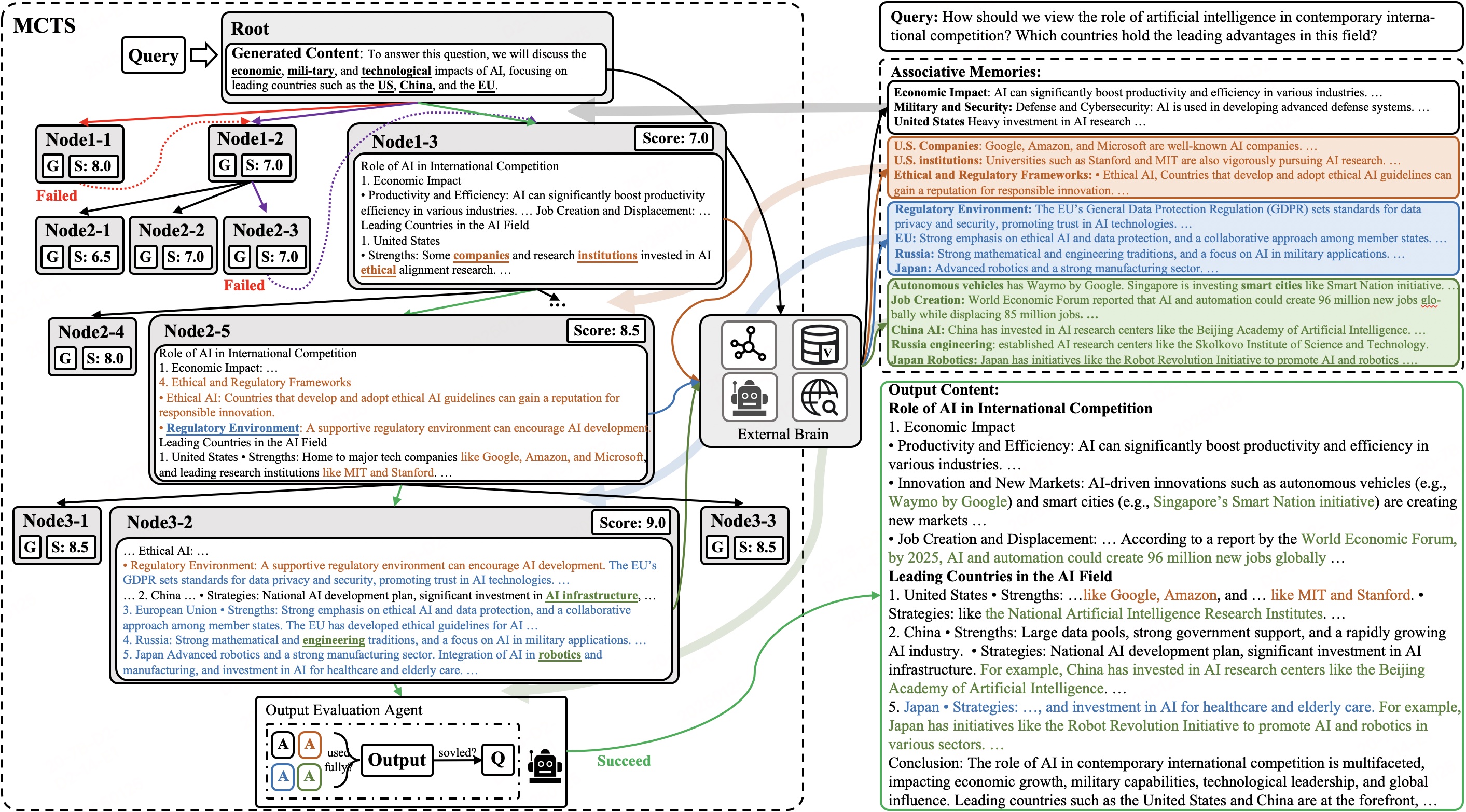

核心思路:CoAT框架的核心思路是模拟人类在思考过程中不断联想和补充知识的过程。通过结合蒙特卡洛树搜索(MCTS)算法和动态的“联想记忆”机制,CoAT能够扩展LLM的搜索空间,探索多样化的推理路径,并实时更新其知识库。这种方式使得模型能够回顾和改进早期的推论,并自适应地整合不断发展的信息,从而提高推理的准确性和全面性。

技术框架:CoAT框架主要包含以下几个关键模块:1) MCTS搜索树:利用MCTS算法构建搜索树,每个节点代表一个中间推理状态。2) LLM推理引擎:使用LLM作为推理引擎,负责生成候选的推理步骤。3) 联想记忆模块:维护一个动态的知识库,用于存储和检索与当前推理状态相关的知识。4) 奖励函数:用于评估每个推理步骤的质量,并指导MCTS的搜索方向。整体流程是:从初始状态开始,MCTS通过选择、扩展、模拟和反向传播等步骤,不断探索搜索树。在每个节点,LLM推理引擎生成候选的推理步骤,联想记忆模块检索相关的知识,奖励函数评估推理步骤的质量,并将结果反馈给MCTS,指导其搜索方向。最终,选择最优的推理路径作为最终的推理结果。

关键创新:CoAT框架的关键创新在于将蒙特卡洛树搜索(MCTS)算法和动态的“联想记忆”机制相结合。与传统的基于单一查询的推理方法相比,CoAT能够探索更广泛的推理路径,并实时更新其知识库,从而提高推理的准确性和全面性。联想记忆模块的设计使得模型能够自适应地整合不断发展的信息,避免了陷入局部最优解。

关键设计:联想记忆模块的关键设计包括:1) 知识表示:使用向量嵌入来表示知识,以便进行相似度计算。2) 知识检索:使用余弦相似度等方法来检索与当前推理状态相关的知识。3) 知识更新:使用滑动平均等方法来更新知识库,以保持其时效性。奖励函数的设计需要综合考虑推理步骤的准确性、相关性和新颖性。MCTS的参数设置,如探索常数和模拟次数,需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoAT框架在多个数据集上取得了显著的性能提升。在开源多跳推理数据集HotpotQA和MuSiQue上,CoAT的性能提升超过10%。在作者自有的CRB数据集上,CoAT的性能提升超过15%。这些结果验证了CoAT框架的有效性,表明其能够显著提高LLM在复杂推理任务中的性能。

🎯 应用场景

CoAT框架具有广泛的应用前景,可应用于问答系统、对话系统、知识图谱推理等领域。该框架能够提高LLM在复杂推理任务中的性能,使其能够更好地理解和解决实际问题。未来,CoAT可以进一步扩展到其他领域,如医疗诊断、金融分析等,为各行各业提供更智能化的解决方案。

📄 摘要(原文)

Research on LLM technologies is rapidly emerging, with most of them employ a 'fast thinking' approach to inference. Most LLMs generate the final result based solely on a single query and LLM's reasoning capabilities. However, with the advent of OpenAI-o1, 'slow thinking' techniques have garnered increasing attention because its process is closer to the human thought process. Inspired by the human ability to constantly associate and replenish knowledge during thinking, we developed the novel Chain-of-Associated-Thoughts (CoAT) framework, which introduces an innovative synergy between the Monte Carlo Tree Search (MCTS) algorithm and a dynamic mechanism for integrating new key information, termed 'associative memory'. By combining the structured exploration capabilities of MCTS with the adaptive learning capacity of associative memory, CoAT significantly expands the LLM search space, enabling our framework to explore diverse reasoning pathways and dynamically update its knowledge base in real-time. This allows the framework to not only revisit and refine earlier inferences but also adaptively incorporate evolving information, ensuring that the final output is both accurate and comprehensive. We validate CoAT's effectiveness across a variety of generative and reasoning tasks. Quantitative experiments show that CoAT achieves over 10% performance improvement on open-source multi-hop reasoning datasets (HotpotQA, MuSiQue) and more than 15% gain on our proprietary CRB dataset.