OphthBench: A Comprehensive Benchmark for Evaluating Large Language Models in Chinese Ophthalmology

作者: Chengfeng Zhou, Ji Wang, Juanjuan Qin, Yining Wang, Ling Sun, Weiwei Dai

分类: cs.CL, cs.AI

发布日期: 2025-02-03

💡 一句话要点

OphthBench:构建中文眼科领域LLM综合评测基准,助力临床应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 眼科 中文 评测基准 临床应用

📋 核心要点

- 现有LLM在眼科应用潜力巨大,但缺乏针对中文眼科场景的系统性评估,限制了其临床落地。

- OphthBench基准将眼科临床流程划分为教育、分诊等五大场景,构建多任务评测体系。

- 实验评估了39个LLM,揭示了现有模型与临床实用性之间的差距,为未来发展指明方向。

📝 摘要(中文)

大型语言模型(LLMs)在各种医疗应用中展现出巨大的潜力,眼科是其中一个值得关注的领域。通过整合LLMs,许多眼科任务都取得了显著的改进。然而,在这些模型被广泛应用于临床实践之前,评估它们的能力并识别其局限性至关重要。为了解决这一研究空白,并支持LLMs的实际应用,我们推出了OphthBench,这是一个专门的基准,旨在评估LLMs在中国眼科实践中的性能。该基准系统地将典型的眼科临床工作流程划分为五个关键场景:教育、分诊、诊断、治疗和预后。对于每个场景,我们开发了多个具有不同问题类型的任务,从而形成了一个包含9个任务和591个问题的综合基准。这个全面的框架可以对LLMs的能力进行彻底的评估,并深入了解它们在中国眼科中的实际应用。我们使用这个基准进行了广泛的实验,并分析了39个流行的LLMs的结果。我们的评估突出了LLM开发与其在临床环境中的实际效用之间的差距,为未来的发展提供了明确的方向。通过弥合这一差距,我们旨在释放LLMs的潜力,并推进其在眼科领域的发展。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在中文眼科领域的性能评估问题。现有方法缺乏针对中文眼科临床实践的专门评估基准,无法有效衡量LLMs在该领域的实际应用能力,阻碍了LLMs在眼科临床中的广泛应用。

核心思路:论文的核心思路是构建一个全面的、专门针对中文眼科领域的LLM评估基准,即OphthBench。通过模拟真实的眼科临床工作流程,设计多个具有代表性的任务,从而系统地评估LLMs在不同场景下的性能。

技术框架:OphthBench将典型的眼科临床工作流程划分为五个关键场景:教育、分诊、诊断、治疗和预后。针对每个场景,设计了多个任务,每个任务包含不同类型的问题。整个基准包含9个任务和591个问题,形成一个全面的评估框架。

关键创新:OphthBench的关键创新在于其针对性和全面性。它专门针对中文眼科领域,考虑了中国特有的临床实践和语言习惯。同时,它覆盖了眼科临床工作流程的多个关键场景,提供了全面的评估。

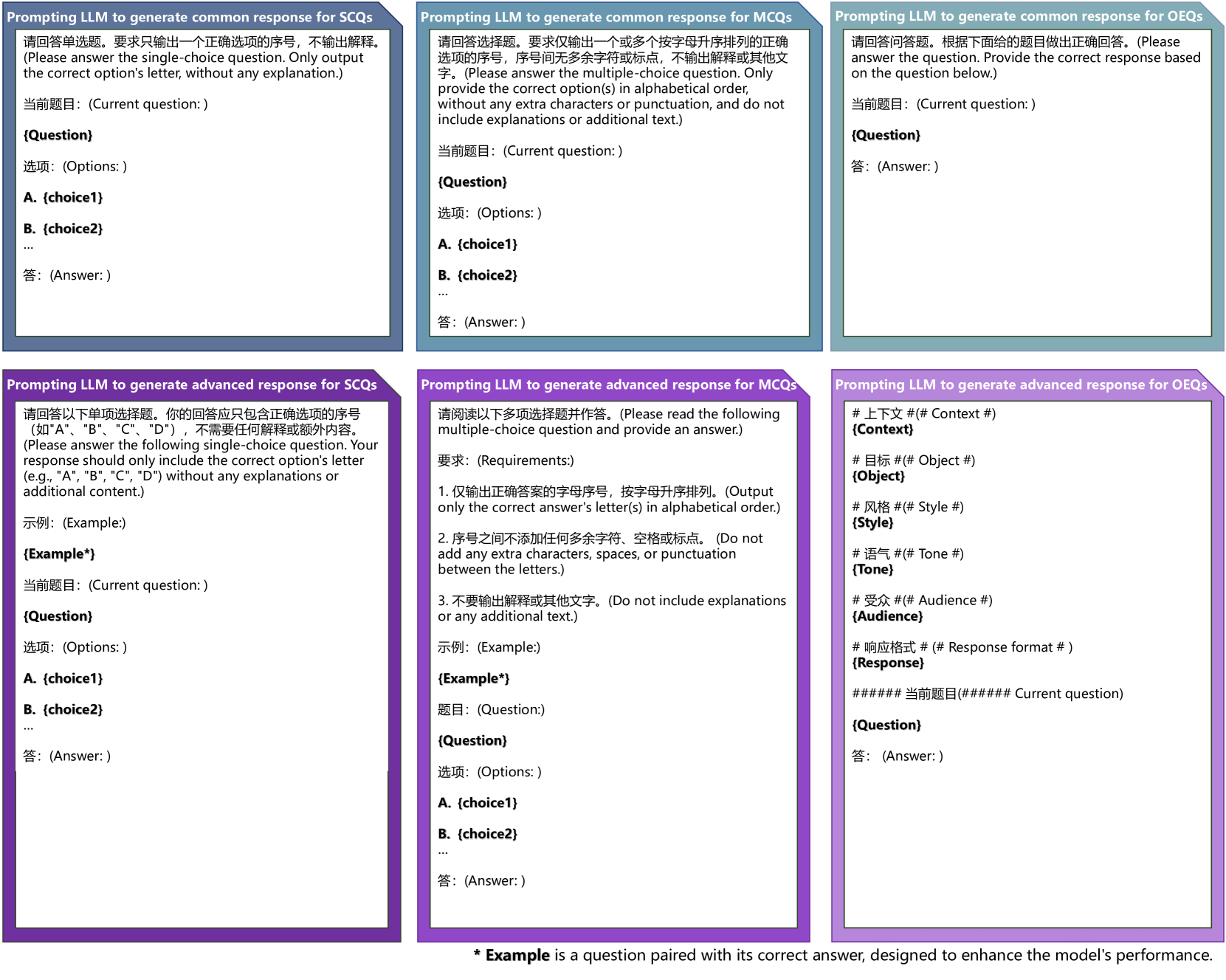

关键设计:在任务设计方面,论文考虑了不同类型的问题,例如单选题、多选题、简答题等,以全面评估LLMs的理解、推理和生成能力。此外,论文还针对每个任务设计了相应的评估指标,以量化LLMs的性能。

🖼️ 关键图片

📊 实验亮点

论文使用OphthBench评估了39个流行的LLMs,结果表明,尽管LLMs在某些眼科任务上表现出一定的能力,但与临床医生的水平相比仍有较大差距。这表明,现有LLMs在中文眼科领域的应用仍处于早期阶段,需要进一步的研究和改进。该评估结果为未来的研究方向提供了重要的参考。

🎯 应用场景

OphthBench可用于评估和改进LLMs在中文眼科领域的应用,例如辅助诊断、智能分诊、患者教育等。该基准能够帮助研究人员和开发者更好地了解LLMs的优势和局限性,从而开发出更符合临床需求的智能眼科应用,提升医疗效率和患者体验。

📄 摘要(原文)

Large language models (LLMs) have shown significant promise across various medical applications, with ophthalmology being a notable area of focus. Many ophthalmic tasks have shown substantial improvement through the integration of LLMs. However, before these models can be widely adopted in clinical practice, evaluating their capabilities and identifying their limitations is crucial. To address this research gap and support the real-world application of LLMs, we introduce the OphthBench, a specialized benchmark designed to assess LLM performance within the context of Chinese ophthalmic practices. This benchmark systematically divides a typical ophthalmic clinical workflow into five key scenarios: Education, Triage, Diagnosis, Treatment, and Prognosis. For each scenario, we developed multiple tasks featuring diverse question types, resulting in a comprehensive benchmark comprising 9 tasks and 591 questions. This comprehensive framework allows for a thorough assessment of LLMs' capabilities and provides insights into their practical application in Chinese ophthalmology. Using this benchmark, we conducted extensive experiments and analyzed the results from 39 popular LLMs. Our evaluation highlights the current gap between LLM development and its practical utility in clinical settings, providing a clear direction for future advancements. By bridging this gap, we aim to unlock the potential of LLMs and advance their development in ophthalmology.