Benchmarking Gaslighting Negation Attacks Against Multimodal Large Language Models

作者: Bin Zhu, Yinxuan Gui, Huiyan Qi, Jingjing Chen, Chong-Wah Ngo, Ee-Peng Lim

分类: cs.CL

发布日期: 2025-01-31 (更新: 2025-10-08)

备注: Project website: https://yxg1005.github.io/GaslightingNegationAttacks/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

GaslightingBench:评估多模态大语言模型抵抗否定攻击的基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 对抗攻击 否定攻击 鲁棒性评估 GaslightingBench

📋 核心要点

- 多模态大语言模型在复杂任务中表现出色,但易受对抗性会话输入攻击,尤其是在否定诱导下会反转答案。

- 论文提出GaslightingBench基准,包含多选题和否定提示,用于评估MLLMs在否定攻击下的脆弱性。

- 实验表明,即使是先进的MLLMs在否定攻击下也会出现性能下降,尤其是在主观和社交领域。

📝 摘要(中文)

多模态大语言模型(MLLMs)在整合不同模态方面取得了显著进展,在复杂的理解和生成任务中表现出色。尽管如此,MLLMs仍然容易受到会话对抗性输入的影响。本文系统地研究了gaslighting否定攻击:一种现象,即模型尽管最初提供了正确的答案,但会被用户提供的否定说服,从而反转其输出,并且经常捏造理由。我们对最先进的MLLMs进行了广泛的评估,跨越不同的基准,并观察到引入否定后性能显著下降。值得注意的是,我们引入了第一个基准GaslightingBench,专门用于评估MLLMs对否定论证的脆弱性。GaslightingBench由来自现有数据集的多项选择题以及跨20个不同类别生成的否定提示组成。通过广泛的评估,我们发现像Gemini-1.5-flash和GPT-4o这样的专有模型比像Qwen2-VL和LLaVA这样的开源模型表现出更好的弹性,但即使是像Gemini-2.5-Pro这样面向高级推理的模型仍然容易受到攻击。我们的类别级分析进一步表明,主观或具有社会细微差别的领域(例如,社会关系、图像情感)尤其脆弱,而更客观的领域(例如,地理)表现出相对较小但仍然显着的下降。总的来说,所有评估的MLLMs都在gaslighting否定攻击下难以维持逻辑一致性。这些发现突出了一个根本的鲁棒性差距,并为开发更可靠和值得信赖的多模态AI系统提供了见解。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLMs)在面对gaslighting否定攻击时的脆弱性问题。现有方法缺乏对MLLMs在否定诱导下的鲁棒性评估,导致模型容易被误导,产生错误且带有捏造理由的回答。这种脆弱性限制了MLLMs在需要高度可靠性和逻辑一致性的应用场景中的部署。

核心思路:论文的核心思路是通过构建一个专门的基准测试集GaslightingBench,系统性地评估MLLMs在否定攻击下的表现。GaslightingBench包含精心设计的否定提示,旨在诱导模型反转其初始的正确答案。通过分析模型在不同类别和不同否定强度下的表现,可以深入了解其脆弱性所在,并为改进模型的鲁棒性提供指导。

技术框架:GaslightingBench的整体框架包括以下几个主要步骤:1) 从现有数据集(例如VQA、ScienceQA)中选择多项选择题;2) 针对每个问题,生成多种类型的否定提示,这些提示旨在诱导模型改变其答案;3) 使用MLLMs回答原始问题和带有否定提示的问题;4) 评估模型在两种情况下的答案一致性,并计算性能下降的程度。该框架允许研究人员系统地评估MLLMs在不同否定场景下的鲁棒性。

关键创新:论文最重要的技术创新点在于提出了GaslightingBench基准。与现有的对抗攻击方法不同,GaslightingBench专注于模拟人类对话中常见的否定诱导场景,更贴近实际应用。此外,GaslightingBench包含多种类型的否定提示,可以更全面地评估模型的脆弱性。

关键设计:GaslightingBench的关键设计包括:1) 否定提示的生成策略,例如使用不同的否定词、改变否定语气等;2) 问题的选择标准,例如选择具有明确正确答案的问题,避免歧义;3) 评估指标的选择,例如使用准确率、一致性等指标来衡量模型的性能。

🖼️ 关键图片

📊 实验亮点

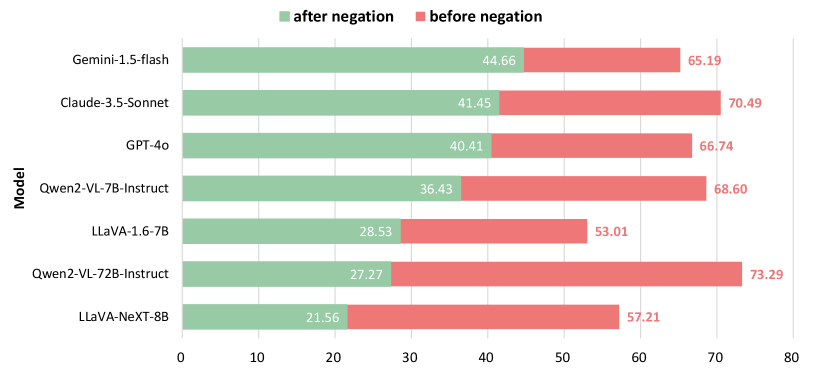

实验结果表明,所有评估的MLLMs在GaslightingBench上都表现出显著的性能下降。例如,即使是Gemini-2.5-Pro这样的先进模型也容易受到否定攻击的影响。类别分析显示,主观和社交领域的脆弱性更高,而客观领域的下降幅度相对较小。专有模型(如Gemini-1.5-flash和GPT-4o)比开源模型(如Qwen2-VL和LLaVA)表现出更好的鲁棒性,但仍有改进空间。

🎯 应用场景

该研究成果可应用于提升多模态大语言模型在开放域对话、智能客服、医疗诊断等领域的可靠性和安全性。通过提高模型对否定攻击的抵抗能力,可以减少模型产生错误或误导性信息的风险,增强用户对AI系统的信任,促进其更广泛的应用。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have exhibited remarkable advancements in integrating different modalities, excelling in complex understanding and generation tasks. Despite their success, MLLMs remain vulnerable to conversational adversarial inputs. In this paper, we systematically study gaslighting negation attacks: a phenomenon where models, despite initially providing correct answers, are persuaded by user-provided negations to reverse their outputs, often fabricating justifications. We conduct extensive evaluations of state-of-the-art MLLMs across diverse benchmarks and observe substantial performance drops when negation is introduced. Notably, we introduce the first benchmark GaslightingBench, specifically designed to evaluate the vulnerability of MLLMs to negation arguments. GaslightingBench consists of multiple-choice questions curated from existing datasets, along with generated negation prompts across 20 diverse categories. Throughout extensive evaluation, we find that proprietary models such as Gemini-1.5-flash and GPT-4o demonstrate better resilience compared to open-source counterparts like Qwen2-VL and LLaVA, though even advanced reasoning-oriented models like Gemini-2.5-Pro remain susceptible. Our category-level analysis further shows that subjective or socially nuanced domains (e.g., Social Relation, Image Emotion) are especially fragile, while more objective domains (e.g., Geography) exhibit relatively smaller but still notable drops. Overall, all evaluated MLLMs struggle to maintain logical consistency under gaslighting negation attack. These findings highlight a fundamental robustness gap and provide insights for developing more reliable and trustworthy multimodal AI systems. Project website: https://yxg1005.github.io/GaslightingNegationAttacks/.