Layered Chain-of-Thought Prompting for Multi-Agent LLM Systems: A Comprehensive Approach to Explainable Large Language Models

作者: Manish Sanwal

分类: cs.CL, cs.AI, cs.MA

发布日期: 2025-01-29 (更新: 2025-02-03)

💡 一句话要点

提出分层思维链提示(Layered-CoT),提升多智能体LLM系统解释性和可靠性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链提示 大型语言模型 多智能体系统 可解释性 分层推理

📋 核心要点

- 传统思维链(CoT)提示在复杂任务中表现出不足,缺乏对中间推理的有效验证,可能导致误导性解释。

- Layered-CoT将推理过程分解为多层,每层都进行外部验证和用户反馈,从而提高LLM的透明度和正确性。

- 在医疗、金融和敏捷工程等场景中,Layered-CoT展现出优于传统CoT的性能,提升了用户参与度和解释可靠性。

📝 摘要(中文)

大型语言模型(LLM)利用思维链(CoT)提示来提供逐步的推理过程,从而提高复杂任务的性能。然而,原始的CoT方法通常无法充分验证中间推理步骤,并可能产生误导性的解释。本文提出了分层思维链(Layered-CoT)提示,这是一种新颖的框架,它系统地将推理过程分割成多个层,每一层都接受外部检查和可选的用户反馈。我们扩展了关键概念,提出了三个应用场景——医疗分诊、金融风险评估和敏捷工程——并证明了Layered-CoT在透明度、正确性和用户参与度方面优于原始CoT。通过整合近期arXiv论文中关于交互式可解释性、多智能体框架和基于智能体的协作的参考文献,我们展示了Layered-CoT如何为高风险领域中更可靠和更具依据的解释铺平道路。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)虽然可以通过思维链(CoT)提示来提升复杂任务的性能,但原始CoT方法缺乏对中间推理步骤的有效验证机制。这导致LLM可能在推理过程中产生错误或偏差,最终给出误导性的解释,尤其是在高风险领域,这种不准确性会带来严重后果。因此,如何提高LLM推理过程的透明度和可靠性,确保每一步推理都经过充分验证,是本文要解决的核心问题。

核心思路:Layered-CoT的核心思路是将复杂的推理过程分解为多个逻辑层,每一层代表推理过程中的一个特定阶段或步骤。通过将推理过程分解为更小的、更易于管理的部分,可以更容易地对每个步骤进行外部验证和用户反馈。这种分层结构允许对推理过程进行更细粒度的控制和监督,从而提高整体的准确性和可靠性。此外,用户反馈的引入进一步增强了系统的适应性和可信度。

技术框架:Layered-CoT的整体框架包含以下几个主要阶段:1) 问题分解:将原始问题分解为多个子问题,每个子问题对应推理过程的一个逻辑层。2) 分层推理:LLM在每个层级上执行推理,生成中间结果和解释。3) 外部验证:对每个层级的推理结果进行外部验证,例如通过知识库查询、规则引擎或用户反馈。4) 反馈整合:将外部验证的结果整合到LLM的推理过程中,用于纠正错误或改进解释。5) 结果输出:最终输出经过验证和修正的推理结果和解释。

关键创新:Layered-CoT最重要的创新在于其分层推理和外部验证的结合。与传统的CoT方法相比,Layered-CoT不是简单地让LLM生成一个完整的推理链,而是将其分解为多个可验证的步骤。这种分层结构使得可以更容易地识别和纠正推理过程中的错误,从而提高整体的准确性和可靠性。此外,外部验证机制的引入使得LLM的推理过程更加透明和可信。

关键设计:Layered-CoT的关键设计包括:1) 层级划分策略:如何将推理过程划分为合适的层级,需要根据具体任务进行设计。2) 外部验证方法:根据不同的层级和任务,选择合适的外部验证方法,例如知识库查询、规则引擎或用户反馈。3) 反馈整合机制:如何将外部验证的结果有效地整合到LLM的推理过程中,需要设计合适的反馈机制,例如调整LLM的参数或修改推理路径。

🖼️ 关键图片

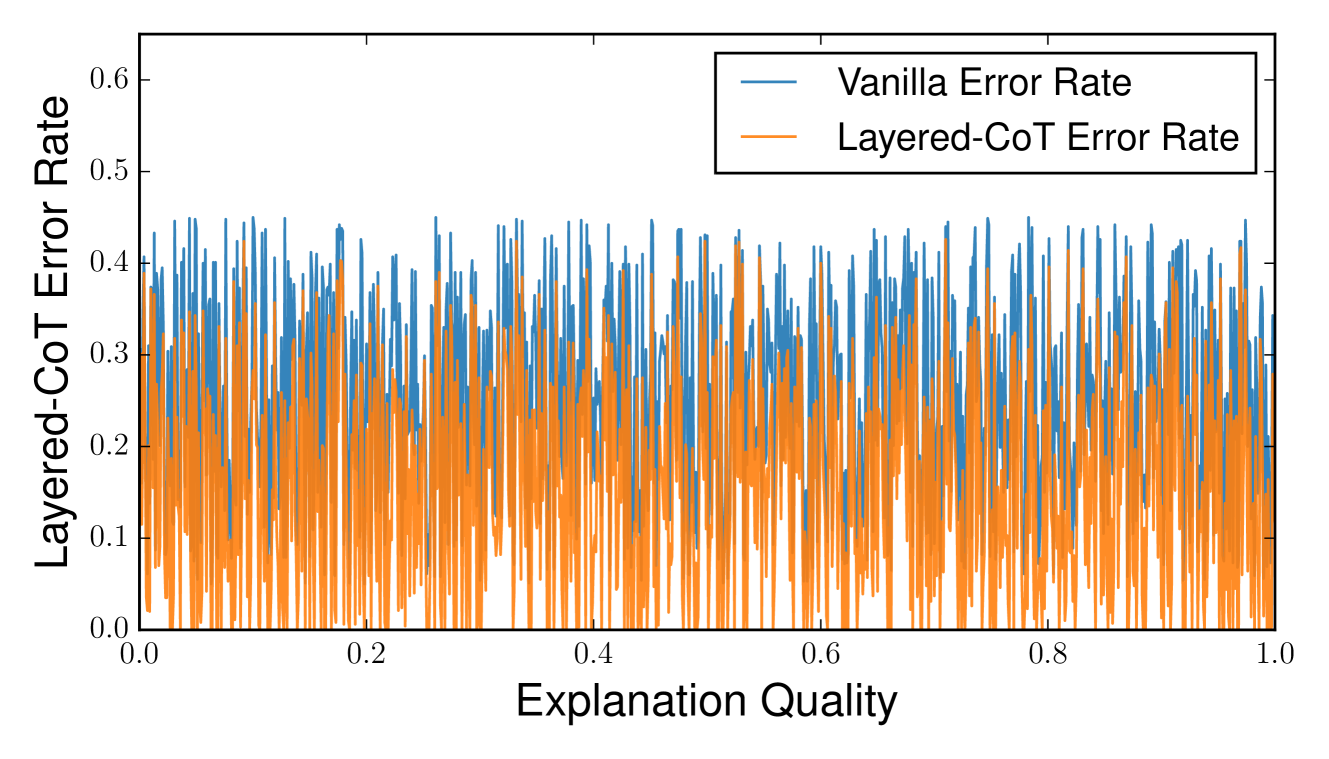

📊 实验亮点

论文在医疗分诊、金融风险评估和敏捷工程三个场景中验证了Layered-CoT的有效性。实验结果表明,Layered-CoT在透明度、正确性和用户参与度方面均优于传统的CoT方法。具体的性能提升数据未知,但论文强调了Layered-CoT在高风险领域的潜在价值。

🎯 应用场景

Layered-CoT具有广泛的应用前景,尤其是在需要高度可靠性和可解释性的高风险领域,如医疗诊断、金融风险评估、法律咨询和智能客服。通过提供更透明、更准确的推理过程,Layered-CoT可以帮助用户更好地理解LLM的决策,并提高对LLM的信任度。未来,Layered-CoT有望成为构建可信赖人工智能系统的关键技术。

📄 摘要(原文)

Large Language Models (LLMs) leverage chain-of-thought (CoT) prompting to provide step-by-step rationales, improving performance on complex tasks. Despite its benefits, vanilla CoT often fails to fully verify intermediate inferences and can produce misleading explanations. In this work, we propose Layered Chain-of-Thought (Layered-CoT) Prompting, a novel framework that systematically segments the reasoning process into multiple layers, each subjected to external checks and optional user feedback. We expand on the key concepts, present three scenarios -- medical triage, financial risk assessment, and agile engineering -- and demonstrate how Layered-CoT surpasses vanilla CoT in terms of transparency, correctness, and user engagement. By integrating references from recent arXiv papers on interactive explainability, multi-agent frameworks, and agent-based collaboration, we illustrate how Layered-CoT paves the way for more reliable and grounded explanations in high-stakes domains.