In-Context Meta LoRA Generation

作者: Yihua Shao, Minxi Yan, Yang Liu, Siyu Chen, Wenjie Chen, Xinwei Long, Ziyang Yan, Lei Li, Chenyu Zhang, Nicu Sebe, Hao Tang, Yan Wang, Hao Zhao, Mengzhu Wang, Jingcai Guo

分类: cs.CL, cs.AI, cs.CV

发布日期: 2025-01-29 (更新: 2025-07-05)

备注: Accepted by IJCAI 2025

💡 一句话要点

提出ICM-LoRA,通过上下文元学习生成任务相关的LoRA参数,实现高效的大语言模型定制。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LoRA 参数生成 条件变分自编码器 上下文元学习 大语言模型 多任务学习 模型定制

📋 核心要点

- 现有方法为每个任务训练单独的LoRA模型,导致存储和推理效率低下,且忽略了任务间的相关性。

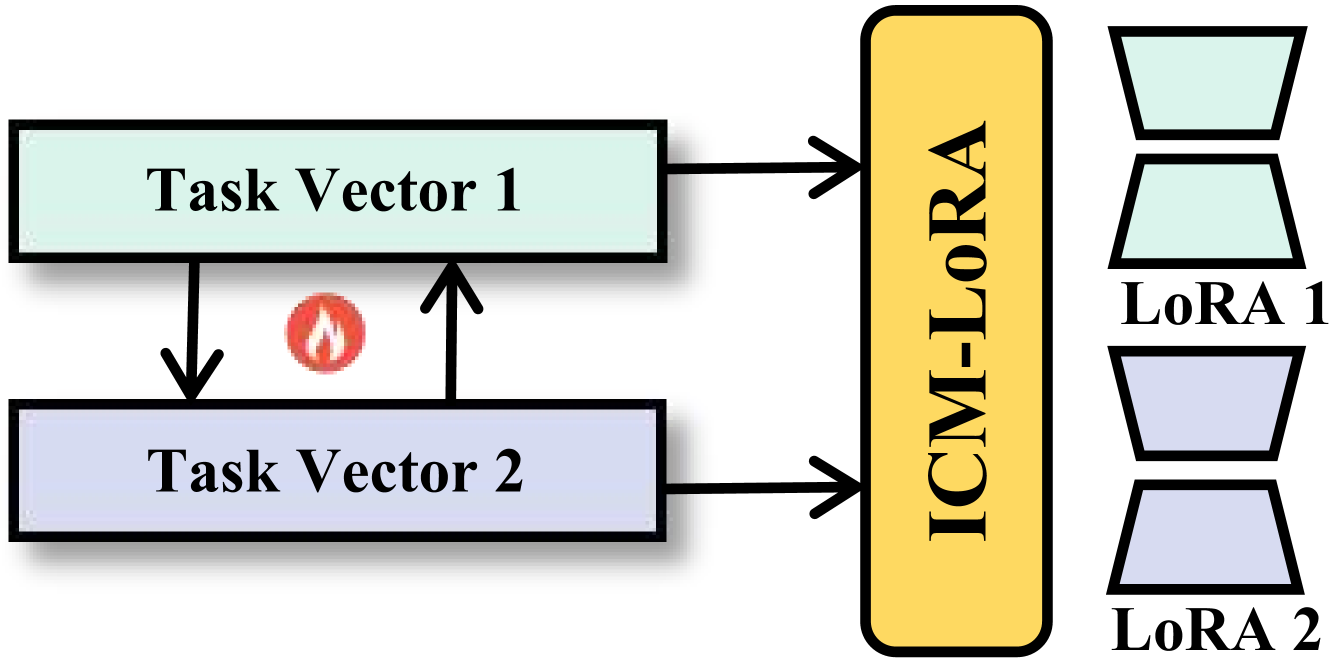

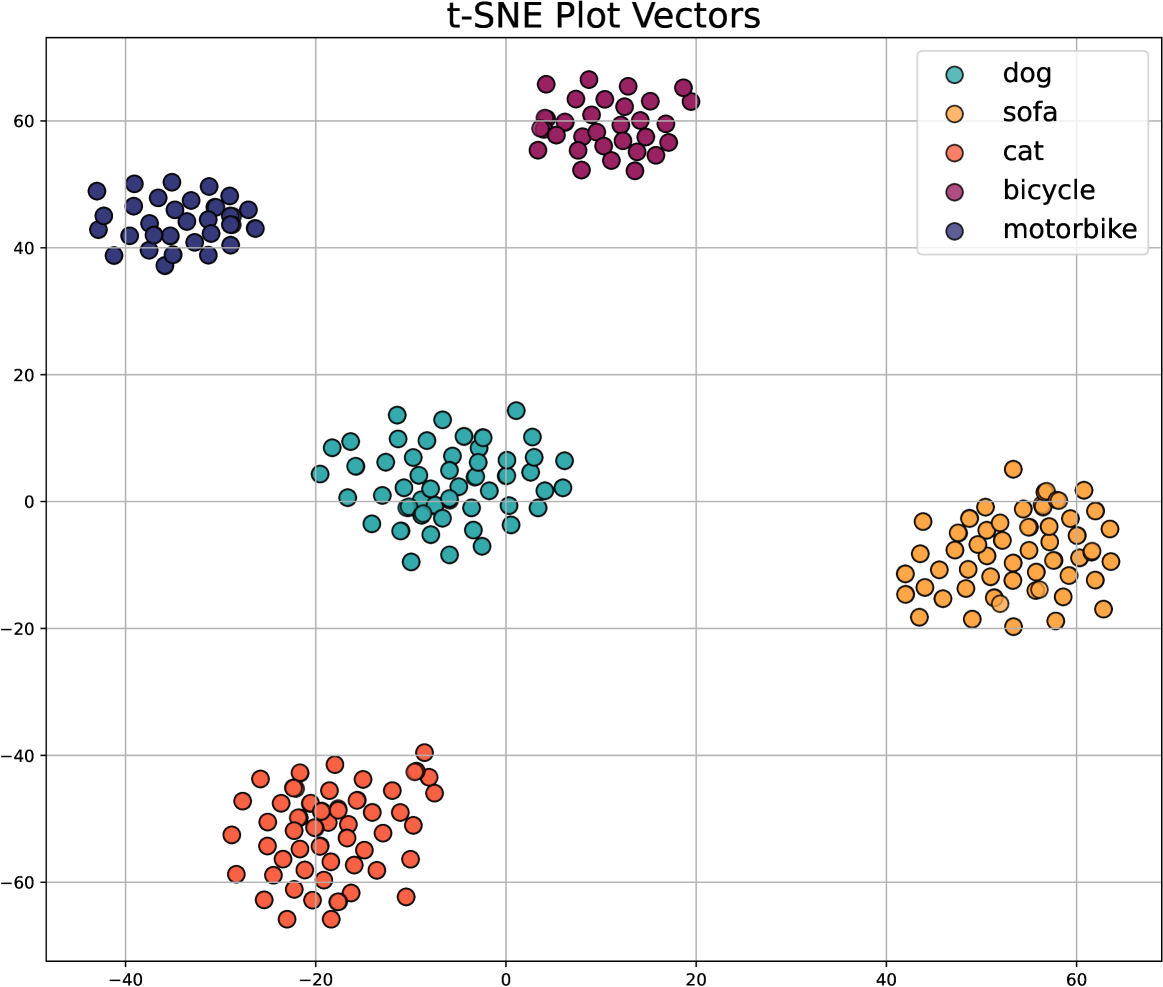

- ICM-LoRA利用条件变分自编码器(CVAE)生成任务相关的LoRA权重,并通过上下文元学习增强知识和任务映射。

- 实验表明,ICM-LoRA能更准确地重构LoRA参数,实现任务特定增强,且存储占用仅为原始LoRA的1%。

📝 摘要(中文)

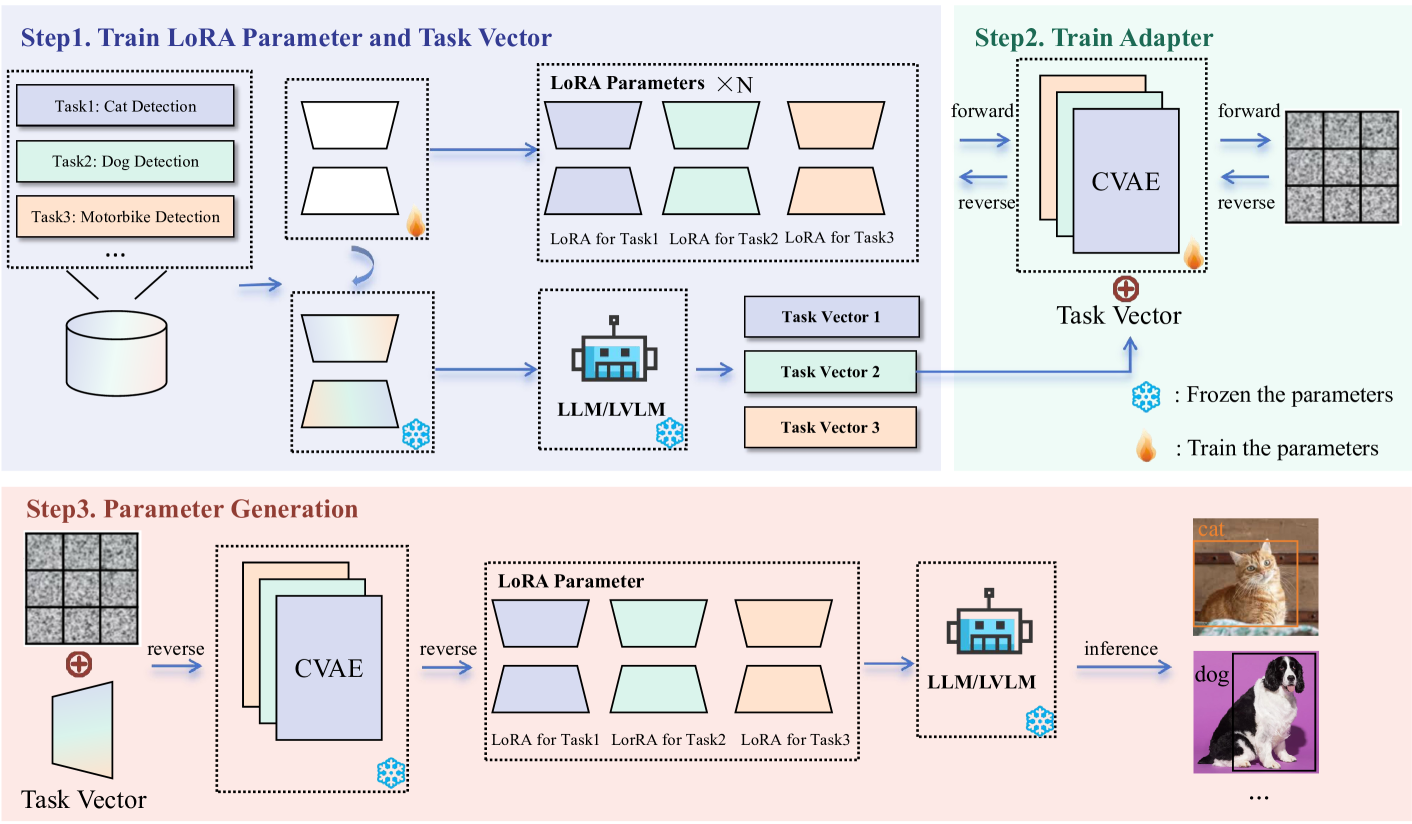

本文提出了一种名为In-Context Meta LoRA (ICM-LoRA) 的新方法,旨在高效地实现大语言模型(LLM)的任务特定定制。针对多任务场景下,为每个任务训练单独的LoRA模型导致存储和推理效率低下的问题,以及现有参数生成方法无法捕捉任务间相关性的挑战,ICM-LoRA利用所有任务的训练数据训练一个定制的生成器,即条件变分自编码器(CVAE)。CVAE以任务描述作为输入,生成任务相关的LoRA权重,这些权重与LLM合并,无需额外微调即可创建任务专用模型。此外,该方法利用上下文元学习进行知识增强和任务映射,以捕捉任务和参数分布之间的关系。实验结果表明,ICM-LoRA比现有的参数重构方法能够更准确地重构LoRA参数,并能有效地实现LoRA参数的任务特定增强。同时,该方法仅占用283MB的存储空间,仅为原始LoRA的1%。

🔬 方法详解

问题定义:论文旨在解决多任务场景下,为每个任务单独训练LoRA模型所带来的存储和推理效率问题。现有参数生成方法无法有效捕捉不同任务之间的相关性,导致生成的LoRA参数质量不高,无法充分利用任务间的共享信息。

核心思路:论文的核心思路是利用条件变分自编码器(CVAE)学习一个LoRA参数生成器,该生成器能够根据任务描述生成任务相关的LoRA权重。通过上下文元学习,CVAE可以学习到任务之间的关系,从而生成更准确的LoRA参数。这种方法避免了为每个任务单独训练LoRA模型,显著降低了存储需求。

技术框架:ICM-LoRA的整体框架包含以下几个主要模块:1) 任务描述编码器:将任务描述转换为向量表示。2) 条件变分自编码器(CVAE):以任务描述向量为条件,生成LoRA权重。CVAE包含编码器和解码器,编码器将任务描述映射到隐空间,解码器从隐空间重构LoRA权重。3) 上下文元学习模块:利用少量样本进行元学习,增强CVAE的知识和任务映射能力。4) LoRA合并模块:将生成的LoRA权重与预训练的LLM合并,得到任务特定的模型。

关键创新:该方法最重要的创新点在于结合了条件变分自编码器和上下文元学习,实现了任务相关的LoRA参数生成。与现有参数重构方法相比,ICM-LoRA能够更准确地捕捉任务之间的关系,生成更有效的LoRA参数。此外,该方法无需为每个任务单独训练LoRA模型,显著降低了存储需求。

关键设计:CVAE的编码器和解码器通常采用多层感知机(MLP)或Transformer结构。损失函数包括重构损失和KL散度损失,用于保证生成的LoRA权重的质量和多样性。上下文元学习模块采用Meta-LSTM或MAML等算法,利用少量样本进行快速适应。任务描述编码器可以使用预训练的文本编码器,如BERT或GPT。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ICM-LoRA在LoRA参数重构方面优于现有的参数重构方法,能够更准确地生成任务相关的LoRA权重。同时,ICM-LoRA仅占用283MB的存储空间,仅为原始LoRA的1%,显著降低了存储成本。这些结果表明,ICM-LoRA是一种高效且有效的任务特定大语言模型定制方法。

🎯 应用场景

ICM-LoRA在需要快速适应多个任务的大语言模型应用中具有广泛的应用前景,例如:智能客服、个性化推荐、多语言翻译等。该方法可以显著降低存储成本,提高推理效率,并能有效利用任务间的共享信息,提升模型性能。未来,该方法可以扩展到更多类型的参数生成任务,并应用于更广泛的领域。

📄 摘要(原文)

Low-rank Adaptation (LoRA) has demonstrated remarkable capabilities for task specific fine-tuning. However, in scenarios that involve multiple tasks, training a separate LoRA model for each one results in considerable inefficiency in terms of storage and inference. Moreover, existing parameter generation methods fail to capture the correlations among these tasks, making multi-task LoRA parameter generation challenging. To address these limitations, we propose In-Context Meta LoRA (ICM-LoRA), a novel approach that efficiently achieves task-specific customization of large language models (LLMs). Specifically, we use training data from all tasks to train a tailored generator, Conditional Variational Autoencoder (CVAE). CVAE takes task descriptions as inputs and produces task-aware LoRA weights as outputs. These LoRA weights are then merged with LLMs to create task-specialized models without the need for additional fine-tuning. Furthermore, we utilize in-context meta-learning for knowledge enhancement and task mapping, to capture the relationship between tasks and parameter distributions. As a result, our method achieves more accurate LoRA parameter generation for diverse tasks using CVAE. ICM-LoRA enables more accurate LoRA parameter reconstruction than current parameter reconstruction methods and is useful for implementing task-specific enhancements of LoRA parameters. At the same time, our method occupies 283MB, only 1\% storage compared with the original LoRA.