RAPID: Retrieval-Augmented Parallel Inference Drafting for Text-Based Video Event Retrieval

作者: Long Nguyen, Huy Nguyen, Bao Khuu, Huy Luu, Huy Le, Tuan Nguyen, Tho Quan

分类: cs.CL, cs.IR

发布日期: 2025-01-27

备注: Under review at SoICT'24

💡 一句话要点

RAPID:检索增强的并行推理草稿,用于基于文本的视频事件检索

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频事件检索 大型语言模型 查询增强 并行检索 上下文信息 提示学习 语义理解

📋 核心要点

- 现有视频事件检索方法过度依赖对象级描述,忽略上下文信息,导致查询不完整时性能下降。

- RAPID利用大型语言模型和提示学习,对用户查询进行语义纠正和上下文增强,提升检索效果。

- 实验表明,RAPID在自定义数据集上显著优于传统方法,并在实际竞赛中成功检索了大量视频事件。

📝 摘要(中文)

由于多媒体内容的快速增长,使用文本查询从视频中检索事件变得越来越具有挑战性。现有的基于文本的视频事件检索方法通常过于关注对象级别的描述,而忽略了上下文信息的关键作用。当查询缺乏足够的上下文时,例如缺少位置细节或模糊的背景元素,这种局限性尤其明显。为了解决这些挑战,我们提出了一种名为RAPID(检索增强的并行推理草稿)的新系统,该系统利用大型语言模型(LLM)的进步和基于提示的学习来语义纠正和丰富用户查询,使其包含相关的上下文信息。然后,这些丰富的查询通过并行检索进行处理,随后进行评估步骤,以根据其与原始查询的对齐程度选择最相关的结果。通过在我们自定义开发的数据集上进行的大量实验,我们证明RAPID明显优于传统的检索方法,尤其是在上下文不完整的查询方面。我们的系统在胡志明市人工智能挑战赛2024中的速度和准确性都得到了验证,它成功地从超过300小时的视频中检索了事件。进一步的评估将RAPID与比赛组织者提出的基线进行了比较,证明了其卓越的有效性,突出了我们方法的优势和稳健性。

🔬 方法详解

问题定义:现有的基于文本的视频事件检索方法,在处理上下文信息不足的查询时表现不佳。它们通常侧重于视频中的对象级描述,而忽略了场景、环境等上下文信息,导致检索结果与用户意图不符。这种问题在实际应用中非常常见,因为用户往往难以提供完整、精确的查询。

核心思路:RAPID的核心思路是利用大型语言模型(LLM)的强大语义理解和生成能力,对用户输入的查询进行上下文增强。通过检索与原始查询相关的知识,并将其融入到查询中,从而生成更全面、更具描述性的查询,进而提高检索的准确性。这种方法模拟了人类在理解模糊问题时,会主动补充相关信息的思维过程。

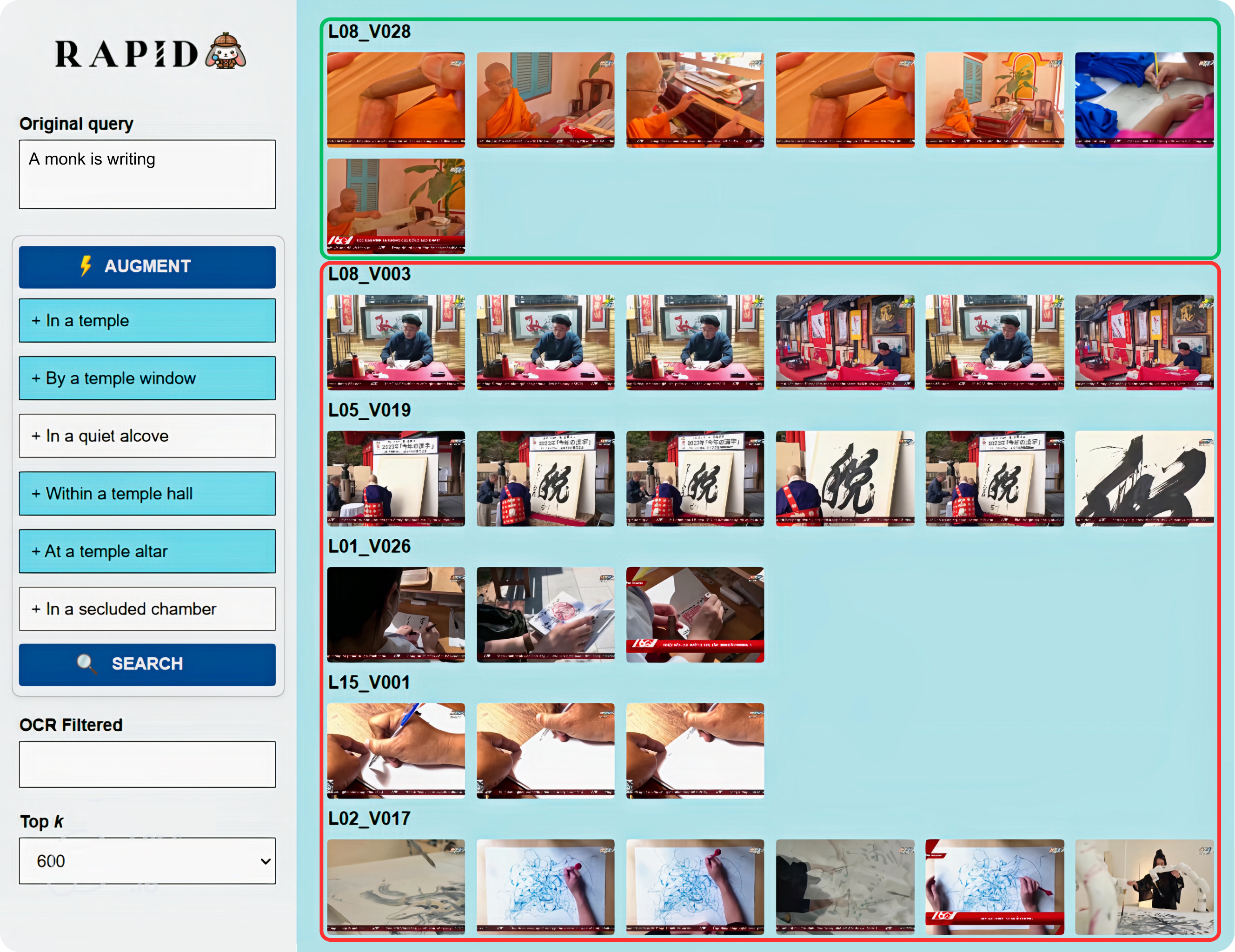

技术框架:RAPID系统主要包含以下几个模块:1) 查询增强模块:利用LLM和提示学习,根据原始查询检索相关上下文信息,并生成增强后的查询。2) 并行检索模块:使用多个检索器并行处理增强后的查询,每个检索器可能采用不同的索引结构或检索算法。3) 结果评估模块:对并行检索的结果进行排序和筛选,选择与原始查询最相关的视频片段。整体流程是从用户输入查询开始,经过查询增强、并行检索和结果评估,最终返回最相关的视频片段。

关键创新:RAPID的关键创新在于将大型语言模型应用于视频事件检索的查询增强阶段。与传统的基于关键词或对象匹配的方法不同,RAPID能够理解查询的语义,并根据上下文信息进行推理和补充,从而生成更准确的查询。此外,并行检索模块也提高了检索效率,能够快速处理大量视频数据。

关键设计:在查询增强模块中,使用了基于提示学习的方法,设计合适的提示语来引导LLM生成相关的上下文信息。例如,提示语可以包含“这个视频可能发生在什么地点?”、“这个事件可能与哪些人物相关?”等问题。在结果评估模块中,可以使用余弦相似度等指标来衡量检索结果与原始查询的语义相关性。具体的LLM选择、提示语设计和相似度计算方法需要根据实际应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

RAPID在自定义数据集上进行了广泛的实验,结果表明其性能显著优于传统的检索方法,尤其是在处理上下文不完整的查询时。在胡志明市人工智能挑战赛2024中,RAPID成功地从超过300小时的视频中检索了事件,并超越了比赛组织者提供的基线系统,验证了其在实际应用中的有效性和鲁棒性。

🎯 应用场景

RAPID可应用于智能安防、视频监控、新闻事件检索、教育视频搜索等领域。通过提升视频事件检索的准确性和效率,可以帮助用户快速找到所需信息,提高工作效率和生活质量。未来,该技术有望与智能助手、自动驾驶等领域结合,实现更智能化的视频内容理解和应用。

📄 摘要(原文)

Retrieving events from videos using text queries has become increasingly challenging due to the rapid growth of multimedia content. Existing methods for text-based video event retrieval often focus heavily on object-level descriptions, overlooking the crucial role of contextual information. This limitation is especially apparent when queries lack sufficient context, such as missing location details or ambiguous background elements. To address these challenges, we propose a novel system called RAPID (Retrieval-Augmented Parallel Inference Drafting), which leverages advancements in Large Language Models (LLMs) and prompt-based learning to semantically correct and enrich user queries with relevant contextual information. These enriched queries are then processed through parallel retrieval, followed by an evaluation step to select the most relevant results based on their alignment with the original query. Through extensive experiments on our custom-developed dataset, we demonstrate that RAPID significantly outperforms traditional retrieval methods, particularly for contextually incomplete queries. Our system was validated for both speed and accuracy through participation in the Ho Chi Minh City AI Challenge 2024, where it successfully retrieved events from over 300 hours of video. Further evaluation comparing RAPID with the baseline proposed by the competition organizers demonstrated its superior effectiveness, highlighting the strength and robustness of our approach.