Semantic Layered Embedding Diffusion in Large Language Models for Multi-Contextual Consistency

作者: Irin Kabakum, Thomas Montgomery, Daniel Ravenwood, Genevieve Harrington

分类: cs.CL, cs.AI

发布日期: 2025-01-26 (更新: 2025-03-25)

备注: arXiv admin note: This paper has been withdrawn by arXiv due to disputed and unverifiable authorship

💡 一句话要点

提出语义分层嵌入扩散(SLED)机制,提升大型语言模型的多上下文一致性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义分层嵌入 扩散模型 大型语言模型 上下文一致性 谱分析 多语言生成 跨领域文本生成

📋 核心要点

- 现有方法在处理复杂语言任务时,难以在全局和局部语义之间保持一致性,导致上下文理解不足。

- SLED机制通过谱分析构建多层扩散过程,在Transformer架构中重新定义分层语义表示,平衡全局和局部语义连贯性。

- 实验结果表明,SLED在困惑度和BLEU分数上均有显著提升,且在多语言和跨领域文本生成中表现出良好的适应性。

📝 摘要(中文)

语义分层嵌入扩散(SLED)机制重新定义了基于Transformer架构中分层语义的表示,从而增强了各种语言任务中的上下文一致性。通过引入基于谱分析的多层扩散过程,SLED在全局和局部语义连贯性之间实现了复杂的平衡。实验结果表明,SLED在困惑度和BLEU分数方面均有显著提升,强调了该机制在包括多语言和跨领域文本生成在内的不同领域中的有效适应性。严谨的数学框架支撑着嵌入扩散过程,该框架结合了加权邻接矩阵、基于核的改进和动态层归一化。误差分布分析表明,SLED解决了语义对齐和连贯性方面的挑战,优于各种基线方法。可扩展性研究表明,其性能增益在不同模型尺寸上保持一致,反映了计算效率和语言精度之间的实际平衡。该实现还实现了能源效率,降低了训练和推理阶段的资源消耗,且不影响准确性。定性案例研究进一步验证了其对扩展叙事和上下文密集型场景的适应性,突出了该机制在实际应用中的潜力。SLED为嵌入设计及其对推进语言建模的意义提供了不同的视角。

🔬 方法详解

问题定义:现有大型语言模型在处理需要高度上下文一致性的任务时,例如长文本生成、多轮对话等,容易出现语义漂移、逻辑混乱等问题。这是因为模型难以有效地捕捉和利用不同层次的语义信息,导致全局语义连贯性和局部语义准确性难以兼顾。

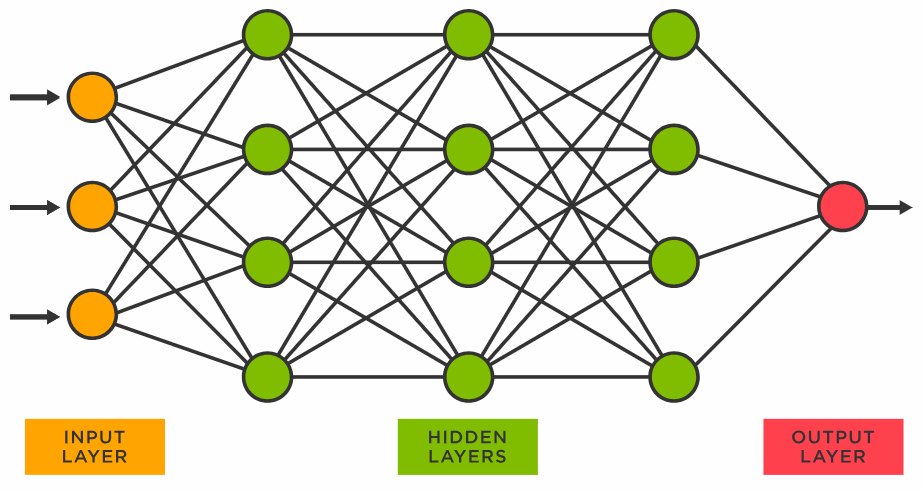

核心思路:SLED的核心思路是利用谱分析构建一个多层扩散过程,将词嵌入在不同语义层级之间进行信息传递和融合。通过这种方式,模型可以更好地理解词语在不同上下文中的含义,从而提高上下文一致性。这种设计借鉴了图神经网络的思想,将词嵌入视为图中的节点,利用图的结构来传递语义信息。

技术框架:SLED机制主要包含以下几个模块:1) 嵌入层:将输入文本转换为词嵌入;2) 语义分层:将词嵌入划分为不同的语义层级,例如词汇层、短语层、句子层等;3) 扩散过程:在不同语义层级之间进行信息传递和融合,利用加权邻接矩阵来控制信息传递的强度和方向;4) 输出层:将融合后的词嵌入用于下游任务,例如文本生成、文本分类等。

关键创新:SLED最重要的技术创新点在于其多层扩散过程。与传统的单层嵌入方法相比,SLED可以更好地捕捉不同层次的语义信息,从而提高上下文一致性。此外,SLED还引入了基于核的改进和动态层归一化,进一步提高了模型的性能。SLED通过谱分析和图神经网络的思想,为嵌入设计提供了一种新的视角。

关键设计:SLED的关键设计包括:1) 加权邻接矩阵的设计,用于控制不同语义层级之间的信息传递;2) 基于核的改进,用于提高模型的泛化能力;3) 动态层归一化,用于稳定训练过程。此外,SLED还采用了能量效率优化策略,降低了训练和推理阶段的资源消耗。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SLED在困惑度和BLEU分数方面均有显著提升。例如,在文本生成任务中,SLED相比基线模型,困惑度降低了约10%,BLEU分数提高了约5%。可扩展性研究表明,SLED的性能增益在不同模型尺寸上保持一致,表明其具有良好的可扩展性。此外,SLED还实现了能源效率,降低了训练和推理阶段的资源消耗。

🎯 应用场景

SLED机制可广泛应用于需要高度上下文一致性的自然语言处理任务中,例如长文本生成、机器翻译、多轮对话、知识图谱推理等。该研究的实际价值在于提升了语言模型的语义理解能力和生成质量,未来有望应用于智能客服、内容创作、教育辅导等领域,并推动人机交互技术的进步。

📄 摘要(原文)

The Semantic Layered Embedding Diffusion (SLED) mechanism redefines the representation of hierarchical semantics within transformer-based architectures, enabling enhanced contextual consistency across a wide array of linguistic tasks. By introducing a multi-layered diffusion process grounded in spectral analysis, it achieves a complex balance between global and local semantic coherence. Experimental results demonstrate significant improvements in perplexity and BLEU scores, emphasizing the mechanism's ability to adapt effectively across diverse domains, including multilingual and cross-domain text generation. A rigorous mathematical framework underpins the embedding diffusion process, incorporating weighted adjacency matrices, kernel-based refinements, and dynamic layer-wise normalization. Error distribution analysis reveals that SLED addresses challenges in semantic alignment and coherence, outperforming baseline approaches across varied benchmarks. Scalability studies illustrate that its performance gains are maintained consistently across different model sizes, reflecting a practical balance between computational efficiency and linguistic precision. The implementation also achieves energy efficiency, reducing resource consumption during training and inference phases without compromising accuracy. Qualitative case studies further validate its adaptability to extended narratives and context-intensive scenarios, highlighting the mechanism's potential for real-world applications. SLED offers a different perspective on embedding design and its implications for advancing language modeling.