Large Language Models as Theory of Mind Aware Generative Agents with Counterfactual Reflection

作者: Bo Yang, Jiaxian Guo, Yusuke Iwasawa, Yutaka Matsuo

分类: cs.CL, cs.AI

发布日期: 2025-01-26

💡 一句话要点

提出ToM-agent,赋予LLM生成式Agent在开放域对话中模拟心智理论的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心智理论 大型语言模型 生成式Agent 开放域对话 反事实推理

📋 核心要点

- 现有生成式Agent难以准确模拟对话参与者的心理状态,尤其是在开放域对话中。

- ToM-agent通过分离置信度与心理状态,并结合对话历史和反思,动态调整对对方心理状态的推断。

- 实验表明,ToM-agent在移情和说服对话中表现出色,能更好地理解对方行为的深层原因。

📝 摘要(中文)

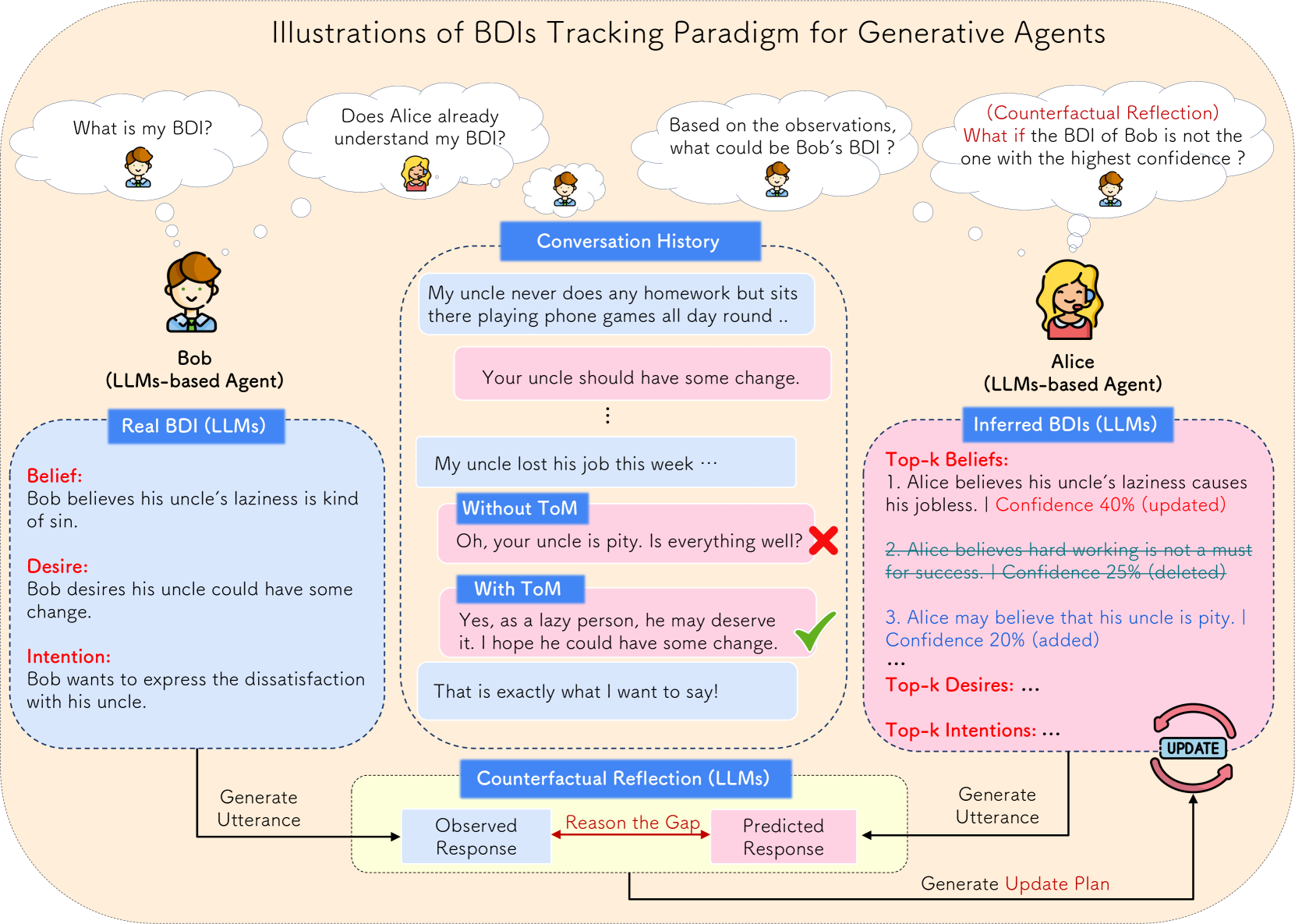

本文提出了一种名为ToM-agent的新范式,旨在增强基于大型语言模型(LLM)的生成式Agent在开放域对话交互中模拟心智理论(ToM)的能力。ToM-agent将置信度与心理状态分离,从而能够模拟Agent对其对应方心理状态(如信念、欲望和意图(BDIs))的感知。通过利用过去的对话历史和口头反思,ToM-Agent可以动态调整对方推断的BDIs以及相关的置信度。此外,本文还提出了一种反事实干预方法,通过反思对方的预测反应与其真实话语之间的差距,从而提高反思的效率。通过移情和说服对话数据集,评估了在下游任务中实施ToM-agent的优势,以及它在第一阶和第二阶ToM中的表现。研究结果表明,ToM-agent能够掌握对方行为的潜在原因,而不仅仅是基于常识的语义情感支持或决策,为研究基于大规模LLM的人类社会行为模拟提供了新的见解。

🔬 方法详解

问题定义:现有基于LLM的生成式Agent在开放域对话中,难以准确捕捉和模拟对话参与者的心理状态,例如信念、欲望和意图(BDIs)。这导致Agent无法进行深层次的理解和推理,从而影响对话的质量和效果。现有方法通常依赖于常识或简单的语义情感分析,缺乏对对方心理状态的动态建模和调整能力。

核心思路:ToM-agent的核心思路是将心智理论(ToM)融入到生成式Agent中,使其能够像人类一样,推断和理解对方的心理状态。通过显式地建模对方的BDIs,并根据对话历史和反思动态调整这些状态,ToM-agent能够更准确地预测对方的行为,并做出更合理的反应。关键在于将置信度与心理状态分离,使得Agent可以对自己的推断进行评估和修正。

技术框架:ToM-agent的整体框架包括以下几个主要模块:1) 对话历史编码器:用于编码过去的对话历史,提取相关信息。2) BDI推断模块:根据对话历史,推断对方的信念、欲望和意图,并赋予相应的置信度。3) 反思模块:通过比较预测的反应和实际的反应,反思推断的准确性,并调整BDIs和置信度。4) 响应生成模块:根据推断的BDIs和对话历史,生成合适的响应。

关键创新:ToM-agent最重要的创新点在于其显式地建模和动态调整对方的心理状态。与以往的方法相比,ToM-agent不仅仅依赖于常识或简单的语义情感分析,而是通过心智理论来理解对方的行为。此外,反事实干预方法能够有效地提高反思的效率,使得Agent能够更快地学习和适应。

关键设计:在BDI推断模块中,可以使用预训练的语言模型(如GPT-3)作为基础模型,并在此基础上进行微调,以提高推断的准确性。反思模块可以使用强化学习或监督学习的方法进行训练,目标是最小化预测反应和实际反应之间的差距。反事实干预方法可以通过生成不同的假设情境,并比较在不同情境下的反应,来评估BDIs的合理性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ToM-agent在移情和说服对话数据集上取得了显著的性能提升。具体来说,ToM-agent在第一阶和第二阶ToM任务中均优于基线模型,能够更准确地预测对方的行为和意图。此外,反事实干预方法能够有效地提高反思的效率,使得Agent能够更快地学习和适应。

🎯 应用场景

ToM-agent具有广泛的应用前景,例如在智能客服、虚拟助手、心理咨询等领域。通过模拟人类的心智理论,ToM-agent可以更好地理解用户的需求和情感,从而提供更个性化和有效的服务。此外,ToM-agent还可以用于研究人类的社会行为,例如合作、竞争和欺骗等。

📄 摘要(原文)

Recent studies have increasingly demonstrated that large language models (LLMs) possess significant theory of mind (ToM) capabilities, showing the potential for simulating the tracking of mental states in generative agents. In this study, we propose a novel paradigm called ToM-agent, designed to empower LLMs-based generative agents to simulate ToM in open-domain conversational interactions. ToM-agent disentangles the confidence from mental states, facilitating the emulation of an agent's perception of its counterpart's mental states, such as beliefs, desires, and intentions (BDIs). Using past conversation history and verbal reflections, ToM-Agent can dynamically adjust counterparts' inferred BDIs, along with related confidence levels. We further put forth a counterfactual intervention method that reflects on the gap between the predicted responses of counterparts and their real utterances, thereby enhancing the efficiency of reflection. Leveraging empathetic and persuasion dialogue datasets, we assess the advantages of implementing the ToM-agent with downstream tasks, as well as its performance in both the first-order and the \textit{second-order} ToM. Our findings indicate that the ToM-agent can grasp the underlying reasons for their counterpart's behaviors beyond mere semantic-emotional supporting or decision-making based on common sense, providing new insights for studying large-scale LLMs-based simulation of human social behaviors.