MDEval: Evaluating and Enhancing Markdown Awareness in Large Language Models

作者: Zhongpu Chen, Yinfeng Liu, Long Shi, Xingyan Chen, Yu Zhao, Fuji Ren

分类: cs.CL, cs.IR

发布日期: 2025-01-25 (更新: 2025-08-27)

备注: WWW 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出MDEval以评估和提升大型语言模型的Markdown意识

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 Markdown意识 可读性评估 数据集构建 模型微调 统计分析 开源工具

📋 核心要点

- 现有评估指标未能有效评估大型语言模型生成内容的可读性,尤其是Markdown结构方面的表现。

- 本文提出MDEval基准,通过构建多语言数据集,评估和提升大型语言模型的Markdown意识,增强可读性。

- 实验结果表明,MDEval的Spearman相关性为0.791,准确率达到84.1%,并且开源模型经过微调后可与GPT-4o相媲美。

📝 摘要(中文)

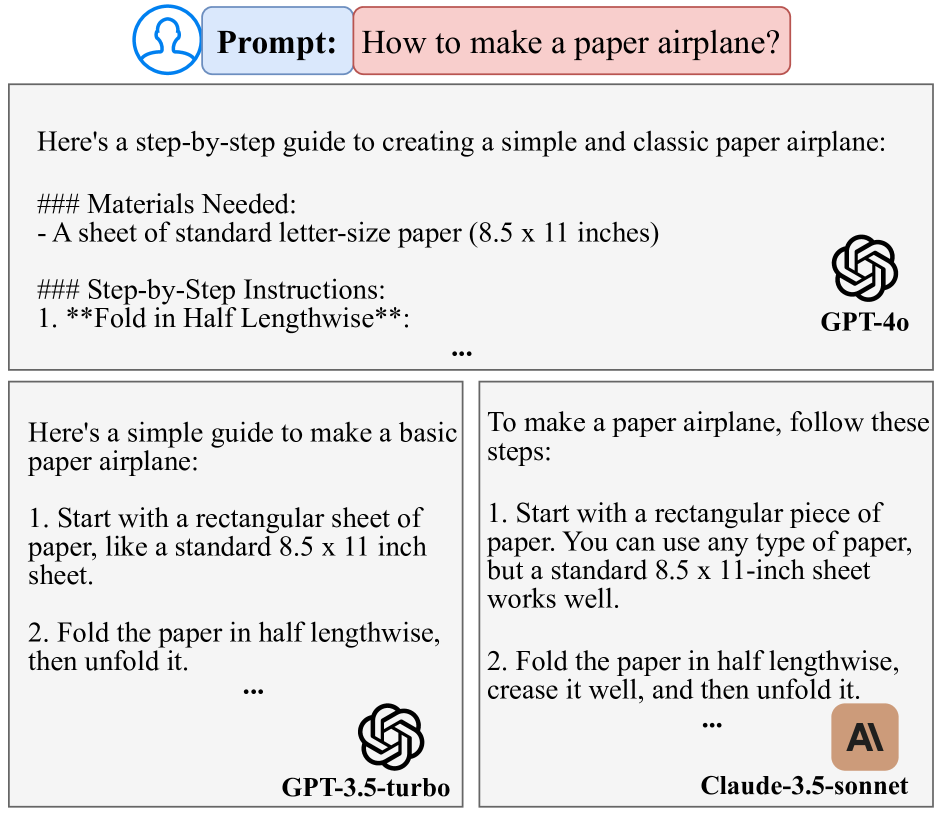

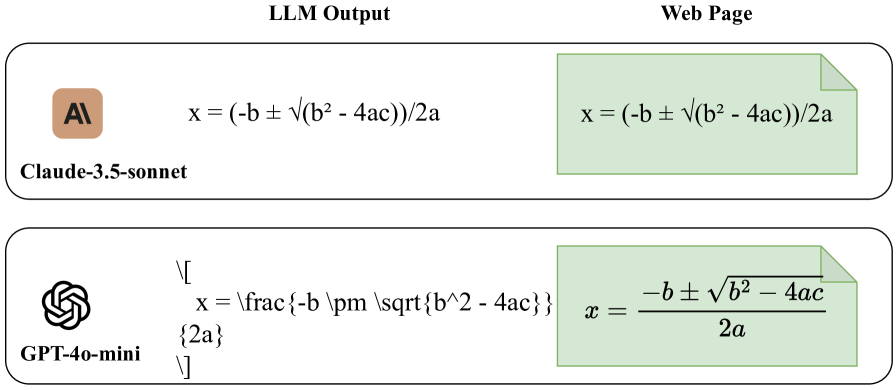

大型语言模型(LLMs)在网络聊天机器人中被期望提供结构化的Markdown响应,以提高可读性。然而,现有的评估指标未能从输出内容结构的角度评估可读性。为此,本文关注一个被忽视但重要的指标——Markdown意识,直接影响这些语言模型生成内容的可读性和结构。我们提出了MDEval,一个全面的基准,评估LLMs的Markdown意识,构建了一个包含20K实例的多语言数据集。MDEval通过结合模型生成任务和统计方法,提供了优异的可解释性。实验结果显示,MDEval与人类的Spearman相关性为0.791,准确率为84.1%,显著优于现有方法。通过在我们提出的数据集上进行微调,性能较差的开源模型能够在Markdown意识方面达到与GPT-4o相当的表现。为确保可重复性和透明性,MDEval已开源。

🔬 方法详解

问题定义:本文旨在解决现有评估指标无法有效评估大型语言模型在Markdown结构方面的表现这一问题。现有方法未能关注内容的可读性和结构,导致评估结果不够全面。

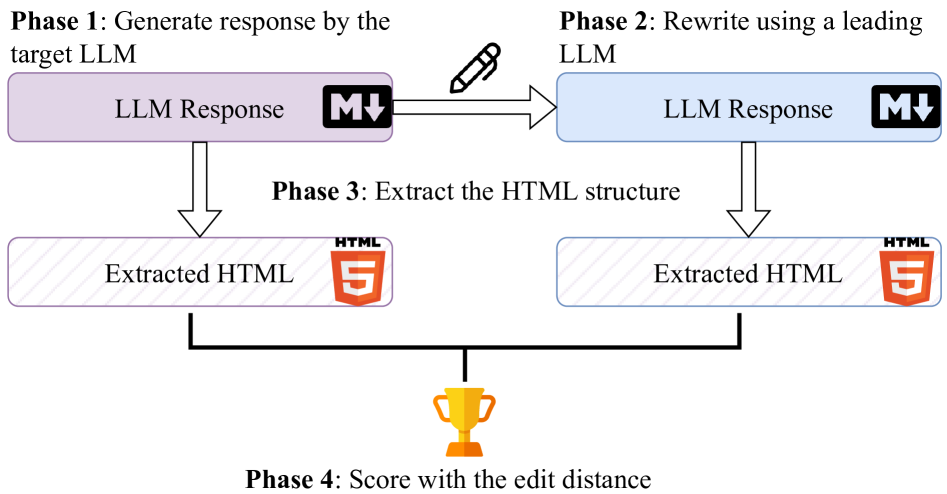

核心思路:论文提出MDEval基准,专注于Markdown意识这一重要指标,通过构建包含多种主题的多语言数据集,提供更具可解释性的评估方法。

技术框架:MDEval的整体架构包括数据集构建、模型生成任务和统计分析三个主要模块。数据集包含20K实例,涵盖英语和中文的多个主题,通过模型生成任务评估Markdown意识,并结合统计方法进行分析。

关键创新:MDEval的核心创新在于其对Markdown意识的专注,结合了模型生成和统计评估,提供了比传统方法更高的可解释性和准确性。

关键设计:在数据集构建中,选择了多样化的主题和实例,确保评估的全面性。损失函数和评估指标设计上,采用Spearman相关性和准确率作为主要评估标准,以确保结果的可靠性。

🖼️ 关键图片

📊 实验亮点

MDEval的实验结果显示,其与人类评估的Spearman相关性达到0.791,准确率为84.1%,显著优于现有评估方法。此外,经过微调的开源模型在Markdown意识方面的表现与GPT-4o相当,展示了MDEval的有效性和实用性。

🎯 应用场景

该研究的潜在应用领域包括智能客服、在线教育和内容生成等场景。通过提升大型语言模型的Markdown意识,可以显著改善用户体验,提高信息传递的清晰度和可读性,未来可能推动更高效的交互式应用发展。

📄 摘要(原文)

Large language models (LLMs) are expected to offer structured Markdown responses for the sake of readability in web chatbots (e.g., ChatGPT). Although there are a myriad of metrics to evaluate LLMs, they fail to evaluate the readability from the view of output content structure. To this end, we focus on an overlooked yet important metric -- Markdown Awareness, which directly impacts the readability and structure of the content generated by these language models. In this paper, we introduce MDEval, a comprehensive benchmark to assess Markdown Awareness for LLMs, by constructing a dataset with 20K instances covering 10 subjects in English and Chinese. Unlike traditional model-based evaluations, MDEval provides excellent interpretability by combining model-based generation tasks and statistical methods. Our results demonstrate that MDEval achieves a Spearman correlation of 0.791 and an accuracy of 84.1% with human, outperforming existing methods by a large margin. Extensive experimental results also show that through fine-tuning over our proposed dataset, less performant open-source models are able to achieve comparable performance to GPT-4o in terms of Markdown Awareness. To ensure reproducibility and transparency, MDEval is open sourced at https://github.com/SWUFE-DB-Group/MDEval-Benchmark.