Self-reflecting Large Language Models: A Hegelian Dialectical Approach

作者: Sara Abdali, Can Goksen, Michael Solodko, Saeed Amizadeh, Julie E. Maybee, Kazuhito Koishida

分类: cs.CL, cs.HC, cs.LG

发布日期: 2025-01-24 (更新: 2025-06-23)

💡 一句话要点

提出基于黑格尔辩证法的自反思LLM,提升科学创意生成与推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自反思 黑格尔辩证法 科学创意生成 多智能体系统

📋 核心要点

- 现有LLM在复杂推理和创新性问题解决方面存在局限,缺乏有效的自我批判和迭代机制。

- 论文提出黑格尔辩证法驱动的自反思框架,通过正反合三阶段迭代,促进LLM生成新颖科学思想。

- 实验表明,该方法在创意生成和数理推理方面均有提升,验证了哲学框架在LLM中的有效性。

📝 摘要(中文)

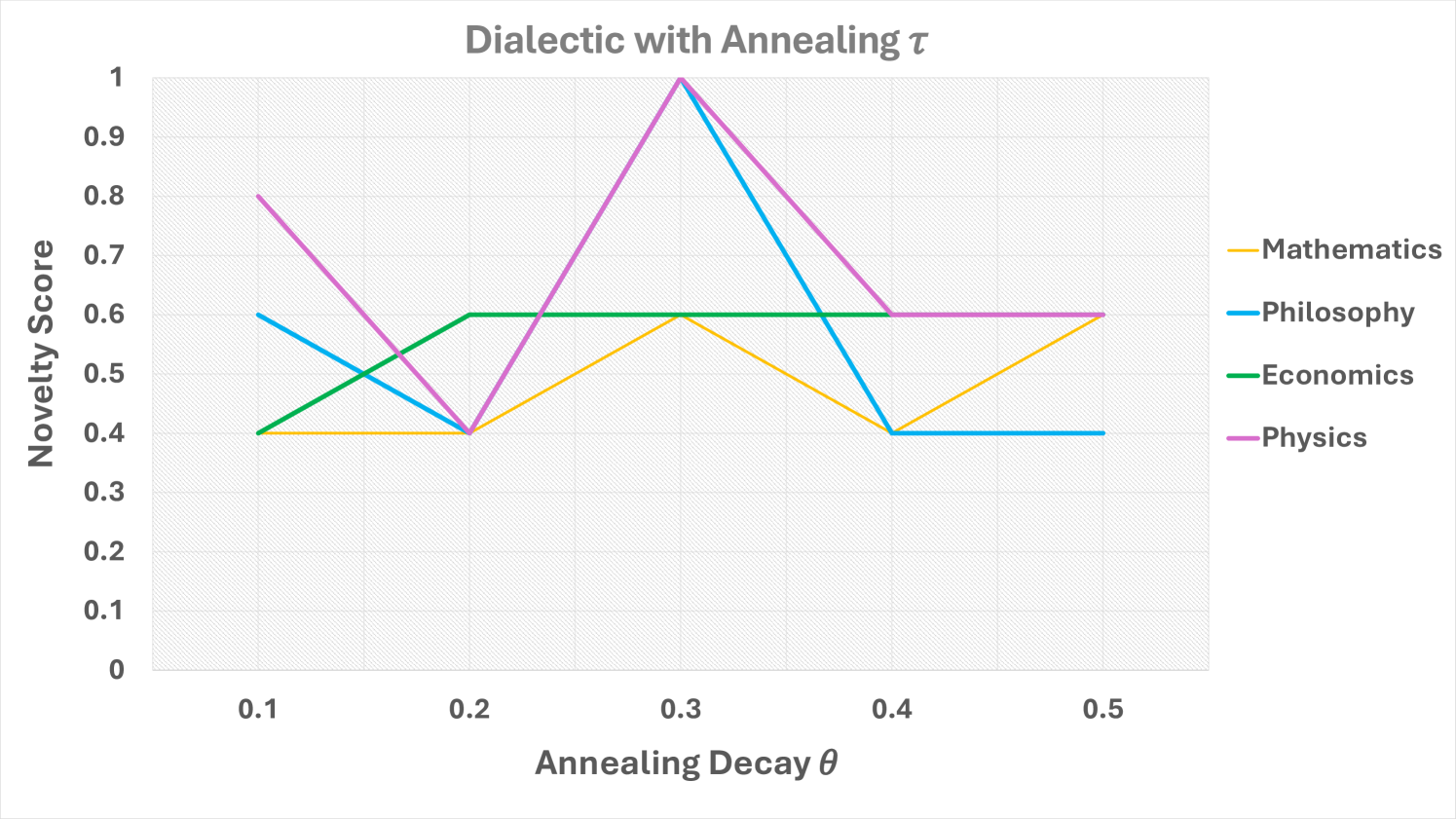

本文提出了一种受黑格尔辩证法启发的哲学框架,用于赋能大型语言模型(LLM)的自反思能力。该框架利用自辩证方法模拟内部批判,并综合产生新的科学思想,涵盖数学、物理等领域。此外,本文还探讨了生成温度对LLM的影响,引入了一种动态退火方法,鼓励早期阶段的创造性,并逐步专注于细化和细微差别,以及一种恒温策略。为了评估生成思想的有效性和新颖性,本文还实现了一种多智能体多数投票(MAMV)策略,这在缺乏领域专家的情况下非常有用。实验结果表明,该方法在创意生成方面表现出良好的效果,并在数学和符号推理方面取得了显著的改进。

🔬 方法详解

问题定义:现有的大型语言模型在生成创新性科学想法和进行复杂推理时面临挑战。它们往往缺乏自我批判和迭代改进的能力,难以产生真正新颖且有价值的见解。现有的方法通常依赖于大量的数据训练,而忽略了模型内部的反思和辩证过程。

核心思路:本文的核心思路是借鉴黑格尔辩证法的“正题-反题-合题”过程,让LLM能够进行自我反思和批判,从而产生更具创新性的想法。通过模拟内部辩论,模型可以识别自身观点的局限性,并在此基础上进行改进和综合。

技术框架:该方法主要包含三个阶段:正题(Thesis)生成初始想法,反题(Antithesis)对初始想法进行批判性评估,合题(Synthesis)综合正题和反题的优点,生成新的、改进的想法。整个过程通过LLM的多次迭代完成。此外,还引入了动态退火温度策略,在初期鼓励探索性生成,后期则注重精细化。

关键创新:该方法最重要的创新点在于将黑格尔辩证法的哲学思想引入到LLM的设计中,使其具备了自我反思和迭代改进的能力。与传统的LLM训练方法相比,该方法更加注重模型内部的推理和辩论过程,从而能够产生更具创新性的想法。

关键设计:动态退火温度策略:在生成初期设置较高的温度,鼓励模型探索更多的可能性;随着迭代的进行,逐渐降低温度,使模型更加专注于细化和完善已有的想法。多智能体多数投票(MAMV):使用多个LLM作为智能体,对生成的想法进行投票,以评估其有效性和新颖性。这种方法可以在缺乏领域专家的情况下,提供一种相对客观的评估标准。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在创意生成方面表现出良好的效果,并在数学和符号推理方面取得了显著的改进。与基线模型相比,该方法生成的想法更具新颖性和有效性。多智能体多数投票(MAMV)策略在评估生成思想的有效性和新颖性方面表现出良好的性能。

🎯 应用场景

该研究成果可应用于科学发现、技术创新、问题解决等领域。通过赋予LLM自反思能力,可以辅助科学家和工程师进行更高效的创新性工作,例如新材料设计、药物研发、算法优化等。未来,该方法有望成为AI驱动科学研究的重要工具。

📄 摘要(原文)

Investigating NLP through a philosophical lens has recently caught researchers' eyes, as it bridges computational methods with classical schools of philosophy. This paper introduces a philosophical framework inspired by the Hegelian Dialectic to enable LLMs' self-reflection, utilizing a self-dialectical approach to emulate internal critiques and synthesize new scientific ideas (spanning domains such as mathematics, physics, and more). Additionally, we explore the effect of generation temperature in LLMs by introducing a dynamic annealing approach, which encourages creativity in the early stages and gradually focuses on refinement and nuance, as well as a constant-temperature strategy. Furthermore, we implement a Multi-Agent Majority Voting (MAMV) strategy to assess the validity and novelty of the generated ideas, which proves useful in the absence of domain experts. We also evaluate the effectiveness of our method in generating novel scientific ideas and improving LLMs' reasoning capabilities. Our experiments demonstrate promising results in ideation, along with significant improvements in mathematical and symbolic reasoning.