Investigating the (De)Composition Capabilities of Large Language Models in Natural-to-Formal Language Conversion

作者: Ziyao Xu, Houfeng Wang

分类: cs.CL

发布日期: 2025-01-24 (更新: 2025-02-21)

备注: Accepted at NAACL 2025 main conference

💡 一句话要点

提出DEDC框架,用于评估大语言模型在自然语言到形式语言转换中的分解与组合能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自然语言处理 形式语言转换 大语言模型 分解能力 组合能力 DEDC框架 模型评估 语义理解

📋 核心要点

- 现有自然语言到形式语言转换方法在处理不熟悉的形式语言和复杂组合时面临挑战。

- DEDC框架通过半自动化的样本和任务构建,解耦评估LLM的分解和组合能力。

- 实验表明,LLM在分解和组合方面存在不足,且易受组合间隙和反直觉符号的影响。

📝 摘要(中文)

为了实现通用且鲁棒的自然语言到形式语言转换(N2F),大语言模型(LLM)需要具备强大的分解和组合能力,以应对不熟悉的形式语言、组合间隙和违反直觉的符号名称。为了研究LLM是否具备这些N2F的基本能力,我们提出了DEDC框架。该框架半自动地执行样本和任务构建,从而能够解耦评估LLM在N2F中的分解和组合能力。基于此框架,我们评估和分析了最先进的LLM,主要发现包括:(1)LLM在分解和组合方面都存在不足;(2)LLM表现出广泛的错误类型,这些错误可归因于自然语言理解以及符号系统的学习和使用方面的缺陷;(3)组合间隙和违反直觉的符号名称都会影响LLM的分解和组合。我们的工作为研究LLM在N2F中的分解和组合基本能力提供了一个新的视角。对缺陷和归因的详细分析可以帮助后续改进LLM。

🔬 方法详解

问题定义:论文旨在解决大语言模型在自然语言到形式语言转换(N2F)任务中,分解和组合能力不足的问题。现有方法难以应对不熟悉的形式语言、组合间隙以及反直觉的符号名称,导致泛化性和鲁棒性较差。

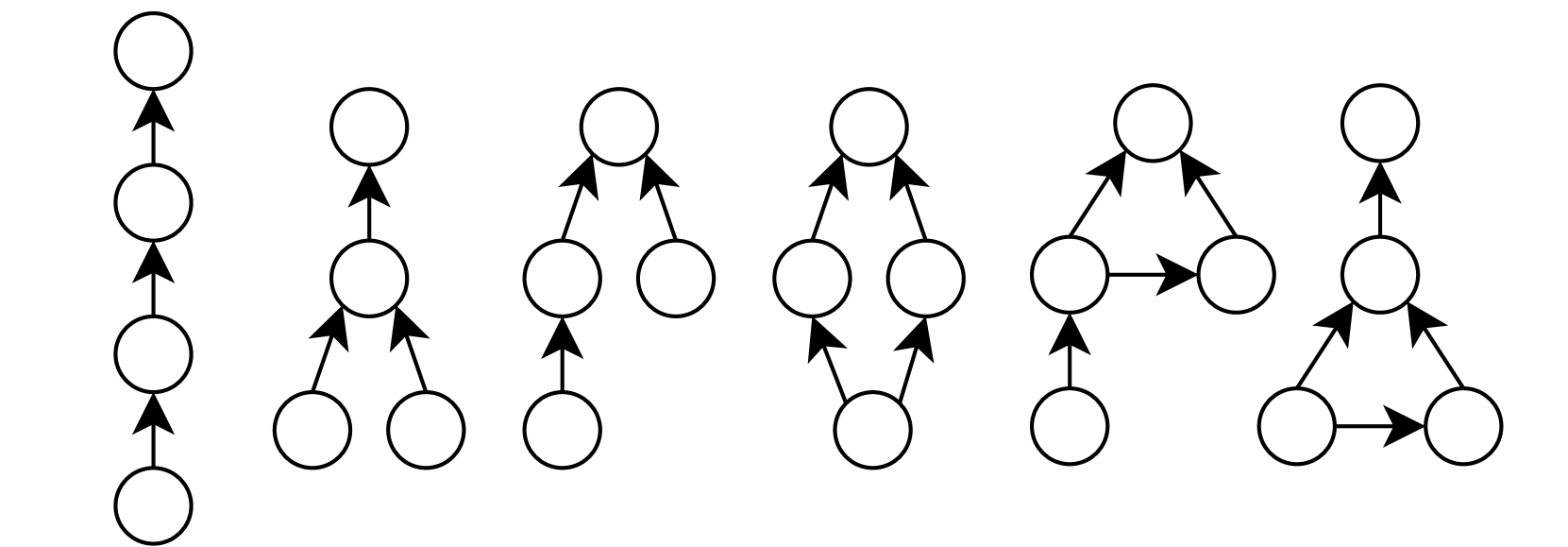

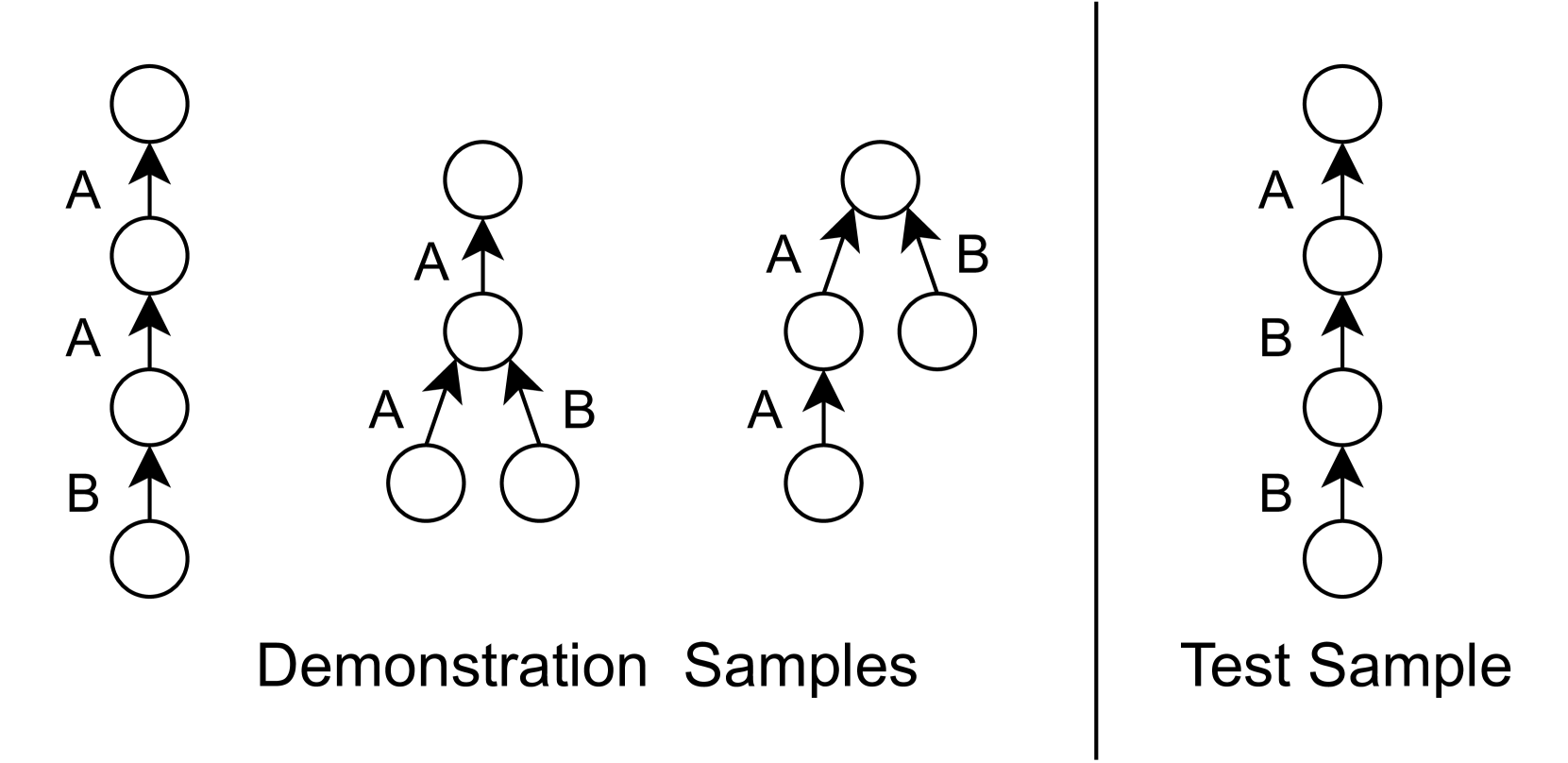

核心思路:论文的核心思路是设计一个名为DEDC的框架,该框架能够解耦地评估LLM在N2F任务中的分解和组合能力。通过半自动化的样本和任务构建,DEDC框架可以独立地测试LLM在分解复杂问题和组合简单组件方面的表现。这样可以更清晰地诊断LLM的缺陷所在,并为后续改进提供指导。

技术框架:DEDC框架包含以下主要模块:1) 任务定义模块:定义需要评估的N2F任务,包括形式语言的语法和语义。2) 样本生成模块:半自动地生成用于评估分解和组合能力的样本,包括正例和负例。3) 模型评估模块:使用生成的样本评估LLM在分解和组合方面的表现,并记录错误类型。4) 结果分析模块:分析评估结果,识别LLM的缺陷和潜在原因。

关键创新:DEDC框架的关键创新在于其解耦评估分解和组合能力的设计。传统的N2F评估方法通常将分解和组合混在一起,难以区分LLM在这两个方面的表现。DEDC框架通过精心设计的样本和任务,可以独立地评估LLM的分解和组合能力,从而更准确地诊断LLM的缺陷。

关键设计:DEDC框架的关键设计包括:1) 使用形式语法定义形式语言,确保任务的清晰性和可控性。2) 设计包含组合间隙和反直觉符号名称的样本,以测试LLM的鲁棒性。3) 定义多种错误类型,例如分解错误、组合错误、符号理解错误等,以便更详细地分析LLM的缺陷。4) 使用准确率、召回率等指标评估LLM的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是最先进的LLM在分解和组合方面仍然存在显著不足。LLM容易受到组合间隙和反直觉符号名称的影响,并且在自然语言理解和符号系统学习方面存在缺陷。DEDC框架能够有效识别这些缺陷,并为后续改进提供指导。

🎯 应用场景

该研究成果可应用于自然语言处理、智能编程、语义理解等领域。通过提升LLM在N2F任务中的分解和组合能力,可以构建更智能的编程助手、更强大的自然语言接口,并促进人机交互的进一步发展。此外,该框架也为评估和改进其他类型语言模型提供了借鉴。

📄 摘要(原文)

To achieve generalized and robust natural-to-formal language conversion (N2F), large language models (LLMs) need to have strong capabilities of decomposition and composition in N2F when faced with an unfamiliar formal language and be able to cope with compositional gaps and counter-intuitive symbolic names. To investigate whether LLMs have this set of basic capabilities in N2F, we propose the DEDC framework. This framework semi-automatically performs sample and task construction, allowing decoupled evaluation of the set of decomposition and composition capabilities of LLMs in N2F. Based on this framework, we evaluate and analyze the most advanced LLMs, and the main findings include that: (1) the LLMs are deficient in both decomposition and composition; (2) the LLMs show a wide coverage of error types that can be attributed to deficiencies in natural language understanding and the learning and use of symbolic systems; (3) compositional gaps and counter-intuitive symbolic names both affect the decomposition and composition of the LLMs. Our work provides a new perspective for investigating the basic capabilities of decomposition and composition of LLMs in N2F. The detailed analysis of deficiencies and attributions can help subsequent improvements of LLMs.