MedSlice: Fine-Tuned Large Language Models for Secure Clinical Note Sectioning

作者: Joshua Davis, Thomas Sounack, Kate Sciacca, Jessie M Brain, Brigitte N Durieux, Nicole D Agaronnik, Charlotta Lindvall

分类: cs.CL, cs.AI, cs.IR, cs.LG

发布日期: 2025-01-23

备注: Our code is publicly available on github ( https://github.com/lindvalllab/MedSlice )

💡 一句话要点

提出MedSlice以解决临床笔记分段的隐私与效率问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 临床笔记 大型语言模型 自动化分段 隐私保护 性能评估 开源技术 医疗数据分析

📋 核心要点

- 现有方法在临床笔记分段中面临格式多样性和手动处理的高劳动成本等挑战。

- 本研究提出了一种基于开源大型语言模型的自动化分段管道,专注于特定的临床笔记部分。

- 实验结果表明,微调后的Llama 3.1 8B在F1分数上超越了专有模型,验证了其有效性和优势。

📝 摘要(中文)

提取临床笔记的各个部分对于后续分析至关重要,但由于格式的多样性和手动分段的劳动密集性,这一过程面临挑战。尽管专有的大型语言模型(LLMs)显示出潜力,但隐私问题限制了其可用性。本研究开发了一种基于开源LLMs的自动化笔记分段管道,重点关注三部分:现病史、间隔历史以及评估与计划。通过对487份进展笔记的精心策划数据集进行微调,比较了结果与专有模型(GPT-4o,GPT-4o mini)的表现。内部和外部有效性通过精确度、召回率和F1分数进行评估。微调后的Llama 3.1 8B在F1分数上超越了GPT-4o(F1=0.92),在外部有效性测试集上的表现依然良好(F1=0.85)。微调后的开源LLMs在临床笔记分段中可以超越专有模型,提供成本、性能和可及性方面的优势。

🔬 方法详解

问题定义:本研究旨在解决临床笔记分段的自动化问题,现有方法由于格式多样性和手动处理的高劳动成本而面临挑战。

核心思路:通过微调开源大型语言模型,自动提取临床笔记中的特定部分,降低隐私风险并提高效率。

技术框架:整体流程包括数据收集、模型微调和性能评估三个主要阶段。首先,收集487份临床进展笔记作为训练数据;然后,使用这些数据对开源LLMs进行微调;最后,通过精确度、召回率和F1分数评估模型性能。

关键创新:本研究的主要创新在于使用开源LLMs进行临床笔记分段,证明其在性能上可以超越专有模型,且在隐私和成本上具有优势。

关键设计:在微调过程中,采用了特定的损失函数和网络结构,确保模型能够有效学习到临床笔记的格式和内容特征。

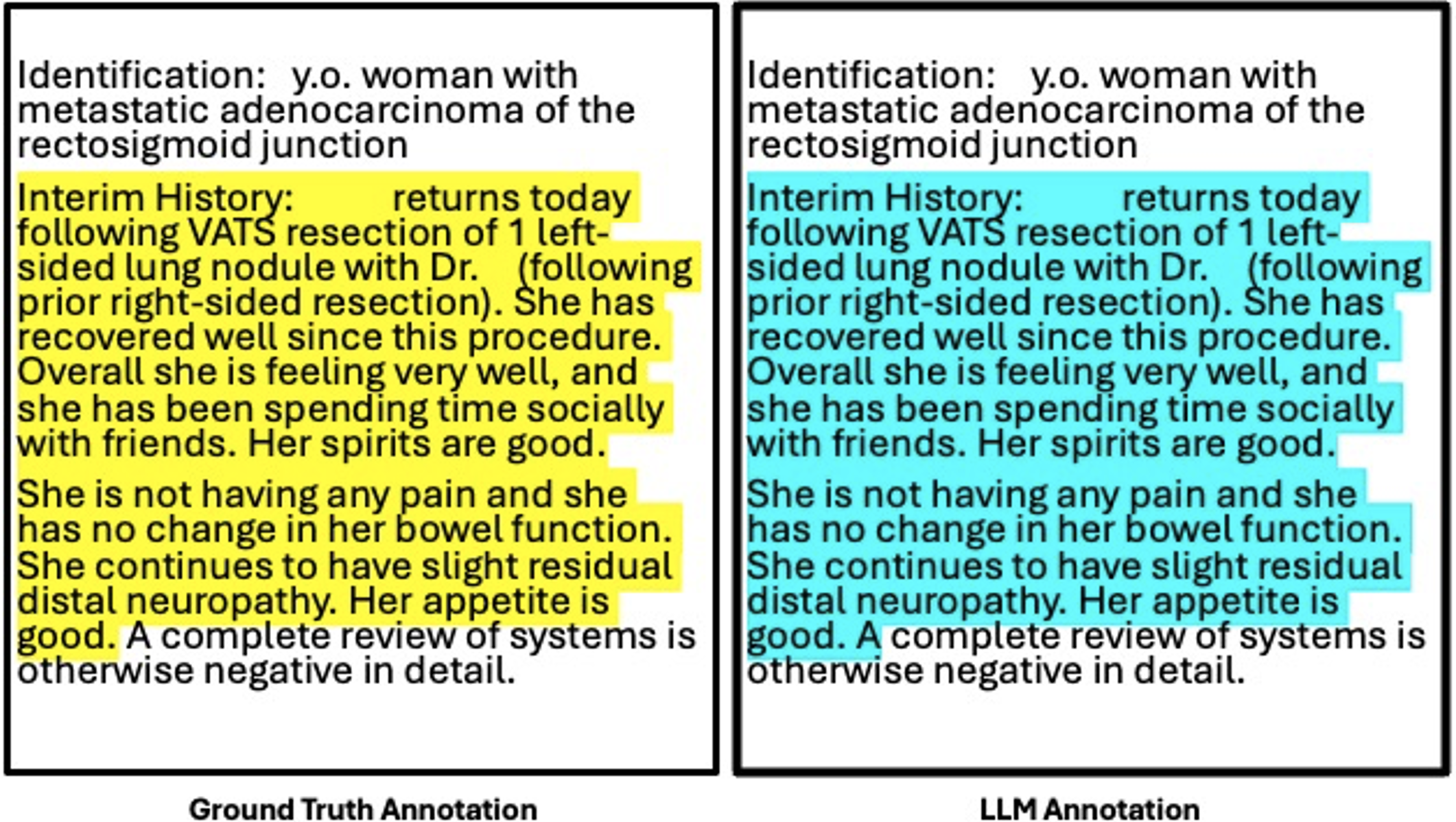

🖼️ 关键图片

📊 实验亮点

实验结果显示,微调后的Llama 3.1 8B模型在F1分数上达到0.92,超越了专有模型GPT-4o,且在外部有效性测试集上保持高达0.85的F1分数,证明了其在临床笔记分段中的优越性能。

🎯 应用场景

该研究的潜在应用领域包括医疗记录管理、临床数据分析和智能医疗助手等。通过自动化分段,能够提高临床工作效率,降低人力成本,促进医疗信息的快速处理与分析,具有重要的实际价值和未来影响。

📄 摘要(原文)

Extracting sections from clinical notes is crucial for downstream analysis but is challenging due to variability in formatting and labor-intensive nature of manual sectioning. While proprietary large language models (LLMs) have shown promise, privacy concerns limit their accessibility. This study develops a pipeline for automated note sectioning using open-source LLMs, focusing on three sections: History of Present Illness, Interval History, and Assessment and Plan. We fine-tuned three open-source LLMs to extract sections using a curated dataset of 487 progress notes, comparing results relative to proprietary models (GPT-4o, GPT-4o mini). Internal and external validity were assessed via precision, recall and F1 score. Fine-tuned Llama 3.1 8B outperformed GPT-4o (F1=0.92). On the external validity test set, performance remained high (F1= 0.85). Fine-tuned open-source LLMs can surpass proprietary models in clinical note sectioning, offering advantages in cost, performance, and accessibility.