Framework for Progressive Knowledge Fusion in Large Language Models Through Structured Conceptual Redundancy Analysis

作者: Joseph Sakau, Evander Kozlowski, Roderick Thistledown, Basil Steinberger

分类: cs.CL, cs.AI

发布日期: 2025-01-23 (更新: 2025-03-25)

备注: arXiv admin note: This paper has been withdrawn by arXiv due to disputed and unverifiable authorship

💡 一句话要点

提出一种基于结构化概念冗余分析的大语言模型渐进式知识融合框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 知识融合 概念冗余 模型优化 聚类分析

📋 核心要点

- 大型语言模型存在潜在知识冗余,影响计算效率和任务表现,亟需优化。

- 提出通过聚类和动态阈值处理,重构模型中的概念冗余,提升效率和性能。

- 实验表明,该方法能提升内存效率、推理速度,并增强模型鲁棒性和可解释性。

📝 摘要(中文)

本文提出了一种框架,旨在通过结构化概念冗余分析来重构大型语言模型中的潜在知识。该框架利用先进的聚类技术和动态阈值处理,在去除不必要的重叠的同时,确保关键语义关系的保留。评估结果表明,该方法提高了内存效率和推理速度,并改善了潜在知识簇的对齐,从而增强了可解释性。错误率和对抗鲁棒性的改进表明,重构冗余对于提高模型在各种应用中的可靠性具有更广泛的意义。对比分析突出了资源消耗的减少和性能的显著提升,尤其是在翻译和摘要任务中。能源指标显示,在训练阶段显著节省了能源,进一步验证了该方法在实际部署中的可行性。表征保真度也得到了增强,潜在空间评估表明更好的簇对齐和更高的语义一致性。该方法通过直接解决结构层面的冗余,弥合了模型优化的一个关键差距。它的应用为可扩展、高效且上下文感知的系统开辟了道路,这些系统可以适应复杂的、特定领域的任务,而不会影响性能。

🔬 方法详解

问题定义:大型语言模型在训练过程中学习到大量知识,但这些知识在模型内部的表示可能存在冗余和重叠。这种冗余不仅增加了计算负担,还可能影响模型在特定任务上的表现,例如翻译和摘要。现有方法通常侧重于模型压缩或知识蒸馏,但很少直接解决模型内部知识表示的结构性冗余问题。

核心思路:本文的核心思路是通过分析和重构模型内部的知识表示,消除概念上的冗余,从而提高模型的效率和性能。具体来说,该方法旨在识别模型中表示相似概念的神经元或层,并将它们合并或精简,以减少模型的复杂性。这种方法的核心在于保持关键语义关系的同时,去除不必要的重叠。

技术框架:该框架包含以下几个主要阶段:1) 知识表示提取:从预训练的大型语言模型中提取各层的知识表示,例如神经元的激活值或嵌入向量。2) 概念冗余分析:使用聚类技术(如K-means或层次聚类)对提取的知识表示进行分组,识别表示相似概念的簇。3) 动态阈值处理:根据簇的相似度和重要性,设置动态阈值,决定哪些簇需要合并或精简。4) 模型重构:根据冗余分析的结果,对模型进行重构,例如合并相似的神经元或层,或使用更紧凑的表示。5) 微调:在特定任务上对重构后的模型进行微调,以恢复性能。

关键创新:该方法最重要的创新点在于它直接针对大型语言模型内部知识表示的结构性冗余进行优化。与传统的模型压缩方法不同,该方法不仅减少了模型的参数量,还提高了模型的效率和可解释性。此外,该方法使用动态阈值处理,可以根据不同的任务和模型自适应地调整冗余消除的程度。

关键设计:在聚类阶段,可以选择不同的聚类算法和距离度量,以适应不同的知识表示。动态阈值的设置可以基于簇的大小、相似度或在特定任务上的表现。模型重构的具体方法可以包括神经元剪枝、层合并或知识蒸馏。损失函数的设计需要考虑保持关键语义关系和提高模型效率之间的平衡。

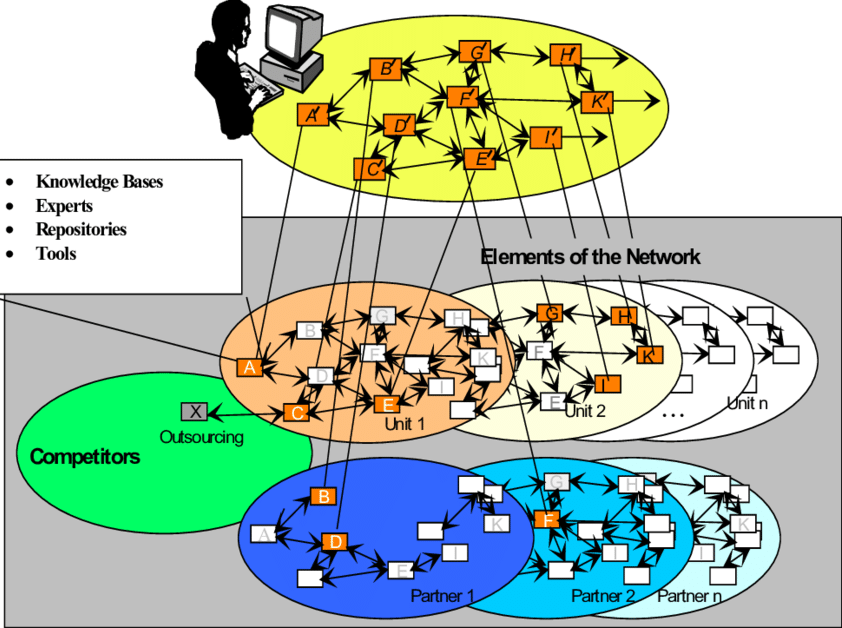

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在翻译和摘要任务中取得了显著的性能提升,同时降低了资源消耗。具体而言,该方法在保持或提高模型性能的同时,显著减少了内存占用和推理时间。能源指标显示,在训练阶段显著节省了能源,验证了该方法在实际部署中的可行性。此外,该方法还提高了模型的对抗鲁棒性,使其更能抵抗恶意攻击。

🎯 应用场景

该研究成果可应用于各种需要高效且高性能的大型语言模型的场景,例如机器翻译、文本摘要、对话系统和信息检索。通过减少模型冗余,可以降低计算成本和能源消耗,使其更易于部署在资源受限的环境中。此外,该方法还可以提高模型的可解释性和鲁棒性,使其在安全关键型应用中更可靠。

📄 摘要(原文)

The organization of latent knowledge within large-scale models poses unique challenges when addressing overlapping representations and optimizing contextual accuracy. Conceptual redundancies embedded across layers often result in inefficiencies that affect both computational demands and task-specific outcomes. A framework was proposed to restructure these redundancies through advanced clustering techniques and dynamic thresholding, ensuring that critical semantic relationships are preserved while removing unnecessary overlaps. Evaluations revealed improved memory efficiency and faster inference times, alongside better alignment in latent knowledge clusters that enhanced interpretability. Improvements in error rates and adversarial robustness suggest that restructuring redundancies has broader implications for increasing model reliability across diverse applications. Comparative analyses highlighted reductions in resource consumption and notable gains in performance, particularly in translation and summarization tasks. Energy metrics demonstrated significant savings during training phases, further validating the practicality of the approach for real-world deployments. Representational fidelity was also enhanced, with latent space evaluations indicating better cluster alignment and higher semantic consistency. The methodology bridges a key gap in model optimization through directly addressing redundancies at the structural level. Its application opens avenues for scalable, efficient, and contextually aware systems that can adapt to complex, domain-specific tasks without compromising on performance.