Advancing Multi-Party Dialogue Framework with Speaker-ware Contrastive Learning

作者: Zhongtian Hu, Qi He, Ronghan Li, Meng Zhao, Lifang Wang

分类: cs.CL

发布日期: 2025-01-20 (更新: 2025-05-19)

💡 一句话要点

提出CMR框架,利用对比学习提升多方对话生成效果

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多方对话 对话生成 对比学习 自监督学习 说话人风格

📋 核心要点

- 现有方法依赖图神经网络建模多方对话,但依赖标注图结构且忽略说话风格。

- CMR框架采用两阶段对比学习,捕捉说话风格差异和对话主题转换。

- 实验表明,CMR显著优于现有模型,并能提升预训练语言模型的多方对话能力。

📝 摘要(中文)

多方对话,常见于协作场景(如头脑风暴和谈判),因其复杂性和多样化的发言者角色而带来重大挑战。现有方法通常使用图神经网络来建模对话上下文,虽然捕捉了结构动态,但严重依赖于标注的图结构,并忽略了个人的说话风格。为了应对这些挑战,我们提出了CMR,一个基于对比学习的多方对话回复生成框架。CMR采用两阶段自监督对比学习框架。首先,它捕捉不同个体说话风格的全局差异。然后,它专注于对话内部的比较,以识别主题转换和上下文相关的的事实。据我们所知,这是第一个将对比学习应用于多方对话生成的方法。实验结果表明,CMR不仅显著优于最先进的模型,而且可以很好地推广到大型预训练语言模型,有效地增强了它们处理多方对话的能力。

🔬 方法详解

问题定义:多方对话生成任务旨在根据多个参与者的对话历史生成合适的回复。现有方法,特别是基于图神经网络的方法,虽然能够捕捉对话的结构信息,但存在两个主要痛点:一是依赖于人工标注的图结构,标注成本高昂且可能引入人为偏差;二是忽略了不同说话者的独特风格,导致生成的回复缺乏个性化和针对性。

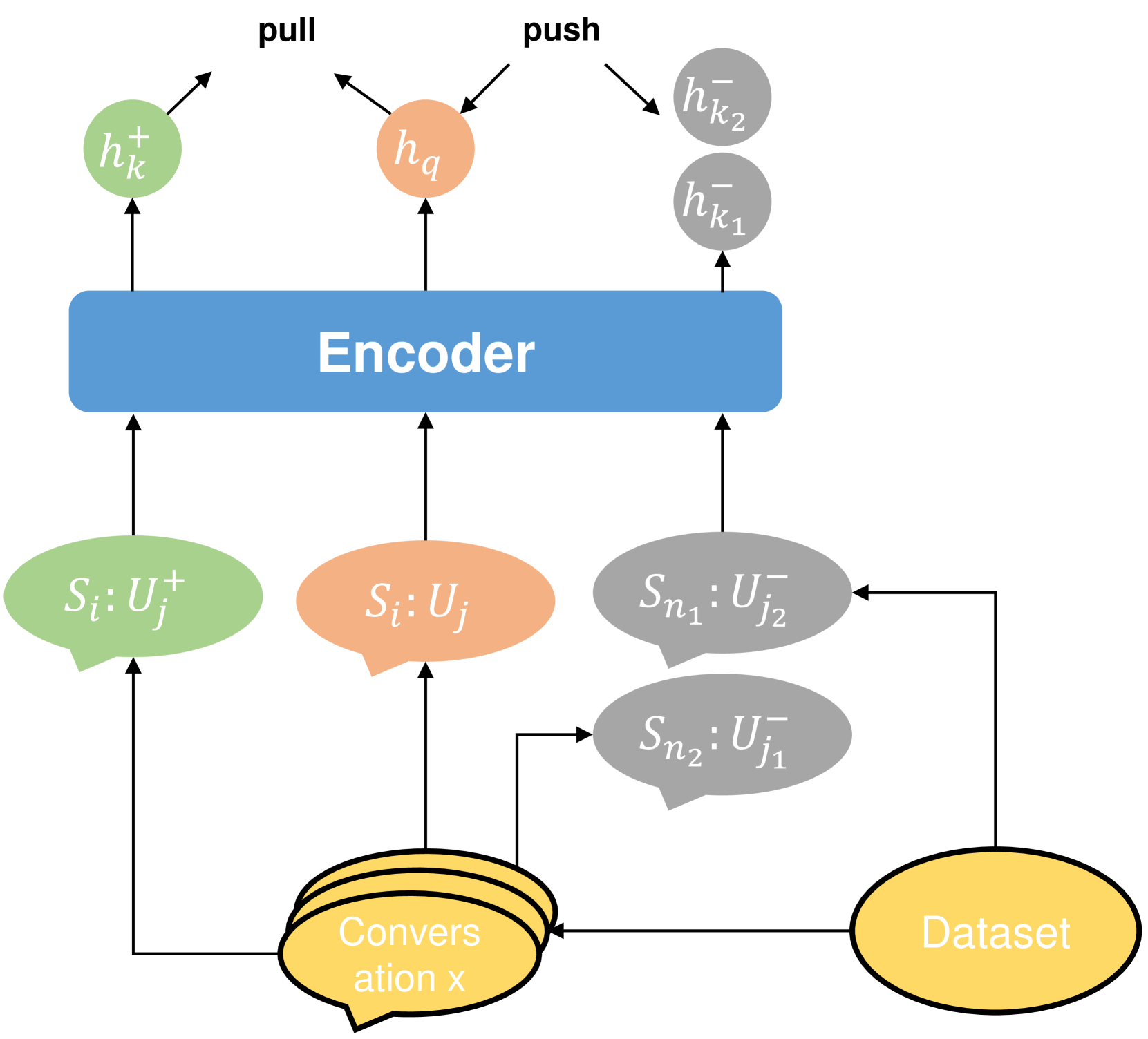

核心思路:CMR的核心思路是利用对比学习,通过区分不同说话者的风格和对话中的主题转换,学习到更具区分性的对话表示。具体来说,CMR通过对比学习,使得同一说话者的不同话语在表示空间中更接近,而不同说话者的话语则更远离。同时,CMR还通过对比学习,使得同一主题下的不同话语更接近,而不同主题的话语则更远离。

技术框架:CMR框架包含两个主要的对比学习阶段。第一阶段是说话者风格对比学习,旨在学习不同说话者的风格表示。该阶段通过对比同一说话者的不同话语和不同说话者的话语,学习到说话者风格的全局差异。第二阶段是对话内部对比学习,旨在识别主题转换和上下文相关的的事实。该阶段通过对比同一对话中不同时间点的话语,学习到对话的主题演变和关键信息。这两个阶段的学习目标共同作用,使得CMR能够生成更具个性化和上下文相关的回复。

关键创新:CMR的关键创新在于将对比学习引入到多方对话生成任务中。与传统的图神经网络方法相比,CMR不需要人工标注的图结构,而是通过自监督的方式学习对话表示。此外,CMR还考虑了不同说话者的风格差异,使得生成的回复更具个性化。

关键设计:在说话者风格对比学习阶段,CMR使用InfoNCE损失函数来最大化同一说话者话语之间的互信息,并最小化不同说话者话语之间的互信息。在对话内部对比学习阶段,CMR也使用InfoNCE损失函数来最大化同一主题下话语之间的互信息,并最小化不同主题下话语之间的互信息。此外,CMR还采用了Transformer作为编码器,以捕捉对话的上下文信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CMR在多方对话生成任务上显著优于现有最先进的模型。具体来说,CMR在ROUGE和BLEU等指标上取得了显著提升,表明其生成的回复更准确、更流畅。此外,CMR还能够很好地推广到大型预训练语言模型,有效地增强了它们处理多方对话的能力。

🎯 应用场景

CMR框架可应用于各种多方对话场景,如在线会议、客服系统、社交媒体论坛等。通过生成更自然、个性化的回复,CMR可以提升用户体验,提高沟通效率,并促进更深入的交流。未来,该技术有望应用于更复杂的协作场景,如智能助理、虚拟谈判等。

📄 摘要(原文)

Multi-party dialogues, common in collaborative scenarios like brainstorming sessions and negotiations, pose significant challenges due to their complexity and diverse speaker roles. Current methods often use graph neural networks to model dialogue context, capturing structural dynamics but heavily relying on annotated graph structures and overlooking individual speaking styles. To address these challenges, we propose CMR, a Contrastive learning-based Multi-party dialogue Response generation framework. CMR employs a two-stage self-supervised contrastive learning framework. First, it captures global differences in speaking styles across individuals. Then, it focuses on intra-conversation comparisons to identify thematic transitions and contextually relevant facts. To the best of our knowledge, this is the first approach that applies contrastive learning in multi-party dialogue generation. Experimental results demonstrate that CMR not only significantly outperforms state-of-the-art models, but also generalizes well to large pre-trained language models, effectively enhancing their capability in handling multi-party conversations.