Hallucination Mitigation using Agentic AI Natural Language-Based Frameworks

作者: Diego Gosmar, Deborah A. Dahl

分类: cs.CL, cs.AI, cs.MA

发布日期: 2025-01-19

备注: 18 pages, 6 figures

💡 一句话要点

利用Agentic AI和自然语言框架缓解生成式AI中的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成式AI 幻觉缓解 Agentic AI 自然语言处理 多智能体系统

📋 核心要点

- 生成式AI模型中的幻觉问题严重影响了其可靠性和可信度,现有方法难以有效解决。

- 该论文提出了一种基于Agentic AI的框架,通过多智能体协作,利用NLP技术进行幻觉检测和缓解。

- 实验结果表明,该方法能够有效降低生成式AI模型中的幻觉,提升输出质量和可信度。

📝 摘要(中文)

幻觉是当前生成式AI模型面临的重大挑战,它会降低AI系统的可信度和可靠性。本研究探讨了如何通过编排多个专门的人工智能代理来缓解此类幻觉,重点关注利用自然语言处理(NLP)促进无缝代理交互的系统。为此,我们设计了一个pipeline,将三百多个旨在诱导幻觉的提示输入到前端代理中。然后,由第二和第三级代理系统地审查和改进输出,每个代理采用不同的LLM和定制策略来检测未经证实的声明,加入明确的免责声明,并澄清推测性内容。此外,我们引入了一组新的关键绩效指标(KPI),专门用于评估幻觉评分水平。一个专门的第四级AI代理被用来评估这些KPI,提供详细的评估并确保准确量化与幻觉相关的行为变化。本研究的核心组成部分是使用OVON(开放语音网络)框架,该框架依赖于通用的基于NLP的接口在代理之间传输上下文信息。通过结构化的JSON消息,每个代理都会沟通其对幻觉可能性的评估以及可疑内容背后的原因,从而使后续阶段能够在不丢失上下文的情况下改进文本。结果表明,采用多个能够通过基于NLP的代理框架相互操作的专门代理,可以在缓解幻觉方面产生有希望的结果,最终增强AI社区内的信任。

🔬 方法详解

问题定义:论文旨在解决生成式AI模型中普遍存在的幻觉问题,即模型生成不真实、不一致或无意义的内容。现有方法在检测和缓解幻觉方面存在不足,难以保证AI系统的可靠性和可信度。

核心思路:论文的核心思路是利用多个专门的AI代理协同工作,通过自然语言处理(NLP)技术进行信息交换和验证,从而检测和缓解幻觉。这种多智能体协作的方式可以充分利用不同模型的优势,提高幻觉检测的准确性和效率。

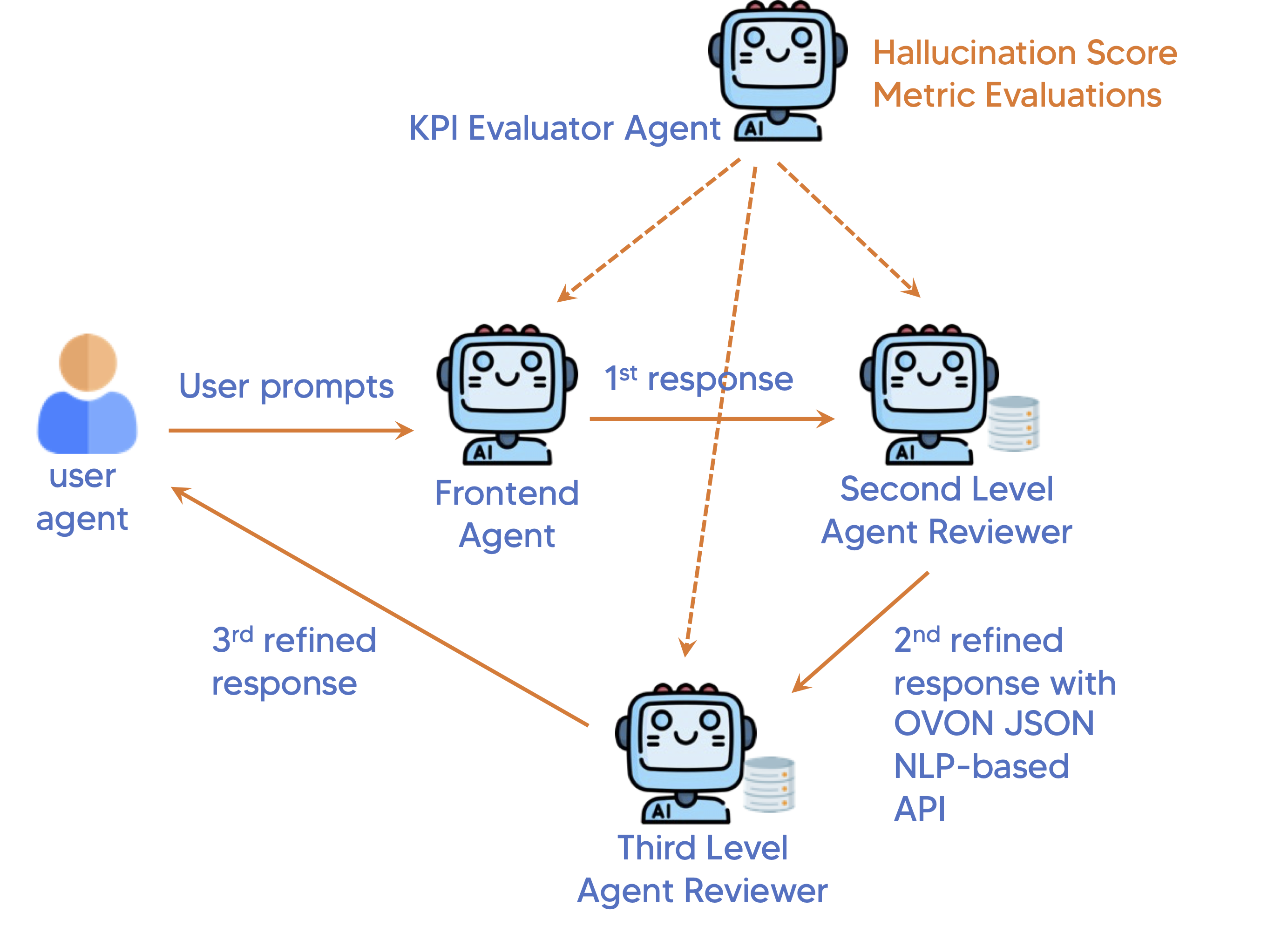

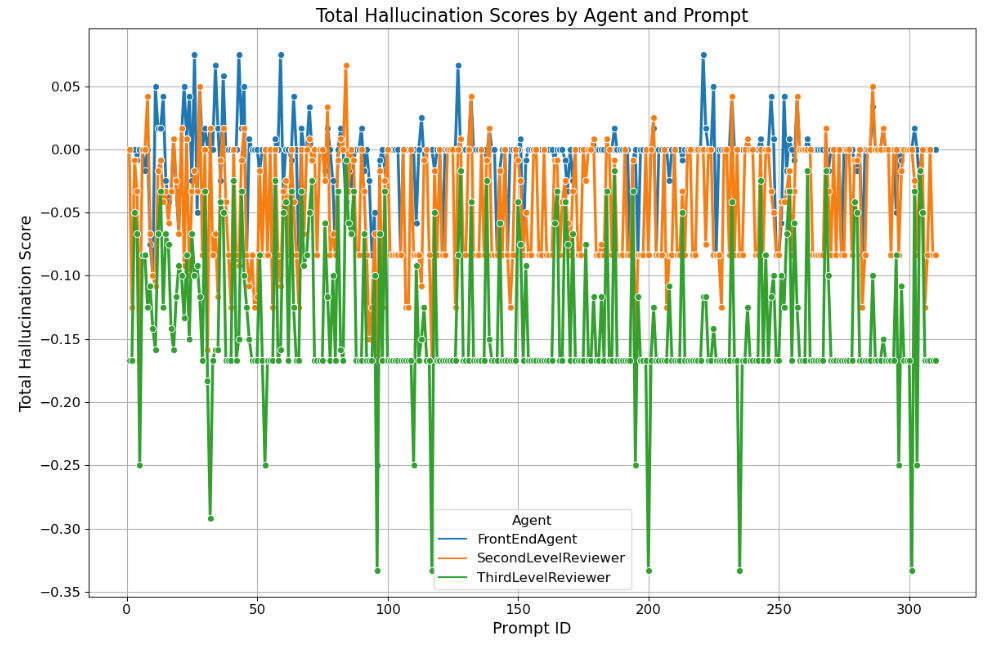

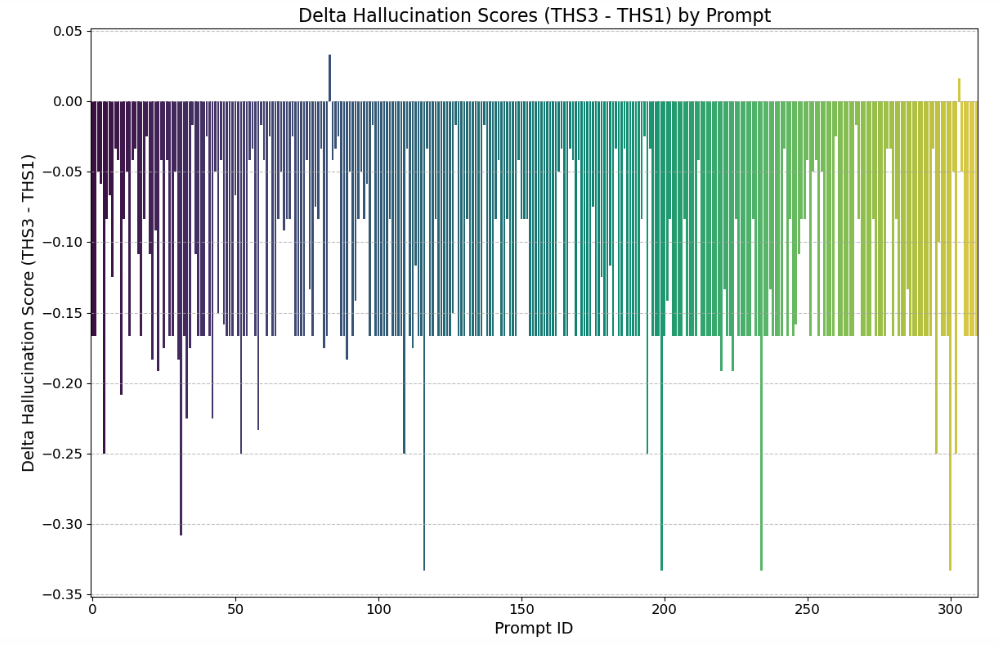

技术框架:该框架包含四个主要级别的AI代理。第一级代理接收输入提示并生成初始输出,该输出可能包含幻觉。第二级和第三级代理负责审查和改进第一级代理的输出,检测未经证实的声明,添加免责声明,并澄清推测性内容。第四级代理负责评估关键绩效指标(KPI),量化幻觉水平的变化。代理之间通过OVON框架进行通信,使用结构化的JSON消息传递上下文信息和评估结果。

关键创新:该方法的主要创新在于利用Agentic AI和NLP技术构建了一个多智能体协作框架,用于检测和缓解生成式AI模型中的幻觉。通过引入专门的KPI和第四级评估代理,可以更准确地量化幻觉水平的变化。

关键设计:论文设计了超过300个旨在诱导幻觉的提示,用于测试和评估该框架的性能。每个代理都使用不同的LLM和定制策略,以提高幻觉检测的多样性和准确性。OVON框架的使用保证了代理之间上下文信息的有效传递。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了该方法在缓解幻觉方面的有效性。通过多智能体协作和NLP技术,该框架能够显著降低生成式AI模型中的幻觉,提高输出质量和可信度。具体的性能数据和对比基线未知,但整体效果表明该方法具有良好的应用前景。

🎯 应用场景

该研究成果可应用于各种生成式AI应用场景,例如智能客服、内容创作、机器翻译等。通过降低幻觉,可以提高AI系统的可靠性和可信度,增强用户体验,并减少潜在的风险和损失。未来,该方法有望成为构建可信AI系统的关键技术。

📄 摘要(原文)

Hallucinations remain a significant challenge in current Generative AI models, undermining trust in AI systems and their reliability. This study investigates how orchestrating multiple specialized Artificial Intelligent Agents can help mitigate such hallucinations, with a focus on systems leveraging Natural Language Processing (NLP) to facilitate seamless agent interactions. To achieve this, we design a pipeline that introduces over three hundred prompts, purposefully crafted to induce hallucinations, into a front-end agent. The outputs are then systematically reviewed and refined by second- and third-level agents, each employing distinct large language models and tailored strategies to detect unverified claims, incorporate explicit disclaimers, and clarify speculative content. Additionally, we introduce a set of novel Key Performance Indicators (KPIs) specifically designed to evaluate hallucination score levels. A dedicated fourth-level AI agent is employed to evaluate these KPIs, providing detailed assessments and ensuring accurate quantification of shifts in hallucination-related behaviors. A core component of this investigation is the use of the OVON (Open Voice Network) framework, which relies on universal NLP-based interfaces to transfer contextual information among agents. Through structured JSON messages, each agent communicates its assessment of the hallucination likelihood and the reasons underlying questionable content, thereby enabling the subsequent stage to refine the text without losing context. The results demonstrate that employing multiple specialized agents capable of interoperating with each other through NLP-based agentic frameworks can yield promising outcomes in hallucination mitigation, ultimately bolstering trust within the AI community.