Attention-guided Self-reflection for Zero-shot Hallucination Detection in Large Language Models

作者: Qiang Liu, Xinlong Chen, Yue Ding, Bowen Song, Weiqiang Wang, Shu Wu, Liang Wang

分类: cs.CL, cs.AI

发布日期: 2025-01-17 (更新: 2025-09-03)

💡 一句话要点

提出注意力引导的自反思方法,用于大语言模型中的零样本幻觉检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉检测 零样本学习 注意力机制 自反思 一致性评估

📋 核心要点

- 大语言模型中的幻觉问题严重阻碍了其有效应用,现有方法难以在零样本场景下高效检测幻觉。

- AGSER方法通过注意力机制区分不同类型的查询,并计算生成回复与原始答案的一致性得分差异来估计幻觉。

- 实验表明,AGSER在多个幻觉检测基准上显著优于现有零样本方法,且计算开销较低。

📝 摘要(中文)

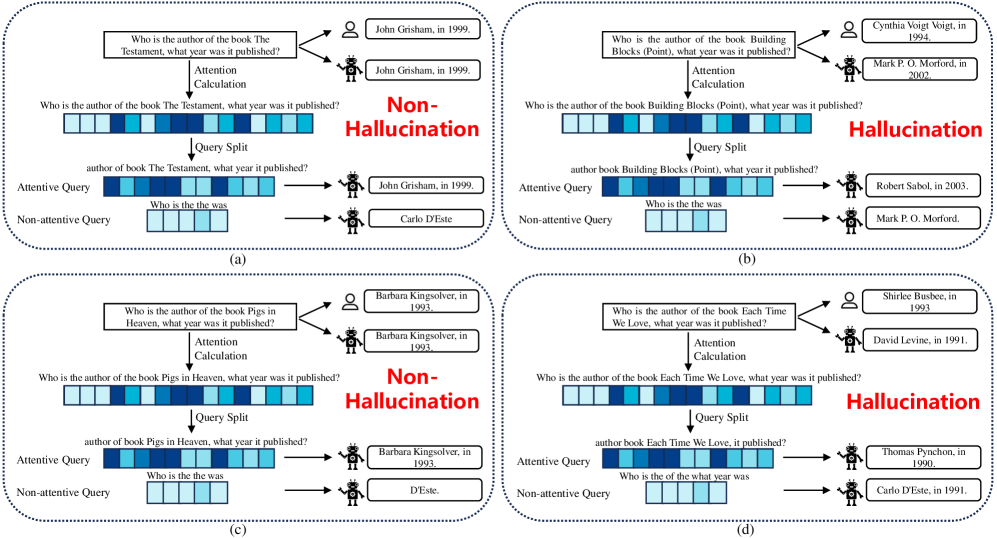

本文提出了一种新颖的注意力引导自反思(AGSER)方法,用于大语言模型(LLMs)中的零样本幻觉检测。AGSER方法利用注意力贡献将输入查询分为关注型查询和非关注型查询。然后,每个查询通过LLM单独处理,从而计算生成响应与原始答案之间的一致性得分。两个一致性得分之间的差异作为幻觉估计器。除了在检测幻觉方面的有效性之外,AGSER还显著降低了计算开销,仅需要通过LLM三次,并利用两组tokens。在三个不同的幻觉基准上,使用四个广泛使用的LLM进行了大量实验,表明我们的方法在零样本幻觉检测方面显著优于现有方法。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLMs)中零样本幻觉检测的问题。现有的幻觉检测方法通常需要训练数据或复杂的提示工程,难以适应零样本场景,并且计算成本较高。因此,如何高效、准确地在零样本条件下检测LLMs的幻觉是本文要解决的核心问题。

核心思路:论文的核心思路是利用LLM自身的注意力机制来判断输入查询的重要性,并基于不同重要性的查询生成回复的一致性来判断是否存在幻觉。具体来说,如果一个查询的某些部分被LLM赋予了较高的注意力权重,那么LLM生成的回复应该与原始答案更加一致。如果一致性较低,则可能存在幻觉。

技术框架:AGSER方法主要包含以下几个阶段:1) 注意力分析:利用LLM的注意力机制,计算输入查询中每个token的注意力权重。2) 查询分类:基于注意力权重,将输入查询分为关注型查询和非关注型查询。3) 回复生成:分别使用LLM对原始查询、关注型查询和非关注型查询生成回复。4) 一致性计算:计算原始查询回复与关注型查询回复的一致性得分,以及原始查询回复与非关注型查询回复的一致性得分。5) 幻觉估计:计算两个一致性得分的差异,作为幻觉的估计值。

关键创新:AGSER的关键创新在于利用LLM自身的注意力机制来指导幻觉检测,无需额外的训练数据或复杂的提示工程。通过区分不同类型的查询,并基于回复的一致性来判断是否存在幻觉,从而实现了高效的零样本幻觉检测。此外,AGSER方法仅需要三次通过LLM,显著降低了计算开销。

关键设计:AGSER方法的关键设计包括:1) 如何定义和计算注意力权重,例如使用最后一层的注意力权重平均值。2) 如何将查询分类为关注型和非关注型,例如设置一个阈值来区分高注意力权重和低注意力权重。3) 如何计算回复之间的一致性得分,例如使用ROUGE或BLEU等指标。4) 如何将一致性得分差异转化为幻觉概率,例如使用sigmoid函数。

🖼️ 关键图片

📊 实验亮点

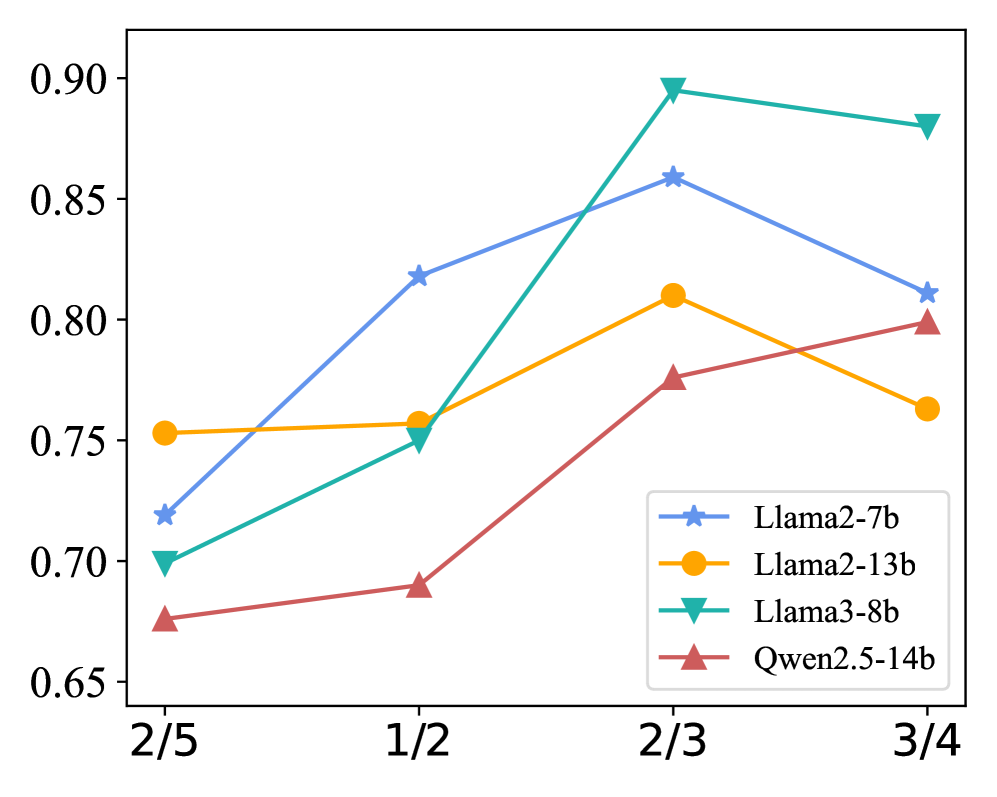

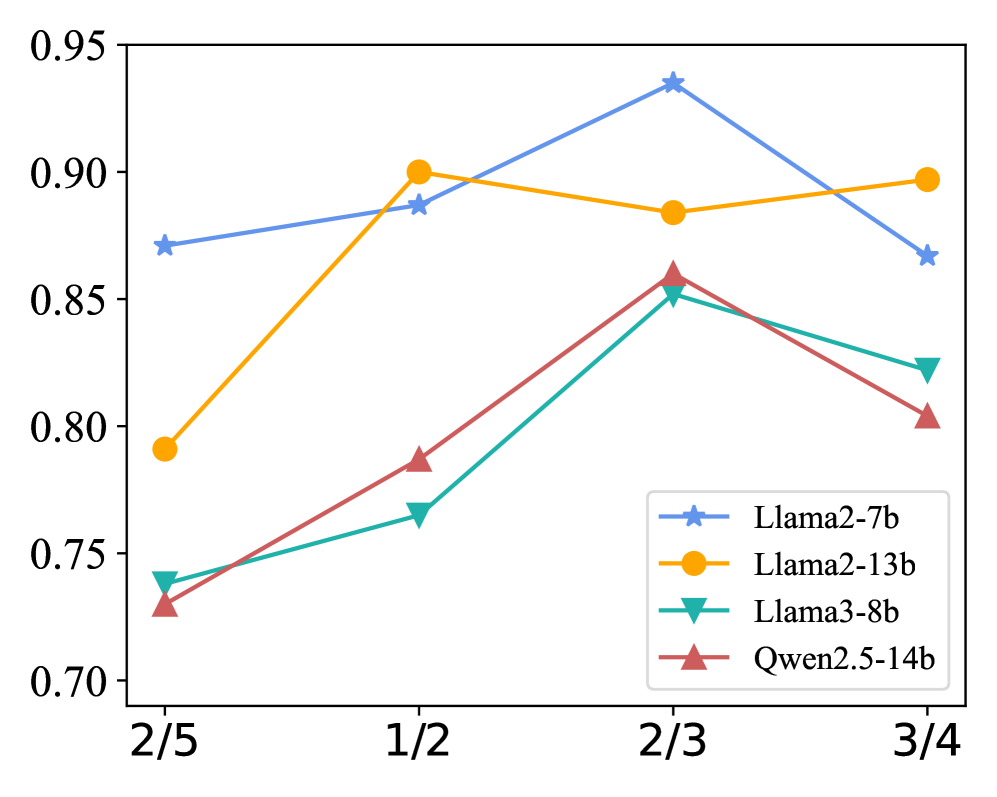

AGSER方法在三个不同的幻觉基准上,使用四个广泛使用的LLM进行了大量实验,结果表明AGSER在零样本幻觉检测方面显著优于现有方法。具体性能提升数据未知,但摘要强调了显著优于现有方法,并降低了计算开销,仅需三次通过LLM。

🎯 应用场景

该研究成果可广泛应用于各种需要大语言模型提供可靠信息的场景,例如智能客服、内容创作、知识问答等。通过有效检测和抑制幻觉,可以提高LLM生成内容的准确性和可信度,从而增强用户体验,降低风险。未来,该方法可以进一步扩展到其他类型的LLM和任务中,并与其他幻觉缓解技术相结合,构建更加鲁棒和可靠的AI系统。

📄 摘要(原文)

Hallucination has emerged as a significant barrier to the effective application of Large Language Models (LLMs). In this work, we introduce a novel Attention-Guided SElf-Reflection (AGSER) approach for zero-shot hallucination detection in LLMs. The AGSER method utilizes attention contributions to categorize the input query into attentive and non-attentive queries. Each query is then processed separately through the LLMs, allowing us to compute consistency scores between the generated responses and the original answer. The difference between the two consistency scores serves as a hallucination estimator. In addition to its efficacy in detecting hallucinations, AGSER notably reduces computational overhead, requiring only three passes through the LLM and utilizing two sets of tokens. We have conducted extensive experiments with four widely-used LLMs across three different hallucination benchmarks, demonstrating that our approach significantly outperforms existing methods in zero-shot hallucination detection.