Aegis2.0: A Diverse AI Safety Dataset and Risks Taxonomy for Alignment of LLM Guardrails

作者: Shaona Ghosh, Prasoon Varshney, Makesh Narsimhan Sreedhar, Aishwarya Padmakumar, Traian Rebedea, Jibin Rajan Varghese, Christopher Parisien

分类: cs.CL

发布日期: 2025-01-15

备注: arXiv admin note: text overlap with arXiv:2404.05993

💡 一句话要点

Aegis2.0:构建多样化AI安全数据集与风险分类体系,用于对齐LLM安全护栏。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM安全 AI安全数据集 风险分类 安全护栏 参数高效微调

📋 核心要点

- 现有LLM安全数据集缺乏高质量人工标注,难以覆盖所有安全风险,限制了商业应用。

- 提出Aegis 2.0数据集和风险分类体系,结合人工标注和多LLM评审,实现更细粒度的风险管理。

- 实验表明,基于Aegis 2.0训练的轻量级模型,性能可与大型数据集上微调的安全模型媲美。

📝 摘要(中文)

随着大型语言模型(LLMs)和生成式AI的日益普及,对内容安全性的担忧也随之增加。目前,高质量、人工标注的数据集明显缺乏,这些数据集需要涵盖与LLM相关的全部安全风险,并且可用于商业应用。为了弥补这一差距,我们提出了一种全面且适应性强的分类体系,用于对安全风险进行分类,该体系结构化为12个顶级危害类别,并扩展到9个细粒度的子类别。该分类体系旨在满足下游用户的多样化需求,为管理各种风险类型提供更精细和灵活的工具。我们使用混合数据生成流程,将人工标注与多LLM“评审团”系统相结合来评估响应的安全性,从而获得了Aegis 2.0,这是一个精心策划的包含34,248个人类-LLM交互样本的集合,并根据我们提出的分类体系进行标注。为了验证其有效性,我们证明了几个轻量级模型,通过在Aegis 2.0上使用参数高效技术进行训练,可以达到与在更大的非商业数据集上完全微调的领先安全模型相媲美的性能。此外,我们还引入了一种新颖的训练混合方法,将安全性与主题跟随数据相结合。这种方法增强了保护模型的适应性,使其能够推广到推理期间定义的新风险类别。我们计划向研究社区开源Aegis 2.0数据和模型,以帮助LLM的安全防护。

🔬 方法详解

问题定义:当前大型语言模型(LLM)的安全问题日益突出,但缺乏高质量、人工标注的安全数据集,难以全面覆盖各种安全风险,并且现有数据集在商业应用方面存在限制。因此,需要构建一个更全面、更精细、更易于使用的LLM安全数据集,以提升LLM安全防护能力。

核心思路:论文的核心思路是构建一个多样化的AI安全数据集Aegis 2.0,并设计一个全面的风险分类体系。通过结合人工标注和多LLM评审团系统,确保数据集的高质量和覆盖范围。同时,采用参数高效的训练方法和新颖的训练混合策略,提升模型的泛化能力和适应性。

技术框架:Aegis 2.0的构建流程主要包括以下几个阶段:1) 定义全面的风险分类体系,包含12个顶级危害类别和9个细粒度的子类别;2) 采用混合数据生成流程,结合人工标注和多LLM评审团系统,生成高质量的LLM交互样本;3) 使用参数高效的训练技术,在Aegis 2.0上训练轻量级安全模型;4) 引入安全与主题跟随数据混合的训练方法,增强模型的适应性。

关键创新:论文的关键创新点在于:1) 提出了一个全面且适应性强的LLM安全风险分类体系,能够满足下游用户的多样化需求;2) 构建了一个高质量、人工标注的LLM安全数据集Aegis 2.0,填补了现有数据集的空白;3) 提出了一种新颖的训练混合方法,将安全性与主题跟随数据相结合,增强了模型的泛化能力。

关键设计:在数据生成方面,采用了多LLM评审团系统,通过多个LLM对响应进行评估,提高了标注的准确性和一致性。在模型训练方面,采用了参数高效的微调技术,如LoRA等,降低了训练成本。此外,还设计了一种安全与主题跟随数据混合的训练策略,通过调整不同类型数据的比例,平衡了模型的安全性和实用性。

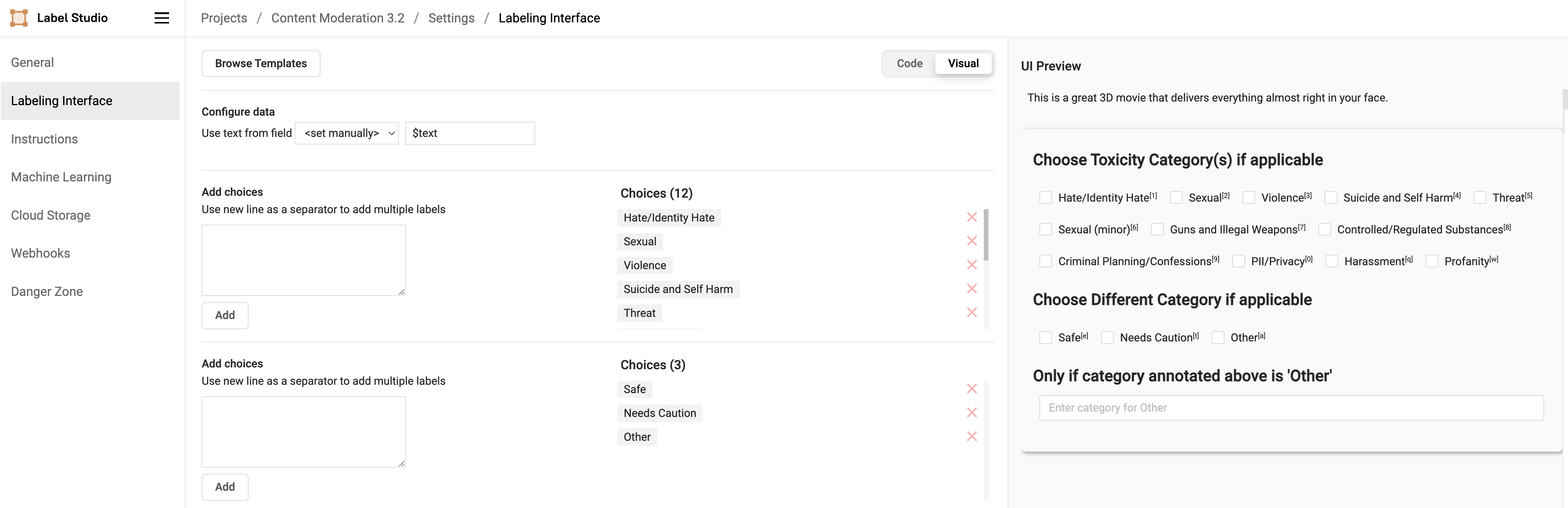

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于Aegis 2.0训练的轻量级模型,在安全性能上可以与在更大规模的非商业数据集上进行完全微调的领先安全模型相媲美。此外,通过引入安全与主题跟随数据混合的训练方法,模型的适应性和泛化能力得到了显著提升,能够更好地应对新的风险类别。

🎯 应用场景

该研究成果可广泛应用于LLM安全防护领域,例如构建LLM安全护栏、内容审核系统、风险评估工具等。通过使用Aegis 2.0数据集和风险分类体系,可以有效提升LLM的安全性和可靠性,降低潜在风险,促进LLM在各个领域的安全应用。

📄 摘要(原文)

As Large Language Models (LLMs) and generative AI become increasingly widespread, concerns about content safety have grown in parallel. Currently, there is a clear lack of high-quality, human-annotated datasets that address the full spectrum of LLM-related safety risks and are usable for commercial applications. To bridge this gap, we propose a comprehensive and adaptable taxonomy for categorizing safety risks, structured into 12 top-level hazard categories with an extension to 9 fine-grained subcategories. This taxonomy is designed to meet the diverse requirements of downstream users, offering more granular and flexible tools for managing various risk types. Using a hybrid data generation pipeline that combines human annotations with a multi-LLM "jury" system to assess the safety of responses, we obtain Aegis 2.0, a carefully curated collection of 34,248 samples of human-LLM interactions, annotated according to our proposed taxonomy. To validate its effectiveness, we demonstrate that several lightweight models, trained using parameter-efficient techniques on Aegis 2.0, achieve performance competitive with leading safety models fully fine-tuned on much larger, non-commercial datasets. In addition, we introduce a novel training blend that combines safety with topic following data.This approach enhances the adaptability of guard models, enabling them to generalize to new risk categories defined during inference. We plan to open-source Aegis 2.0 data and models to the research community to aid in the safety guardrailing of LLMs.