Advancing Student Writing Through Automated Syntax Feedback

作者: Kamyar Zeinalipour, Mehak Mehak, Fatemeh Parsamotamed, Marco Maggini, Marco Gori

分类: cs.CL

发布日期: 2025-01-13

备注: This paper has been accepted for presentation at AIEER 2024

💡 一句话要点

提出Essay-Syntax-Instruct数据集,微调LLM以提升学生写作语法能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语法纠错 大型语言模型 微调 数据集构建 写作辅助

📋 核心要点

- 学生在写作中难以掌握复杂的语法规则,现有方法缺乏针对性的语法反馈机制。

- 构建Essay-Syntax-Instruct数据集,并微调LLM,使其能够提供更准确的语法纠错和指导。

- 实验表明,微调后的LLM在语法纠错方面有显著提升,能有效帮助学生识别和改正语法错误。

📝 摘要(中文)

本研究强调了语法反馈在提升学生语法能力中的关键作用。针对学生在掌握语法细微之处时面临的挑战,我们引入了一个名为Essay-Syntax-Instruct的专用数据集,旨在增强学生对英语语法的理解和应用。利用大型语言模型(LLMs)如GPT3.5-Turbo、Llama-2-7b-chat-hf、Llama-2-13b-chat-hf和Mistral-7B-Instruct-v0.2,本研究开展了一个针对语法改进任务的全面微调过程。通过细致的评估,我们证明了微调后的LLMs在解决语法相关挑战方面表现出显著的改进,从而成为学生识别和纠正语法错误的强大工具。研究结果不仅突出了所提出的数据集在提升LLMs语法增强性能方面的有效性,而且为利用先进语言模型支持语言学习工作开辟了一条有希望的道路。这项研究通过展示LLMs在促进学生语言发展方面的潜力,为更广泛的语言学习技术领域做出了贡献。

🔬 方法详解

问题定义:论文旨在解决学生在英语写作中语法错误频发的问题。现有方法要么是人工批改效率低,要么是自动语法检查工具不够智能,无法提供深入的语法解释和改进建议。因此,学生难以真正理解并改正语法错误。

核心思路:论文的核心思路是利用大型语言模型(LLMs)的强大语言理解和生成能力,通过在专门构建的语法数据集上进行微调,使LLM能够更准确地识别和纠正语法错误,并提供有针对性的语法反馈。这样可以帮助学生更好地理解语法规则,提高写作水平。

技术框架:整体框架包括两个主要部分:一是构建Essay-Syntax-Instruct数据集,该数据集包含学生的作文以及对应的语法错误标注和修改建议;二是使用该数据集对LLM进行微调,使其适应语法纠错任务。具体流程是,首先收集学生的作文,然后由专家进行语法错误标注,并提供修改建议。接着,将这些数据用于微调LLM,使其能够生成类似的语法反馈。

关键创新:论文的关键创新在于构建了一个专门用于语法纠错的Essay-Syntax-Instruct数据集,并利用该数据集对LLM进行微调。与通用数据集相比,该数据集更具针对性,能够更好地提升LLM在语法纠错方面的性能。此外,论文还探索了不同LLM在语法纠错任务中的表现,为选择合适的LLM提供了参考。

关键设计:论文的关键设计包括数据集的构建方式和LLM的微调策略。在数据集构建方面,论文采用了人工标注的方式,保证了标注的准确性。在LLM微调方面,论文采用了监督学习的方式,使用标注好的数据对LLM进行训练,使其能够生成高质量的语法反馈。具体使用的LLM包括GPT3.5-Turbo、Llama-2-7b-chat-hf、Llama-2-13b-chat-hf和Mistral-7B-Instruct-v0.2。损失函数未知,网络结构为对应LLM的原始结构。

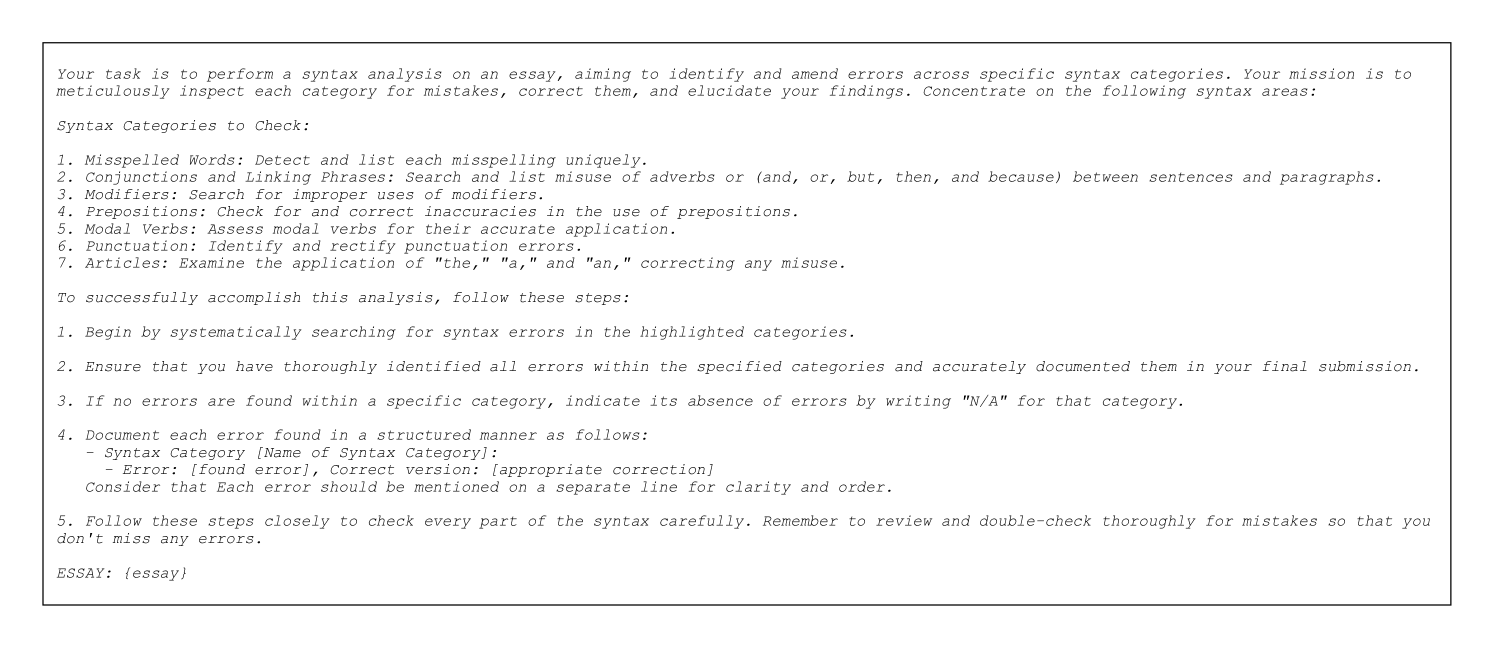

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过Essay-Syntax-Instruct数据集微调后的LLM在语法纠错任务中表现出显著的提升。具体性能数据未知,但论文强调微调后的模型能够更准确地识别和纠正语法错误,并提供更有针对性的语法反馈,有效提升学生的写作能力。

🎯 应用场景

该研究成果可应用于在线教育平台、写作辅助工具和语言学习App等领域,为学生提供个性化的语法指导和反馈,帮助他们提高写作水平。此外,该方法还可以推广到其他语言的学习中,具有广泛的应用前景。

📄 摘要(原文)

This study underscores the pivotal role of syntax feedback in augmenting the syntactic proficiency of students. Recognizing the challenges faced by learners in mastering syntactic nuances, we introduce a specialized dataset named Essay-Syntax-Instruct designed to enhance the understanding and application of English syntax among these students. Leveraging the capabilities of Large Language Models (LLMs) such as GPT3.5-Turbo, Llama-2-7b-chat-hf, Llama-2-13b-chat-hf, and Mistral-7B-Instruct-v0.2, this work embarks on a comprehensive fine-tuning process tailored to the syntax improvement task. Through meticulous evaluation, we demonstrate that the fine-tuned LLMs exhibit a marked improvement in addressing syntax-related challenges, thereby serving as a potent tool for students to identify and rectify their syntactic errors. The findings not only highlight the effectiveness of the proposed dataset in elevating the performance of LLMs for syntax enhancement but also illuminate a promising path for utilizing advanced language models to support language acquisition efforts. This research contributes to the broader field of language learning technology by showcasing the potential of LLMs in facilitating the linguistic development of Students.