Exploring the encoding of linguistic representations in the Fully-Connected Layer of generative CNNs for Speech

作者: Bruno Ferenc Šegedin, Gasper Beguš

分类: cs.CL

发布日期: 2025-01-13

💡 一句话要点

探索语音生成CNN全连接层中语言表征的编码方式

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 语音合成 可解释性 全连接层 卷积神经网络 语言表征 权重分析 ciwGAN

📋 核心要点

- 现有对CNN卷积层的可解释性研究主要集中在计算机视觉领域,音频领域的研究较少,且缺乏对全连接层的深入分析。

- 本文提出两种方法探索语音合成CNN的全连接层,旨在揭示该层如何编码语言学信息,弥补了现有研究的不足。

- 实验结果表明,生成CNN中的词汇特定潜在代码在全连接层权重中具有共享的、词汇不变的亚词汇表征,验证了模型以语言学原理编码词汇信息。

📝 摘要(中文)

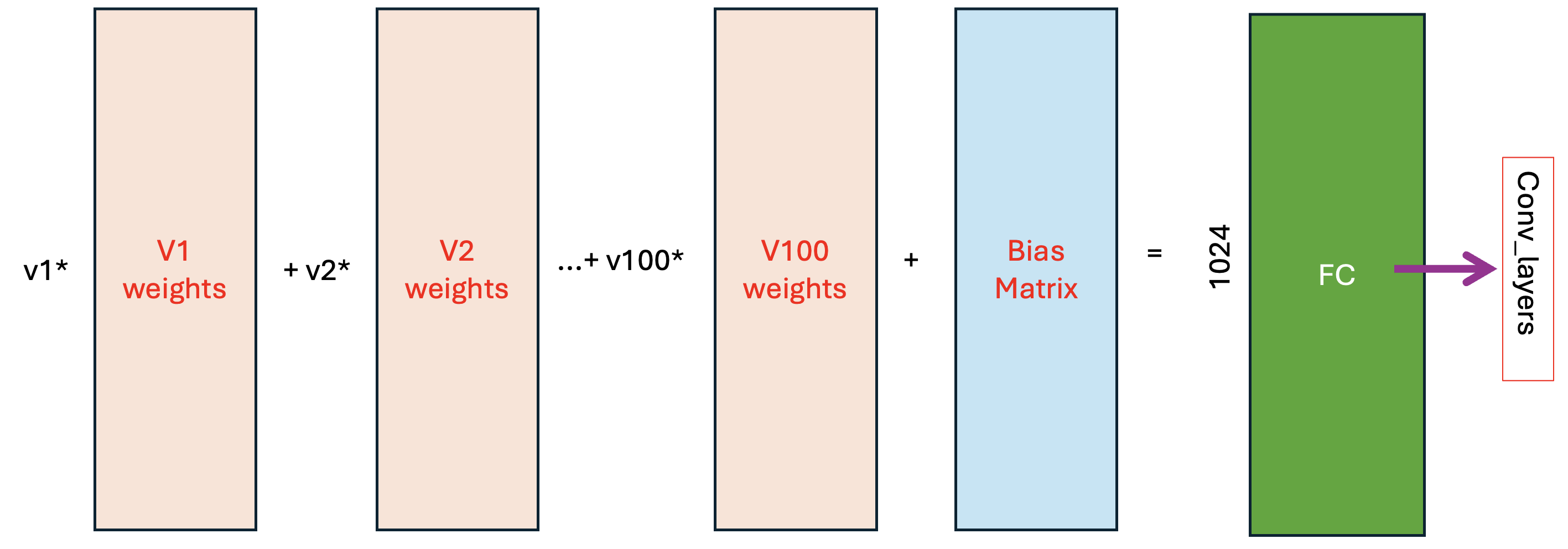

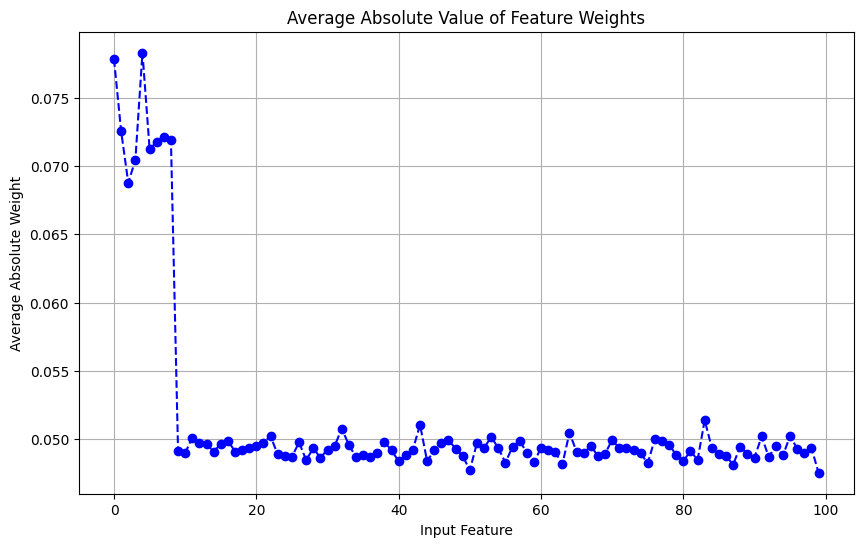

本文首次探索了语音合成CNN的全连接(FC)层如何编码语言相关信息。我们提出了两种探索FC层的方法。在实验1中,我们使用权重矩阵作为卷积层的输入。在实验2中,我们操纵FC层,以探索类符号表征如何在CNN中编码。我们利用FC层输出特征图以及变量特定的权重矩阵在时间上结构化的特点,(1)展示了学习到的权重分布如何在潜在变量之间以系统的方式变化,(2)展示了在保持后续模型参数不变的情况下,操纵FC层如何影响输出。最终,我们提出了一种FC操纵方法,可以输出单个片段。使用该技术,我们表明生成CNN (ciwGAN)中词汇特定的潜在代码在FC层权重中具有共享的词汇不变的亚词汇表征,表明ciwGAN以语言学原理的方式编码词汇信息。

🔬 方法详解

问题定义:现有语音合成CNN的可解释性研究主要集中在卷积层,缺乏对连接潜在空间和卷积层的全连接层如何编码语言信息的深入研究。现有方法难以理解全连接层中语言信息的具体表征方式。

核心思路:本文的核心思路是通过操纵全连接层的权重矩阵,观察其对输出的影响,从而推断全连接层如何编码语言信息。具体来说,利用全连接层输出特征图以及变量特定的权重矩阵在时间上结构化的特点,分析权重分布和操纵权重后的输出变化。

技术框架:本文主要包含两个实验: 1. 权重矩阵作为卷积层输入:将全连接层的权重矩阵作为卷积层的输入,观察其输出,分析权重矩阵中包含的信息。 2. 操纵全连接层:通过操纵全连接层的权重,例如固定部分权重或改变权重分布,观察输出的变化,从而推断全连接层中不同权重的作用。 整体流程是先分析权重分布,然后通过操纵权重来验证分析结果。

关键创新:本文最重要的创新在于提出了一种操纵全连接层的方法,可以输出单个语音片段。通过这种方法,可以更精确地分析全连接层中特定权重对特定语音片段的影响,从而揭示全连接层中语言信息的编码方式。

关键设计:本文的关键设计包括: 1. 权重矩阵的可视化:通过可视化权重矩阵,可以观察到权重分布的模式,为后续的操纵提供依据。 2. 全连接层的操纵策略:设计不同的操纵策略,例如固定部分权重、改变权重分布等,以观察输出的变化。 3. ciwGAN模型的使用:选择ciwGAN作为研究对象,因为它是一种常用的语音合成模型,具有较好的性能和可解释性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ciwGAN的词汇特定潜在代码在全连接层权重中具有共享的、词汇不变的亚词汇表征。通过操纵全连接层,可以输出单个语音片段,并观察到特定权重对特定语音片段的影响,从而验证了模型以语言学原理编码词汇信息。

🎯 应用场景

该研究成果可应用于改进语音合成模型的性能和可控性,例如通过操纵全连接层来控制语音的音色、语速等。此外,该研究也有助于理解深度学习模型内部的表征方式,为开发更可解释的AI系统提供理论基础。

📄 摘要(原文)

Interpretability work on the convolutional layers of CNNs has primarily focused on computer vision, but some studies also explore correspondences between the latent space and the output in the audio domain. However, it has not been thoroughly examined how acoustic and linguistic information is represented in the fully connected (FC) layer that bridges the latent space and convolutional layers. The current study presents the first exploration of how the FC layer of CNNs for speech synthesis encodes linguistically relevant information. We propose two techniques for exploration of the fully connected layer. In Experiment 1, we use weight matrices as inputs into convolutional layers. In Experiment 2, we manipulate the FC layer to explore how symbolic-like representations are encoded in CNNs. We leverage the fact that the FC layer outputs a feature map and that variable-specific weight matrices are temporally structured to (1) demonstrate how the distribution of learned weights varies between latent variables in systematic ways and (2) demonstrate how manipulating the FC layer while holding constant subsequent model parameters affects the output. We ultimately present an FC manipulation that can output a single segment. Using this technique, we show that lexically specific latent codes in generative CNNs (ciwGAN) have shared lexically invariant sublexical representations in the FC-layer weights, showing that ciwGAN encodes lexical information in a linguistically principled manner.