Gender-Neutral Large Language Models for Medical Applications: Reducing Bias in PubMed Abstracts

作者: Elizabeth Schaefer, Kirk Roberts

分类: cs.CL, cs.AI, cs.IR

发布日期: 2025-01-10 (更新: 2025-05-28)

备注: 9 pages, 4 figures

💡 一句话要点

提出MOBERT模型,通过中性化性别代词以减少医学领域LLM的性别偏见。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 性别偏见 大型语言模型 医学领域 BERT模型 数据中性化

📋 核心要点

- 现有医学领域LLM存在性别偏见,影响模型公平性,需要有效缓解。

- 提出MOBERT模型,通过中性化职业代词来训练LLM,减少性别偏见。

- 实验表明,MOBERT模型在包容性代词替换率上显著优于基线模型1965BERT。

📝 摘要(中文)

本文提出了一种用于减轻医学文献中大型语言模型(LLM)性别偏见的流程,通过中性化性别化的职业代词来实现。处理了1965-1980年间379,000篇PubMed摘要的数据集,以识别和修改与职业相关的代词。我们开发了一个基于BERT的模型,名为“通过精细训练消除现代职业偏见”(MOBERT),该模型在这些中性化摘要上进行训练,并将其性能与在原始数据集上训练的“1965BERT”进行了比较。MOBERT实现了70%的包容性替换率,而1965BERT仅达到4%。对MOBERT的进一步分析表明,代词替换的准确性与训练数据中职业术语的频率相关。我们建议扩展数据集并改进流程,以提高性能并确保医学应用中更公平的语言建模。

🔬 方法详解

问题定义:论文旨在解决医学领域大型语言模型(LLM)中存在的性别偏见问题。具体来说,模型在处理医学文献时,可能会将某些职业与特定性别关联起来,导致不公平或不准确的推断。现有方法缺乏有效的中性化机制,无法消除这种偏见。

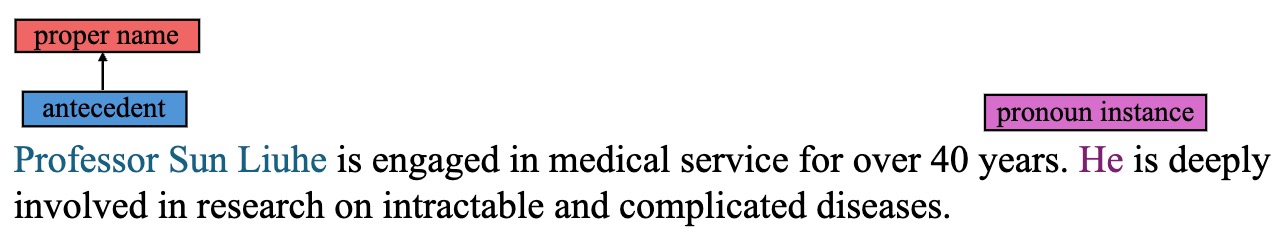

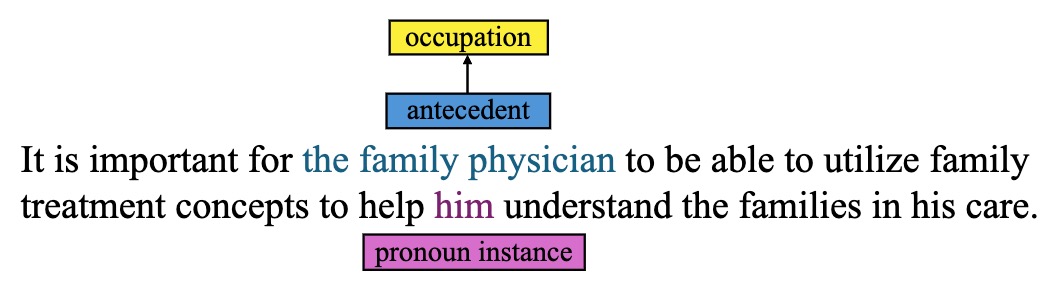

核心思路:论文的核心思路是通过预处理训练数据,将其中带有性别色彩的职业代词替换为中性代词,从而使模型在训练过程中学习到更公平的语言表示。这样,模型在后续应用中就不会将职业与特定性别强行关联。

技术框架:整体流程包括以下几个阶段:1) 数据收集:收集1965-1980年的PubMed摘要数据集。2) 代词识别与替换:识别数据集中与职业相关的性别化代词,并将其替换为中性代词。3) 模型训练:使用中性化后的数据集训练BERT模型,得到MOBERT模型。4) 性能评估:将MOBERT模型与在原始数据集上训练的1965BERT模型进行比较,评估其在代词替换方面的性能。

关键创新:最重要的创新点在于提出了一种简单有效的性别偏见消除方法,即通过预处理训练数据来中性化性别化的职业代词。这种方法不需要修改模型结构或训练目标,易于实现且效果显著。

关键设计:论文使用BERT作为基础模型,并采用了一种精细的训练策略,以确保模型能够有效地学习到中性化的语言表示。具体的技术细节包括:1) 使用大规模的PubMed摘要数据集进行训练。2) 设计了一种自动化的代词识别与替换流程。3) 采用了一种合适的损失函数来优化模型参数。论文中提到“Modern Occupational Bias Elimination with Refined Training”,但具体refined training的细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MOBERT模型在包容性代词替换率方面显著优于基线模型1965BERT,达到了70%的替换率,而1965BERT仅为4%。这表明通过中性化训练数据,可以有效地减少LLM中的性别偏见。此外,研究还发现代词替换的准确性与训练数据中职业术语的频率相关。

🎯 应用场景

该研究成果可应用于医学信息检索、临床决策支持系统等领域,有助于构建更公平、更客观的医学人工智能系统。通过减少性别偏见,可以避免模型在诊断、治疗等方面产生不准确或带有偏见的建议,从而提升医疗服务的质量和公平性。未来,该方法可以推广到其他领域,以消除各种类型的偏见。

📄 摘要(原文)

This paper presents a pipeline for mitigating gender bias in large language models (LLMs) used in medical literature by neutralizing gendered occupational pronouns. A dataset of 379,000 PubMed abstracts from 1965-1980 was processed to identify and modify pronouns tied to professions. We developed a BERT-based model, "Modern Occupational Bias Elimination with Refined Training," or "MOBERT," trained on these neutralized abstracts, and compared its performance with "1965BERT," trained on the original dataset. MOBERT achieved a 70% inclusive replacement rate, while 1965BERT reached only 4%. A further analysis of MOBERT revealed that pronoun replacement accuracy correlated with the frequency of occupational terms in the training data. We propose expanding the dataset and refining the pipeline to improve performance and ensure more equitable language modeling in medical applications.