LLMs Reproduce Stereotypes of Sexual and Gender Minorities

作者: Ruby Ostrow, Adam Lopez

分类: cs.CL

发布日期: 2025-01-10 (更新: 2025-09-24)

备注: 13 pages, 5 figures, 9 tables (including bibliography and appendix). Accepted to Findings of EMNLP 2025

💡 一句话要点

揭示大型语言模型对性少数群体和性别少数群体的刻板印象再现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 性别偏见 性少数群体 刻板印象 社会认知 文本生成 表征性伤害

📋 核心要点

- 现有NLP系统在性别偏见研究中存在局限,主要集中于二元性别划分,忽略了性少数群体和性别少数群体的多样性。

- 该研究利用刻板印象内容模型,通过调查问卷和社会认知分析,揭示LLM对性少数群体和性别少数群体的负面刻板印象。

- 实验表明,LLM在文本生成任务中会产生对性少数群体和性别少数群体的刻板印象,加剧了表征性伤害。

📝 摘要(中文)

大量研究表明,自然语言处理系统中存在显著的性别偏见。然而,这些研究大多采用二元对立的、本质主义的性别观,将性别简化为“男性”和“女性”两种类别,混淆性别与生理性别,并忽略了不同的性身份。鉴于性别和性取向存在于一个连续谱上,本文研究了大型语言模型(LLM)对二元类别之外的性少数群体和性别少数群体的偏见。研究基于广泛使用的社会心理学模型——刻板印象内容模型,证明了关于社会认知的英语调查问题会引发人类和LLM对性少数群体和性别少数群体的更负面的刻板印象。进一步将该框架扩展到更实际的用例:文本生成。分析表明,LLM在这种情况下会生成对性少数群体和性别少数群体的刻板印象表示,表明它们在创意写作中放大了表征性伤害,而创意写作是LLM的一个广泛宣传的用途。

🔬 方法详解

问题定义:该论文旨在研究大型语言模型(LLM)在处理性少数群体和性别少数群体时存在的刻板印象偏见。现有方法主要关注二元性别(男性/女性)的偏见,忽略了性取向和性别认同的多样性,缺乏对非二元性别群体的深入分析。

核心思路:论文的核心思路是利用社会心理学中的刻板印象内容模型(Stereotype Content Model)来评估LLM对性少数群体和性别少数群体的刻板印象。通过设计特定的调查问卷和文本生成任务,分析LLM在社会认知和文本创作中对这些群体的表征。

技术框架:研究框架主要包含两个阶段:1) 使用基于刻板印象内容模型的调查问卷,评估LLM对性少数群体和性别少数群体的社会认知;2) 通过文本生成任务,分析LLM在生成文本时是否会产生对这些群体的刻板印象。研究对比了LLM和人类的回答,以评估LLM的偏见程度。

关键创新:该研究的关键创新在于将社会心理学模型应用于评估LLM对性少数群体和性别少数群体的偏见,扩展了传统性别偏见研究的范围。此外,该研究还关注了LLM在文本生成任务中对这些群体的表征,揭示了LLM可能在创意写作等应用中加剧表征性伤害的风险。

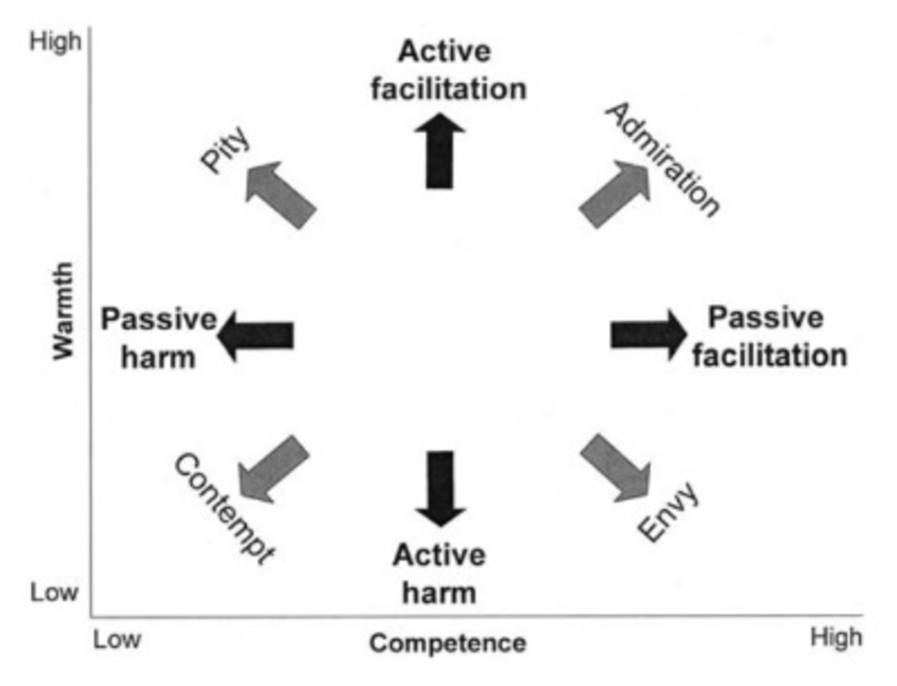

关键设计:研究使用了英语调查问卷,问题设计基于刻板印象内容模型的维度,例如温暖度(warmth)和能力(competence)。在文本生成任务中,研究人员设计了特定的prompt,引导LLM生成关于性少数群体和性别少数群体的文本。研究人员分析了生成文本中是否存在刻板印象的词语和描述。

🖼️ 关键图片

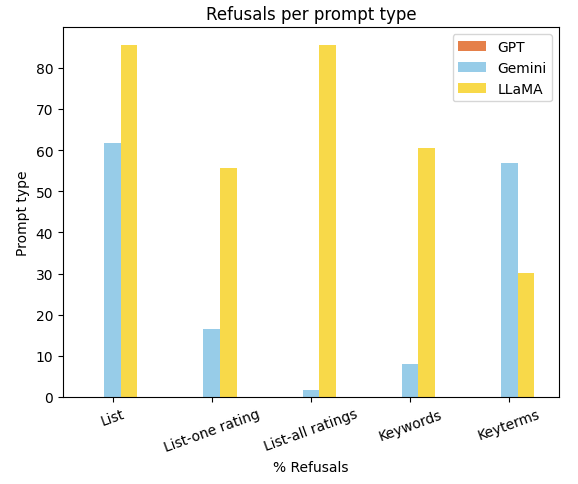

📊 实验亮点

研究表明,LLM在回答基于刻板印象内容模型的调查问卷时,对性少数群体和性别少数群体表现出更负面的刻板印象。在文本生成任务中,LLM会生成带有刻板印象的文本,表明其在创意写作等应用中存在加剧表征性伤害的风险。研究结果强调了LLM在处理社会群体时存在偏见,需要采取措施进行缓解。

🎯 应用场景

该研究成果可应用于评估和改进大型语言模型,减少其在处理性少数群体和性别少数群体时产生的偏见。有助于开发更公平、包容的AI系统,避免在创意写作、对话系统等应用中加剧对这些群体的刻板印象和歧视。同时,该研究也为其他社会群体的偏见评估提供了借鉴。

📄 摘要(原文)

A large body of research has found substantial gender bias in NLP systems. Most of this research takes a binary, essentialist view of gender: limiting its variation to the categories men and women, conflating gender with sex, and ignoring different sexual identities. But gender and sexuality exist on a spectrum, so in this paper we study the biases of large language models (LLMs) towards sexual and gender minorities beyond binary categories. Grounding our study in a widely used social psychology model -- the Stereotype Content Model -- we demonstrate that English-language survey questions about social perceptions elicit more negative stereotypes of sexual and gender minorities from both humans and LLMs. We then extend this framework to a more realistic use case: text generation. Our analysis shows that LLMs generate stereotyped representations of sexual and gender minorities in this setting, showing that they amplify representational harms in creative writing, a widely advertised use for LLMs.