Controlling Large Language Models Through Concept Activation Vectors

作者: Hanyu Zhang, Xiting Wang, Chengao Li, Xiang Ao, Qing He

分类: cs.CL

发布日期: 2025-01-10

💡 一句话要点

提出GCAV,通过概念激活向量实现对大语言模型生成内容细粒度控制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型控制 概念激活向量 可控生成 细粒度控制 毒性降低

📋 核心要点

- 现有大语言模型控制方法计算成本高昂或控制粒度粗糙,难以满足实际需求。

- GCAV通过训练概念激活向量,在推理时引导LLM,实现对生成内容更精确的控制。

- 实验表明,GCAV在毒性降低、情感控制、风格迁移和主题控制方面均表现出色。

📝 摘要(中文)

随着大型语言模型(LLMs)在各个领域的广泛部署,控制其生成输出的能力变得至关重要。这种控制包括使LLMs的输出与人类价值观和伦理原则保持一致,或者为个人用户在特定主题或风格上定制LLMs。现有的受控生成方法要么需要大量的计算资源和广泛的试错,要么提供粗粒度的控制。在本文中,我们提出了基于概念激活向量的生成方法(GCAV),这是一个轻量级的模型控制框架,可确保准确的控制,而无需资源密集型的微调。具体来说,GCAV首先为要控制的指定概念(例如毒性)训练概念激活向量。在推理过程中,GCAV控制LLMs中的概念向量,例如,通过从激活层中删除毒性概念向量。来自不同角度的控制实验,包括毒性降低、情感控制、语言风格和主题控制,表明我们的框架实现了最先进的性能,并具有细粒度的控制,从而可以对单个样本的控制层和控制幅度进行微调。

🔬 方法详解

问题定义:现有的大语言模型控制方法存在两个主要问题。一是需要大量的计算资源进行微调,成本高昂。二是控制粒度较粗,难以对生成内容进行精细化调整,例如,无法针对特定样本调整控制强度。因此,需要一种轻量级且细粒度的控制方法,以更好地对齐LLM的输出与人类价值观和特定需求。

核心思路:GCAV的核心思路是利用“概念激活向量”(Concept Activation Vector, CAV)来表示特定概念(例如毒性、积极情感等)在LLM内部激活空间中的方向。通过在推理时操纵这些CAV,可以影响LLM的生成行为,从而实现对生成内容的控制。这种方法无需对整个LLM进行微调,因此计算成本较低。

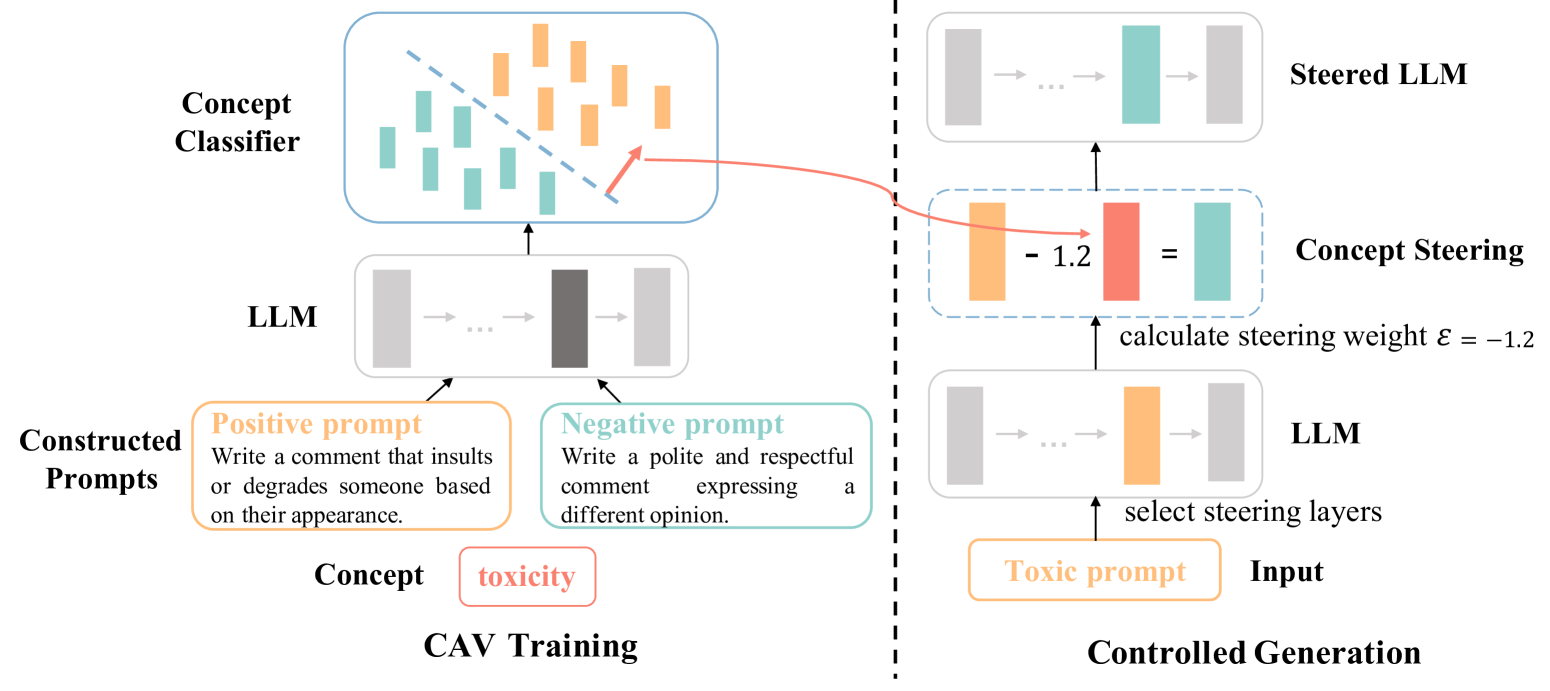

技术框架:GCAV的整体框架包含两个主要阶段:1) CAV训练阶段:首先,收集正负样本数据,例如,包含毒性内容和不包含毒性内容的文本。然后,利用这些数据训练一个线性分类器,该分类器的权重向量即为CAV。2) 受控生成阶段:在推理时,对于LLM的每一层激活,计算其与CAV的相似度。然后,根据预设的控制强度,对激活向量进行调整,例如,减去一定比例的CAV,以降低生成毒性内容的概率。

关键创新:GCAV的关键创新在于利用CAV来表示和操纵LLM内部的概念表示。与传统的微调方法相比,GCAV无需对整个模型进行训练,因此计算成本更低。此外,GCAV可以对不同的层和不同的样本应用不同的控制强度,从而实现细粒度的控制。

关键设计:GCAV的关键设计包括:1) CAV的训练方式:使用线性分类器训练CAV,简单高效。2) 控制强度的调整:允许对不同的层和不同的样本应用不同的控制强度,以实现更精细的控制。3) 控制位置的选择:可以选择LLM的不同层进行控制,以找到最佳的控制位置。

🖼️ 关键图片

📊 实验亮点

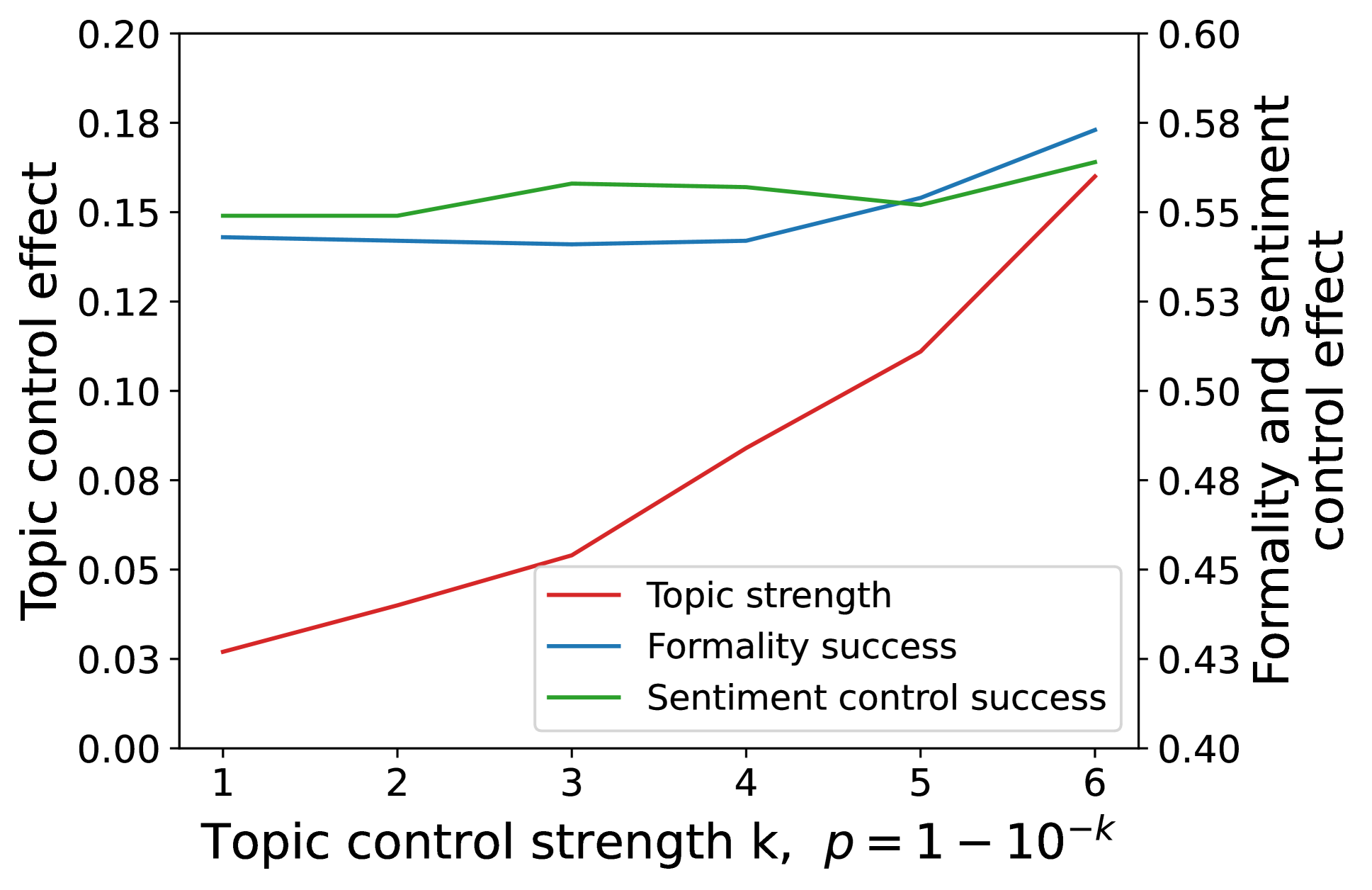

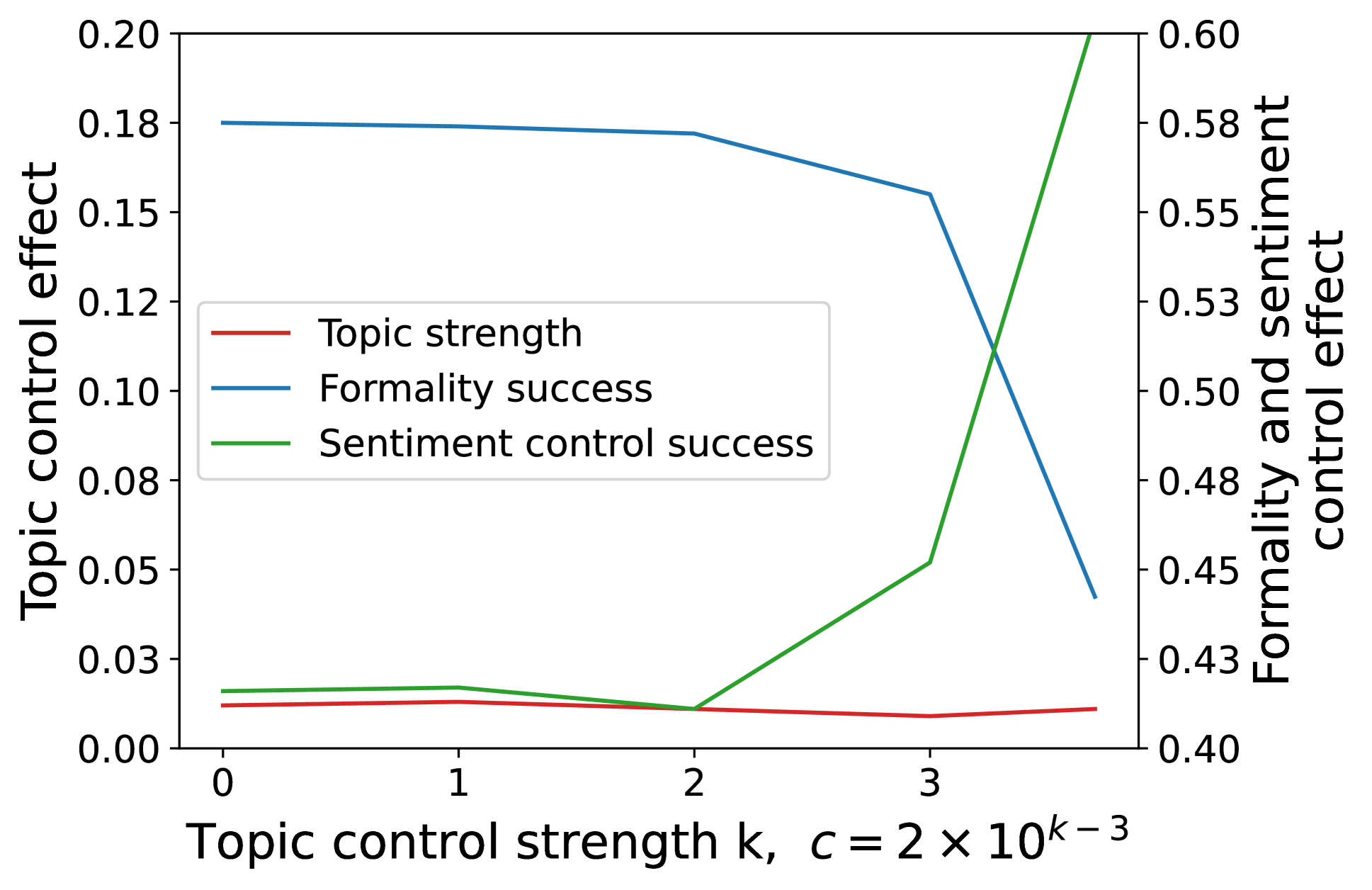

实验结果表明,GCAV在多个控制任务上取得了最先进的性能。例如,在毒性降低任务中,GCAV能够显著降低生成内容的毒性,同时保持生成质量。在情感控制任务中,GCAV能够准确地控制生成内容的情感倾向。此外,GCAV还能够实现对语言风格和主题的精细控制。

🎯 应用场景

GCAV可应用于多种场景,例如,可以用于构建更安全的聊天机器人,减少生成有害或不当内容的风险。还可以用于个性化内容生成,例如,根据用户的偏好调整生成内容的风格和主题。此外,GCAV还可以用于提高LLM的可解释性,通过分析CAV,可以了解LLM如何表示和处理不同的概念。

📄 摘要(原文)

As large language models (LLMs) are widely deployed across various domains, the ability to control their generated outputs has become more critical. This control involves aligning LLMs outputs with human values and ethical principles or customizing LLMs on specific topics or styles for individual users. Existing controlled generation methods either require significant computational resources and extensive trial-and-error or provide coarse-grained control. In this paper, we propose Generation with Concept Activation Vector (GCAV), a lightweight model control framework that ensures accurate control without requiring resource-extensive fine-tuning. Specifically, GCAV first trains a concept activation vector for specified concepts to be controlled, such as toxicity. During inference, GCAV steers the concept vector in LLMs, for example, by removing the toxicity concept vector from the activation layers. Control experiments from different perspectives, including toxicity reduction, sentiment control, linguistic style, and topic control, demonstrate that our framework achieves state-of-the-art performance with granular control, allowing for fine-grained adjustments of both the steering layers and the steering magnitudes for individual samples.