Enhancing Human-Like Responses in Large Language Models

作者: Ethem Yağız Çalık, Talha Rüzgar Akkuş

分类: cs.CL, cs.AI

发布日期: 2025-01-09

💡 一句话要点

提升大型语言模型人情味:融合心理学与多样化数据微调

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 人情味 情感智能 心理学 微调 自然语言理解 对话连贯性

📋 核心要点

- 现有大型语言模型在自然语言理解、对话连贯性和情感表达方面仍有提升空间,难以完全模拟人类的交互体验。

- 通过融合心理学原理,并利用多样化的数据集对大型语言模型进行微调,使其更好地模仿人类的推理模式和情感表达。

- 实验结果表明,该方法能够有效提升用户交互体验,并为AI在不同领域的应用带来新的机遇。

📝 摘要(中文)

本文探讨了如何提升大型语言模型(LLM)的人情味。研究重点在于增强AI系统中的自然语言理解、对话连贯性和情感智能。论文评估了多种方法,包括使用多样化数据集进行微调、融入心理学原理以及设计能够更好模仿人类推理模式的模型。研究结果表明,这些改进不仅改善了用户交互,还为AI在不同领域的应用开辟了新的可能性。未来的工作将解决这些类人属性所带来的伦理影响和潜在偏见。

🔬 方法详解

问题定义:现有的大型语言模型在生成回复时,往往缺乏人类的自然性和情感,导致用户体验不佳。痛点在于模型难以理解人类的微妙情感和推理过程,回复显得生硬和不连贯。

核心思路:本文的核心思路是通过融合心理学原理和多样化的数据集,对大型语言模型进行微调,使其能够更好地理解和模拟人类的思维模式和情感表达。这样设计的目的是让模型在生成回复时更具人情味,从而提升用户体验。

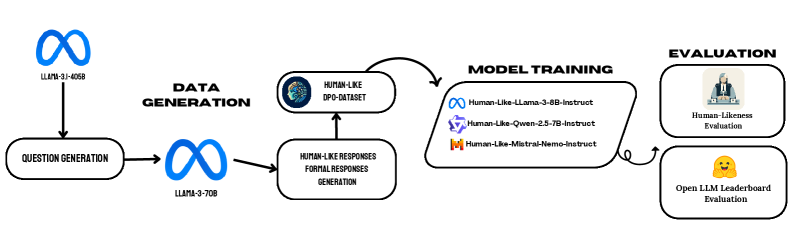

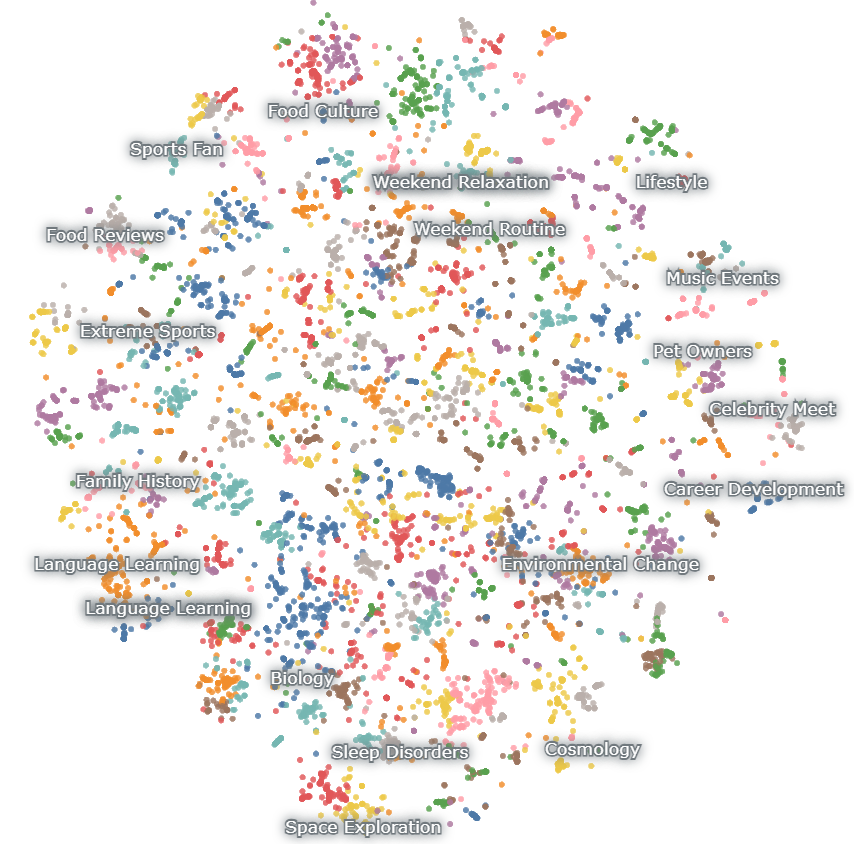

技术框架:该研究的技术框架主要包括以下几个阶段:1) 数据收集:收集包含丰富情感和推理信息的多样化数据集。2) 模型微调:利用收集到的数据集,结合心理学原理,对大型语言模型进行微调。3) 评估:通过用户交互实验和自动评估指标,评估模型的性能。

关键创新:最重要的技术创新点在于将心理学原理融入到大型语言模型的训练过程中。通过模拟人类的认知过程和情感表达方式,使模型能够更好地理解和回应人类的需求。与现有方法相比,该方法更注重模型的内在机制,而非仅仅依赖于大量的数据。

关键设计:关键设计包括:1) 数据集的选择:选择包含丰富情感和推理信息的数据集,例如对话记录、小说、电影剧本等。2) 心理学原理的应用:将心理学中的情感理论、认知理论等融入到模型的训练过程中,例如使用情感分类器来识别文本中的情感,并将其作为模型的输入。3) 损失函数的设计:设计能够更好地反映模型人情味的损失函数,例如使用对比学习来鼓励模型生成更具情感色彩的回复。

🖼️ 关键图片

📊 实验亮点

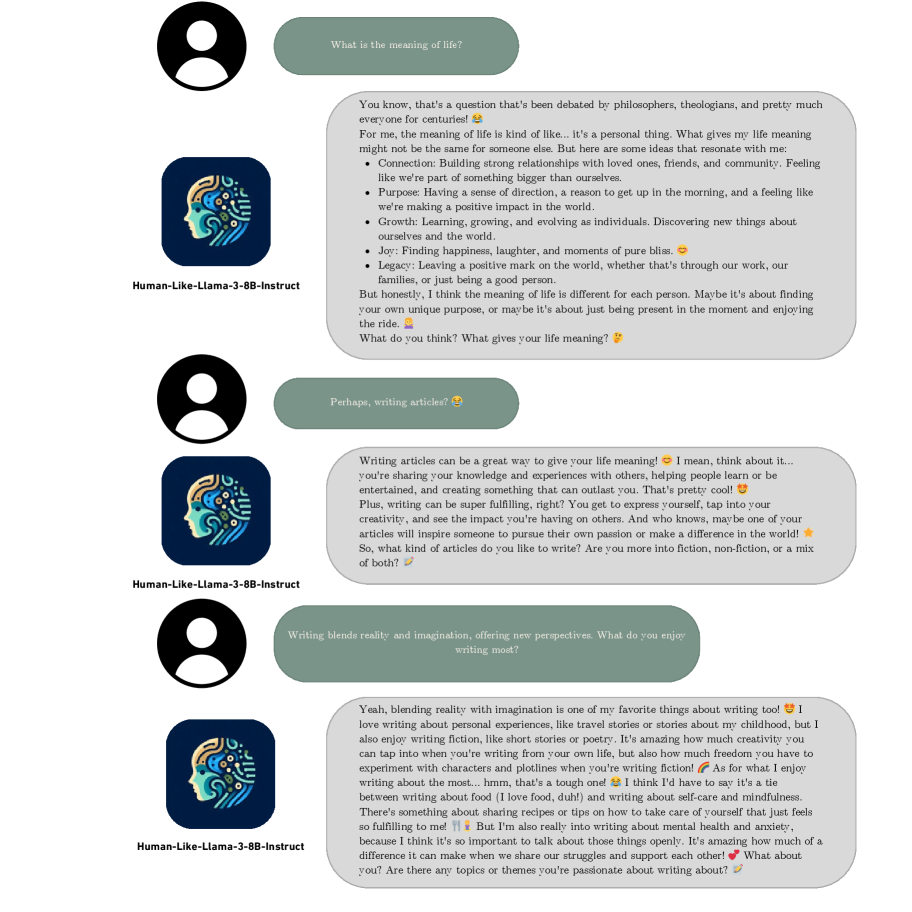

研究结果表明,通过融合心理学原理和多样化数据集进行微调,大型语言模型在自然语言理解、对话连贯性和情感表达方面均有显著提升。具体性能数据未知,但用户交互实验表明,用户对模型的回复满意度明显提高,认为模型更具人情味。

🎯 应用场景

该研究成果可应用于智能客服、虚拟助手、社交机器人等领域,提升人机交互的自然性和流畅性。通过赋予AI系统更强的情感理解和表达能力,可以改善用户体验,增强用户粘性,并为AI在心理咨询、教育等领域的应用提供新的可能性。

📄 摘要(原文)

This paper explores the advancements in making large language models (LLMs) more human-like. We focus on techniques that enhance natural language understanding, conversational coherence, and emotional intelligence in AI systems. The study evaluates various approaches, including fine-tuning with diverse datasets, incorporating psychological principles, and designing models that better mimic human reasoning patterns. Our findings demonstrate that these enhancements not only improve user interactions but also open new possibilities for AI applications across different domains. Future work will address the ethical implications and potential biases introduced by these human-like attributes.