Step-by-Step Mastery: Enhancing Soft Constraint Following Ability of Large Language Models

作者: Qingyu Ren, Jie Zeng, Qianyu He, Jiaqing Liang, Yanghua Xiao, Weikang Zhou, Zeye Sun, Fei Yu

分类: cs.CL, cs.AI

发布日期: 2025-01-09 (更新: 2025-05-31)

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于DPO和课程学习的框架,提升LLM对软约束的遵循能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 软约束遵循 直接偏好优化 课程学习 指令学习

📋 核心要点

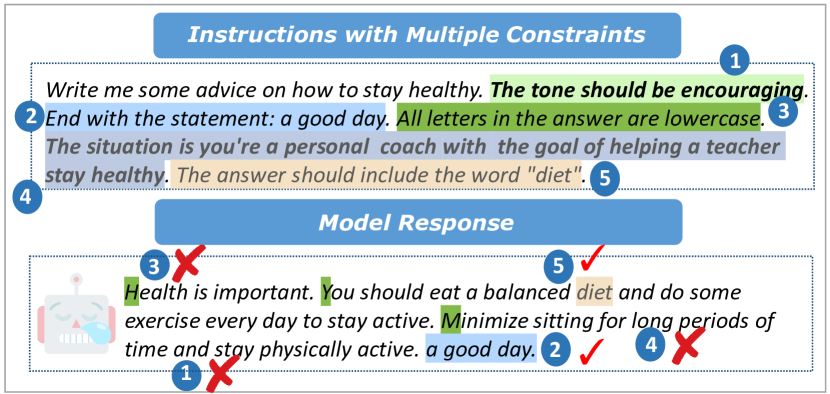

- 现有大型语言模型在遵循多约束指令方面存在不足,尤其是在软约束场景下,缺乏有效提升LLM软约束遵循能力的方法。

- 论文提出一种基于数据自动构建pipeline、直接偏好优化(DPO)和课程学习的训练框架,以提升LLM对软约束的遵循能力。

- 实验结果表明,该方法能够有效提高LLM在软约束遵循方面的性能,并分析了约束数量等因素对模型性能的影响。

📝 摘要(中文)

大型语言模型(LLMs)遵循包含多个约束的指令至关重要。然而,增强LLMs遵循软约束的能力是一个尚未充分探索的领域。为了弥补这一差距,我们首先设计了一个pipeline来自动构建具有高质量输出的数据集。此外,为了充分利用数据构建过程中生成的正负样本,我们选择直接偏好优化(DPO)作为训练方法。更进一步,考虑到软约束的难度由约束的数量决定,我们设计了一种基于约束数量的课程学习训练范式。我们通过实验评估了我们的方法在提高LLMs软约束遵循能力方面的有效性,并分析了推动改进的因素。数据集和代码已公开发布在https://github.com/Rainier-rq/FollowSoftConstraint。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在遵循软约束指令时表现不佳的问题。现有的方法通常难以有效地处理多个软约束,导致生成的结果不符合用户的期望。这种不足限制了LLMs在实际应用中的灵活性和可靠性。

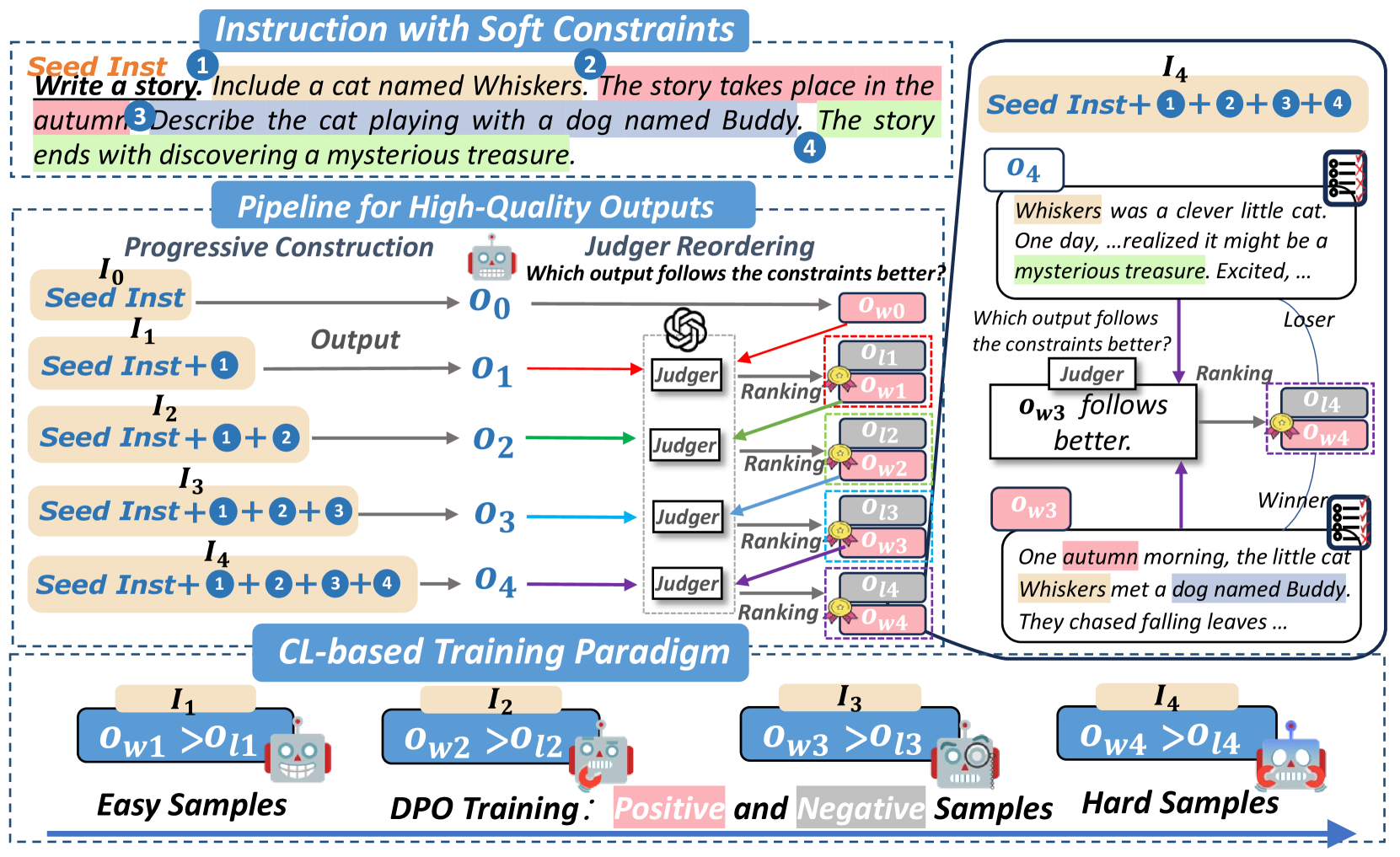

核心思路:论文的核心思路是通过自动构建高质量数据集、利用直接偏好优化(DPO)算法进行训练,并结合课程学习策略,逐步提升LLMs遵循软约束的能力。DPO算法能够有效地利用正负样本信息,而课程学习则能够根据约束数量的难易程度,循序渐进地训练模型。

技术框架:整体框架包含三个主要阶段:1) 数据集构建pipeline,用于自动生成包含多个软约束的高质量数据集;2) 基于DPO的训练阶段,利用生成的数据集对LLM进行训练,优化模型对软约束的偏好;3) 课程学习阶段,根据约束数量的难易程度,逐步增加训练难度,提升模型的泛化能力。

关键创新:论文的关键创新在于结合了数据自动构建、DPO训练和课程学习三种技术,形成了一个完整的解决方案。数据自动构建保证了训练数据的质量和多样性,DPO算法能够有效地学习软约束的偏好,而课程学习则能够提升模型的泛化能力。这种结合使得模型能够更好地遵循复杂的软约束指令。

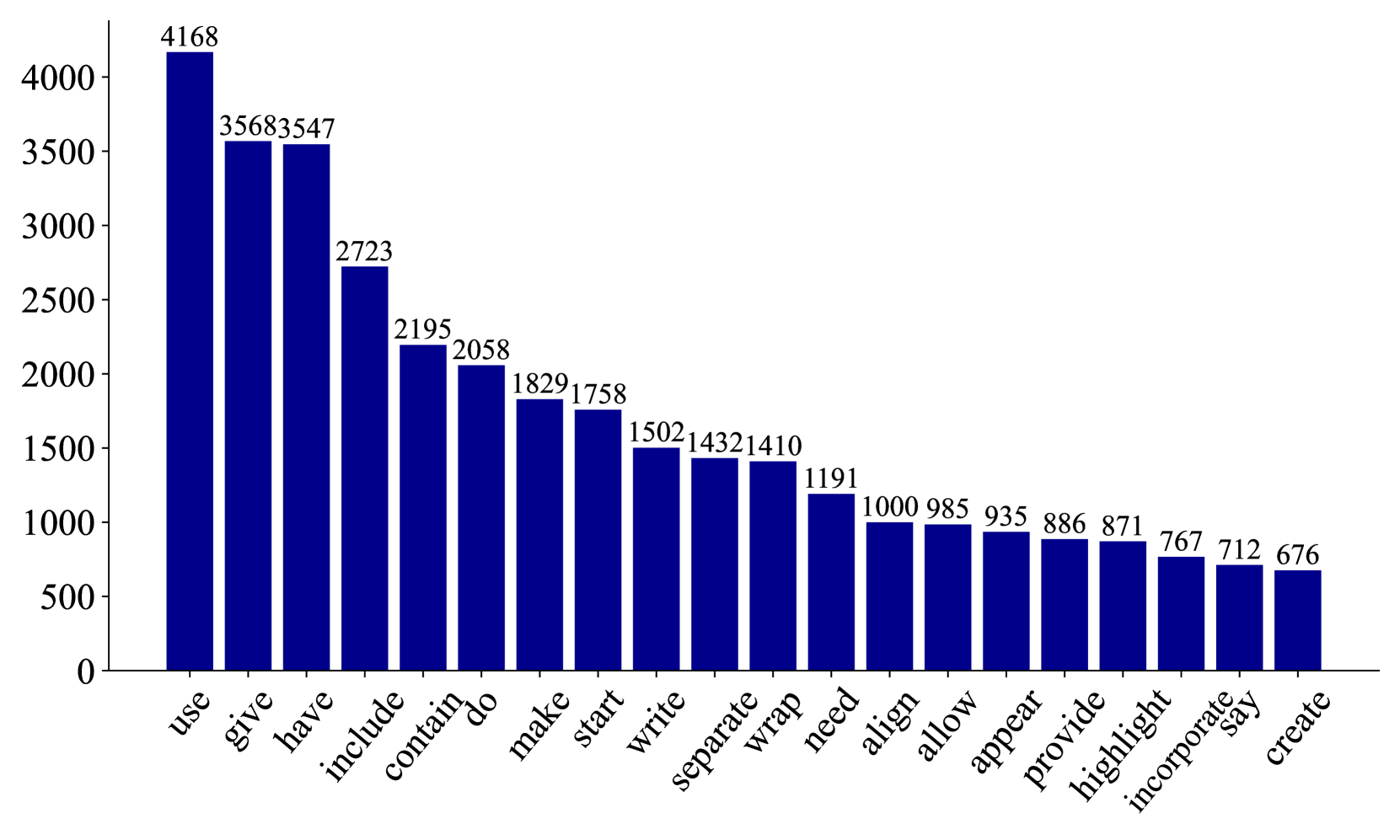

关键设计:在数据构建方面,设计了特定的prompt模板和过滤规则,以保证生成数据的质量。在DPO训练方面,选择了合适的奖励函数,以区分正负样本的优劣。在课程学习方面,根据约束数量将训练数据划分为不同的难度级别,并设计了相应的训练策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够显著提高LLM在软约束遵循方面的性能。具体而言,在多个评估指标上,该方法都优于现有的基线方法,并且随着约束数量的增加,性能提升更加明显。例如,在某个特定数据集上,该方法相对于基线方法,在约束遵循准确率方面提升了10%以上。

🎯 应用场景

该研究成果可应用于各种需要LLM遵循复杂约束的场景,例如智能客服、内容生成、任务规划等。通过提升LLM对软约束的遵循能力,可以提高生成结果的质量和用户满意度,从而拓展LLM的应用范围和实际价值。未来,该方法可以进一步推广到其他类型的约束遵循任务中。

📄 摘要(原文)

It is crucial for large language models (LLMs) to follow instructions that involve multiple constraints. However, it is an unexplored area to enhance LLMs' ability to follow soft constraints. To bridge the gap, we initially design a pipeline to construct datasets with high-quality outputs automatically. Additionally, to fully utilize the positive and negative samples generated during the data construction process, we choose Direct Preference Optimization (DPO) as the training method. Furthermore, taking into account the difficulty of soft constraints indicated by the number of constraints, we design a curriculum learning training paradigm based on the constraint quantity. We experimentally evaluate the effectiveness of our methods in improving LLMs' soft constraint following ability and analyze the factors driving the improvements.The datasets and code are publicly available at https://github.com/Rainier-rq/FollowSoftConstraint.