Understanding Before Reasoning: Enhancing Chain-of-Thought with Iterative Summarization Pre-Prompting

作者: Dong-Hai Zhu, Yu-Jie Xiong, Jia-Chen Zhang, Xi-Jiong Xie, Chun-Ming Xia

分类: cs.CL

发布日期: 2025-01-08 (更新: 2025-09-24)

🔗 代码/项目: GITHUB

💡 一句话要点

提出迭代摘要预提示(ISP^2)方法,提升LLM在隐式信息下的推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 链式思考 预提示 迭代摘要 知识推理

📋 核心要点

- 现有CoT方法在处理隐式或缺失关键信息的推理任务时表现不佳,因为其侧重于推理步骤而忽略了信息提取。

- ISP^2方法通过迭代地提取、评估和合并信息,形成关键信息对,并将其作为预提示输入LLM,以增强推理能力。

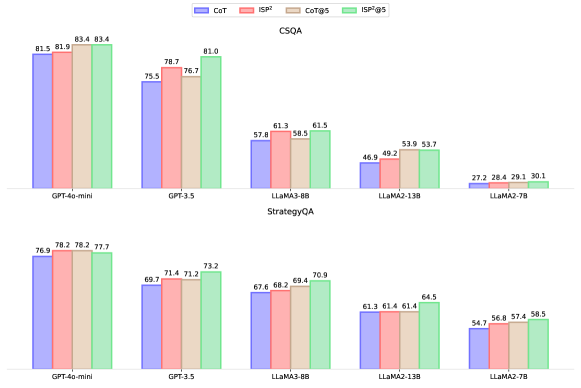

- 实验结果表明,ISP^2方法在推理任务上相比现有方法有显著提升,性能提高了7.1%。

📝 摘要(中文)

Chain-of-Thought (CoT) Prompting 是大型语言模型 (LLM) 中增强复杂推理的主流范例。它引导 LLM 呈现多步推理,而不是直接生成最终答案。然而,当推理所需的关键信息是隐式的或缺失时,CoT 会遇到困难。这是因为 CoT 强调推理步骤的顺序,而忽略了早期对必要信息的提取。我们提出了一种名为迭代摘要预提示 (ISP^2) 的预提示方法,用于在未明确提供关键信息时改进 LLM 推理。首先,提取实体及其对应的描述以形成潜在的关键信息对。接下来,我们使用可靠性评级来评估这些信息对,然后将两个排名最低的信息对合并为一个新的实体描述。重复此过程,直到获得唯一的关键信息对。最后,将该信息对连同原始问题一起输入到 LLM 中以生成答案。大量实验表明,与现有方法相比,性能提高了 7.1%。与传统的提示不同,ISP^2 采用带有预提示的归纳方法,可灵活地集成到各种推理框架中。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在使用Chain-of-Thought (CoT) prompting进行复杂推理时,由于关键信息隐式或缺失而导致的性能下降问题。现有的CoT方法主要关注推理步骤的连贯性,而忽略了对问题中隐含信息的有效提取和利用,导致在信息不完整的情况下推理效果不佳。

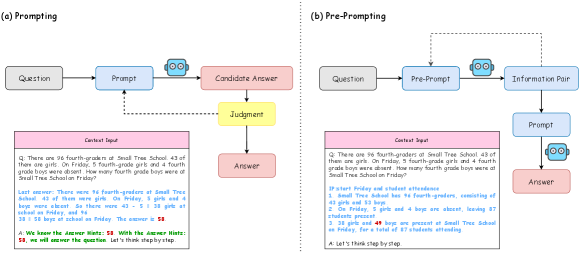

核心思路:论文的核心思路是采用预提示(pre-prompting)的方式,在进行CoT推理之前,先通过迭代摘要的方法提取和提炼关键信息,形成一个明确的关键信息对,然后将该信息对作为上下文提供给LLM,辅助其进行推理。这种方式将信息提取和推理过程解耦,使得LLM能够更好地利用问题中隐含的信息。

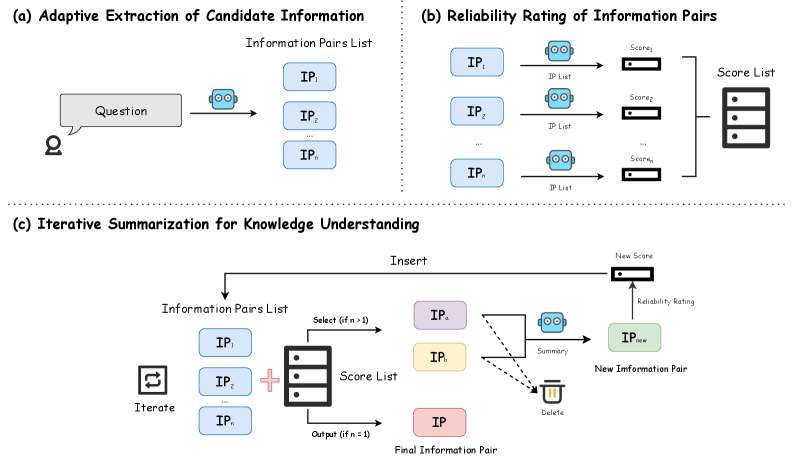

技术框架:ISP^2方法主要包含以下几个阶段:1) 实体提取:从问题描述中提取实体及其相关描述,形成多个潜在的关键信息对;2) 可靠性评估:对每个关键信息对进行可靠性评估,例如通过LLM进行打分;3) 迭代合并:将可靠性最低的两个信息对进行合并,生成新的信息对,重复此过程直到只剩下一个信息对;4) 预提示与推理:将最终的关键信息对与原始问题一起作为LLM的输入,进行CoT推理并生成答案。

关键创新:ISP^2的关键创新在于其迭代摘要预提示的框架。与传统的直接进行CoT prompting的方法不同,ISP^2采用了一种归纳式的预处理方法,通过迭代地提炼信息,逐步逼近问题的核心关键信息。这种方法能够有效地处理信息不完整或隐式的情况,提升LLM的推理能力。

关键设计:在可靠性评估阶段,可以使用LLM对每个信息对进行打分,例如使用“这个信息对对于解决问题有多大帮助?”这样的prompt,让LLM输出一个置信度分数。在迭代合并阶段,可以使用简单的文本拼接方法将两个信息对合并成一个新的信息对。具体的迭代次数和合并策略可以根据实际情况进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ISP^2方法在多个推理数据集上取得了显著的性能提升。与现有的CoT prompting方法相比,ISP^2方法平均提升了7.1%的准确率。这表明ISP^2方法能够有效地提取和利用问题中的关键信息,从而提升LLM的推理能力。

🎯 应用场景

ISP^2方法可以应用于各种需要复杂推理的场景,尤其是在信息不完整或存在歧义的情况下。例如,可以用于问答系统、知识图谱推理、医疗诊断辅助等领域。该方法能够提升LLM在这些场景下的准确性和可靠性,具有广泛的应用前景。

📄 摘要(原文)

Chain-of-Thought (CoT) Prompting is a dominant paradigm in Large Language Models (LLMs) to enhance complex reasoning. It guides LLMs to present multi-step reasoning, rather than generating the final answer directly. However, CoT encounters difficulties when key information required for reasoning is implicit or missing. This occurs because CoT emphasizes the sequence of reasoning steps while overlooking the early extraction of essential information. We propose a pre-prompting method called Iterative Summarization Pre-Prompting (ISP^2) to refine LLM reasoning when key information is not explicitly provided. First, entities and their corresponding descriptions are extracted to form potential key information pairs. Next, we use a reliability rating to assess these pairs, then merge the two lowest-ranked pairs into a new entity description. This process is repeated until a unique key information pair is obtained. Finally, that pair, along with the original question, is fed into LLMs to produce the answer. Extensive experiments demonstrate a 7.1% improvement compared to existing methods. Unlike traditional prompting, ISP^2 adopts an inductive approach with pre-prompting, offering flexible integration into diverse reasoning frameworks. The code is available at https://github.com/zdhgreat/ISP-2.