Improving Dialectal Slot and Intent Detection with Auxiliary Tasks: A Multi-Dialectal Bavarian Case Study

作者: Xaver Maria Krückl, Verena Blaschke, Barbara Plank

分类: cs.CL

发布日期: 2025-01-07

备注: VarDial @ COLING 2025

💡 一句话要点

利用辅助任务改进方言槽位和意图检测:以巴伐利亚方言为例

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 槽位意图检测 方言处理 辅助任务学习 迁移学习 自然语言理解

📋 核心要点

- 方言数据稀缺且无标准化形式,导致现有SID模型在方言上的表现不佳,零样本迁移学习是潜在解决方案。

- 论文提出利用辅助任务来提升方言SID性能,比较了联合多任务学习和中间任务训练,以及不同类型的辅助任务。

- 实验表明,辅助任务对槽位填充的提升更明显,NER效果最佳,中间任务训练更稳定,整体性能显著提升。

📝 摘要(中文)

可靠的槽位和意图检测(SID)在自然语言理解中至关重要,例如在数字助理等应用中。在大量资源语言上微调的仅编码器Transformer模型通常在SID上表现良好。然而,它们在方言数据上表现不佳,因为方言数据没有标准化形式,并且训练数据稀缺且生产成本高昂。我们探索了SID的零样本迁移学习,重点关注多种巴伐利亚方言,并为此发布了慕尼黑方言的新数据集。我们评估了在巴伐利亚语辅助任务上训练的模型,并将联合多任务学习与中间任务训练进行了比较。我们还比较了三种类型的辅助任务:token级别的句法任务、命名实体识别(NER)和语言建模。我们发现,包含的辅助任务对槽位填充比意图分类有更积极的影响(其中NER的影响最为积极),并且中间任务训练产生了更一致的性能提升。我们表现最佳的方法将巴伐利亚方言的意图分类性能提高了5.1个百分点,槽位填充F1提高了8.4个百分点。

🔬 方法详解

问题定义:论文旨在解决方言场景下槽位和意图检测(SID)任务的性能瓶颈。现有方法在处理高资源语言时表现良好,但由于方言数据匮乏、缺乏标准化形式,直接应用这些方法效果不佳,需要探索新的迁移学习策略。

核心思路:论文的核心思路是利用辅助任务来提升方言SID的性能。通过在相关但更易获取或标注的数据上训练模型,学习通用的语言表示,然后将这些表示迁移到目标方言的SID任务上,从而缓解数据稀缺问题。

技术框架:整体框架包括预训练阶段和微调阶段。在预训练阶段,模型在辅助任务上进行训练,学习语言表示。在微调阶段,将预训练的模型迁移到目标方言的SID任务上进行微调。论文比较了两种训练策略:联合多任务学习(同时训练SID和辅助任务)和中间任务训练(先训练辅助任务,再训练SID)。

关键创新:论文的关键创新在于系统性地研究了不同类型的辅助任务对巴伐利亚方言SID的影响,并比较了不同的训练策略。具体来说,论文考察了token级别的句法任务、命名实体识别(NER)和语言建模三种辅助任务,以及联合多任务学习和中间任务训练两种训练策略。

关键设计:论文的关键设计包括:1) 选择了三种不同类型的辅助任务,覆盖了句法、语义和语言建模等多个方面;2) 比较了联合多任务学习和中间任务训练两种训练策略,探索了不同策略对性能的影响;3) 发布了慕尼黑方言的新数据集,为后续研究提供了基准。

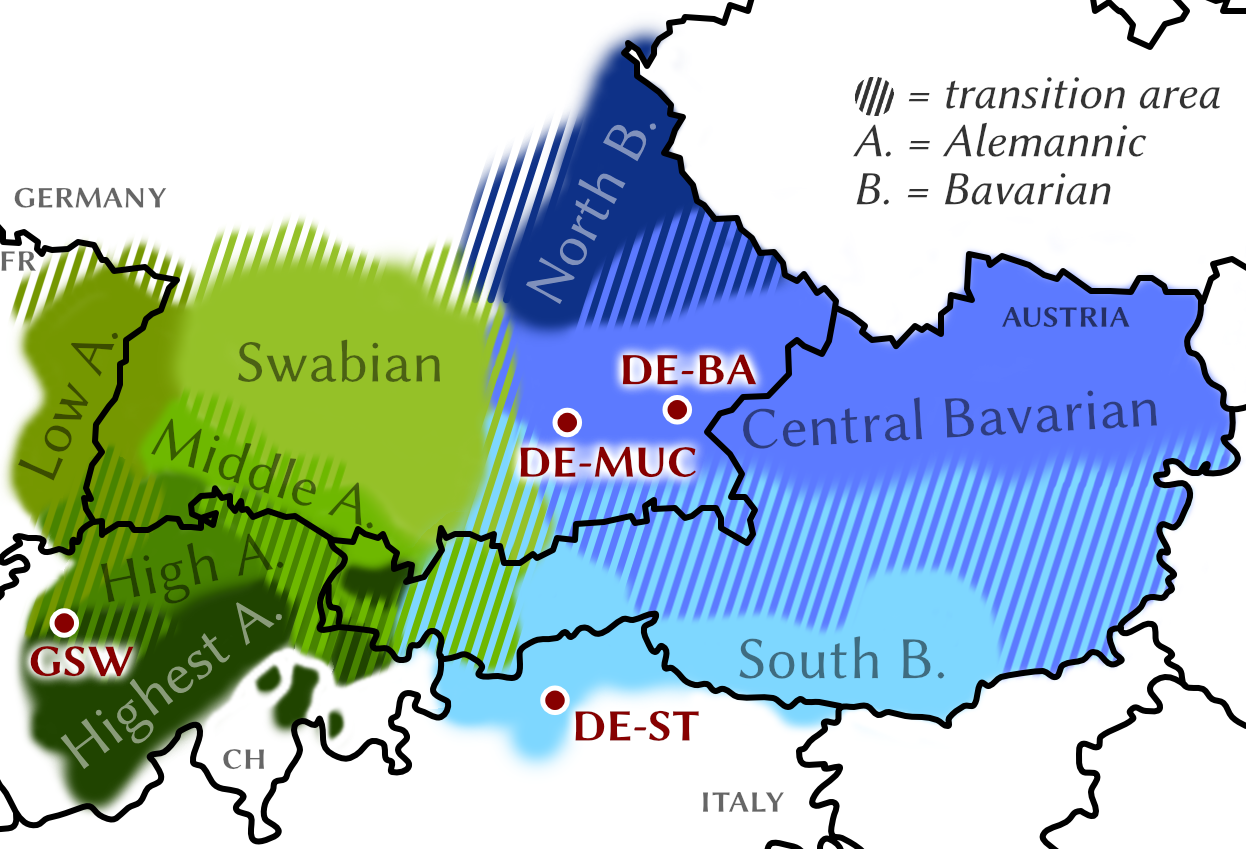

🖼️ 关键图片

📊 实验亮点

实验结果表明,辅助任务对槽位填充的提升效果优于意图分类,其中NER辅助任务效果最佳。中间任务训练相比联合多任务学习,能够带来更稳定的性能提升。最佳模型在巴伐利亚方言上,意图分类准确率提升了5.1个百分点,槽位填充F1值提升了8.4个百分点。

🎯 应用场景

该研究成果可应用于多方言数字助理、方言语音识别和理解等领域。通过提升方言场景下的自然语言理解能力,可以更好地服务于特定方言人群,促进文化传承和交流,并为低资源语言的自然语言处理提供借鉴。

📄 摘要(原文)

Reliable slot and intent detection (SID) is crucial in natural language understanding for applications like digital assistants. Encoder-only transformer models fine-tuned on high-resource languages generally perform well on SID. However, they struggle with dialectal data, where no standardized form exists and training data is scarce and costly to produce. We explore zero-shot transfer learning for SID, focusing on multiple Bavarian dialects, for which we release a new dataset for the Munich dialect. We evaluate models trained on auxiliary tasks in Bavarian, and compare joint multi-task learning with intermediate-task training. We also compare three types of auxiliary tasks: token-level syntactic tasks, named entity recognition (NER), and language modelling. We find that the included auxiliary tasks have a more positive effect on slot filling than intent classification (with NER having the most positive effect), and that intermediate-task training yields more consistent performance gains. Our best-performing approach improves intent classification performance on Bavarian dialects by 5.1 and slot filling F1 by 8.4 percentage points.