A Sequential Optimal Learning Approach to Automated Prompt Engineering in Large Language Models

作者: Shuyang Wang, Somayeh Moazeni, Diego Klabjan

分类: cs.CL

发布日期: 2025-01-07

💡 一句话要点

提出基于序列优化学习的自动化Prompt工程框架,高效搜索Prompt特征。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动化Prompt工程 序列优化学习 知识梯度策略 贝叶斯回归 大型语言模型

📋 核心要点

- 现有Prompt工程依赖人工设计,效率低且成本高,难以适应复杂任务和有限资源。

- 提出基于特征的Prompt表达方法,结合贝叶斯回归和知识梯度策略,实现Prompt的自动优化。

- 实验表明,该方法在有限的评估预算下,显著优于基准方法,提升了Prompt的质量。

📝 摘要(中文)

本文提出了一种用于自动化Prompt工程的优化学习框架,旨在通过顺序识别有效的Prompt特征,并高效地分配有限的评估预算,从而减少对人工设计的依赖。该方法采用基于特征的方式来表达Prompt,显著扩展了搜索空间。利用贝叶斯回归来利用相似Prompt之间的相关性,加速学习过程。为了高效探索Prompt特征的巨大空间,采用前瞻性的知识梯度(KG)策略进行序列优化学习。通过求解混合整数二阶锥优化问题高效地计算KG策略,使其具有可扩展性,并能够适应仅通过约束表征的Prompt。在指令归纳任务上的评估表明,该方法显著优于一系列基准策略。结果突出了在有限评估预算下使用KG策略进行Prompt学习的优势。该框架为在Prompt评估成本高昂的更广泛应用中部署自动化Prompt工程提供了一种解决方案。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中Prompt工程的自动化问题。现有方法主要依赖人工设计Prompt,耗时耗力,且难以保证Prompt的有效性。尤其是在Prompt评估成本高昂的场景下,如何利用有限的资源高效地搜索最佳Prompt是一个挑战。

核心思路:论文的核心思路是将Prompt工程问题转化为一个序列优化学习问题。通过将Prompt表示为一组特征的组合,并利用贝叶斯回归来建模Prompt与性能之间的关系,从而可以在有限的评估预算下,高效地探索Prompt特征空间,找到最优的Prompt。

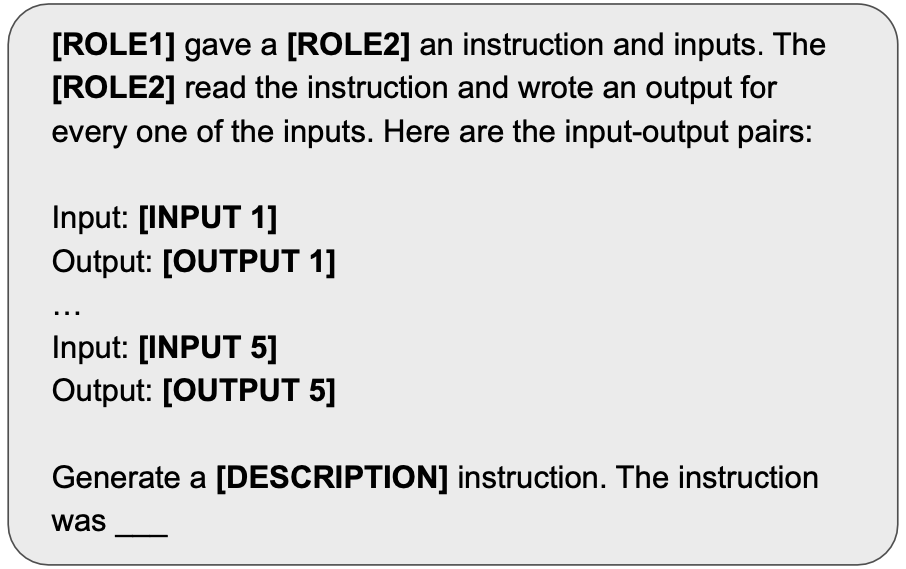

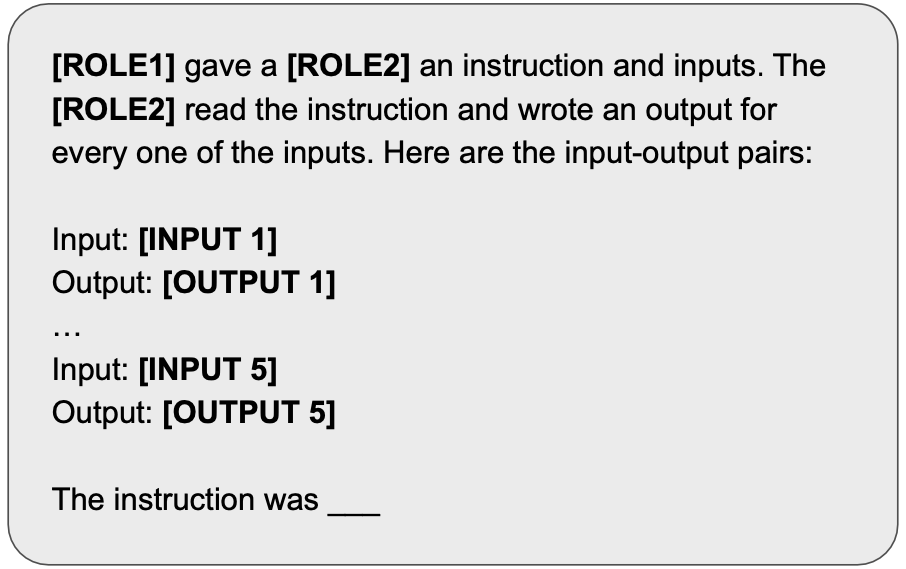

技术框架:该框架主要包含以下几个模块:1) Prompt特征表示:将Prompt表示为一组可学习的特征向量。2) 贝叶斯回归模型:利用贝叶斯回归建模Prompt特征与性能之间的关系,并利用Prompt之间的相关性加速学习。3) 知识梯度(KG)策略:采用前瞻性的KG策略,指导Prompt特征的序列选择,以最大化预期收益。4) 优化求解器:通过求解混合整数二阶锥优化问题,高效地计算KG策略。

关键创新:该论文的关键创新在于将Prompt工程问题转化为一个序列优化学习问题,并采用知识梯度策略来指导Prompt特征的选择。与传统的Prompt搜索方法相比,该方法能够更有效地利用有限的评估预算,并找到更高质量的Prompt。此外,使用基于特征的Prompt表示方法,极大地扩展了Prompt的搜索空间。

关键设计:在Prompt特征表示方面,论文没有给出具体的特征类型,而是提出了一种通用的基于约束的特征表示方法,可以根据具体的任务进行定制。在贝叶斯回归模型方面,论文采用了高斯过程回归,并利用核函数来建模Prompt之间的相关性。在知识梯度策略方面,论文通过求解混合整数二阶锥优化问题来计算KG值,从而保证了计算效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在指令归纳任务上显著优于一系列基准策略。在有限的评估预算下,该方法能够找到更高质量的Prompt,从而提升LLM的性能。具体而言,该方法在多个指标上都取得了显著的提升,证明了KG策略在Prompt学习中的有效性。

🎯 应用场景

该研究成果可应用于各种需要利用大型语言模型,但Prompt评估成本高昂的场景,例如:科学发现、药物研发、法律咨询等。通过自动化Prompt工程,可以降低人工成本,提高效率,并发现更有效的Prompt,从而提升LLM在特定领域的应用效果。未来,该方法可以进一步扩展到多模态Prompt工程,以及Prompt的自适应优化。

📄 摘要(原文)

Designing effective prompts is essential to guiding large language models (LLMs) toward desired responses. Automated prompt engineering aims to reduce reliance on manual effort by streamlining the design, refinement, and optimization of natural language prompts. This paper proposes an optimal learning framework for automated prompt engineering, designed to sequentially identify effective prompt features while efficiently allocating a limited evaluation budget. We introduce a feature-based method to express prompts, which significantly broadens the search space. Bayesian regression is employed to utilize correlations among similar prompts, accelerating the learning process. To efficiently explore the large space of prompt features for a high quality prompt, we adopt the forward-looking Knowledge-Gradient (KG) policy for sequential optimal learning. The KG policy is computed efficiently by solving mixed-integer second-order cone optimization problems, making it scalable and capable of accommodating prompts characterized only through constraints. We demonstrate that our method significantly outperforms a set of benchmark strategies assessed on instruction induction tasks. The results highlight the advantages of using the KG policy for prompt learning given a limited evaluation budget. Our framework provides a solution to deploying automated prompt engineering in a wider range applications where prompt evaluation is costly.