Leveraging Explainable AI for LLM Text Attribution: Differentiating Human-Written and Multiple LLMs-Generated Text

作者: Ayat Najjar, Huthaifa I. Ashqar, Omar Darwish, Eman Hammad

分类: cs.CL, cs.CY

发布日期: 2025-01-06

💡 一句话要点

利用可解释AI进行LLM文本溯源,区分人类撰写和多种LLM生成文本

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本溯源 可解释AI 大语言模型 机器学习 抄袭检测

📋 核心要点

- 当前检测AI生成文本的方法效果有限,难以准确区分不同LLM生成的文本,且缺乏可解释性。

- 利用机器学习模型(如随机森林和循环神经网络)进行二元和多元分类,并结合可解释AI技术分析特征重要性。

- 实验结果表明,该方法在区分人类撰写和LLM生成文本方面表现出色,准确率高达98.5%,优于GPTZero。

📝 摘要(中文)

生成式AI大语言模型(LLMs)的发展引发了人们对识别由AI生成或人类创作内容的需求。学生过度依赖此类工具会影响写作或编码技能的发展,并可能导致抄袭问题。本研究旨在支持检测和识别LLM工具生成的文本内容。我们假设LLM生成的文本可以通过机器学习(ML)检测,并研究能够识别和区分多种LLM工具生成文本的ML模型。我们利用随机森林(RF)和循环神经网络(RNN)等多种ML和深度学习(DL)算法,并利用可解释人工智能(XAI)来理解溯源中的重要特征。我们的方法分为1)二元分类,区分人类撰写和AI文本,以及2)多元分类,区分人类撰写文本和五种不同的LLM工具(ChatGPT、LLaMA、Google Bard、Claude和Perplexity)生成的文本。结果表明,多分类和二元分类均具有较高的准确率。我们的模型优于GPTZero,准确率从78.3%提升到98.5%。值得注意的是,GPTZero无法识别约4.2%的观测结果,但我们的模型能够识别完整的测试数据集。XAI结果表明,理解不同类别之间的特征重要性能够构建详细的作者/来源画像,通过突出独特的文体和结构元素来辅助溯源和支持剽窃检测,从而确保强大的内容原创性验证。

🔬 方法详解

问题定义:论文旨在解决如何准确区分人类撰写文本和由不同LLM(如ChatGPT、LLaMA、Google Bard等)生成的文本的问题。现有方法,如GPTZero,在准确率和识别完整性方面存在不足,并且缺乏对模型决策过程的解释性。

核心思路:论文的核心思路是利用机器学习模型学习人类和不同LLM生成文本的特征,并通过可解释AI技术分析这些特征的重要性,从而实现准确的文本溯源和区分。通过分析特征重要性,可以了解不同作者/来源的独特文体和结构元素。

技术框架:整体框架包括数据收集、特征提取、模型训练和评估以及可解释性分析四个主要阶段。首先,收集人类撰写和不同LLM生成的文本数据。然后,提取文本的各种特征,例如词汇、语法和风格特征。接着,使用机器学习模型(如随机森林和循环神经网络)进行训练,并评估其在二元分类(人类 vs AI)和多元分类(人类 vs 不同LLM)任务上的性能。最后,利用可解释AI技术分析模型所学习到的特征的重要性。

关键创新:该研究的关键创新在于结合了机器学习和可解释AI技术,不仅实现了高准确率的文本溯源,还提供了对模型决策过程的深入理解。通过分析特征重要性,可以揭示不同LLM生成文本的独特特征,从而提高溯源的准确性和可靠性。

关键设计:论文采用了随机森林(RF)和循环神经网络(RNN)作为主要的机器学习模型。随机森林是一种集成学习方法,具有较高的准确率和鲁棒性。循环神经网络擅长处理序列数据,能够捕捉文本中的上下文信息。此外,论文还使用了XAI技术,例如LIME或SHAP,来解释模型预测结果,并确定对预测贡献最大的特征。

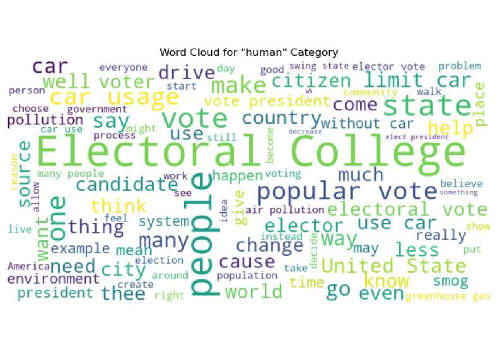

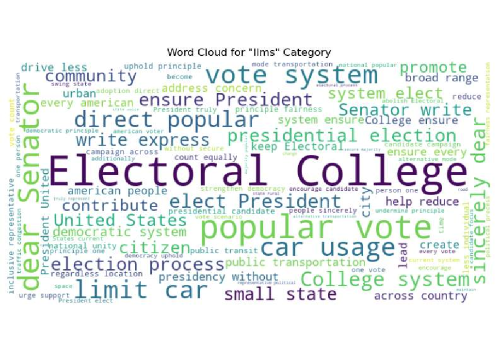

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在区分人类撰写和LLM生成文本方面表现出色,准确率高达98.5%,显著优于GPTZero(78.3%)。此外,该模型能够识别GPTZero无法识别的4.2%的观测结果,表明其具有更高的鲁棒性和泛化能力。XAI分析揭示了不同LLM生成文本的独特特征,为文本溯源提供了有价值的信息。

🎯 应用场景

该研究成果可应用于教育领域,帮助检测学生作业中是否存在AI代写行为,从而维护学术诚信。此外,还可用于新闻媒体领域,识别虚假新闻和AI生成的内容,提高信息的可信度。在版权保护方面,该技术可以帮助识别侵权内容,保护原创作者的权益。

📄 摘要(原文)

The development of Generative AI Large Language Models (LLMs) raised the alarm regarding identifying content produced through generative AI or humans. In one case, issues arise when students heavily rely on such tools in a manner that can affect the development of their writing or coding skills. Other issues of plagiarism also apply. This study aims to support efforts to detect and identify textual content generated using LLM tools. We hypothesize that LLMs-generated text is detectable by machine learning (ML), and investigate ML models that can recognize and differentiate texts generated by multiple LLMs tools. We leverage several ML and Deep Learning (DL) algorithms such as Random Forest (RF), and Recurrent Neural Networks (RNN), and utilized Explainable Artificial Intelligence (XAI) to understand the important features in attribution. Our method is divided into 1) binary classification to differentiate between human-written and AI-text, and 2) multi classification, to differentiate between human-written text and the text generated by the five different LLM tools (ChatGPT, LLaMA, Google Bard, Claude, and Perplexity). Results show high accuracy in the multi and binary classification. Our model outperformed GPTZero with 98.5\% accuracy to 78.3\%. Notably, GPTZero was unable to recognize about 4.2\% of the observations, but our model was able to recognize the complete test dataset. XAI results showed that understanding feature importance across different classes enables detailed author/source profiles. Further, aiding in attribution and supporting plagiarism detection by highlighting unique stylistic and structural elements ensuring robust content originality verification.