Decoding News Bias: Multi Bias Detection in News Articles

作者: Bhushan Santosh Shah, Deven Santosh Shah, Vahida Attar

分类: cs.CL

发布日期: 2025-01-05

💡 一句话要点

提出一种基于LLM的新闻偏见多领域检测方法,旨在提升新闻文章的客观性和可信度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 新闻偏见检测 大型语言模型 多领域偏见 自然语言处理 数据集构建

📋 核心要点

- 现有方法主要关注特定领域的偏见检测,缺乏对新闻文章中多领域偏见的全面分析能力。

- 利用大型语言模型(LLM)构建数据集,并探索多种检测技术,实现对新闻文章中各种偏见的识别。

- 通过实验验证了该方法在广谱偏见检测中的有效性,为提升新闻文章的客观性和可信度提供了新思路。

📝 摘要(中文)

新闻文章是社会事件的重要信息来源,但常带有各种偏见。这些偏见会严重扭曲公众舆论和对媒体的信任。因此,开发检测和解决这些偏见的技术至关重要。以往的研究主要集中在特定领域(如政治、性别偏见)的偏见识别。然而,需要更全面的研究来检测跨领域的多样偏见。大型语言模型(LLM)为分析和理解自然语言提供了一种强大的方法,使其成为构建数据集和检测这些偏见的理想选择。本文探索了新闻文章中存在的各种偏见,使用LLM构建了一个数据集,并展示了使用多种检测技术获得的结果。我们的方法强调了广谱偏见检测的重要性,并为提高新闻文章的完整性提供了新的见解。

🔬 方法详解

问题定义:该论文旨在解决新闻文章中存在的多种偏见难以被有效检测的问题。现有方法主要集中于特定领域(如政治、性别)的偏见检测,缺乏对新闻文章中广泛存在的各种偏见的全面分析能力。这导致公众容易受到带有偏见的新闻报道的影响,损害了媒体的公信力。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的自然语言理解和生成能力,构建一个包含多种偏见类型的新闻数据集,并在此基础上探索多种偏见检测技术。通过这种方式,可以实现对新闻文章中更广泛、更全面的偏见检测。

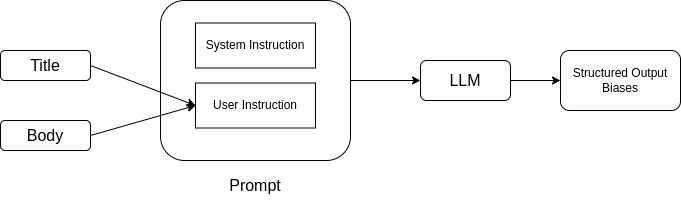

技术框架:该方法主要包含以下几个阶段:1) 偏见类型定义:确定需要检测的多种偏见类型,例如政治偏见、性别偏见、种族偏见等。2) 数据集构建:利用LLM生成包含各种偏见类型的新闻文章,并进行标注。3) 偏见检测模型训练:使用构建的数据集训练多种偏见检测模型,例如基于Transformer的模型。4) 模型评估:在测试集上评估模型的性能,并分析结果。

关键创新:该论文的关键创新在于:1) 提出了一个基于LLM的新闻偏见多领域检测框架,能够检测新闻文章中更广泛的偏见类型。2) 利用LLM自动构建数据集,降低了数据收集和标注的成本。3) 探索了多种偏见检测技术,并比较了它们的性能。

关键设计:论文中关于数据集构建的关键设计包括:使用不同的prompt来引导LLM生成不同类型的偏见文章;对生成的数据进行人工审核,确保数据的质量;对数据进行平衡处理,避免某些类型的偏见过度表示。关于模型训练的关键设计包括:使用预训练的Transformer模型作为基础模型;采用合适的损失函数来优化模型;使用正则化技术来防止过拟合。

🖼️ 关键图片

📊 实验亮点

该研究通过实验验证了基于LLM的多领域偏见检测方法的有效性。具体性能数据未知,但论文强调了该方法在检测广谱偏见方面的优势,并为提高新闻文章的完整性提供了新的见解。与现有方法相比,该方法能够检测更多类型的偏见,并降低数据收集和标注的成本。

🎯 应用场景

该研究成果可应用于新闻媒体的自动审核系统,帮助编辑识别和纠正新闻报道中的偏见,从而提高新闻报道的客观性和公正性。此外,该技术还可以应用于舆情分析、虚假信息检测等领域,帮助用户更好地理解和评估新闻信息。

📄 摘要(原文)

News Articles provides crucial information about various events happening in the society but they unfortunately come with different kind of biases. These biases can significantly distort public opinion and trust in the media, making it essential to develop techniques to detect and address them. Previous works have majorly worked towards identifying biases in particular domains e.g., Political, gender biases. However, more comprehensive studies are needed to detect biases across diverse domains. Large language models (LLMs) offer a powerful way to analyze and understand natural language, making them ideal for constructing datasets and detecting these biases. In this work, we have explored various biases present in the news articles, built a dataset using LLMs and present results obtained using multiple detection techniques. Our approach highlights the importance of broad-spectrum bias detection and offers new insights for improving the integrity of news articles.