Understand, Solve and Translate: Bridging the Multilingual Mathematical Reasoning Gap

作者: Hyunwoo Ko, Guijin Son, Dasol Choi

分类: cs.CL

发布日期: 2025-01-05 (更新: 2025-01-31)

备注: 18 pages, 14 figures, 9 tables

💡 一句话要点

提出UST方法,提升大语言模型在韩语数学推理任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言推理 数学问题求解 低资源语言 机器翻译 大语言模型 知识迁移 数据增强

📋 核心要点

- 现有大语言模型在非高资源语言的数学推理任务中表现不佳,主要瓶颈在于对非英语输入的理解。

- UST方法利用英语作为桥梁,先理解问题、解决问题,再翻译答案,从而提升模型在低资源语言中的推理能力。

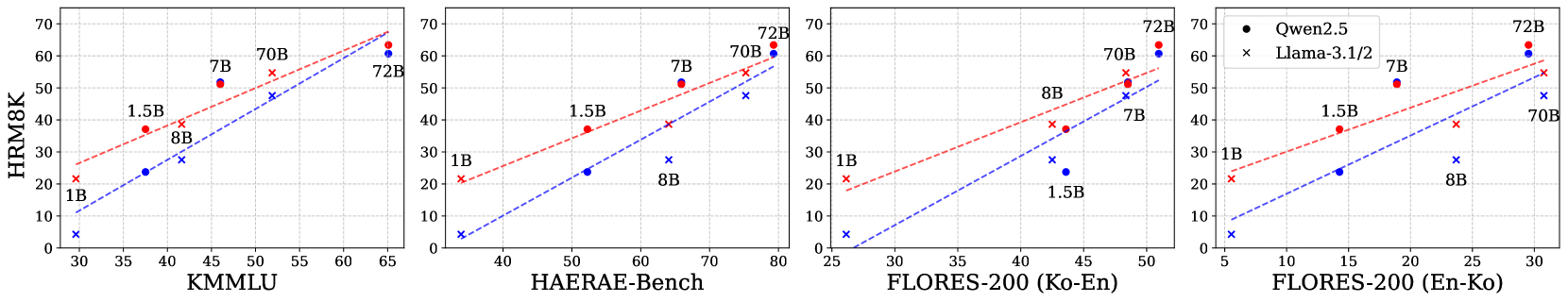

- 实验表明,UST在HRM8K基准上提升显著,并能泛化到其他韩语领域,有效缩小了多语言性能差距。

📝 摘要(中文)

大型语言模型(LLMs)在复杂的推理任务中表现出卓越的性能。然而,尽管它们在高资源语言(如英语和中文)中具有强大的推理能力,但在其他语言中仍然存在显著的性能差距。为了研究韩语中的这种差距,我们引入了HRM8K,这是一个包含8011个英韩平行双语数学问题的基准。通过对模型行为的系统分析,我们发现了一个关键结论:这些性能差异主要源于理解非英语输入的困难,而不是推理能力的限制。基于这些发现,我们提出了一种名为UST(理解、解决和翻译)的方法,该方法策略性地使用英语作为推理和解决方案生成的锚点。通过在13万个合成生成的数据点上对模型进行微调,UST在HRM8K基准上实现了10.91%的改进,并将多语言性能差距从11.6%降低到0.7%。此外,我们表明UST的改进可以有效地推广到不同的韩语领域,证明了从机器可验证的内容中获得的能力可以推广到其他领域。我们公开发布了基准、训练数据集和模型。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在低资源语言(特别是韩语)的数学推理任务中表现不佳的问题。现有方法直接处理韩语问题,但由于模型对韩语的理解能力不足,导致推理性能显著下降。痛点在于模型难以准确理解韩语问题,从而无法进行有效的推理和求解。

核心思路:论文的核心思路是利用英语作为“锚点”,将韩语数学问题转化为英语,利用模型在英语上的强大推理能力解决问题,最后将答案翻译回韩语。这种“理解、解决、翻译”的策略旨在规避模型直接处理韩语问题的困难,充分发挥模型在英语上的优势。

技术框架:UST方法包含三个主要阶段:1) 理解 (Understand):将韩语数学问题翻译成英语。2) 解决 (Solve):利用大语言模型在英语环境下解决数学问题。3) 翻译 (Translate):将英语答案翻译回韩语。整个流程依赖于高质量的翻译模型和强大的英语推理能力。论文通过合成数据对模型进行微调,以提升其在各个阶段的性能。

关键创新:UST方法的关键创新在于其“以英语为中心”的推理框架。它避免了直接在低资源语言上进行推理,而是利用模型在高资源语言上的优势,通过翻译作为桥梁,实现了更好的推理效果。这种方法论具有通用性,可以推广到其他低资源语言的推理任务中。

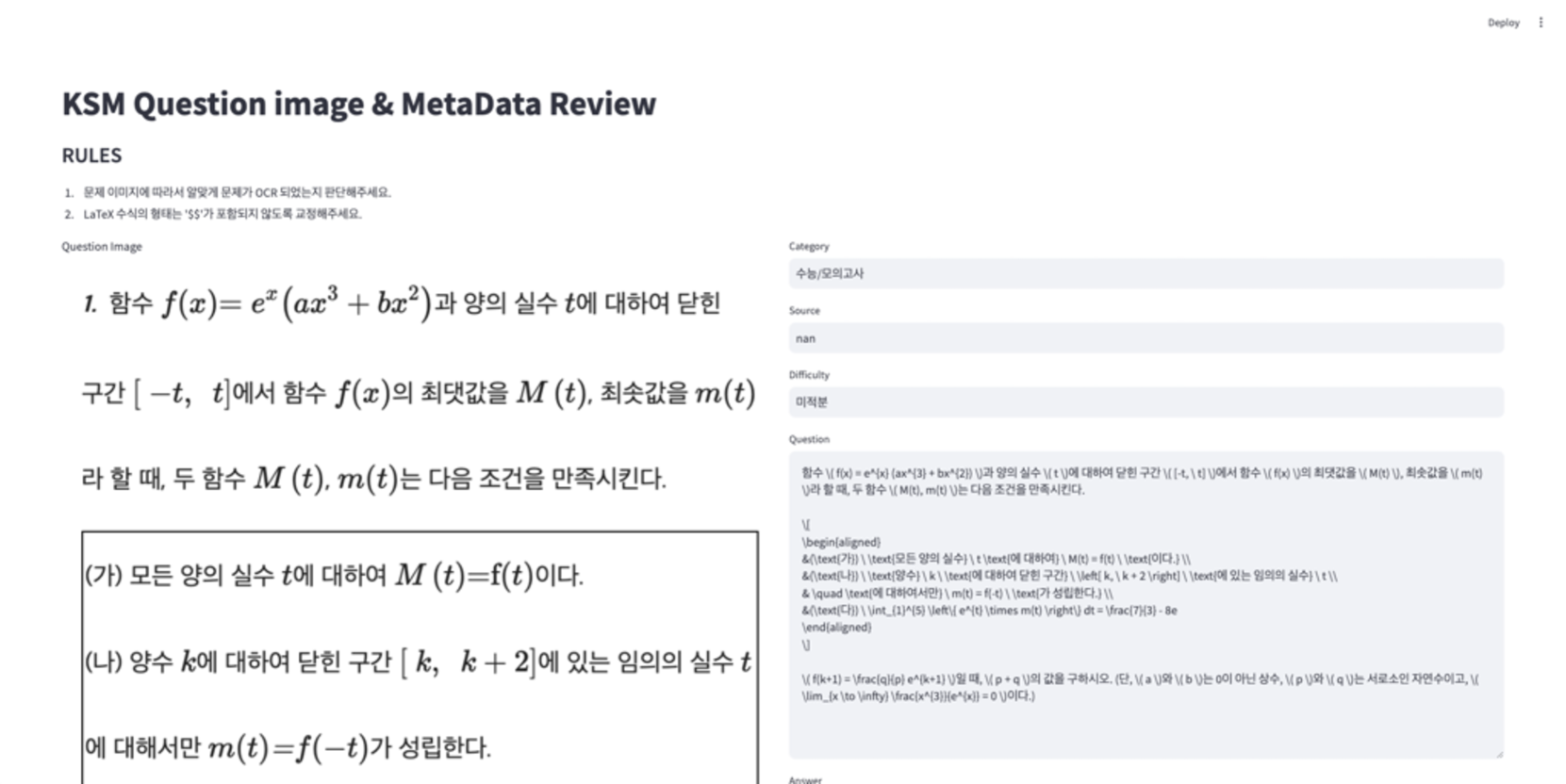

关键设计:论文使用合成数据进行微调,数据包含韩语问题、英语问题、英语解答和韩语解答。微调目标是提升模型在翻译和推理方面的能力。具体的技术细节包括:使用高质量的机器翻译模型进行数据增强,设计合适的损失函数以优化翻译和推理性能,以及探索不同的模型架构以提升整体性能。论文还详细描述了HRM8K基准的构建过程,包括数据收集、清洗和标注等步骤。

🖼️ 关键图片

📊 实验亮点

UST方法在HRM8K基准上实现了显著的性能提升,相较于直接在韩语上进行推理的模型,UST的准确率提高了10.91%。更重要的是,UST方法将多语言性能差距从11.6%降低到0.7%,表明该方法能够有效缩小不同语言之间的推理能力差异。此外,实验还证明了UST的改进可以泛化到其他韩语领域,验证了该方法的有效性和通用性。

🎯 应用场景

该研究成果可应用于智能教育、机器翻译、跨语言信息检索等领域。通过提升大语言模型在低资源语言中的推理能力,可以为更多用户提供个性化的智能服务,促进语言之间的信息交流和知识共享。未来,该方法有望应用于更广泛的跨语言任务,例如多语言对话系统、跨语言文本摘要等。

📄 摘要(原文)

Large language models (LLMs) demonstrate exceptional performance on complex reasoning tasks. However, despite their strong reasoning capabilities in high-resource languages (e.g., English and Chinese), a significant performance gap persists in other languages. To investigate this gap in Korean, we introduce HRM8K, a benchmark comprising 8,011 English-Korean parallel bilingual math problems. Through systematic analysis of model behaviors, we identify a key finding: these performance disparities stem primarily from difficulties in comprehending non-English inputs, rather than limitations in reasoning capabilities. Based on these findings, we propose UST (Understand, Solve, and Translate), a method that strategically uses English as an anchor for reasoning and solution generation. By fine-tuning the model on 130k synthetically generated data points, UST achieves a 10.91% improvement on the HRM8K benchmark and reduces the multilingual performance gap from 11.6% to 0.7%. Additionally, we show that improvements from UST generalize effectively to different Korean domains, demonstrating that capabilities acquired from machine-verifiable content can be generalized to other areas. We publicly release the benchmark, training dataset, and models.