AdaSkip: Adaptive Sublayer Skipping for Accelerating Long-Context LLM Inference

作者: Zhuomin He, Yizhen Yao, Pengfei Zuo, Bin Gao, Qinya Li, Zhenzhe Zheng, Fan Wu

分类: cs.CL, cs.AI

发布日期: 2025-01-04

备注: 9 pages,10 figures, AAAI

💡 一句话要点

AdaSkip:面向长文本LLM推理的自适应子层跳跃加速方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本LLM 推理加速 层跳跃 自适应算法 子层跳跃

📋 核心要点

- 现有层跳跃方法在长文本LLM推理中存在局限,无法适应模型和上下文变化,忽略子层重要性,且不适用于预填充阶段。

- AdaSkip通过利用即时相似性信息自适应地识别不重要的层,并支持子层级的跳跃,从而加速长文本LLM的推理。

- 实验结果表明,AdaSkip在多种长文本基准和模型上优于现有基线,验证了其在长文本LLM推理加速方面的有效性。

📝 摘要(中文)

长文本大语言模型(LLM)的推理变得越来越重要,这促使大量研究致力于缓解此类场景中巨大的存储和计算成本。逐层跳跃方法是一种有前景的优化方案,但在长文本推理中很少被探索。我们观察到,现有的逐层跳跃策略在应用于长文本推理时存在一些局限性,包括无法适应模型和上下文的可变性,忽略了子层的重要性,以及不适用于预填充阶段。本文提出了AdaSkip,一种专门为长文本推理设计的自适应子层跳跃方法。AdaSkip通过利用即时相似性信息自适应地识别不太重要的层,实现子层级的跳跃,并加速预填充和解码阶段。通过在各种长文本基准和模型上进行的大量实验证明了AdaSkip的有效性,展示了其优于现有基线的推理性能。

🔬 方法详解

问题定义:长文本LLM推理面临巨大的计算和存储成本,现有的层跳跃方法无法有效适应长文本的特性。具体来说,现有方法无法根据模型和上下文的变化动态调整跳跃策略,忽略了不同子层的重要性差异,并且无法应用于预填充阶段,限制了其加速效果。

核心思路:AdaSkip的核心思路是自适应地跳过对推理结果影响较小的子层,从而减少计算量。它利用层之间的相似性信息来判断哪些层可以安全地跳过,并且允许在子层级别进行跳跃,从而更精细地控制计算量。此外,AdaSkip也适用于预填充阶段,进一步提升加速效果。

技术框架:AdaSkip的整体框架包含以下几个主要步骤:1) 相似性计算:在推理过程中,动态计算不同层之间的相似性。2) 重要性评估:基于相似性信息,评估每个子层的重要性。3) 跳跃决策:根据重要性评估结果,决定是否跳过某个子层。4) 推理执行:执行跳跃后的推理过程,只计算必要的子层。

关键创新:AdaSkip的关键创新在于:1) 自适应性:能够根据模型和上下文的变化动态调整跳跃策略。2) 子层级跳跃:允许在子层级别进行跳跃,从而更精细地控制计算量。3) 预填充阶段适用性:能够应用于预填充阶段,进一步提升加速效果。与现有方法相比,AdaSkip更加灵活和高效,能够更好地适应长文本LLM推理的需求。

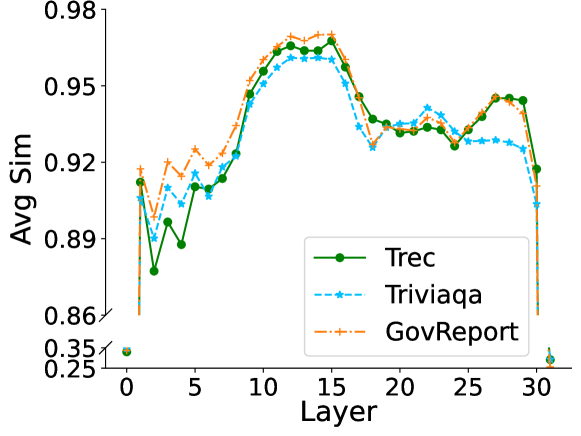

关键设计:AdaSkip的关键设计包括:1) 相似性度量:使用余弦相似度等方法来衡量层之间的相似性。2) 重要性阈值:设置一个阈值来判断子层的重要性,高于阈值的子层保留,低于阈值的子层跳过。3) 跳跃策略:可以采用不同的跳跃策略,例如固定比例跳跃、动态比例跳跃等。具体的参数设置需要根据不同的模型和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AdaSkip在多个长文本基准测试中显著优于现有基线方法。例如,在某些模型和数据集上,AdaSkip能够在保持精度基本不变的情况下,将推理速度提升20%-40%。此外,AdaSkip在预填充阶段也能实现显著的加速效果,进一步提升了整体的推理性能。

🎯 应用场景

AdaSkip可广泛应用于需要处理长文本的LLM推理场景,例如长文档摘要、问答系统、代码生成等。通过降低计算成本,AdaSkip能够提升LLM在资源受限设备上的部署能力,并降低在线服务的延迟,具有重要的实际应用价值。未来,该技术可以进一步扩展到其他类型的模型和任务中。

📄 摘要(原文)

Long-context large language models (LLMs) inference is increasingly critical, motivating a number of studies devoted to alleviating the substantial storage and computational costs in such scenarios. Layer-wise skipping methods are promising optimizations but rarely explored in long-context inference. We observe that existing layer-wise skipping strategies have several limitations when applied in long-context inference, including the inability to adapt to model and context variability, disregard for sublayer significance, and inapplicability for the prefilling phase. This paper proposes \sysname, an adaptive sublayer skipping method specifically designed for long-context inference. \sysname adaptively identifies less important layers by leveraging on-the-fly similarity information, enables sublayer-wise skipping, and accelerates both the prefilling and decoding phases. The effectiveness of \sysname is demonstrated through extensive experiments on various long-context benchmarks and models, showcasing its superior inference performance over existing baselines.