Enhancing Uncertainty Modeling with Semantic Graph for Hallucination Detection

作者: Kedi Chen, Qin Chen, Jie Zhou, Xinqi Tao, Bowen Ding, Jingwen Xie, Mingchen Xie, Peilong Li, Feng Zheng, Liang He

分类: cs.CL, cs.AI

发布日期: 2025-01-02 (更新: 2025-04-05)

💡 一句话要点

提出基于语义图增强不确定性建模的幻觉检测方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 幻觉检测 大型语言模型 不确定性建模 语义图 知识图谱

📋 核心要点

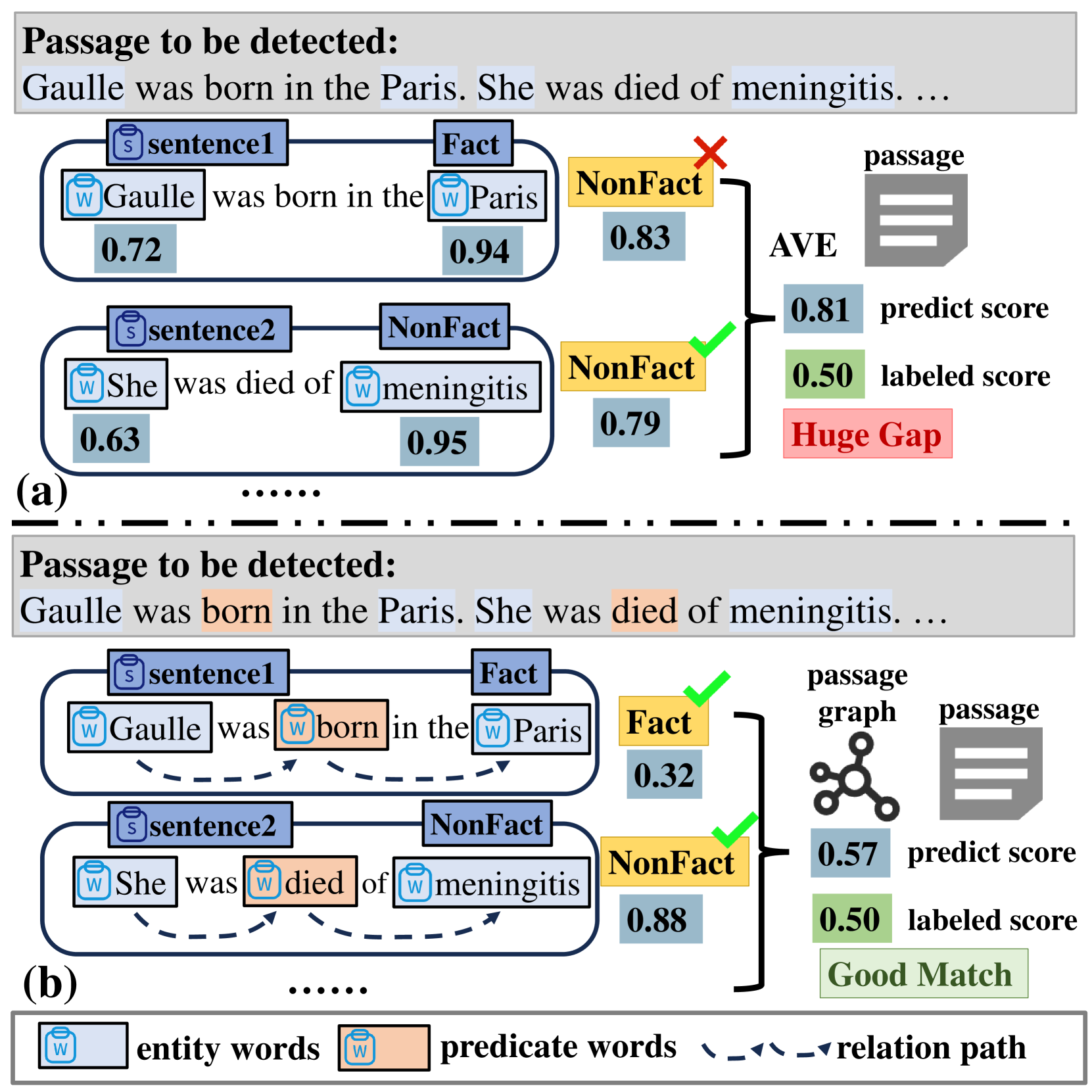

- 现有基于不确定性的幻觉检测方法忽略了token和句子间复杂的语义关系,限制了跨多个token和句子的幻觉检测。

- 论文构建语义图捕捉实体token和句子间的关系,通过不确定性传播增强句子级别幻觉检测,并进行图校准。

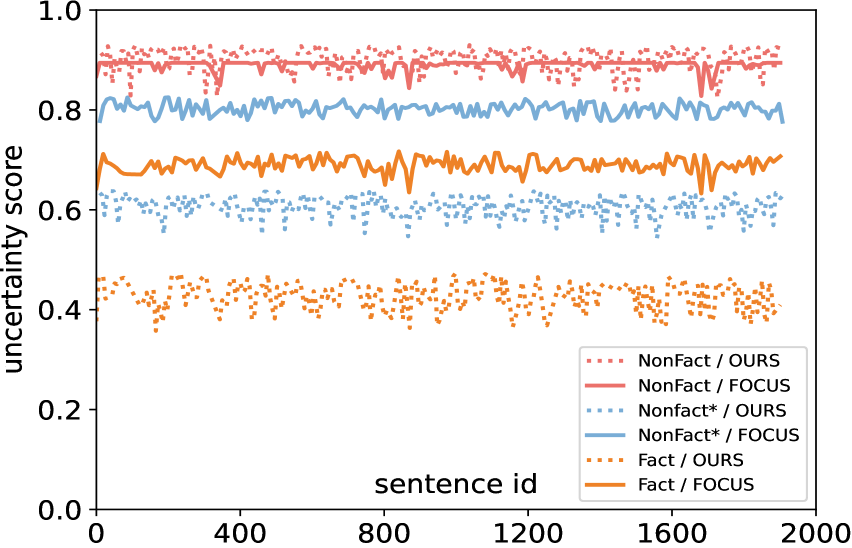

- 实验结果表明,该方法在两个数据集上表现出巨大优势,在段落级别幻觉检测中获得了19.78%的显著改进。

📝 摘要(中文)

大型语言模型(LLMs)容易产生包含非事实或不忠实陈述的幻觉,这损害了其在现实场景中的应用。最近的研究侧重于基于不确定性的幻觉检测,该方法利用LLMs的输出概率进行不确定性计算,不依赖于外部知识或LLMs的频繁采样。然而,大多数方法仅考虑每个独立token的不确定性,而token和句子之间复杂的语义关系没有得到充分研究,这限制了对跨越段落中多个token和句子的幻觉的检测。本文提出了一种利用语义图增强不确定性建模的幻觉检测方法。具体来说,我们首先构建一个语义图,很好地捕捉实体token和句子之间的关系。然后,我们结合两个实体之间的关系进行不确定性传播,以增强句子级别的幻觉检测。鉴于幻觉的发生是由于句子之间的冲突,我们进一步提出了一种基于图的不确定性校准方法,该方法将句子与其在语义图中的邻居的矛盾概率相结合,用于不确定性计算。在两个数据集上的大量实验表明了我们提出的方法的巨大优势。特别是在段落级别的幻觉检测中,我们获得了19.78%的显著改进。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中存在的幻觉问题,即生成不真实或不忠实的信息。现有基于不确定性的幻觉检测方法主要关注单个token的不确定性,忽略了token和句子之间的语义关系,导致无法有效检测跨多个token和句子的复杂幻觉。

核心思路:论文的核心思路是利用语义图来建模token和句子之间的语义关系,并利用这些关系来增强不确定性建模,从而更准确地检测幻觉。通过考虑句子间的矛盾关系,进一步校准不确定性,提高检测的准确性。这样设计的目的是为了弥补现有方法在语义关系建模方面的不足。

技术框架:该方法主要包含以下几个阶段:1. 语义图构建:构建一个语义图,节点代表实体token和句子,边代表它们之间的关系。2. 不确定性传播:利用语义图中的关系,将实体间的不确定性进行传播,从而增强句子级别的不确定性估计。3. 不确定性校准:基于图结构,结合句子与其邻居的矛盾概率,对不确定性进行校准。

关键创新:该方法最重要的创新点在于利用语义图来建模和利用token和句子之间的语义关系,从而增强不确定性建模。与现有方法只关注单个token的不确定性不同,该方法考虑了上下文信息,能够更准确地检测跨多个token和句子的复杂幻觉。

关键设计:语义图的构建方式(例如,实体识别方法、关系抽取方法),不确定性传播的具体方式(例如,如何定义和计算实体间关系的权重),以及不确定性校准的具体方法(例如,如何定义和计算句子间的矛盾概率,如何将矛盾概率与不确定性相结合)是关键的设计细节。具体的损失函数和网络结构信息未知。

🖼️ 关键图片

📊 实验亮点

该方法在两个数据集上进行了广泛的实验,结果表明该方法具有显著的优势。特别是在段落级别的幻觉检测中,该方法获得了19.78%的显著改进。实验结果表明,通过利用语义图建模token和句子之间的语义关系,可以有效地提高幻觉检测的准确性。

🎯 应用场景

该研究成果可应用于各种需要大型语言模型生成可靠信息的场景,例如智能客服、新闻摘要、报告生成等。通过提高幻觉检测的准确性,可以减少错误信息的传播,提高用户对语言模型输出的信任度,并促进语言模型在实际应用中的广泛使用。未来可以探索更复杂的语义关系建模方法,以及更有效的图结构学习算法。

📄 摘要(原文)

Large Language Models (LLMs) are prone to hallucination with non-factual or unfaithful statements, which undermines the applications in real-world scenarios. Recent researches focus on uncertainty-based hallucination detection, which utilizes the output probability of LLMs for uncertainty calculation and does not rely on external knowledge or frequent sampling from LLMs. Whereas, most approaches merely consider the uncertainty of each independent token, while the intricate semantic relations among tokens and sentences are not well studied, which limits the detection of hallucination that spans over multiple tokens and sentences in the passage. In this paper, we propose a method to enhance uncertainty modeling with semantic graph for hallucination detection. Specifically, we first construct a semantic graph that well captures the relations among entity tokens and sentences. Then, we incorporate the relations between two entities for uncertainty propagation to enhance sentence-level hallucination detection. Given that hallucination occurs due to the conflict between sentences, we further present a graph-based uncertainty calibration method that integrates the contradiction probability of the sentence with its neighbors in the semantic graph for uncertainty calculation. Extensive experiments on two datasets show the great advantages of our proposed approach. In particular, we obtain substantial improvements with 19.78% in passage-level hallucination detection.