Cross-model Transferability among Large Language Models on the Platonic Representations of Concepts

作者: Youcheng Huang, Chen Huang, Duanyu Feng, Wenqiang Lei, Jiancheng Lv

分类: cs.CL, cs.AI

发布日期: 2025-01-02 (更新: 2025-05-20)

备注: ACL 2025 Main Camera Ready

💡 一句话要点

提出线性变换方法,实现大语言模型间概念表示的跨模型迁移与行为控制。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 概念表示 跨模型迁移 行为控制 线性变换 steering vectors 知识迁移

📋 核心要点

- 现有方法难以有效利用不同LLM间的知识,阻碍了跨模型概念表示的迁移和行为控制。

- 提出线性变换方法,对齐不同LLM的概念表示,实现steering vectors的跨模型迁移。

- 实验表明,该方法能有效实现跨模型行为控制,且小模型SVs可有效控制大模型。

📝 摘要(中文)

理解大型语言模型(LLM)的内部运作是重要的研究前沿。先前的研究表明,单个LLM的概念表示可以被捕获为steering vectors(SVs),从而控制LLM的行为(例如,生成有害内容)。本文提出了一种新颖的方法,通过探索不同LLM之间概念表示的复杂关系,与柏拉图的洞穴寓言进行类比。特别地,我们引入了一种线性变换方法来桥接这些表示,并提出了三个关键发现:1)不同LLM之间的概念表示可以通过简单的线性变换有效地对齐,从而实现通过SVs进行高效的跨模型迁移和行为控制。2)这种线性变换可以推广到不同的概念,从而促进跨LLM对齐和控制代表不同概念的SVs。3)LLM概念表示之间存在一种由弱到强的可迁移性,即从较小的LLM中提取的SVs可以有效地控制较大的LLM的行为。

🔬 方法详解

问题定义:论文旨在解决不同大型语言模型(LLM)之间概念表示的对齐和迁移问题。现有方法通常针对单个LLM进行概念表示的提取和控制,缺乏跨模型迁移能力。这限制了知识的共享和利用,并且难以将从小型LLM中获得的知识迁移到大型LLM上,从而无法有效控制大型LLM的行为。

核心思路:论文的核心思路是利用线性变换来对齐不同LLM的概念表示空间。作者认为,尽管不同LLM的内部结构和训练数据可能存在差异,但它们对相同概念的表示在一定程度上是相关的。通过学习一个线性变换矩阵,可以将一个LLM的概念表示映射到另一个LLM的表示空间,从而实现跨模型迁移。这种方法的优势在于简单高效,易于实现和部署。

技术框架:该方法主要包含以下几个步骤:1)从源LLM中提取代表特定概念的steering vector(SV)。2)利用线性变换矩阵将源LLM的SV映射到目标LLM的表示空间。3)将变换后的SV应用于目标LLM,以控制其行为。整个框架的核心在于学习这个线性变换矩阵,这可以通过最小化源LLM和目标LLM对相同概念的表示之间的距离来实现。

关键创新:该论文的关键创新在于提出了利用线性变换实现LLM间概念表示对齐和迁移的方法。与现有方法相比,该方法无需重新训练LLM,而是通过学习一个简单的线性变换矩阵来实现跨模型知识迁移。此外,该方法还发现了弱到强的迁移性,即从小型LLM中提取的SV可以有效地控制大型LLM的行为。

关键设计:线性变换矩阵的学习可以通过最小化源LLM和目标LLM对相同概念的表示之间的均方误差来实现。具体来说,给定源LLM的SV(Vs)和目标LLM的SV(Vt),目标是学习一个线性变换矩阵W,使得||WVs - Vt||^2最小化。可以使用梯度下降等优化算法来求解W。此外,作者还探索了不同的损失函数和正则化方法,以提高线性变换的泛化能力。

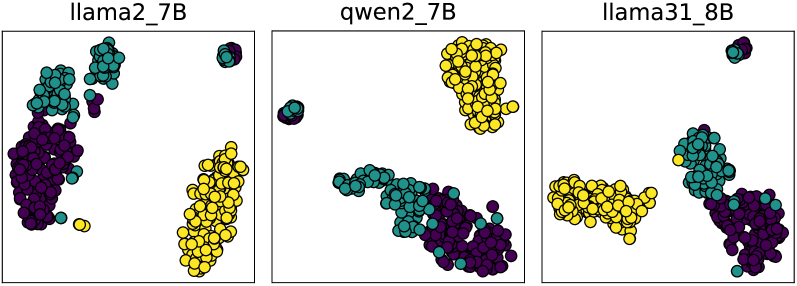

🖼️ 关键图片

📊 实验亮点

实验结果表明,该线性变换方法能够有效对齐不同LLM的概念表示,实现跨模型行为控制。例如,从较小的LLM中提取的steering vectors可以成功地控制较大的LLM生成特定内容。此外,该方法还具有良好的泛化能力,可以应用于不同的概念和LLM。

🎯 应用场景

该研究成果可应用于多个领域,例如:提升LLM安全性,通过迁移有害概念的抑制向量来防止生成有害内容;知识迁移,将小型LLM学习到的知识迁移到大型LLM,降低训练成本;个性化定制,根据用户偏好调整LLM的行为。未来,该方法有望促进LLM的协同训练和知识共享。

📄 摘要(原文)

Understanding the inner workings of Large Language Models (LLMs) is a critical research frontier. Prior research has shown that a single LLM's concept representations can be captured as steering vectors (SVs), enabling the control of LLM behavior (e.g., towards generating harmful content). Our work takes a novel approach by exploring the intricate relationships between concept representations across different LLMs, drawing an intriguing parallel to Plato's Allegory of the Cave. In particular, we introduce a linear transformation method to bridge these representations and present three key findings: 1) Concept representations across different LLMs can be effectively aligned using simple linear transformations, enabling efficient cross-model transfer and behavioral control via SVs. 2) This linear transformation generalizes across concepts, facilitating alignment and control of SVs representing different concepts across LLMs. 3) A weak-to-strong transferability exists between LLM concept representations, whereby SVs extracted from smaller LLMs can effectively control the behavior of larger LLMs.